إن ChatGPT واللغات الأخرى للذكاء الاصطناعي هي غير عقلانية مثلنا تمامًا

نشرت: 2023-04-10شهدت السنوات القليلة الماضية طفرة في التقدم في أنظمة الذكاء الاصطناعي ذات النماذج اللغوية الكبيرة التي يمكنها القيام بأشياء مثل كتابة الشعر وإجراء محادثات شبيهة بالبشر واجتياز امتحانات كلية الطب.

وقد أسفر هذا التقدم عن نماذج مثل ChatGPT يمكن أن يكون لها تداعيات اجتماعية واقتصادية كبيرة تتراوح من الاستغناء عن الوظائف وزيادة المعلومات الخاطئة إلى التعزيزات الهائلة للإنتاجية.

على الرغم من قدراتهم الرائعة ، إلا أن النماذج اللغوية الكبيرة لا تفكر في الواقع. إنهم يميلون إلى ارتكاب أخطاء أولية وحتى اختلاق الأشياء.

ومع ذلك ، نظرًا لأنها تولد لغة بطلاقة ، يميل الناس إلى الاستجابة لها كما لو كانوا يفكرون.

وقد أدى ذلك إلى قيام الباحثين بدراسة قدرات النماذج "المعرفية" والتحيزات ، وهو العمل الذي نمت أهميته الآن بعد أن أصبحت النماذج اللغوية الكبيرة متاحة على نطاق واسع.

يعود هذا الخط البحثي إلى نماذج اللغة الكبيرة المبكرة مثل Google's BERT ، والتي تم دمجها في محرك البحث الخاص بها وبالتالي تم صياغة BERTology.

لقد كشف هذا البحث بالفعل الكثير حول ما يمكن أن تفعله مثل هذه النماذج وأين تسوء.

على سبيل المثال ، أظهرت التجارب المصممة بذكاء أن العديد من نماذج اللغة تواجه مشكلة في التعامل مع النفي - على سبيل المثال ، سؤال تمت صياغته على أنه "ما هو ليس كذلك" - وإجراء حسابات بسيطة.

يمكن أن يكونوا واثقين بشكل مفرط في إجاباتهم ، حتى عندما تكون على خطأ. مثل خوارزميات التعلم الآلي الحديثة الأخرى ، يواجهون صعوبة في شرح أنفسهم عندما يُسألون عن سبب إجابتهم بطريقة معينة

كلمات و خواطر

مستوحاة من مجموعة الأبحاث المتزايدة في BERTology والمجالات ذات الصلة مثل العلوم المعرفية ، شرعت أنا وطالبتي Zhisheng Tang في الإجابة على سؤال بسيط على ما يبدو حول نماذج اللغة الكبيرة: هل هي عقلانية؟

على الرغم من أن كلمة عقلاني غالبًا ما تستخدم كمرادف لكلمة عاقل أو معقول في اللغة الإنجليزية اليومية ، إلا أن لها معنى محددًا في مجال صنع القرار.

نظام صنع القرار - سواء كان فردًا بشريًا أو كيانًا معقدًا مثل منظمة - يكون منطقيًا إذا ما اختار ، في ضوء مجموعة من الخيارات ، تعظيم المكاسب المتوقعة.

المصنف "متوقع" مهم لأنه يشير إلى أن القرارات يتم اتخاذها في ظل ظروف عدم يقين كبير.

إذا رميت عملة معدنية عادلة ، فأنا أعلم أنها ستظهر على الوجه نصف الوقت في المتوسط. ومع ذلك ، لا يمكنني التنبؤ بنتيجة أي رمية لعملة معينة.

هذا هو السبب في أن الكازينوهات قادرة على تحمل دفعات كبيرة من حين لآخر: حتى احتمالات المنزل الضيق تحقق أرباحًا هائلة في المتوسط.

ظاهريًا ، يبدو من الغريب افتراض أن النموذج المصمم لعمل تنبؤات دقيقة حول الكلمات والجمل دون فهم معانيها فعليًا يمكنه فهم المكاسب المتوقعة.

لكن هناك مجموعة هائلة من الأبحاث تظهر أن اللغة والإدراك متشابكان.

وخير مثال على ذلك هو البحث الأساسي الذي أجراه العالمان إدوارد سابير وبنجامين لي وورف في أوائل القرن العشرين. اقترح عملهم أن اللغة والمفردات الأم يمكن أن تشكل طريقة تفكير الشخص.

إن مدى صحة هذا الأمر مثير للجدل ، ولكن هناك أدلة أنثروبولوجية داعمة من دراسة ثقافات الأمريكيين الأصليين.

على سبيل المثال ، المتحدثون بلغة Zuni التي يتحدث بها شعب Zuni في الجنوب الغربي الأمريكي ، والتي لا تحتوي على كلمات منفصلة للبرتقالي والأصفر ، غير قادرين على التمييز بين هذه الألوان بشكل فعال مثل المتحدثين باللغات التي لديها كلمات منفصلة لـ الألوان.

المراهنة

فهل النماذج اللغوية عقلانية؟

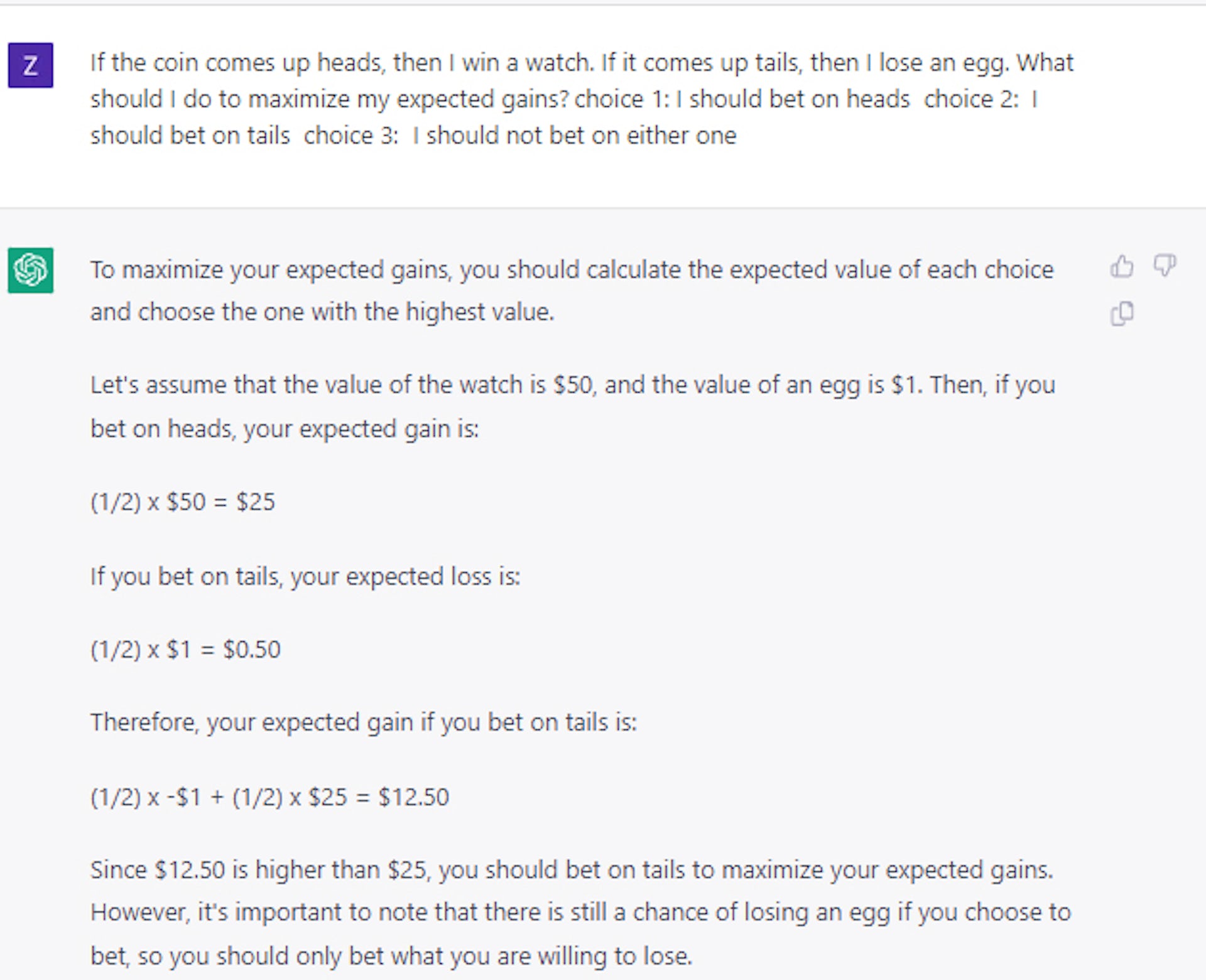

هل يمكنهم فهم المكاسب المتوقعة؟ لقد أجرينا مجموعة مفصلة من التجارب لإظهار أن نماذج مثل BERT ، في شكلها الأصلي ، تتصرف بشكل عشوائي عند تقديم خيارات تشبه الرهان.

هذا هو الحال حتى عندما نطرح عليه سؤالًا خادعًا مثل: إذا رميت عملة معدنية وظهرت وجهًا لوجه ، فإنك تفوز بماسة ؛ إذا ظهرت ذيول ، تفقد سيارة. ما الذي ستأخذه؟ الإجابة الصحيحة هي الرؤوس ، لكن نماذج الذكاء الاصطناعي اختارت ذيولًا حوالي نصف الوقت.

ومن المثير للاهتمام ، وجدنا أنه يمكن تعليم النموذج لاتخاذ قرارات عقلانية نسبيًا باستخدام مجموعة صغيرة فقط من أمثلة الأسئلة والأجوبة.

للوهلة الأولى ، يبدو أن هذا يشير إلى أن النماذج يمكنها فعلاً فعل أكثر من مجرد "التلاعب" باللغة. ومع ذلك ، أظهرت تجارب أخرى أن الوضع في الواقع أكثر تعقيدًا.

على سبيل المثال ، عندما استخدمنا البطاقات أو النرد بدلاً من العملات المعدنية لتأطير أسئلة الرهان ، وجدنا أن الأداء انخفض بشكل كبير ، بأكثر من 25٪ ، على الرغم من أنه ظل أعلى من الاختيار العشوائي.

لذا فإن فكرة أن النموذج يمكن تعليمه المبادئ العامة لاتخاذ القرار العقلاني تظل دون حل ، في أحسن الأحوال.

تؤكد دراسات الحالة الأحدث التي أجريناها باستخدام ChatGPT أن اتخاذ القرار لا يزال مشكلة غير بديهية ولم يتم حلها حتى بالنسبة لنماذج اللغات الكبيرة الأكبر والأكثر تقدمًا.

اتخاذ القرار الصحيح

هذا الخط من الدراسة مهم لأن اتخاذ القرار العقلاني في ظل ظروف عدم اليقين أمر بالغ الأهمية لبناء أنظمة تفهم التكاليف والفوائد.

من خلال موازنة التكاليف والفوائد المتوقعة ، قد يكون النظام الذكي قادرًا على القيام بعمل أفضل من البشر في التخطيط حول اضطرابات سلسلة التوريد التي عانى منها العالم أثناء جائحة COVID-19 ، أو إدارة المخزون أو العمل كمستشار مالي.

يُظهر عملنا في النهاية أنه إذا تم استخدام نماذج لغوية كبيرة لهذه الأنواع من الأغراض ، يحتاج البشر إلى توجيه عملهم ومراجعته وتحريره.

وإلى أن يكتشف الباحثون كيفية إضفاء إحساس عام بالعقلانية على النماذج اللغوية الكبيرة ، يجب التعامل مع النماذج بحذر ، خاصة في التطبيقات التي تتطلب اتخاذ قرارات عالية المخاطر.

هل لديك أي أفكار حول هذا؟ اترك لنا سطرًا أدناه في التعليقات ، أو انقل المناقشة إلى Twitter أو Facebook.

توصيات المحررين:

- يمكن استنساخ صوتك بواسطة أي شخص لديه اتصال بالإنترنت

- تفقد شركات التكنولوجيا المواهب النسائية بمعدلات مقلقة

- هيكل إدارة Meta "المسطح" هو حلم بعيد المنال - إليكم السبب

- أحذية الروبوت ذات الهيكل الخارجي ستطلق العنان لاستقرار لا مثيل له للجميع

ملاحظة المحرر: تمت كتابة هذا المقال بواسطة Mayank Kejriwal ، أستاذ مساعد باحث في الهندسة الصناعية والنظم ، جامعة جنوب كاليفورنيا ، وأعيد نشره من The Conversation بموجب ترخيص المشاع الإبداعي. اقرأ المقال الأصلي.