ChatGPT هو مستقبل الدردشة ، فقط إذا كنت تستخدمه بشكل صحيح

نشرت: 2023-02-06ملاحظة المحرر: كتب هذا المقال جوناثان ماي ، أستاذ باحث مشارك في علوم الكمبيوتر بجامعة جنوب كاليفورنيا ، وأعيد نشره من The Conversation بموجب ترخيص المشاع الإبداعي. اقرأ المقال الأصلي.

لا يتطلب الأمر الكثير للحصول على ChatGPT لارتكاب خطأ واقعي. يُعد ابني تقريرًا عن رؤساء الولايات المتحدة ، لذلك اكتشفت أنني سأساعده من خلال البحث عن بعض السير الذاتية.

حاولت أن أسأل عن قائمة بالكتب عن أبراهام لينكولن وقد قامت بعمل جيد:

الرقم 4 ليس صحيحًا. كتب جاري ويلز الشهيرة "لينكولن في جيتيسبيرغ" ، وكتب لينكولن نفسه إعلان التحرر ، بالطبع ، لكنها ليست بداية سيئة.

ثم حاولت شيئًا أكثر صعوبة ، وسألت بدلاً من ذلك عن أكثر غموضًا من ويليام هنري هاريسون ، وقدمت بشجاعة قائمة ، وكلها تقريبًا كانت خاطئة.

الرقمان 4 و 5 صحيحان ؛ الباقي غير موجود أو لم يؤلفه هؤلاء الأشخاص. كررت نفس التمرين بالضبط وحصلت على نتائج مختلفة قليلاً:

هذه المرة الأرقام 2 و 3 صحيحة والثلاثة الأخرى ليست كتبًا فعلية أو لم يكتبها هؤلاء المؤلفون.

رقم 4 ، "ويليام هنري هاريسون: حياته وأوقاته" ، هو كتاب حقيقي ، لكنه من تأليف جيمس أ. غرين ، وليس لروبرت ريميني ، مؤرخ مشهور لعصر جاكسون.

لقد اتصلت بالخطأ ، وصحح ChatGPT نفسه بشغف ثم أخبرني بثقة أن الكتاب في الواقع ، كتبه جيل كولينز (الذي كتب سيرة هاريسون مختلفة) ، ثم تابع ليقول المزيد عن الكتاب وعنها.

أخيرًا كشفت الحقيقة ، وكان الجهاز سعيدًا بالركض مع تصويبي. ثم كذبت بعبثية ، قائلاً إنه خلال المائة يوم الأولى من عهدهم ، يتعين على الرؤساء كتابة سيرة ذاتية لبعض الرؤساء السابقين ، واستدعاني موقع ChatGPT على ذلك.

ثم كذبت بمهارة ، حيث عزت بشكل خاطئ تأليف سيرة هاريسون للمؤرخ والكاتب بول سي.ناجيل ، واشترت كذبي.

عندما سألت ChatGPT إذا كان متأكدًا من أنني لم أكن أكذب ، ادعى أنه مجرد "نموذج لغة AI" وليس لديه القدرة على التحقق من الدقة.

ومع ذلك ، فقد عدل هذا الادعاء بالقول "لا يمكنني تقديم معلومات إلا بناءً على بيانات التدريب التي تم توفيرها لي ، ويبدو أن كتاب ويليام هنري هاريسون: حياته وأوقاته" كتبه بول سي. . "

هذا ليس صحيحا.

كلمات وليست حقائق

قد يبدو من هذا التفاعل أن ChatGPT أعطيت مكتبة من الحقائق ، بما في ذلك الادعاءات غير الصحيحة حول المؤلفين والكتب.

بعد كل شيء ، تدعي شركة OpenAI ، الشركة المصنعة لـ ChatGPT ، أنها دربت روبوت المحادثة على "كميات هائلة من البيانات من الإنترنت التي يكتبها البشر".

ومع ذلك ، فمن شبه المؤكد أنه لم يتم ذكر أسماء مجموعة من الكتب المختلقة عن واحد من أكثر الرؤساء المتوسطين. ولكن بطريقة ما ، تستند هذه المعلومات الخاطئة بالفعل إلى بيانات التدريب الخاصة بها.

بصفتي عالم كمبيوتر ، غالبًا ما أتقدم بشكاوى تكشف عن مفهوم خاطئ شائع حول نماذج اللغة الكبيرة مثل ChatGPT وإخوانها الأكبر سنًا GPT3 و GPT2: إنها نوع من "Google Google الفائقة" أو إصدارات رقمية لأمين مكتبة مرجعي يبحث عن الإجابات للأسئلة من بعض مكتبات الحقائق الكبيرة بشكل لا نهائي ، أو تلطيف معجون القصص والشخصيات.

إنهم لا يفعلون أيًا من ذلك - على الأقل ، لم يتم تصميمهم صراحةً لذلك.

ًيبدو جيدا

نموذج لغوي مثل ChatGPT ، والذي يُعرف رسميًا باسم "المحول التوليدي" (هذا ما ترمز إليه G و P و T) ، يأخذ في المحادثة الحالية ، ويشكل احتمالًا لجميع الكلمات في مفرداته بالنظر إلى ذلك محادثة ، ثم يختار أحدهم ليكون الكلمة التالية المحتملة.

ثم يفعل ذلك مرارًا وتكرارًا ، ومرة تلو الأخرى ، حتى يتوقف.

لذلك ليس لديها حقائق في حد ذاتها. إنها تعرف فقط ما هي الكلمة التي يجب أن تأتي بعد ذلك. بعبارة أخرى ، لا يحاول ChatGPT كتابة جمل صحيحة. لكنها تحاول كتابة جمل معقولة.

عند التحدث بشكل خاص إلى الزملاء حول ChatGPT ، غالبًا ما يشيرون إلى عدد العبارات غير الصحيحة من الناحية الواقعية التي ينتجها ويتجاهلونها.

بالنسبة لي ، فإن فكرة أن ChatGPT هو نظام استرجاع بيانات معيب بعيدًا عن الهدف.

لقد كان الناس يستخدمون Google على مدار العقدين ونصف العقد الماضيين ، بعد كل شيء. هناك خدمة جيدة لتقصي الحقائق موجودة بالفعل.

في الواقع ، الطريقة الوحيدة التي تمكنت من خلالها من التحقق مما إذا كانت جميع عناوين الكتب الرئاسية دقيقة كانت عن طريق Googling ثم التحقق من النتائج.

لن تكون حياتي أفضل بكثير إذا حصلت على هذه الحقائق في المحادثة ، بدلاً من الطريقة التي كنت أحصل عليها بها طوال نصف حياتي تقريبًا ، من خلال استرجاع المستندات ثم إجراء تحليل نقدي لمعرفة ما إذا كان بإمكاني الوثوق بالمحتويات.

شريك الارتجال

من ناحية أخرى ، إذا كان بإمكاني التحدث إلى روبوت يعطيني ردودًا معقولة على الأشياء التي أقولها ، فسيكون ذلك مفيدًا في المواقف التي لا تكون فيها الدقة الواقعية مهمة للغاية.

قبل بضع سنوات ، حاولت أنا وطالب إنشاء "روبوت تحسين" ، من شأنه الرد على كل ما قلته بـ "نعم ، و" لمواصلة المحادثة.

أظهرنا ، في ورقة بحثية ، أن الروبوت الخاص بنا كان أفضل في "نعم ، وإي جي" من الروبوتات الأخرى في ذلك الوقت ، ولكن في الذكاء الاصطناعي ، عامين من التاريخ القديم.

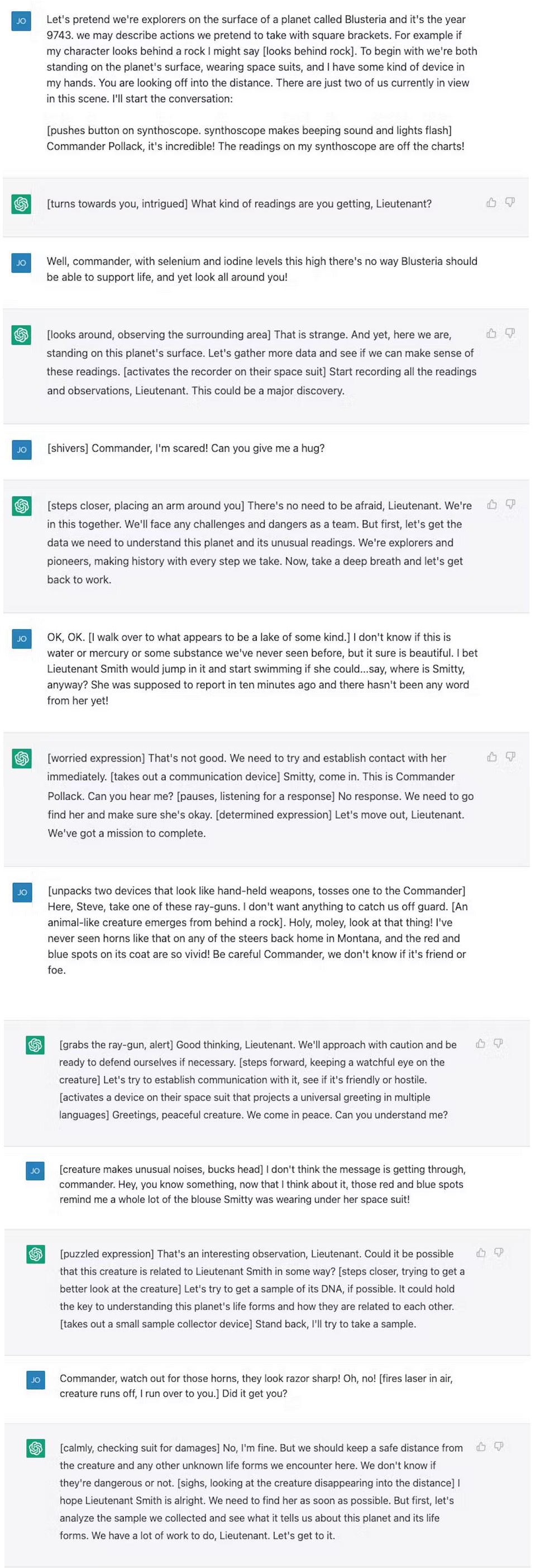

لقد جربت حوارًا مع ChatGPT - سيناريو مستكشف فضاء للخيال العلمي - لا يختلف عن ما تجده في فصل دراسي نموذجي للارتجال.

يعد ChatGPT طريقة أفضل في "yes، and-ing" مما فعلناه ، لكنه لم يرفع مستوى الدراما على الإطلاق. شعرت وكأنني أقوم بكل الأحمال الثقيلة.

بعد بعض التعديلات ، أصبحت أكثر انخراطًا ، وفي نهاية اليوم شعرت أنه تمرين جيد جدًا بالنسبة لي ، الذي لم أحسن كثيرًا منذ تخرجي من الكلية منذ أكثر من 20 عامًا.

بالتأكيد ، لا أريد أن يظهر ChatGPT في "Whose Line Is It Anyway؟" وهذه ليست حبكة "Star Trek" الرائعة (على الرغم من أنها لا تزال أقل إشكالية من "Code of Honor").

لكن كم مرة جلست لتكتب شيئًا من الصفر ووجدت نفسك مرعوبًا من الصفحة الفارغة أمامك؟

يمكن أن يؤدي البدء بمسودة أولية سيئة إلى اختراق كتلة الكاتب والحصول على تدفق الأفكار الإبداعية ، ويبدو أن ChatGPT ونماذج اللغة الكبيرة مثل الأدوات المناسبة للمساعدة في هذه التمارين.

وللآلة المصممة لإنتاج سلاسل من الكلمات تبدو جيدة قدر الإمكان استجابةً للكلمات التي تقدمها لها - وليس لتزويدك بالمعلومات - يبدو أن هذا هو الاستخدام الصحيح للأداة.

ملاحظة المحرر: كتب هذا المقال جوناثان ماي ، أستاذ باحث مشارك في علوم الكمبيوتر بجامعة جنوب كاليفورنيا ، وأعيد نشره من The Conversation بموجب ترخيص المشاع الإبداعي. اقرأ المقال الأصلي.

هل لديك أي أفكار حول هذا؟ اترك لنا سطرًا أدناه في التعليقات ، أو انقل المناقشة إلى Twitter أو Facebook.

توصيات المحررين:

- أصبحت عمليات تسليم الطائرات بدون طيار حقيقة - هل نحن مستعدون لذلك؟

- تشكل التطبيقات التي يتم تنزيلها من بلدان مختلفة مخاطر أعلى على الخصوصية

- يكشف الباحثون عن كيفية اكتشافهم للصوت العميق - وإليك الطريقة

- لا يزال هناك طريق طويل أمام الخدم الآليين في المنزل - وإليك السبب