GPT-4 Turbo vs. GPT-4: Was ist der ChatGPT Turbo von OpenAI?

Veröffentlicht: 2023-11-07OpenAI hielt seine jährliche DevDay-Konferenz ab und nutzte diese als Gelegenheit, eine Reihe von Änderungen an ChatGPT und anderen Produkten anzukündigen, darunter Großhandelspreissenkungen für Entwickler und ein brandneues Sprachmodell für den Chatbot namens Turbo. Hier erfahren Sie, was es ist und welche wesentlichen Unterschiede zwischen GPT-4 Turbo und GPT-4 Sie kennen sollten.

GPT Turbo ist eine fortgeschrittenere Version von GPT-4 mit einem viel größeren Kontextfenster und verfügt über Kenntnisse über Weltereignisse bis April 2023. OpenAI hat außerdem eine API gestartet, mit der Sie Assistenten erstellen und benutzerdefinierte Versionen davon erstellen können ChatGPT.

Allerdings sind die Änderungen derzeit nicht für alle ChatGPT-Benutzer verfügbar . Für jede der folgenden Änderungen/Ankündigungen haben wir Informationen darüber bereitgestellt, welche Kontoinhaber auf die verschiedenen Sprachmodelle zugreifen können.

- Was ist GPT-4 Turbo?

- ChatGPT Turbo vs. GPT-4 vs. GPT-3.5

- Was sind benutzerdefinierte GPTs?

- Was ist die Assistenten-API von OpenAI?

- Das reduzierte Preismodell von ChatGPT

- ChatGPT bei der Arbeit verwenden

Was ist GPT-4 Turbo?

GPT-4 Turbo ist das neueste Sprachmodell, das vom ChatGPT-Besitzer OpenAI veröffentlicht wurde. Es ist leistungsfähiger als die beiden vorherigen Sprachmodelle, die für ChatGPT verwendet wurden: GPT-4 und GPT-3.5.

ChatGPT hatte bekanntermaßen Schwierigkeiten, genaue Antworten auf Ereignisse zu geben , die nach der Abschaltung seines Trainingsdatensatzes stattfanden, was bis zu diesem Zeitpunkt im September 2021 erfolgte.

Der GPT-4 Turbo-Chatbot von OpenAI verfügt jedoch über Kenntnisse über Ereignisse bis April 2023 . Nachdem Elon Musks xAI einen Chatbot mit Zugriff auf Echtzeitinformationen auf den Markt gebracht hat, ist dies ein wichtiges Update in der aufkeimenden Rivalität zwischen Grok und ChatGPT .

Möchten Sie privat im Internet surfen? Oder so aussehen, als wären Sie in einem anderen Land?

Möchten Sie privat im Internet surfen? Oder so aussehen, als wären Sie in einem anderen Land?

Sichern Sie sich mit diesem Black Friday-Angebot von Tech.co satte 86 % Rabatt auf Surfshark. ![]()

GPT-4 Turbo kann Bilder als Eingaben und Text-zu-Sprache-Eingabeaufforderungen akzeptieren und lässt sich in DALLE-3 integrieren. Es verfügt außerdem über ein auf 128 KB vergrößertes Kontextfenster, sodass Eingabeaufforderungen verarbeitet werden können, die etwa 100 Textseiten entsprechen. Kurz gesagt: GPT-4 Turbo vs. GPT-4 ist ein klarer Sieg für das neuere Modell, aber es steckt noch viel mehr dahinter.

Wer kann auf GPT-4 Turbo zugreifen?

OpenAI sagt, dass „GPT-4 Turbo allen zahlenden Entwicklern zum Ausprobieren zur Verfügung steht, indem GPT-4-1106-preview in der API übergeben wird“, und gab bekannt, dass das Unternehmen plant, „das stabile, produktionsreife Modell in den kommenden Wochen“ zu veröffentlichen. ”

GPT 4 Turbo vs. GPT-4 vs. GPT-3.5 Turbo: Vergleich der ChatGPT-Modelle

Es gibt eine Reihe wesentlicher Unterschiede zwischen den OpenAI-Modellen. GPT-4 Turbo ist ein bedeutendes Upgrade seines Schwestermodells GPT-4 – das sich selbst recht stark von GPT-3.5 unterscheidet, dem Sprachmodell, das ChatGPT bei seiner ersten Einführung im November 2022 unterstützte.

Zusammen mit der Veröffentlichung von GPT-4 Turbo hat OpenAI auch eine neue Version von GPT-3.5 namens GPT-3.5 Turbo veröffentlicht , die standardmäßig über ein 16-KByte-Kontextfenster verfügt und eine verbesserte Befehlsfolge aufweist. Das Unternehmen hat bestätigt, dass alle Anwendungen, die das alte GPT-3.5 Turbo-Modell verwenden, am 11. Dezember 2023 aktualisiert werden.

Hier sind die wichtigsten Unterschiede zwischen GPT-3.5 Turbo, GPT-4 und GPT-4.5 Turbo:

Name | Ersteller-Besitzer | Bis dahin auf Daten geschult | Zugänglich für | Schnelle Eingaben | Kontextfenster | |

|---|---|---|---|---|---|---|

|  |  | ||||

GPT-3.5 | GPT-4 | GPT-4 Turbo | ||||

OpenAI | OpenAI | OpenAI | ||||

September 2021 | September 2021 | April 2023  | ||||

Alle ChatGPT-Benutzer | ChatGPT Plus-Benutzer | Bezahlende Entwickler (Vorschau) | ||||

Text | Text | Text | ||||

16.385 Token (GPT-3.5 Turbo-1106) | 8.192 Token (GPT-4) | 128.000 Token |

Was sind benutzerdefinierte GPTs?

OpenAI bringt jetzt ein neues Produkt namens „GPTs“ auf den Markt, das sie als „benutzerdefinierte Versionen von ChatGPT, die Sie für einen bestimmten Zweck erstellen können“ beschreiben. OpenAI sieht vor, dass Menschen sie für Aufgaben zu Hause und am Arbeitsplatz bauen und diese Kreationen dann mit anderen teilen .

Auf der DevDay-Konferenz haben OpenAI-Mitarbeiter ihre eigenen Chatbot-Agenten entwickelt – und es sieht so aus, als könnte jeder Wissensarbeiter so etwas tun. Es sind keine Programmierkenntnisse erforderlich.

Laut OpenAI könnten Sie ein benutzerdefiniertes GPT erstellen, das Datenanalysen durchführt oder sogar das Web nach Informationen durchsucht . „Viele Power-User führen eine Liste sorgfältig erstellter Eingabeaufforderungen und Befehlssätze und kopieren diese manuell in ChatGPT“, sagte das Unternehmen kürzlich in einem Blogbeitrag. „GPTs erledigen das jetzt alles für Sie.“

Bald wird OpenAI innerhalb eines Monats einen GPT-Store haben . In diesem Fall erhalten Entwickler eine völlig neue Möglichkeit , mit ChatGPT Geld zu verdienen, denn laut OpenAI können damit diejenigen, die die beliebtesten GPTs erstellen, über den Store Geld verdienen.

Wer kann auf die benutzerdefinierten GPTs von ChatGPT zugreifen?

OpenAI sagt, dass Sie heute mit der Erstellung von GPTs beginnen – aber ein Beitrag auf dem Hilfeportal von OpenAI bestätigt, dass es nur für ChatGPT Plus- und Enterprise- Kunden verfügbar ist.

Wenn Sie ein kostenloser Benutzer sind und versuchen, auf eines der Beispiel-GPTs des Unternehmens zuzugreifen (es gibt bereits ein Canva- und ein Zapier-GPT), werden Sie darüber informiert, dass Sie etwas länger auf den Zugriff warten müssen . Zahlende Kunden können auf diese Beispielversionen zugreifen.

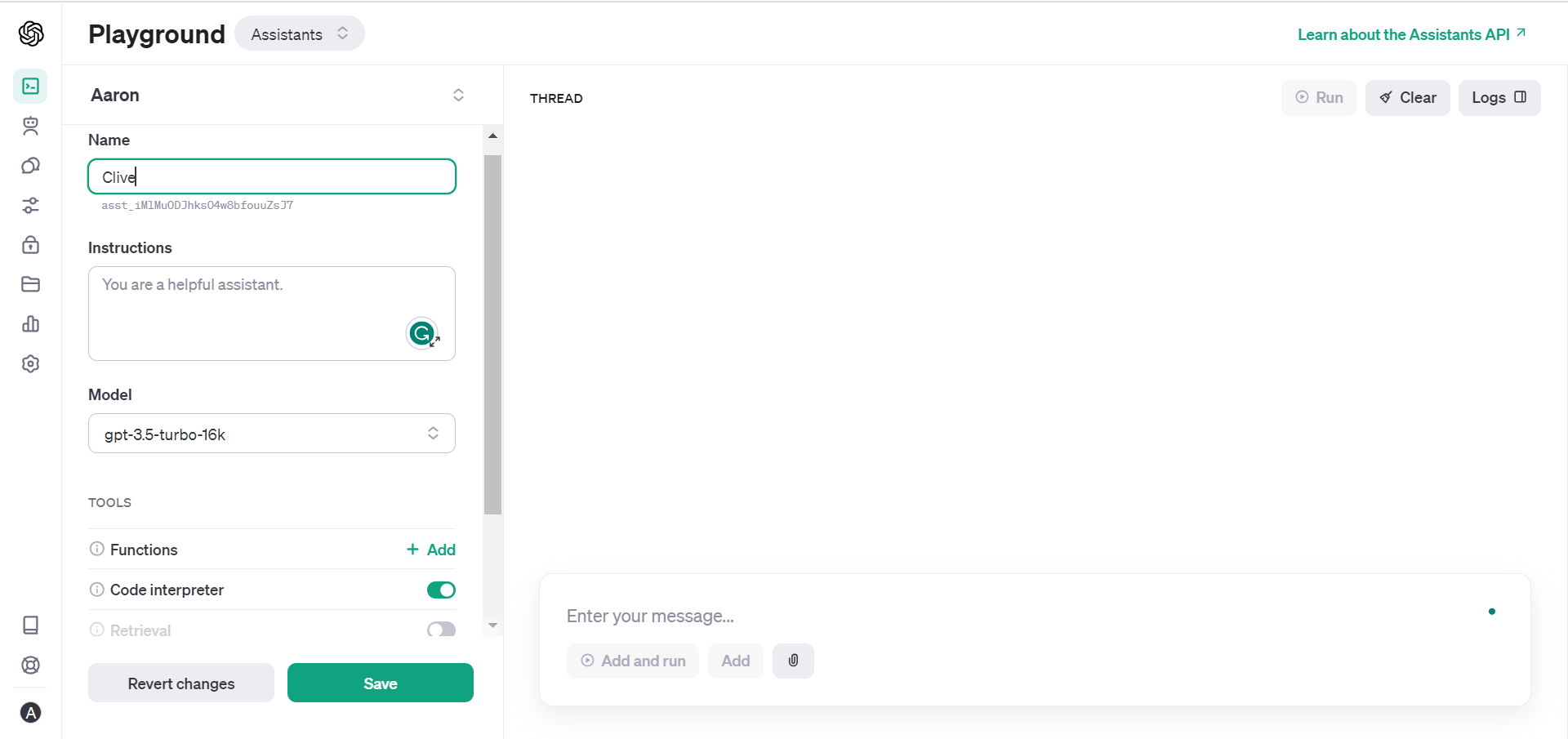

Was ist die Assistenten-API von OpenAI?

Die neue Assistenten-API von ChatGPT basiert auf derselben Technologie wie die neuen benutzerdefinierten GPTs, mit dem Ziel, „Menschen dabei zu helfen, agentenähnliche Erfahrungen in ihren eigenen Anwendungen zu erstellen“.

Zu den von OpenAI bereitgestellten Anwendungsbeispielen gehören eine Datenanalyse-App, ein Assistent, der beim Codieren hilft, und ein KI-gestützter Urlaubsplaner .

Sie können Ihren Assistenten mit Informationen und Daten aus Ihrer Organisation erweitern, obwohl OpenAI bekräftigt, dass die von Ihnen in die Modelle eingegebenen Daten nicht zum Trainieren dieser Modelle verwendet werden und dass Entwickler die Daten jederzeit löschen können.

Wer kann auf die Assistants API zugreifen?

Sie können jetzt auf die Betaversion der Assistants API zugreifen, indem Sie sich mit denselben Anmeldeinformationen anmelden, die Sie für den Zugriff auf ChatGPT verwenden. Obwohl keine Programmierung erforderlich ist, benötigen Sie grundlegende technische Kenntnisse, um dieses Tool effektiv nutzen zu können.

Das reduzierte Preismodell von ChatGPT

ChatGPT hat außerdem angekündigt, die Token-Preise zu senken und dabei „Einsparungen an Entwickler weiterzugeben“.

Token – die Grundeinheiten, die große Sprachmodelle verarbeiten – werden jetzt bei mehreren GPT-Modellen deutlich günstiger sein. OpenAI beschreibt Token als Wortteile ; Eingabe-Tokens sind die Wortteile, aus denen Eingabeaufforderungen bestehen, während Ausgabe-Tokens Antworten bilden.

GPT-4 Turbo- Eingabetoken sind jetzt dreimal günstiger als GPT-4-Token. Sie kosten nur 0,01 US-Dollar, während Ausgabetoken 0,03 US-Dollar kosten, was der Hälfte des Preises für GPT-4 entspricht.

GPT-3.5-Turbo-Token sind außerdem dreimal günstiger als die vorherige Version von GPT-3.5 mit dem 16K-Kontextfenster für 0,001 US-Dollar, während Ausgabe-Token ebenfalls zum halben Preis erhältlich sind und nur 0,002 US-Dollar pro Token kosten.

Für Entwickler, die die 4K-Kontextfensterversion von GPT-3.5 Turbo verwenden, werden die Token-Preise um 33 % (jetzt 0,001 $) gesenkt. Diese Preise beziehen sich ausschließlich auf die neue 16K-Version auf GPT-3.5 Turbo .

ChatGPT bei der Arbeit verwenden

Arbeitnehmer auf der ganzen Welt finden jeden Tag neue, einfallsreiche Möglichkeiten, ChatGPT zu nutzen . Die Verwendung eines so leistungsstarken Tools zur Reduzierung der Zeit, die Sie für Aufgaben aufwenden, bringt jedoch eine Reihe unterschiedlicher Überlegungen mit sich.

Einerseits glauben die meisten Unternehmensleiter, dass Mitarbeiter um Erlaubnis fragen sollten, bevor sie KI-Tools wie ChatGPT am Arbeitsplatz verwenden. Wenn Sie vorhaben, KI für eine Aufgabe einzusetzen, stellen Sie sicher, dass Sie dies gegenüber Ihrem Vorgesetzten/Abteilungsleiter transparent machen , um Verwirrung und Fehler zu vermeiden.

Dies ist besonders wichtig, wenn Sie damit etwas generieren, das Sie mit Kunden teilen. Wie Sie vielleicht wissen, neigen ChatGPT und andere KI-Tools wie Bard dazu, zu „halluzinieren“ – daher ist das Korrekturlesen und Überprüfen der von ihnen für Sie erstellten Inhalte unerlässlich und nicht optional.

Es ist auch wichtig, Ihre Nutzung transparent zu machen, denn was ChatGPT mit Ihren Daten macht, hängt davon ab, welches Produkt Sie verwenden, und es gibt Möglichkeiten, die Nutzung für Schulungszwecke zu deaktivieren. Außerdem können die Richtlinien Ihres Arbeitsplatzes zu der Art der Aufgabe, bei der Sie sich an ChatGPT wenden können, mit der Art von Daten verknüpft sein, die Sie gerne mit ihm teilen.