So erkennen Sie ChatGPT- und KI-Plagiate

Veröffentlicht: 2023-06-22ChatGPT hat die akademische und geschäftliche Welt mit seiner Fähigkeit, in Sekundenschnelle kohärente, gut geschriebene Texte zu praktisch jedem Thema auf der Welt zu erstellen, auf den Kopf gestellt.

Seine bemerkenswerten Fähigkeiten haben dazu geführt, dass sich Schüler aller Bildungsniveaus – ebenso wie seine Konkurrenten wie Bard – an den Chatbot gewandt haben, um komplexe Aufsätze zu schreiben, deren Fertigstellung sonst Stunden dauern würde.

Dies hat eine weltweite Diskussion über ein neues Phänomen ausgelöst, das oft als „ChatGPT-Plagiat“ bezeichnet wird. Dieser Leitfaden behandelt die Tools, die Unternehmen und Bildungseinrichtungen verwenden, um ChatGPT-Plagiate zu erkennen, die Gefahren des Betrugs mit ChatGPT – und ob die Verwendung von ChatGPT überhaupt als Plagiat gilt.

- So erkennen Sie ChatGPT-Plagiate

- Die beliebtesten KI- und ChatGPT-Plagiatsprüfer

- Funktionieren KI-Inhaltsprüfer tatsächlich?

- Ist die Verwendung von ChatGPT oder Bard tatsächlich ein Plagiat?

- Die Gefahren des Betrugs mit ChatGPT

- Plagiiert ChatGPT?

- Plagiiert Bard?

- Plagiieren andere KI-Tools?

- Sollte ich ChatGPT für meine Aufsätze oder meine Arbeit verwenden?

So erkennen Sie ChatGPT-Plagiate

Um ChatGPT-Plagiate zu erkennen, benötigen Sie einen KI-Inhaltsprüfer. KI-Inhaltsprüfer scannen Textkörper, um festzustellen, ob sie von einem Chatbot wie ChatGPT oder Bard oder von einem Menschen erstellt wurden. Wie wir später noch besprechen werden, sind diese Tools jedoch alles andere als zuverlässig.

Es ist etwas schwieriger, Plagiate zu erkennen, wenn es um Code geht, etwas, das ChatGPT ebenfalls kompetent generieren kann. Es gibt nicht ganz das gleiche Ökosystem an KI-Erkennungstools für Code wie für Inhalte.

Wenn Sie sich jedoch beispielsweise in einer Universitätsumgebung befinden und Code einreichen, der weit über Ihr technisches Niveau hinausgeht, hat Ihr Professor oder Dozent möglicherweise den begründeten Verdacht, dass Sie ChatGPT um Hilfe gebeten haben.

Die beliebtesten KI- und ChatGPT-Tools zur Plagiatsprüfung im Test

Seit dem Start von ChatGPT im November 2022 haben viele Unternehmen und Bildungseinrichtungen KI-Inhaltsprüfer entwickelt, die behaupten, zwischen künstlich generierten Inhalten und von Menschen erstellten Inhalten unterscheiden zu können. Mittlerweile nutzen viele Unternehmen auch Googles Chatbot Bard, der ein anderes Sprachmodell verwendet.

Allerdings ist die angebliche Genauigkeit selbst der renommiertesten Tools zur Erkennung von KI-Inhalten heftig umstritten, und es kam bereits zu Gerichtsverfahren zwischen Studenten, denen fälschlicherweise vorgeworfen wurde, KI-Inhalte und -Bildung zu verwenden.

Das Fazit lautet: Kein Werkzeug in diesem Bereich ist 100 % genau, aber einige sind viel besser als andere.

GPTZero

GPTZero ist ein beliebtes, kostenloses Tool zur Erkennung von KI-Inhalten, das behauptet, es sei „der genaueste KI-Detektor für alle Anwendungsfälle, verifiziert durch mehrere unabhängige Quellen“.

Allerdings bewies bereits im April ein Geschichtsstudent an der UC Davis, dass GPTZero – ein von seinem Professor verwendetes Tool zur Erkennung von KI-Inhalten – falsch war, als es seinen Aufsatz als KI-generiert bezeichnete.

Wir haben GPTZero getestet, indem wir ChatGPT gebeten haben, eine Kurzgeschichte zu schreiben. Leider konnte GPTZero nicht erkennen, dass der Inhalt von einem KI-Tool geschrieben wurde:

Originalität.ai

Originality.ai ist sicherlich eines der genaueren Tools zur KI-Inhaltserkennung, die derzeit verfügbar sind.

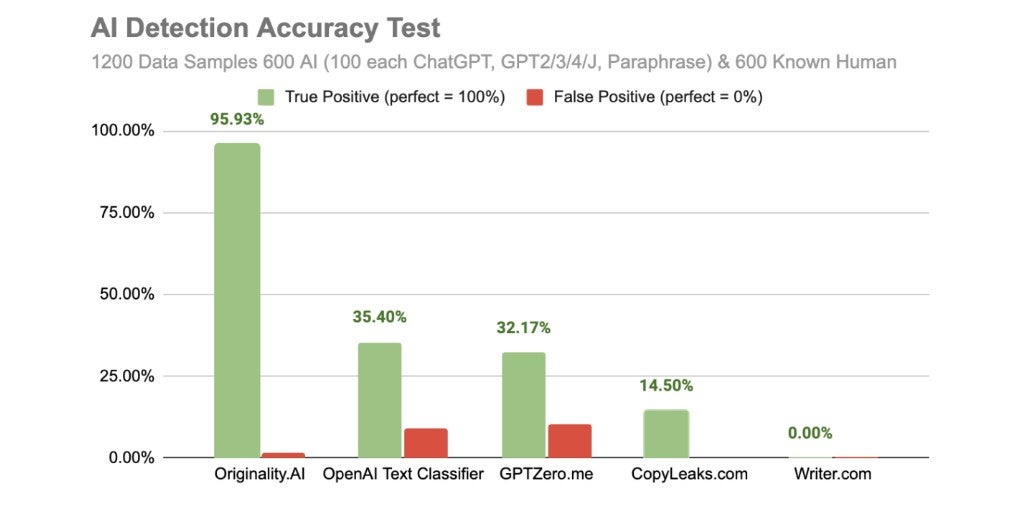

Das Unternehmen führte im April dieses Jahres eine eigene Studie zu KI-Tools zur Inhaltserkennung durch, in deren Rahmen es 600 künstlich erzeugte und 600 von Menschen generierte Textblöcke in sein eigenes Inhaltserkennungssystem einspeiste, sowie andere beliebte Tools, die behaupten, dass sie ähnliches leisten .

Wie Sie den folgenden Ergebnissen entnehmen können, übertraf Originality.ai alle im Test enthaltenen Tools:

Der einzige Nachteil von Originality.ai besteht darin, dass es keinen kostenlosen Plan gibt und Sie es nicht einmal kostenlos testen können, wie dies bei den anderen in diesem Artikel enthaltenen Apps der Fall ist. Es kostet 20 US-Dollar für 2.000 Credits, sodass Sie 200.000 Wörter überprüfen können.

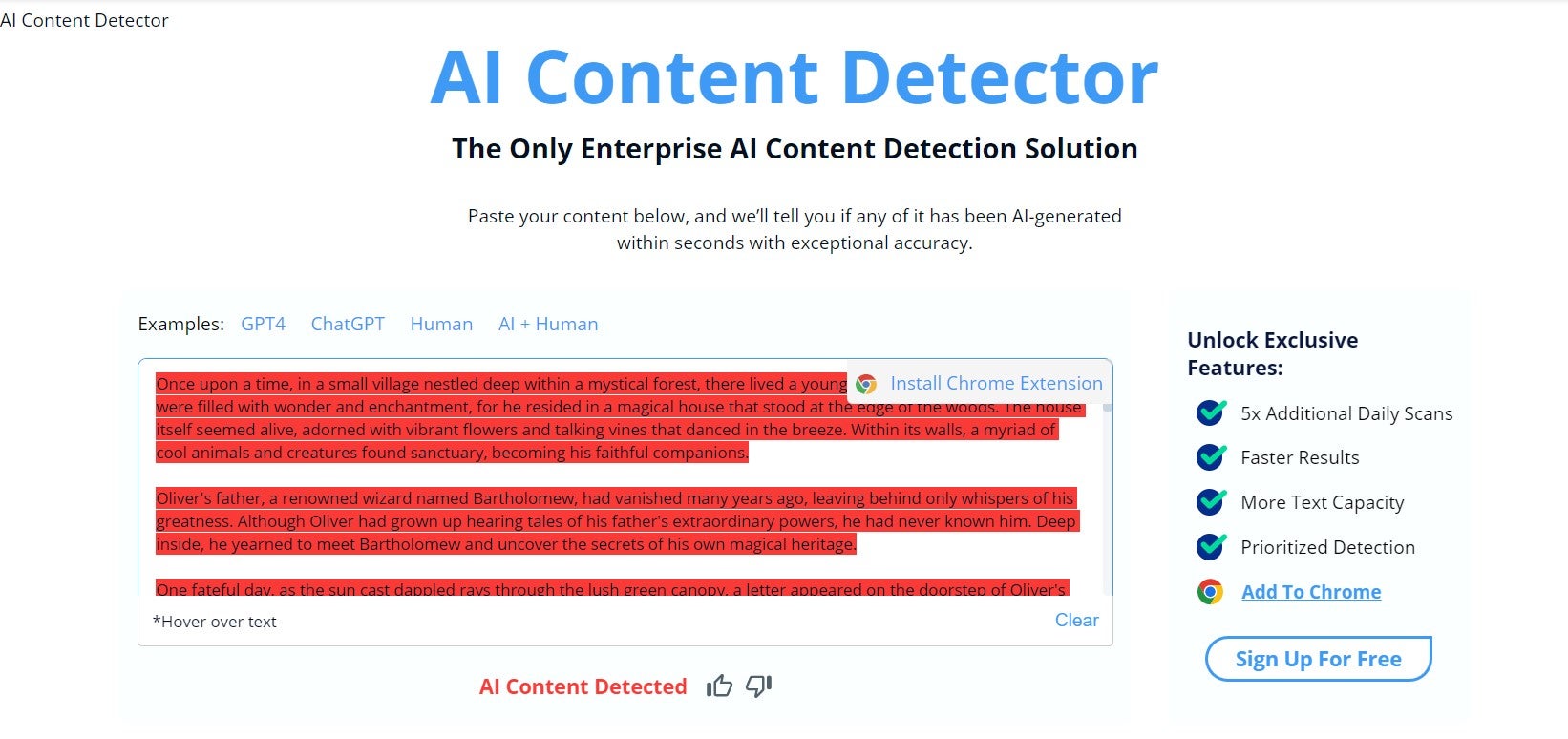

Copyleaks AI Content Detector

Copyleaks ist ein kostenloser KI-Inhaltsdetektor, der angeblich in der Lage ist, mit einer Genauigkeit von 99,12 % zwischen von Menschen erstellten und KI-generierten Kopien zu unterscheiden.

Copyleaks sagt Ihnen auch, ob bestimmte Aspekte eines Dokuments oder einer Passage von KI geschrieben wurden, auch wenn andere Teile davon scheinbar von einem Menschen geschrieben wurden.

Copyleaks sagt, dass es in der Lage ist, KI-generierte Inhalte zu erkennen, die von „ChatGPT, GPT-4, GPT-3, Jasper und anderen“ erstellt wurden, und behauptet sogar, dass „sobald neuere Modelle auf den Markt kommen, wir sie automatisch erkennen können.“

CopyLeaks kostet 8,33 $ pro Monat für 1.200 Credits (250 Wörter Kopie pro Credit).

In einem von TechCrunch im Februar 2023 durchgeführten Test stufte Copyleaks jedoch verschiedene Arten von KI-generierten Kopien, darunter einen Nachrichtenartikel, einen Enzyklopädieeintrag und ein Anschreiben, fälschlicherweise als von Menschen erstellt ein.

Darüber hinaus kam die oben erwähnte Studie von Originality.ai zu dem Ergebnis, dass sie nur in 14,50 % der Fälle korrekt ist – weit entfernt von der von CopyLeaks behaupteten Genauigkeit von 99,12 %.

Als wir es jedoch testeten, schien es zu erkennen, dass der von uns eingegebene Text von ChatGPT generiert wurde:

Turnitin KI-Detektor

Turnitin ist ein in den USA ansässiges Unternehmen zur Plagiatserkennung, das von verschiedenen Universitäten eingesetzt wird, um die Arbeiten ihrer Studenten zu scannen. Turnitin soll alle Arten von Plagiaten erkennen, gab jedoch im April bekannt, dass das Unternehmen bereits seit einiger Zeit in ein KI-fokussiertes Team investiert.

Turnitin sagt, dass es „das Vorhandensein von KI-Schreiben mit 98-prozentiger Sicherheit und einer Falsch-Positiv-Rate von weniger als einem Prozent in unserer kontrollierten Laborumgebung erkennen kann“.

Das Unternehmen sagt jedoch auch, dass Inhalte, die sie als KI-generiert kennzeichnen, als „Hinweis und nicht als Anschuldigung“ behandelt werden sollten. Die wahre Genauigkeit des KI-Detektors von Turnitin wurde von der Washington Post und anderen Quellen bestritten.

Die KI-Inhaltserkennungssoftware von Turnitin ist derzeit kostenlos, aber das Unternehmen gibt in einer FAQ auf seiner Website an, dass es im Januar 2024 auf ein kostenpflichtiges Lizenzprogramm umsteigen wird – der Preis dafür ist nicht angegeben.

OpenAI-Textklassifikator

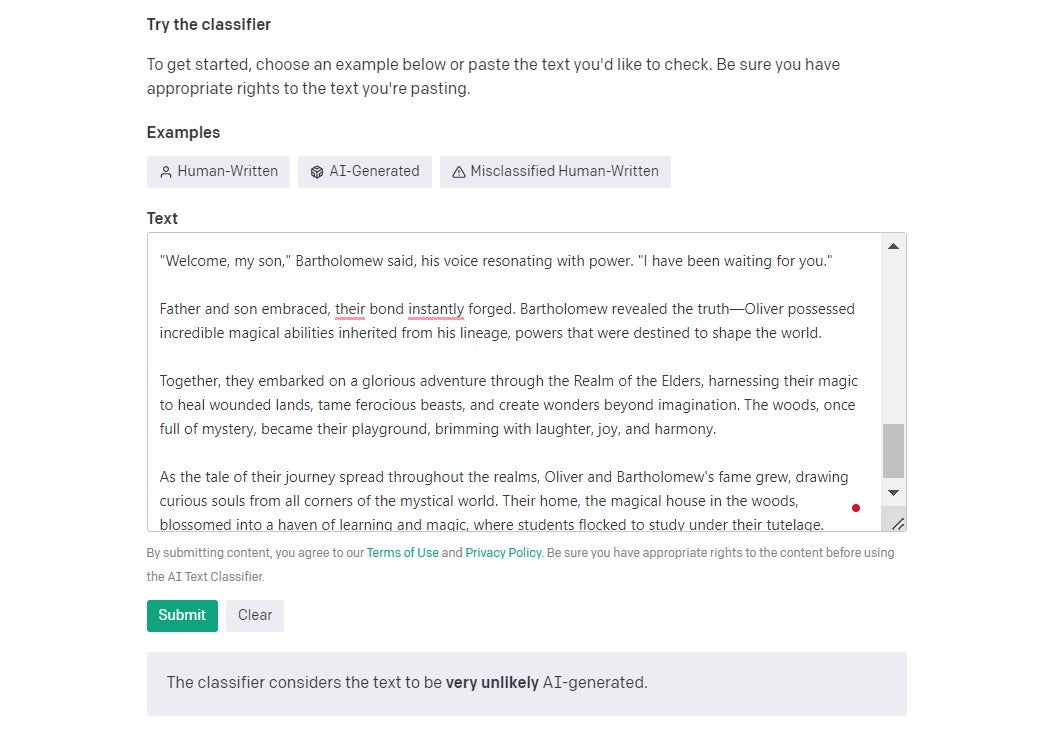

OpenAI will sich nicht von KI-Inhaltsprüfern Dritter ausmanövrieren lassen und hat selbst eine Software herausgebracht, die dazu dient, zu klassifizieren, ob Inhalte von KI generiert wurden.

Das von Ihnen eingegebene Dokument oder der Text muss mehr als 1000 Zeichen lang sein. Sobald Sie Ihr Dokument eingegeben haben, teilt Ihnen OpenAI fast sofort mit, wie wahrscheinlich es ist, dass es von Menschen erstellt wurde.

Ich habe einen Auszug aus einem kürzlich von einem Autor verfassten Tech.co-Artikel gepostet, bei dem OpenAI zu Recht feststellte, dass es „sehr unwahrscheinlich“ sei, dass er von KI geschrieben wurde.

In demselben TechCrunch-Artikel, auf den wir zuvor verwiesen haben, heißt es in der Veröffentlichung, dass OpenAI schätzt, dass sein Textklassifikator 74 % der KI-generierten Inhalte übersieht. Es ist gut, dass sie auch hier so ehrlich sind – als wir einen zweiten Test mit einer von ChatGPT generierten Kurzgeschichte durchführten, wurde die Tatsache, dass sie KI-generiert war, nicht berücksichtigt:

Funktioniert die KI-Inhaltserkennung tatsächlich?

Kein Tool zur Erkennung von KI-Inhalten ist 100 % zuverlässig – das beweisen unsere Tests ziemlich deutlich.

Allerdings erhebt keines der Tools, die wir heute besprochen haben, tatsächlich den Anspruch, 100 % genau zu sein, und nur sehr wenige behaupten, absolut frei von Fehlalarmen zu sein. Andere, wie GPTZero, veröffentlichen Haftungsausschlüsse darüber, dass sie ihre Ergebnisse als Evangelium betrachten.

Mehrere Universitätsstudenten, denen vorgeworfen wird, bei der Erstellung von Essays künstliche Intelligenz eingesetzt zu haben, wurden bereits gezwungen, die Originalität ihrer Arbeit nachzuweisen.

In Texas ließ ein Professor im März fälschlicherweise eine ganze Klasse von Studenten durchfallen, nachdem er ihnen zu Unrecht vorgeworfen hatte, ChatGPT zum Schreiben von Aufsätzen zu verwenden. Es gibt auch eine Reihe von Berichten – und Studien wie die von Originality.ai –, die darauf hinweisen, dass selbst die fähigsten Plagiatsprüfer bei weitem nicht so genau sind, wie sie behaupten.

Selbst der KI-Inhaltsdetektor von Turnitin ist nicht narrensicher. In dem kürzlich von der Washington Post durchgeführten, relativ kleinen Test, den wir zuvor besprochen haben, blieb die Genauigkeit weit hinter den angeblichen 98 % zurück.

Originality.ai hingegen ist sicherlich eines der robusteren auf dem Markt – und selbst seine Erkennungstechnologie stimmt nicht immer.

Wenn darüber hinaus in irgendeiner Form falsch positive Ergebnisse vorliegen, besteht für Studierende immer die Möglichkeit zu behaupten, ihre Arbeit sei originell und lediglich falsch identifiziert worden.

Ist die Verwendung von ChatGPT oder Bard ein Plagiat?

Es ist fraglich, ob es sich bei ChatGPT überhaupt um ein Plagiat handelt. Oxford Languages definiert Plagiat als „die Praxis, die Arbeit oder Ideen einer anderen Person zu übernehmen und sie als die eigenen auszugeben.“

ChatGPT ist keine Person und reproduziert nicht einfach die Arbeit und Ideen anderer Menschen, wenn es eine Antwort generiert. Nach der Wörterbuchdefinition handelt es sich also nicht um ein reines Plagiat.

Selbst wenn es so wäre, wäre es, wenn man ehrlich wäre, woher es kommt (z. B. ChatGPT), wohl sowieso kein Plagiat.

Einige Schulen und Universitäten haben jedoch weitreichende Plagiatsregeln und erwägen den Einsatz von Chatbots zum Verfassen von Aufsätzen. Ein Student der Furman University hat im Dezember sein Philosophiestudium nicht bestanden, nachdem er ChatGPT zum Verfassen seines Aufsatzes verwendet hatte. In einem anderen Fall berichtete ein Professor der Northern Michigan University, wie er zwei Studenten dabei erwischte, wie sie den Chatbot nutzten, um Aufsätze für ihre Klasse zu schreiben.

ChatGPT zu verwenden, um Aufsätze zu erstellen und diese dann als Ihre eigene Arbeit auszugeben, lässt sich vielleicht besser als „Betrug“ beschreiben und ist definitiv „unehrlich“.

Beim Schreiben eines Aufsatzes geht es darum, zu zeigen, dass Sie in der Lage sind, originelle Gedanken zu formulieren, relevante Konzepte zu verstehen, widersprüchliche Argumente sorgfältig abzuwägen, Informationen klar darzustellen und Ihre Quellen zu zitieren.

Es gibt kaum einen Unterschied zwischen der Verwendung von ChatGPT auf diese Weise und der Bezahlung eines anderen Studenten, der Ihren Aufsatz für Sie schreibt – was natürlich Betrug ist.

Im Hinblick auf Googles Bard ist die Antwort etwas komplizierter. Die oben verwendete Logik gilt für Bard wie für ChatGPT, aber Bard wurde durch Plagiatsvorwürfe und die falsche Zitierung von Dingen, die es aus dem Internet bezieht, in einer Weise beeinträchtigt, die ChatGPT nicht getan hat. Die Verwendung von Bard könnte also dazu führen, dass Sie versehentlich andere Quellen plagiieren ( mehr dazu weiter unten ).

Die Gefahren des Betrugs mit ChatGPT

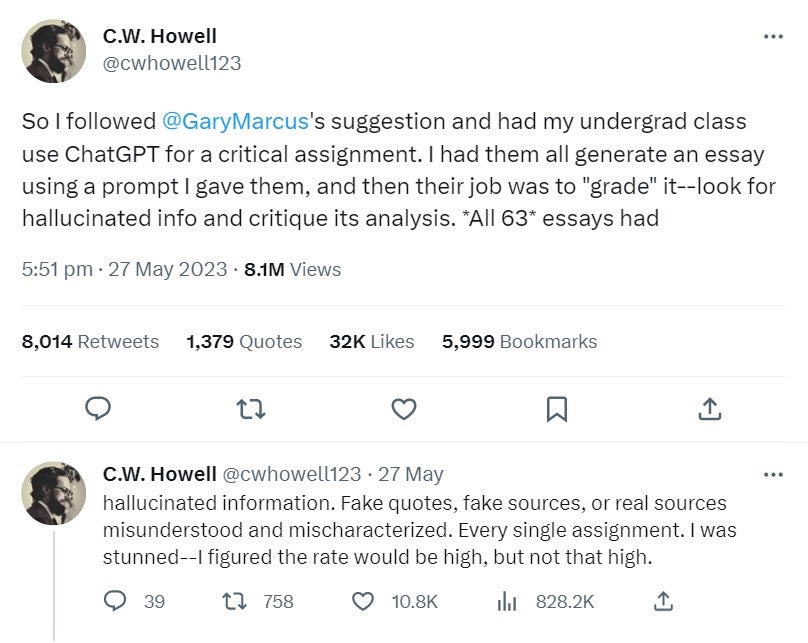

Christopher Howell, außerordentlicher Assistenzprofessor an der Elon University, hat kürzlich eine Gruppe von Studenten gebeten, ChatGPT für eine kritische Aufgabe zu verwenden und dann die für sie erstellten Aufsätze zu bewerten.

Er berichtete in einem langen Twitter-Thread (der erste Teil davon ist unten abgebildet), dass alle 63 teilnehmenden Schüler in ihren Aufgaben irgendeine Form von „Halluzination“ fanden – einschließlich gefälschter Zitate sowie gefälschter und falsch interpretierter Quellen.

Plagiiert ChatGPT in seinen Antworten?

Nein – ChatGPT bezieht keine Informationen aus anderen Quellen und fügt sie einfach Satz für Satz zusammen. Dies ist ein Missverständnis darüber, wie generative vorab trainierte Transformatoren funktionieren.

ChatGPT – oder genauer gesagt das GPT-Sprachmodell – wird anhand eines riesigen Datensatzes aus Dokumenten, Website-Material und anderem Text trainiert.

Es verwendet Algorithmen, um sprachliche Sequenzen und Muster in seinen Datensätzen zu finden. Anschließend können Absätze, Sätze und Wörter generiert werden, basierend auf dem, was das Sprachmodell aus Sequenzen in diesen Datensätzen über Sprache gelernt hat.

Aus diesem Grund sind die Antworten, wenn Sie ChatGPT gleichzeitig von zwei verschiedenen Geräten aus stellen, in der Regel sehr ähnlich – es gibt jedoch dennoch Unterschiede und manchmal werden völlig unterschiedliche Antworten angeboten.

Plagiiert Bard in seinen Antworten?

Der größte Konkurrent von ChatGPT, Bard von Google, hatte seit seiner Einführung deutlich mehr Probleme mit der Plagiierung von Inhalten als sein populäreres Gegenstück. Die Technologie-Website Tom's Hardware stellte fest, dass Bard einen ihrer Artikel plagiiert hatte, und entschuldigte sich dann, als einer ihrer Mitarbeiter dies anprangerte.

Kürzlich, im Mai 2023, teilte PlagiarismCheck Yahoo News mit, dass sie mit Bard 35 Textstücke generiert hätten und bei 25 von ihnen einen Plagiatsanteil von mehr als 5 % festgestellt hätten, indem sie einfach bereits im Internet veröffentlichte Inhalte umschrieben hätten.

Ein großer Unterschied zwischen Bard und ChatGPT, der dies vielleicht erklären kann, besteht darin, dass Bard das Internet nach Antworten durchsuchen kann, weshalb es tendenziell besser mit Fragen zu Ereignissen nach 2021 umgeht, mit denen ChatGPT zu kämpfen hat. Dies scheint jedoch auch zu bedeuten, dass Daten auf weniger originelle Weise aus Quellen entnommen werden und die Quellen häufiger zitiert werden.

Bei diesen Beispielen mag es sich um Ausrutscher handeln, aber es ist gut, die Risiken zu kennen, wenn Sie Bard für wichtige Arbeiten verwenden.

Plagiieren andere KI-Tools?

Leider ja – und einige Unternehmen haben sich bereits durch den Einsatz von KI-Tools blamiert, die Inhalte plagiiert haben. Beispielsweise wurde festgestellt, dass CNET – eine der größten Technologieseiten der Welt – ein KI-Tool zur Generierung von Artikeln nutzte und dies überhaupt nicht transparent machte. Es stellte sich heraus, dass etwa die Hälfte der Artikel, die CNET mithilfe von KI veröffentlichte, falsche Informationen enthielten.

Um die Sache noch schlimmer zu machen, sagte Futurism, das eine Untersuchung zum KI-Plagiat von CNET eingeleitet hatte: „Das Fehlverhalten des Bots reicht von wörtlichem Kopieren über moderate Bearbeitungen bis hin zu erheblichen Umformulierungen, alles ohne ordnungsgemäße Nennung des Originals.“

KI-Tools, die keine einzigartigen, originellen Inhalte – sei es Kunst oder Text – generieren, haben das Potenzial, Inhalte zu plagiieren, die bereits im Internet veröffentlicht wurden. Es ist wichtig, genau zu verstehen, wie das Sprachmodell, das Ihr KI-Tool verwendet, funktioniert, und auch die von ihm produzierten Inhalte genau zu überwachen, sonst könnten Sie in der gleichen Lage wie CNET landen.

Sollten Sie ChatGPT für Aufsätze oder für die Arbeit verwenden?

Verwenden von ChatGPT für Aufsätze

Die Tatsache, dass ChatGPT nicht einfach Antworten aus anderen Quellen abruft und Sätze zusammenfügt, bedeutet , dass Unternehmen ChatGPT für eine Vielzahl unterschiedlicher Aufgaben nutzen konnten, ohne sich über Urheberrechtsfragen Gedanken machen zu müssen.

Aufgrund seiner inneren Mechanik kommt es aber auch häufig zu Halluzinationen und Fehlern. Es ist alles andere als perfekt – und obwohl es verlockend ist, ChatGPT damit zu beauftragen, Ihren Aufsatz für die Universität oder Hochschule zu schreiben, raten wir davon ab.

Die spezifischen Einreichungsrichtlinien jeder Bildungseinrichtung unterscheiden sich natürlich geringfügig, aber es ist sehr wahrscheinlich, dass es an Ihrer Universität oder Schule bereits als „Betrug“ oder Plagiat gilt. Und unabhängig davon, wie genau sie sind, verwenden Bildungseinrichtungen KI-Inhaltsdetektoren, die sich mit der Zeit verbessern werden.

ChatGPT bei der Arbeit verwenden

Natürlich nutzen viele Menschen ChatGPT bereits bei der Arbeit – es erweist sich in einer Vielzahl von Branchen als nützlich und hilft Arbeitnehmern in allen möglichen Rollen, wertvolle Zeit bei alltäglichen Aufgaben zu sparen.

Wenn Sie ChatGPT jedoch am Arbeitsplatz verwenden, empfehlen wir Ihnen, offen mit Ihrem Manager oder Vorgesetzten darüber zu sprechen – insbesondere, wenn Sie es für wichtige Aktivitäten wie das Verfassen von Berichten für externe Stakeholder verwenden.

Wir empfehlen außerdem dringend, die gesamte Arbeit, die Sie mit ChatGPT, Bard oder einem anderen KI-Tool erstellen, gründlich zu bearbeiten und genau zu überprüfen. Es ist unklug, vertrauliche persönliche oder Unternehmensinformationen in einen Chatbot einzugeben, da es nicht viele öffentliche Informationen darüber gibt, wo diese Chats gespeichert werden oder über die Sicherheitsinfrastruktur von OpenAI.

Verwendung anderer KI-Tools für Aufsätze oder Arbeit

Natürlich sind Bard und ChatGPT nicht die einzigen KI-Chatbots da draußen. Wir würden jedoch zögern, kleinere KI-Tools zu unterstützen, die nicht auf leistungsstarken Sprachmodellen basieren. Sie werden nicht so gut ausgestattet sein und es ist unwahrscheinlich, dass Sie sie als nützlich empfinden, wenn Sie damit experimentieren, sie beruflich zu nutzen.

Es gelten jedoch nach wie vor die gleichen Regeln: Seien Sie gegenüber Ihrem Vorgesetzten offen und lassen Sie sich von der Verwendung dieser Informationen freigeben, geben Sie keine sensiblen Unternehmensdaten ein und überprüfen Sie immer die Antworten, die Sie erhalten.