ChatGPT-Preise: Wie viel kostet ChatGPT?

Veröffentlicht: 2023-12-11Die Preispläne von ChatGPT beginnen mit einem kostenlosen Plan. Es gibt auch einen ChatGPT „Plus“-Plan für Benutzer, die das Premium-Erlebnis wünschen, der für 20 US-Dollar pro Monat im Einzelhandel erhältlich ist und den Zugriff auf das fortschrittlichste große Sprachmodell von OpenAI, GPT-4, beinhaltet.

ChatGPT bietet auch Produkte und Dienstleistungen an, die sich an Unternehmen richten, aber alle werden nach Token berechnet und nicht nach Benutzer und Monat, wie es bei den meisten anderen Softwareprodukten der Fall ist.

Wie viel kostet ChatGPT, was wird angeboten und wie schneidet es im Vergleich zu den Preisplänen anderer beliebter Chatbots wie Claude von Anthropic ab? Lesen Sie weiter, um mehr in diesem ChatGPT-Preisleitfaden zu erfahren.

- ChatGPT-Preise erklärt

- Die kostenlose Version von ChatGPT

- ChatGPT Plus-Preise

- ChatGPT Enterprise-Preise

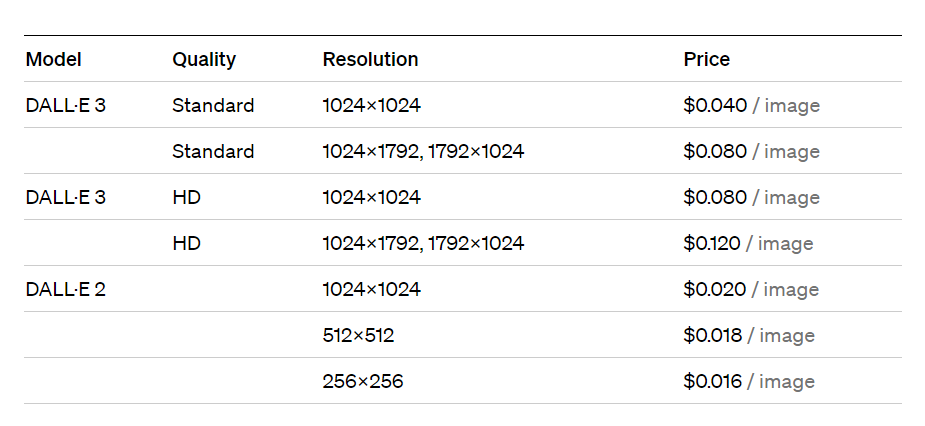

- DALL-E-Preise (Bilder)

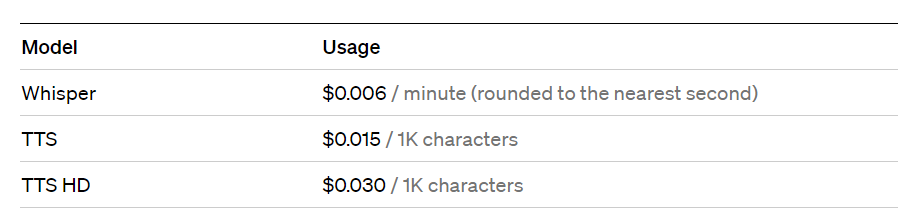

- OpenAI Whisper-Preise (Audio)

- Bietet ChatGPT Rabatte an?

- ChatGPT-Preise im Vergleich zu Mitbewerbern

Bevor wir näher darauf eingehen, wie viel ChatGPT genau kostet, gehen wir kurz auf die Preise von ChatGPT für seine Produkte und Dienstleistungen ein. Die Preisstruktur von ChatGPT ändert sich je nachdem, wofür Sie den Chatbot verwenden und welche spezifischen Dienste/Modelle Sie nutzen.

Wenn Sie bereits wissen, wie die Preisgestaltung von ChatGPT funktioniert, und sich lieber mit den Kosten von ChatGPT befassen möchten, überspringen Sie einfach diesen Abschnitt und lesen Sie weiter in unserem Überblick über die kostenlose Version .

Möchten Sie privat im Internet surfen? Oder so aussehen, als wären Sie in einem anderen Land?

Möchten Sie privat im Internet surfen? Oder so aussehen, als wären Sie in einem anderen Land?

Sichern Sie sich mit diesem Black Friday-Angebot von Tech.co satte 86 % Rabatt auf Surfshark. ![]()

Die Verbraucherangebote von ChatGPT

ChatGPT verfügt über eine kostenlose und eine Premium-Version, die auf die Nutzung durch Verbraucher ausgerichtet ist. Diese Versionen von ChatGPT können verwendet werden , um Einzelpersonen bei der Arbeit bei einer Vielzahl von Aufgaben zu unterstützen , sie können jedoch nicht auf die gleiche Weise feinabgestimmt werden wie die geschäftsorientierten Angebote von ChatGPT, und Sie können die Trainingsdaten auch nicht bearbeiten. Insgesamt sind sie weniger anpassbar.

ChatGPT Enterprise (API)

ChatGPT Enterprise-Kunden zahlen nicht pro Konto oder sogar pro Benutzer für den Zugriff auf die API. Stattdessen zahlen sie für „ Tokens “. Wenn Large Language Models (LLMs) Text verarbeiten, wird er in kleine Einheiten , sogenannte „Tokens“, zerlegt – bei denen es sich möglicherweise um ganze Wörter handelt, es sich jedoch in der Regel um Wortteile handelt.

Unternehmensbenutzer zahlen sowohl für Eingabetokens (die von ihnen bereitgestellten Informationen) als auch für Ausgabetokens (die Antworten, die ChatGPT generiert).

Wenn Sie untersucht haben, was ChatGPT für Ihr Unternehmen tun kann, haben Sie wahrscheinlich den Ausdruck „ Kontextfenster “ gehört oder gesehen (z. B. „GPT 3.5 Turbo hat ein 16K-Kontextfenster“). Das „16K“ – oder 16.000 – in diesem Satz bezieht sich auf die Anzahl der Token

Ein Kontextfenster ist die maximale Textmenge, die ein Sprachmodell gleichzeitig berücksichtigen kann – einschließlich der Eingabeaufforderung und der von ihr gegebenen Antwort. Wenn Sie eine Eingabeaufforderung eingeben, die dazu führt, dass ein Chatbot sein Kontextfensterlimit überschreitet, vergisst er den Beginn einer Konversation, die Sie mit ihm geführt haben.

Bilderzeugung

Neben ChatGPT verfügt OpenAI auch über einen Bildgenerator namens DALL-E. Derzeit gibt es DALL-E 2, DALL-E 3 Standard und DALL-E 3 HD. Ab dem 19. Oktober 2023 ist DALL-E 3 für alle ChatGPT Plus- und Enterprise- Kunden verfügbar.

Wenn Sie DALL-E verwenden, zahlen Sie nicht für Token, sondern pro generiertem Bild . Der Preis pro Bild variiert je nach verwendeter Version, da die neueren Versionen viel besser in der Lage sind, präzisere Bilder in höherer Qualität zu erzeugen.

Kostenlose ChatGPT-Version

Wie Sie wahrscheinlich inzwischen wissen, gibt es von ChatGPT eine kostenlose Version , die am 30. November 2022 gestartet ist – und wie der vorherige Satz schon sagt, müssen Sie dafür nichts bezahlen. Um es zu nutzen, müssen Sie sich lediglich mit einer E-Mail-Adresse und einer Telefonnummer für ein OpenAI-Konto anmelden.

Die kostenlose Version von ChatGPT basiert auf GPT-3.5 Turbo. Dies ist das neueste LLM der GPT-3.5-Klasse. Obwohl es sich um ein sehr fortgeschrittenes LLM handelt, handelt es sich nicht um die fortschrittlichste Anstrengung von OpenAI. In einem Kopf-an-Kopf-Rennen zwischen GPT-3.5 und GPT-4 hat GPT-4 jedes Mal die Nase vorn (obwohl es nicht so schnell ist).

Neben dem Zugriff auf den Chatbot haben Inhaber eines OpenAI-Kontos auch Zugriff auf eine kostenlose Version von DALL-E (DALLE-2), mit der Bilder generiert werden können. Dies ist jedoch wiederum nicht die fortschrittlichste Version der derzeit verfügbaren Software.

ChatGPT Plus-Preise

ChatGPT Plus, das im Februar 2023 eingeführt wurde, kostet derzeit 20 US-Dollar pro Monat . Außerdem können Benutzer GPT-4 verwenden, das leistungsfähiger ist, dessen Beantwortung jedoch länger dauert, sowie GPT 3.5, das schneller, aber nicht ganz so leistungsfähig ist.

Mit ChatGPT Plus können Sie mit Bildern und Aufzeichnungen chatten und Bilder erstellen, ohne die Benutzeroberfläche zu verlassen (in der kostenlosen Version müssen Sie zu DALL-E 2 wechseln). Sie können DALLE-3 , die fortschrittlichste Version des Bildgenerators, auch separat verwenden, wenn Sie möchten.

Ein weiterer großer Unterschied zwischen der kostenlosen und der kostenpflichtigen Version besteht darin, dass Sie mit ChatGPT Plus Ihren eigenen Chatbot, sogenannte GPTs, erstellen können. Diese Funktion ist in der kostenlosen Version von chatGPT nicht verfügbar. Sie können auch die GPTs anderer Personen verwenden, obwohl der GPT-Store, dessen Eröffnung für diesen Monat geplant war, auf 2024 verschoben wurde.

Preise für ChatGPT Enterprise (API).

Die Preise für die Enterprise-API- Modelle und -Dienste von ChatGPT betragen 1.000 Token . Laut OpenAI entsprechen 1.000 Token ungefähr 750 Wörtern .

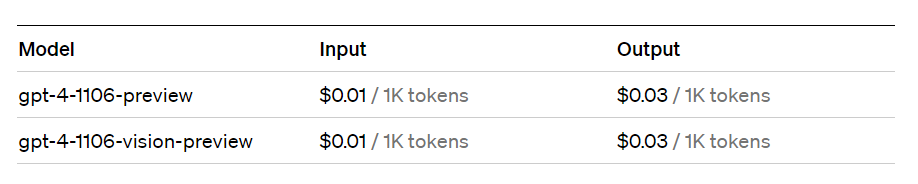

GPT-4 Turbo-Preise

GPT-4 Turbo ist das leistungsstärkste LLM von ChatGPT und verfügt über ein 128K-Kontextfenster, das zu den größten in der Branche zählt. Derzeit ist der Preis pro Token günstiger als bei GPT-4.

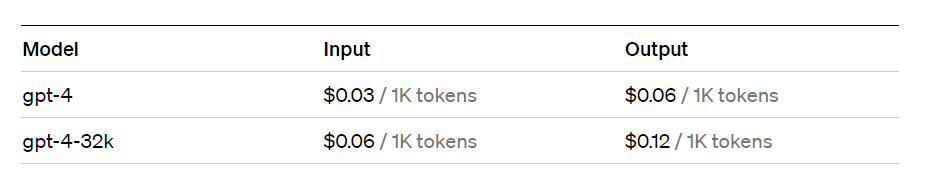

GPT-4-Preise

GPT-4 ist wie der unglaublich ähnliche kleine Bruder von GPT-4 Turbo – beide sind sehr leistungsstark, aber entscheidend ist, dass die Trainingsdaten von GPT-4 wie GPT 3.5 im September 2021 eingestellt werden.

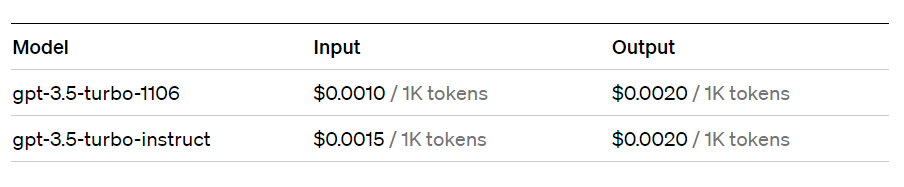

GPT-3.5 Turbo-Preise

„GPT-3.5 Turbo“, sagt OpenAI, „ist das Flaggschiffmodell dieser Familie, unterstützt ein 16K-Kontextfenster und ist für Dialoge optimiert.“ Neben der Turbo-Version gibt es ein Instruct-Modell, das ein kleineres Kontextfenster von 4.000 Token unterstützt. Wie Sie sehen, ist es sowohl bei den Ein- als auch bei den Ausgängen etwas günstiger als GPT-4 Turbo und GPT-4:

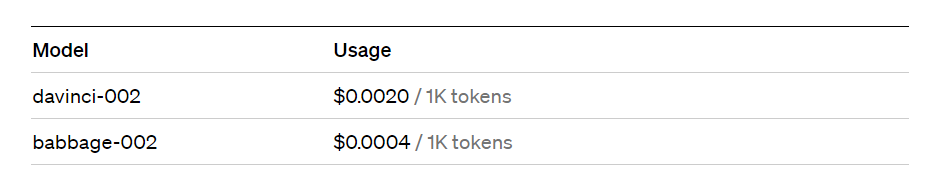

Preise für das GPT-Basismodell

Die von OpenAI angebotenen GPT-Basismodelle richten sich an Unternehmen mit kleinem Budget – sie sind viel einfacher als GPT-3.5 und GPT-4 und, wie OpenAI zugibt, einfach nicht so gut darin, Anweisungen zu befolgen. Bei richtiger Feinabstimmung sind sie jedoch durchaus in der Lage, ein begrenztes Aufgabenspektrum zu erfüllen.

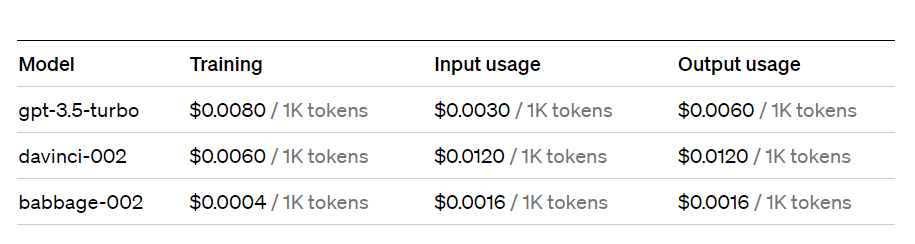

Feinabstimmung der Modellpreise

Unternehmen können benutzerdefinierte Versionen von ChatGPT erstellen, indem sie ihre eigenen Trainingsdaten eingeben. ChatGPT lernt dann Dinge aus diesen Trainingsdaten und kann viel nützlichere Antworten geben, als wenn es sich nur auf den allgemeinen Datensatz verlassen würde, der zum Training aller GPT-LLMs verwendet wird.

Für die Eingabe von Trainingsdaten in diesen Plänen werden Ihnen keine Kosten berechnet, sondern nur die Eingabe- und Ausgabetokens, die in Anfragen verwendet werden. Wie Sie sehen, können Sie GPT-3.5 Turbo verfeinern oder, wenn Sie es sich im Moment nicht leisten können, ein einfacheres Sprachmodell verwenden.

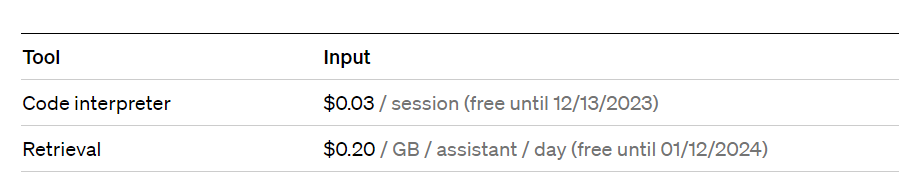

Preise für die Assistenten-API

Die Assistants API von ChatGPT wurde beim ersten DevDay von ChatGPT angekündigt, der im November stattfand. Damit können Entwickler im Wesentlichen ihre eigenen, maßgeschneiderten Chatbots für Unternehmen erstellen, die in bestehende Anwendungen integriert werden können. Es befindet sich derzeit in der Beta-Phase und OpenAI sagt, dass sie derzeit daran arbeiten, es funktionaler zu machen. Wenn Sie die Beta nutzen, berechnet Ihnen OpenAI derzeit nur Eingaben:

Bietet ChatGPT Rabatte an?

Die kurze Antwort lautet „Nein“. Während einige Softwareprogramme wie monday.com Rabatte für Startups und gemeinnützige Organisationen anbieten, bietet OpenAI derzeit keine Rabatte für Unternehmen an. Wenn Sie also auf die Plus- oder Enterprise-Funktionen zugreifen möchten, müssen Sie den vollen Preis bezahlen.

Aus geschäftlicher Sicht ist das durchaus verständlich. Die Nachfrage nach ChatGPT ist so groß, dass OpenAI nicht gerade nach Neuanmeldungen schreit und außerdem ist bereits eine kostenlose Version verfügbar. Allein der Betrieb des Chatbots kostet rund 700.000 US-Dollar pro Tag – Sam Altman und Co. brauchen also jeden Cent, den sie kriegen können.

ChatGPT-Preise im Vergleich zu Mitbewerbern

Als ChatGPT im November 2022 auf den Markt kam, war es praktisch einzigartig. Mittlerweile gibt es mehrere Konkurrenten auf dem Markt, und einige von ihnen übertreffen ChatGPT bei einigen Aufgaben, während sie in anderen Bereichen auch mithalten können.

ChatGPT gegen Claude

Claude 2 ist der jüngste LLM-basierte ChatGPT-Konkurrent Claude , ein von Anthropic entwickelter Chatbot. Anthropic ist ein Startup wie OpenAI und wird finanziell von Amazon und Google unterstützt, wobei letzteres einen Anteil von 10 % am Unternehmen besitzt.

Claude ist ein äußerst leistungsfähiges Sprachmodell und unterstützt Jasper – es verfügt außerdem über ein 128-KByte-Kontextfenster, was bedeutet, dass es unglaublich große Eingaben verarbeiten kann.

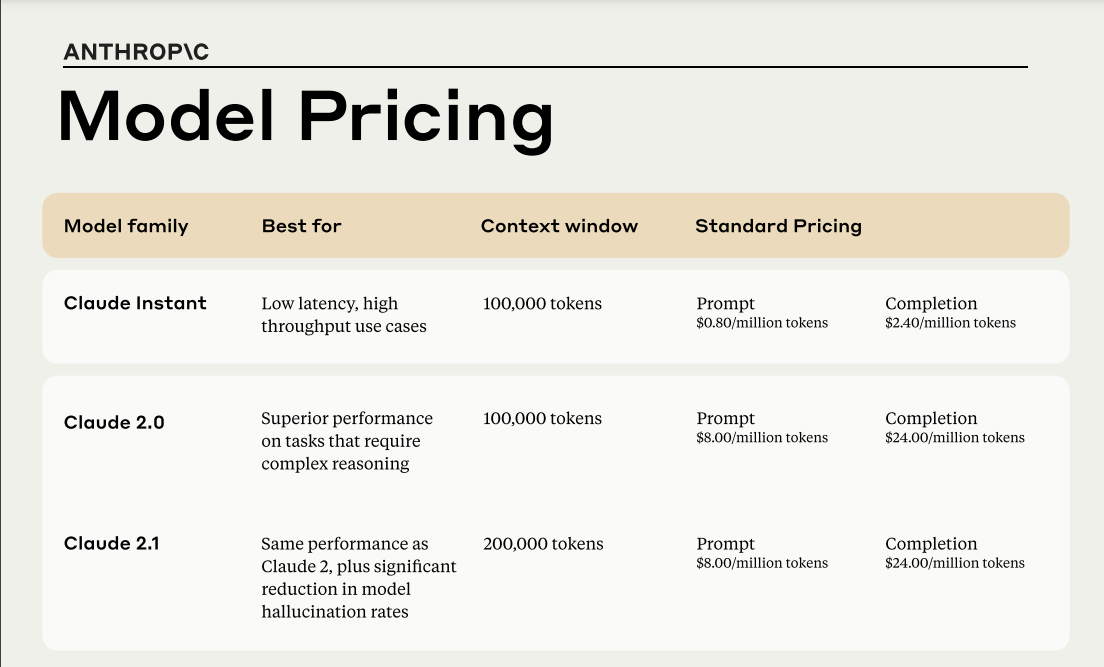

Wie bei ChatGPT gibt es eine kostenlose Version von Claude sowie eine Premium-Version für 20 $ pro Monat namens Claude Pro . Claude bietet auch Token-Preise für Unternehmen an, die Claude 2 oder 2.1 verwenden möchten, sowie eine vereinfachte Version namens Claude Instant. Wie Sie den Preisinformationen unten entnehmen können, werden die Preise von Claude pro Million Token und nicht pro tausend festgelegt:

Weitere Informationen zu Anthropics Stolz und Freude finden Sie in unserem Leitfaden zu Claude .

ChatGPT gegen Bard

Googles ChatGPT-Konkurrent Bard wurde im Februar 2023 auf den Markt gebracht – etwa zur gleichen Zeit, als OpenAI ChatGPT Plus auf den Markt brachte. Damals basierte es auf dem großen Sprachmodell LaMDa, von dem ein Google-Mitarbeiter einmal sagte, es zeige Empfindungsvermögen.

In jüngerer Zeit wurde auf PaLM 2 umgestellt , ein leistungsstärkeres Modell, das laut Google schneller und effizienter als LaMDA ist. Bald wird auf Gemini umgestellt , das laut den Machern von DeepMind leistungsfähiger und intelligenter als GPT-4 ist. Derzeit gilt GPT-4 Turbo jedoch allgemein als das leistungsstärkste verfügbare Sprachmodell.

Trotz seines Rufs, gelegentlich Fehler zu machen, besteht der große Vorteil von Bard darin, dass es völlig kostenlos ist . Sie benötigen lediglich ein Gmail-Konto (privat oder geschäftlich), dessen Erstellung kostenlos ist, und Sie haben Zugriff auf den vollen Funktionsumfang. Um zu sehen, wie die beiden Chatbots in einer Reihe von Tests gegeneinander abschneiden, schauen Sie sich unseren Vergleich zwischen Bard und ChatGPT an.