Cómo detectar el plagio de ChatGPT y AI

Publicado: 2023-06-22ChatGPT ha revolucionado el mundo académico y empresarial con su capacidad para generar textos coherentes y bien escritos sobre casi cualquier tema del mundo en cuestión de segundos.

Sus notables habilidades han hecho que los estudiantes de todos los niveles educativos recurran al chatbot, así como a sus rivales, como Bard , para escribir ensayos complejos que, de otro modo, tardarían horas en terminar.

Esto ha iniciado una conversación global sobre un nuevo fenómeno, a menudo denominado "plagio de ChatGPT". Esta guía cubre las herramientas que las empresas y las instituciones educativas están utilizando para detectar el plagio de ChatGPT, los peligros de hacer trampa con ChatGPT y si el uso de ChatGPT incluso cuenta como plagio.

- Cómo detectar el plagio de ChatGPT

- Los verificadores de plagio de IA y ChatGPT más populares

- ¿Funcionan realmente los verificadores de contenido de IA?

- ¿Usar ChatGPT o Bard es realmente plagio?

- Los peligros de hacer trampa con ChatGPT

- ¿ChatGPT plagia?

- ¿Bard plagia?

- ¿Otras herramientas de IA plagian?

- ¿Debo usar ChatGPT para mis ensayos o trabajos?

Cómo detectar el plagio de ChatGPT

Para detectar el plagio de ChatGPT, necesita un verificador de contenido de IA. Los verificadores de contenido de IA escanean cuerpos de texto para determinar si han sido producidos por un chatbot como ChatGPT o Bard, o por un humano. Sin embargo, como veremos más adelante, estas herramientas están lejos de ser confiables.

Es un poco más difícil detectar plagio cuando se trata de código, algo que ChatGPT también puede generar hábilmente. No existe el mismo ecosistema de herramientas de detección de IA para el código que para el contenido.

Sin embargo, si se encuentra en un entorno universitario, por ejemplo, y está enviando un código muy por encima de su nivel técnico, su profesor o conferencista puede tener algunas sospechas muy razonables de que le ha pedido ayuda a ChatGPT.

Revisión de las herramientas de verificación de plagio de IA y ChatGPT más populares

Desde el lanzamiento de ChatGPT en noviembre de 2022, muchas empresas e instituciones educativas han producido verificadores de contenido de IA, que afirman poder distinguir entre contenido generado artificialmente y contenido creado por humanos. Ahora, muchas empresas también utilizan el chatbot Bard de Google, que utiliza un modelo de lenguaje diferente.

Sin embargo, la supuesta precisión de incluso las herramientas de detección de contenido de IA más reputadas se disputa ferozmente y ya se han materializado casos judiciales entre estudiantes acusados falsamente de usar contenido de IA y educación.

La conclusión es esta: ninguna herramienta en este espacio es 100% precisa, pero algunas son mucho mejores que otras.

GPTZero

GPTZero es una popular herramienta gratuita de detección de contenido de IA que afirma que es "el detector de IA más preciso en todos los casos de uso, verificado por múltiples fuentes independientes".

Sin embargo, en abril, un estudiante de historia de UC Davis demostró que GPTZero, una herramienta de detección de contenido de IA utilizada por su profesor, era incorrecta cuando etiquetó su ensayo como generado por IA.

Probamos GPTZero pidiéndole a ChatGPT que escribiera una historia corta. GPTZero, desafortunadamente, no pudo decir que el contenido fue escrito por una herramienta de IA:

Originalidad.ai

Originality.ai es sin duda una de las herramientas de detección de contenido de IA más precisas disponibles actualmente.

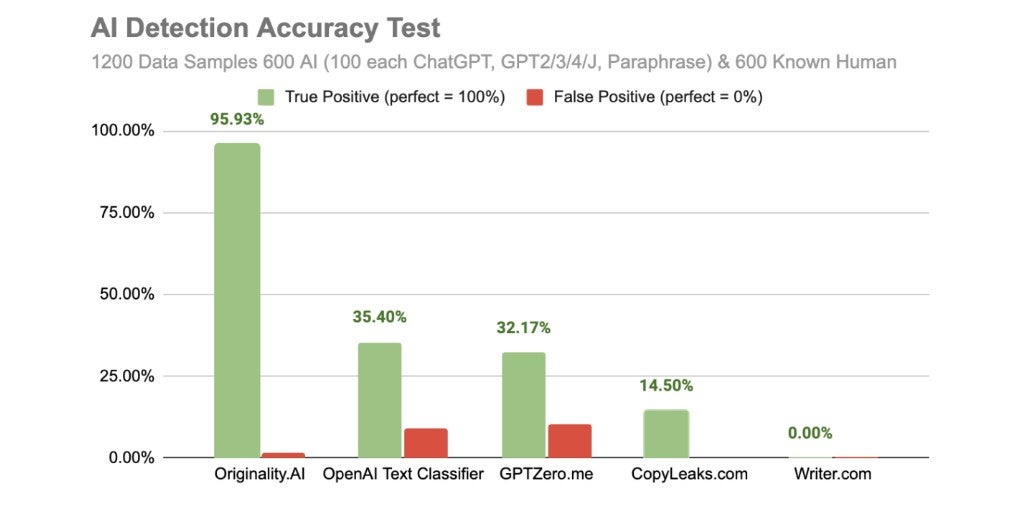

La compañía realizó su propio estudio sobre herramientas de detección de contenido de IA en abril de este año, dentro del cual alimentó 600 bloques de texto generados artificialmente y 600 generados por humanos a su propio sistema de detección de contenido, así como otras herramientas populares que afirman hacer algo similar. .

Como puede ver en los resultados a continuación, Originality.ai superó a todas las herramientas incluidas en la prueba:

El único inconveniente de Originality.ai es que no hay un plan gratuito, y ni siquiera puedes probarlo gratis como puedes hacerlo con las otras aplicaciones incluidas en este artículo. cuesta $20 por 2000 créditos, lo que le permitirá revisar 200 000 palabras.

Detector de contenido de IA de Copyleaks

Copyleaks es un detector de contenido de IA de uso gratuito que afirma ser capaz de distinguir entre la copia generada por humanos y la generada por IA con una precisión del 99,12 %.

Copyleaks también le dirá si aspectos específicos de un documento o pasaje están escritos por IA, incluso si otras partes parecen estar escritas por un humano.

Copyleaks dice que es capaz de detectar contenido generado por IA creado por "ChatGPT, GPT-4, GPT-3, Jasper y otros", e incluso afirma que "una vez que salgan modelos más nuevos, podremos detectarlo automáticamente".

CopyLeaks cuesta $8.33 por mes por 1,200 créditos (250 palabras de copia por crédito).

Sin embargo, en una prueba realizada por TechCrunch en febrero de 2023, Copyleaks clasificó incorrectamente varios tipos diferentes de copia generada por IA, incluido un artículo de noticias, una entrada de enciclopedia y una carta de presentación como generada por humanos.

Además, el estudio de Originality.ai al que se hace referencia anteriormente solo encontró que era preciso en el 14,50% de los casos, muy lejos de la afirmación de precisión del 99,12% que hace CopyLeaks.

Sin embargo, cuando lo probamos, pareció detectar que el texto que ingresamos fue generado por ChatGPT:

Detector de IA Turnitin

Turnitin es una empresa de detección de plagio con sede en EE. UU. que utilizan diversas universidades para escanear el trabajo de sus estudiantes. Turnitin está diseñado para detectar todo tipo de plagio, pero reveló en abril que ha estado invirtiendo en un equipo centrado en la IA desde hace algún tiempo.

Turnitin dice que puede "detectar la presencia de escritura de IA con un 98 % de confianza y una tasa de falsos positivos de menos del uno por ciento en nuestro entorno de laboratorio controlado".

Sin embargo, la compañía también dice que el contenido si marca un contenido como generado por IA, esto debe tratarse como una "indicación, no como una acusación". La verdadera precisión del detector de IA de Turnitin ha sido cuestionada por el Washington Post, así como por otras fuentes.

El software de detección de contenido de IA de Turnitin actualmente es gratuito, pero la compañía dice en una pregunta frecuente en su sitio web que pasarán a un programa de licencia paga en enero de 2024, cuyo precio no se especifica.

Clasificador de texto OpenAI

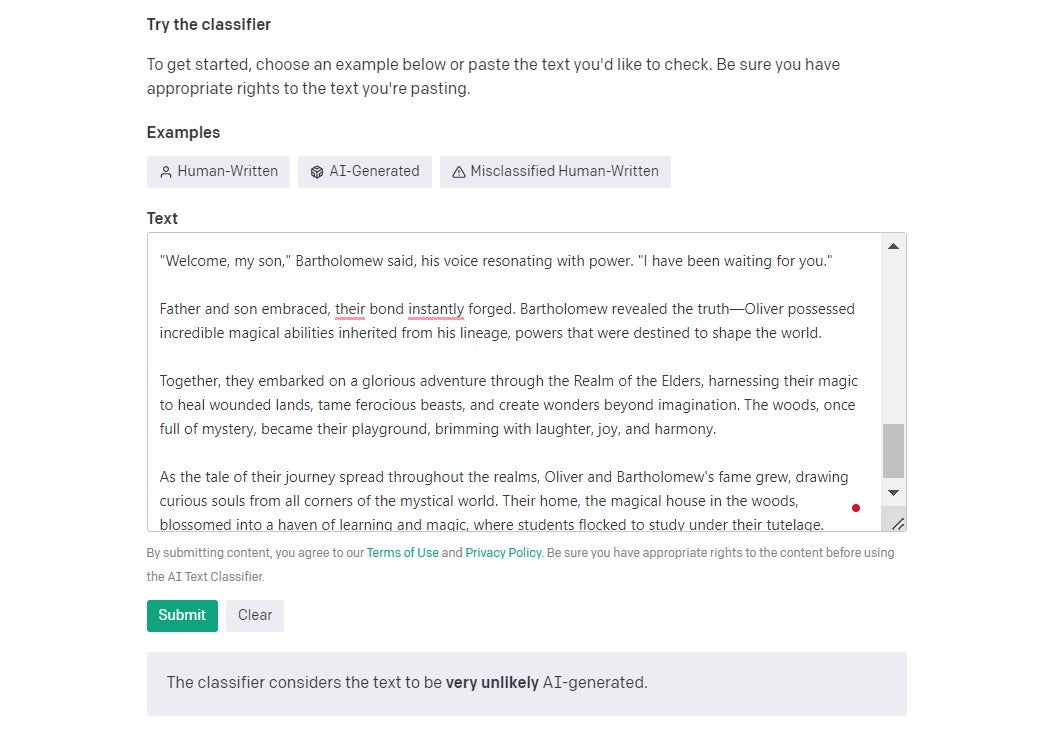

No dispuestos a ser superados por verificadores de contenido de IA de terceros, los mismos OpenAI han lanzado una pieza de software diseñada para clasificar si el contenido ha sido generado por IA.

El documento o texto que ingrese debe tener más de 1000 caracteres. Una vez que haya ingresado su documento, OpenAI le dirá casi instantáneamente qué tan probable es que haya sido generado por humanos.

Publiqué un extracto de un artículo reciente de Tech.co, escrito por un escritor, que OpenAI correctamente determinó que era "muy poco probable" que hubiera sido escrito por AI.

En el mismo artículo de TechCrunch al que hicimos referencia anteriormente, la publicación dice que OpenAI estima que su clasificador de texto pierde el 74% del contenido generado por IA. Es bueno que también sean tan honestos al respecto: cuando realizamos una segunda prueba, utilizando una historia corta generada por ChatGPT, no se dio cuenta del hecho de que fue generada por IA:

¿Funciona realmente la detección de contenido de IA?

Ninguna herramienta de detección de contenido de IA es 100% confiable; nuestras pruebas lo demuestran de manera bastante rotunda.

Sin embargo, ninguna de las herramientas que hemos discutido hoy en realidad afirma ser 100% precisa, y muy pocas afirman estar absolutamente libres de falsos positivos. Otros, como GPTZero, publican descargos de responsabilidad sobre tomar sus resultados como un evangelio.

Varios estudiantes universitarios acusados de usar inteligencia artificial para producir ensayos ya han sido obligados a demostrar que su trabajo era original.

En Texas, en marzo, un profesor reprobó falsamente a toda una clase de estudiantes después de acusarlos injustamente de usar ChatGPT para escribir ensayos. También hay una colección de informes, y estudios como el realizado por Originality.ai, que sugieren que incluso los verificadores de plagio más capaces no son tan precisos como afirman.

Incluso el detector de contenido de IA de Turnitin no es infalible. En la prueba reciente y relativamente pequeña realizada por el Washington Post que discutimos anteriormente, su precisión estuvo muy por debajo del 98% que afirman ser capaces de producir.

Originality.ai, por otro lado, es sin duda uno de los más robustos disponibles, e incluso su tecnología de detección no siempre es correcta.

Además, si existen falsos positivos en cualquier capacidad, entonces siempre habrá espacio para que los estudiantes afirmen que su trabajo es original y simplemente se identificó erróneamente.

¿Usar ChatGPT o Bard es plagio?

Es discutible si ChatGPT es de hecho plagio. Oxford Languages define el plagio como “la práctica de tomar el trabajo o las ideas de otra persona y hacerlos pasar por propios”.

ChatGPT no es una persona, y no está simplemente reproduciendo el trabajo y las ideas de otras personas cuando genera una respuesta. Entonces, según la definición del diccionario, no es un plagio absoluto.

Incluso si estuviera haciendo eso, si fuera honesto acerca de dónde vino (es decir, ChatGPT), podría decirse que eso no sería plagio de todos modos.

Sin embargo, algunas escuelas y universidades tienen reglas de plagio de gran alcance y consideran usar chatbots para escribir ensayos como tales. Un estudiante de la Universidad de Furman reprobó su título de filosofía en diciembre después de usar ChatGPT para escribir su ensayo. En otro caso, un profesor de la Universidad del Norte de Michigan informó que atrapó a dos estudiantes que usaban el chatbot para escribir ensayos para su clase.

Usar ChatGPT para generar ensayos y luego hacerlo pasar por su propio trabajo quizás se describa mejor como "hacer trampa" y definitivamente es "deshonesto".

El objetivo de escribir un ensayo es demostrar que eres capaz de producir pensamientos originales, comprender conceptos relevantes, considerar cuidadosamente los argumentos en conflicto, presentar la información con claridad y citar las fuentes.

Hay muy poca diferencia entre usar ChatGPT de esta manera y pagarle a otro estudiante para que escriba su ensayo por usted, lo cual es, por supuesto, hacer trampa.

Con respecto a Bard de Google, la respuesta es un poco más complicada. La misma línea de lógica utilizada anteriormente se aplica a Bard como lo hace con ChatGPT, pero Bard se ha visto empañado por acusaciones de plagio y por citar incorrectamente cosas que extrae de Internet de una manera en que ChatGPT no lo ha hecho. Por lo tanto, usar Bard podría llevarlo a plagiar inadvertidamente otras fuentes ( más sobre esto a continuación ).

Los peligros de hacer trampa con ChatGPT

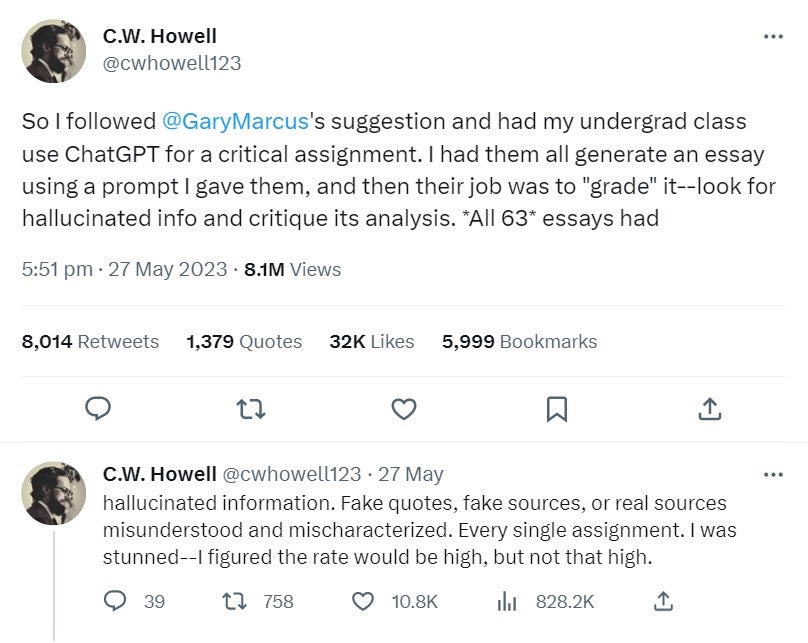

Christopher Howell, profesor asistente adjunto en la Universidad de Elon, recientemente le pidió a un grupo de estudiantes que usaran ChatGPT para una tarea crítica y luego calificaran los ensayos que produjo para ellos.

Informó en un extenso hilo de Twitter (cuya primera parte se muestra a continuación) que los 63 estudiantes que participaron encontraron algún tipo de "alucinación", incluidas citas falsas y fuentes falsas y mal interpretadas, en sus tareas.

¿ChatGPT plagia en sus respuestas?

No, ChatGPT no extrae información de otras fuentes y simplemente la combina, oración por oración. Este es un malentendido de cómo funcionan los transformadores preentrenados generativos.

ChatGPT, o más exactamente el modelo de lenguaje GPT, está entrenado en un enorme conjunto de datos de documentos, material de sitios web y otros textos.

Utiliza algoritmos para encontrar secuencias y patrones lingüísticos dentro de sus conjuntos de datos. Luego, se pueden generar párrafos, oraciones y palabras en función de lo que el modelo de lenguaje ha aprendido sobre el lenguaje a partir de secuencias en estos conjuntos de datos.

Es por eso que si le haces a ChatGPT la misma pregunta al mismo tiempo desde dos dispositivos diferentes, sus respuestas suelen ser extremadamente similares, pero aún habrá variaciones y, a veces, ofrece respuestas completamente diferentes.

¿Bard plagia en sus respuestas?

El mayor rival de ChatGPT, Bard de Google, ha tenido muchos más problemas con el plagio de contenido desde su lanzamiento que su contraparte más popular. El sitio web de tecnología Tom's Hardware descubrió que Bard había plagiado uno de sus artículos y luego procedió a disculparse cuando uno de sus empleados lo llamó.

Más recientemente, en mayo de 2023, PlagiarismCheck le dijo a Yahoo News que generaron 35 piezas de texto con Bard y descubrieron que había sido plagiado por encima del 5 % en 25 de ellas simplemente parafraseando contenido existente ya publicado en Internet.

Una gran diferencia entre Bard y ChatGPT que quizás pueda explicar esto es que Bard puede buscar respuestas en Internet, por lo que tiende a tratar mejor las preguntas relacionadas con eventos posteriores a 2021, con las que ChatGPT tiene problemas. Sin embargo, esto también parece significar que extrae datos de fuentes de una manera menos original y cita sus fuentes con más frecuencia.

Estos ejemplos pueden haber sido irregularidades, pero es bueno conocer los riesgos si usa Bard para un trabajo importante.

¿Otras herramientas de IA plagian?

Desafortunadamente, sí, y algunas empresas ya se han avergonzado al usar herramientas de IA que tienen contenido plagiado. Por ejemplo, se descubrió que CNET, uno de los sitios de tecnología más grandes del mundo, estaba usando una herramienta de IA para generar artículos, y no fue nada transparente al respecto. Se encontró que alrededor de la mitad de los artículos que CNET publicó usando IA tenían información incorrecta incluida.

Para empeorar las cosas, Futurism, que inició una investigación sobre el plagio de IA de CNET, dijo que "el mal comportamiento del bot va desde la copia textual hasta ediciones moderadas y reformulaciones significativas, todo sin acreditar adecuadamente el original".

Las herramientas de IA que no generan contenido único y original, ya sea arte o texto, tienen el potencial de plagiar contenido que ya se ha publicado en Internet. Es importante comprender exactamente cómo funciona el modelo de lenguaje que usa su herramienta de IA y también tener una supervisión estricta del contenido que produce, o podría terminar en la misma posición que CNET.

¿Debería usar ChatGPT para ensayos o trabajo?

Uso de ChatGPT para ensayos

El hecho de que ChatGPT no extraiga simplemente respuestas de otras fuentes y combine oraciones significa que las empresas han podido usar ChatGPT para una variedad de tareas diferentes sin preocuparse por los problemas de derechos de autor.

Pero su mecánica interna también significa que a menudo alucina y comete errores. Está lejos, lejos de ser perfecto, y aunque es tentador que ChatGPT escriba su ensayo para la universidad o la universidad, desaconsejamos hacerlo.

Las pautas de presentación específicas de cada institución educativa serán ligeramente diferentes, por supuesto, pero es muy probable que ya se considere "trampa" o plagio en su universidad o escuela. Además, independientemente de su precisión, las instituciones educativas utilizan detectores de contenido de IA, que mejorarán con el tiempo.

Usando ChatGPT en el trabajo

Por supuesto, mucha gente ya está usando ChatGPT en el trabajo : está resultando útil en una amplia gama de industrias y ayuda a los trabajadores en todo tipo de roles a ahorrar un tiempo valioso en las tareas diarias.

Sin embargo, si usa ChatGPT en el trabajo, le recomendamos que sea abierto con su gerente o supervisor al respecto, especialmente si lo usa para actividades importantes como escribir informes para partes interesadas externas.

También le recomendamos encarecidamente que edite y revise detenidamente todo el trabajo que está utilizando ChatGPT, Bard o cualquier otra herramienta de IA para generar. No es aconsejable poner información confidencial personal o de la empresa en cualquier chatbot, ya que no hay mucha información pública sobre dónde se almacenan estos chats o la infraestructura de seguridad de OpenAI.

Uso de otras herramientas de IA para ensayos o trabajos

Por supuesto, Bard y ChatGPT no son los únicos chatbots de IA que existen. Sin embargo, dudaríamos en brindar nuestro apoyo a cualquier herramienta de IA más pequeña que no esté respaldada por modelos de lenguaje poderosos. No contarán con los mismos recursos y es poco probable que los encuentre tan útiles si experimenta con su uso para el trabajo.

Sin embargo, se siguen aplicando las mismas reglas: sea abierto con su gerente y apruebe su uso, no ingrese ningún dato confidencial de la empresa y siempre revise las respuestas que le den.