Escroqueries par clonage de voix par IA : 1 adulte sur 4 déjà ciblé

Publié: 2023-05-02Pensez-vous que vous pourriez faire la différence entre un message vocal de quelqu'un que vous aimez et un message vocal généré par l'IA ? Eh bien, les escrocs utilisant la technologie de clonage de la voix de l'IA pour escroquer des victimes sans méfiance espèrent certainement que vous ne le pouvez pas - et maintenant, ils sont plus actifs que jamais.

Une enquête récemment menée par McAfee a révélé qu'un quart des adultes ont déjà été ciblés par des escroqueries vocales basées sur l'IA, l'écrasante majorité perdant ainsi de l'argent durement gagné. Il a également révélé que la majorité des adultes partagent leur voix sur les plateformes de médias sociaux et d'autres espaces en ligne au moins une fois par semaine, ce qui donne aux acteurs de la menace exactement ce dont ils ont besoin pour commettre ce type d'escroquerie encore et encore.

Alors, comment fonctionnent réellement les escroqueries par clonage de voix par IA, quelle est leur fréquence et comment pouvez-vous repérer une escroquerie par clonage de voix par IA ? Nous regardons de plus près.

- Qu'est-ce qu'une escroquerie de clonage de voix par IA ?

- Comment fonctionne réellement le clonage de voix AI

- Quelle est la fréquence des escroqueries AI Voice Clone?

- Comment savoir si un message est une escroquerie AI Voice Clone

Qu'est-ce qu'une escroquerie de clonage de voix par IA ?

Une escroquerie par clonage de voix IA est une escroquerie qui utilise des fichiers audio générés artificiellement pour duper les victimes en leur faisant croire que leurs proches sont en danger ou ont besoin d'une aide financière urgente et les ont contactés pour obtenir de l'aide.

Dans une escroquerie de ce type, un fraudeur diffusera un clip d'un sujet parlant - souvent extrait des médias sociaux - via un générateur de voix IA. À l'aide de l'apprentissage automatique, le générateur analysera la cadence, le ton et la hauteur du clip initial, puis permettra au fraudeur de produire un son unique et original qui imite presque parfaitement la voix des sujets.

L'escroc enverra ensuite ces enregistrements aux amis et aux proches du sujet via des applications comme WhatsApp, en espérant qu'ils ne pourront pas faire la distinction entre leur bien-aimé et une version de leur voix générée par l'IA.

Comme c'est le cas pour les autres escroqueries en ligne , l'escroc essaiera d'injecter un sentiment d'urgence et de détresse dans sa correspondance, afin de pousser la cible à agir de manière imprudente ou erratique.

Dans un cas récent, un escroc de la voix de l'IA a tenté de convaincre une mère aux États-Unis que sa fille avait été kidnappée en clonant la voix de l'enfant.

En ce qui concerne, un escroc en herbe n'aura pas de mal à dénicher les fichiers audio dont il aura besoin pour cibler une victime - en fait, il est susceptible d'avoir l'embarras du choix.

Une enquête de mai 2023 publiée par McAfee auprès de plus de 7 000 personnes de sept pays différents a révélé que 53 % des personnes interrogées ont déclaré partager leur voix en ligne au moins une fois par semaine. En Inde, ce chiffre était de 86 %.

Comment fonctionne réellement le clonage de voix

Le clonage de voix IA n'est possible qu'avec un outil IA appelé générateur de voix IA. En un mot, les générateurs de voix IA transforment les fichiers texte en parole (souvent appelé outil de « synthèse vocale » ou « TTS »).

Les générateurs de voix IA utilisent l'apprentissage automatique pour apprendre à parler de manière spécifique en analysant les informations des fichiers audio des personnes qui parlent. Les générateurs appliquent ensuite ce qu'ils ont appris pour lire les fichiers texte fournis par les utilisateurs et générer du contenu audio original.

Beaucoup de ces générateurs ont des voix personnalisées que vous pouvez sélectionner pour lire votre texte, ainsi que des voix de célébrités parmi lesquelles choisir - mais d'autres vous permettront d'enregistrer votre propre voix et de créer du contenu audio ultérieur.

L'outil de synthèse vocale Descript.com propose un "générateur de voix à la pointe de la technologie qui crée un clone ultra-réaliste de votre propre voix".

Les générateurs de voix IA sont désormais largement disponibles pour toutes sortes d'appareils. Ces programmes offrent beaucoup de valeur aux personnes qui ont des difficultés à lire ou qui apprennent simplement mieux en écoutant de l'audio plutôt qu'en lisant le mot écrit.

Ils sont également utilisés par les agences de publicité qui n'ont pas de budget pour embaucher un artiste voix off coûteux pour leur contenu marketing.

Le succès et l'utilisation généralisée de ChatGPT ont mis l'accent sur les outils d'IA de toutes formes et tailles, y compris ceux qui peuvent être utilisés pour le clonage audio. Malgré leurs nobles utilisations, il existe désormais un petit écosystème d'outils TTS AI qui peuvent malheureusement être utilisés à des fins néfastes, notamment pour escroquer des personnes.

Quelle est la fréquence des escroqueries AI Voice Clone?

Dans l'enquête McAfee récemment publiée, le géant de la cybersécurité a découvert qu'un adulte sur quatre interrogé avait été victime d'une escroquerie vocale basée sur l'IA.

77% des personnes ciblées ont déclaré avoir perdu de l'argent à cause de l'escroquerie. McAfee rapporte que sur ces 77 %, « plus d'un tiers ont perdu plus de 1 000 $, tandis que 7 % ont été dupés entre 5 000 $ et 15 000 $ ».

Les victimes aux États-Unis perdent le plus, révèle l'enquête. 11 % des victimes américaines qui ont perdu de l'argent à cause d'escroqueries par clonage de voix par IA ont perdu entre 5 000 et 15 000 $.

Comment savoir si un message est une escroquerie AI Voice Clone

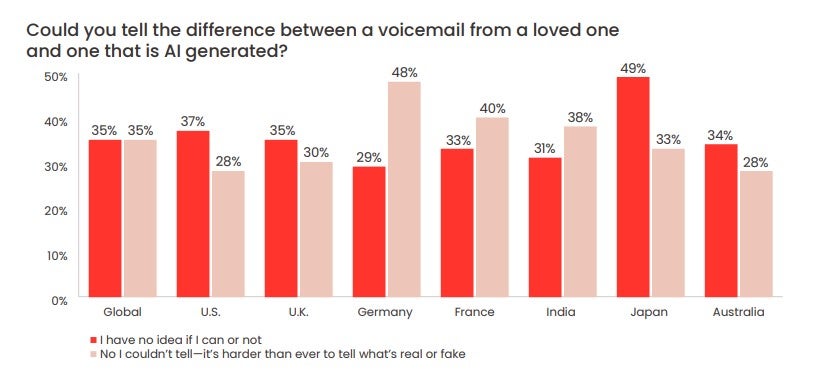

L'enquête McAfee a également révélé que 70 % des personnes ont déclaré qu'elles n'étaient « pas sûres » de pouvoir faire la différence entre une voix IA et une voix humaine.

Près d'un tiers (28 %) des répondants américains ont déclaré qu'ils ne seraient pas en mesure de faire la différence entre un message vocal laissé par un « imposteur artificiel », comme le dit McAfee, et un être cher.

N'oubliez pas que les escrocs peuvent reproduire la voix d'un être cher, mais prendre le contrôle du numéro ou du compte WhatsApp de votre proche est beaucoup plus difficile.

Il peut être difficile d'agir calmement lorsqu'il semble que l'un de vos proches ou amis est en détresse. Mais avec les escroqueries vocales par IA devenant de plus en plus courantes, il est important que vous le fassiez. Certains signes indiquent qu'un message vocal IA pourrait être une arnaque :

- Une méthode de contact inhabituelle (par exemple un numéro inconnu)

- Demandes immédiates de grosses sommes d'argent

- Demandes de transfert d'argent par des moyens inhabituels (par exemple, cartes-cadeaux ou crypto)

- Une demande de ne parler à personne de l'appel/de l'incident

Dans cet esprit, voici ce que la FTC vous conseille de faire :

- Appelez le numéro qui vous a laissé le message pour vérifier de qui il s'agit

- Appelez votre proche ou ami sur son numéro personnel

- Envoyer un message à la famille et aux amis proches de la personne en question

Si vous ne pouvez pas entrer en contact, il est important que vous informiez immédiatement les forces de l'ordre. Pour ceux d'entre vous qui n'ont pas encore été ciblés par l'une de ces escroqueries mais qui veulent s'assurer de ne pas en être victimes, établissez un safeword avec votre famille et vos amis.

Il s'agit d'un code qui signifie que vous et vos proches pouvez vous identifier les uns aux autres, c'est l'un des meilleurs moyens de vous assurer de ne pas être victime d'une escroquerie vocale AI. Cela sera particulièrement utile pour les membres âgés de la famille, et si ce n'est jamais écrit, cela peut être assez simple.

Il est également important de se tenir au courant des dernières méthodes, techniques et formats que les escrocs vocaux AI utilisent pour extorquer les victimes. En plus d'être vigilant et de traiter les appels de numéros inconnus avec une extrême prudence, garder l'oreille collée au sol est souvent la meilleure chose à faire.