Réseaux de neurones Feed Forward : un guide complet

Publié: 2024-03-02

Bienvenue dans notre guide complet sur les réseaux de neurones à action directe. Dans le contexte en constante évolution de la conscience de l’IA, il est fondamental de comprendre les réseaux de neurones. Les réseaux de neurones reflètent la construction et les capacités de l'esprit humain, permettant aux ordinateurs de tirer profit des informations et de poursuivre leurs choix d'une manière qui ressemble aux points de vue humains.

Ces organisations sont devenues la base de différentes applications d'IA, allant de la reconnaissance d'images à la gestion normale du langage. Quoi qu'il en soit, parmi les nombreuses conceptions de réseaux de neurones, les réseaux de neurones à action directe se distinguent par leur simplicité et leur viabilité.

Dans ce guide, nous approfondirons les complexités des organisations cérébrales à réaction anticipée, en étudiant leur ingénierie, la préparation de leurs cycles et leurs applications. Nous devrions donc quitter cette excursion pour démêler les secrets des réseaux neuronaux à action directe et confier leur pouvoir au domaine de la conscience de l’IA.

Qu'est-ce qu'un réseau neuronal Feed Forward ?

Bienvenue dans notre enquête sur les réseaux de neurones feed-forward, un élément principal des cadres de raisonnement informatisé actuels. Un réseau neuronal à action directe, souvent simplement appelé réseau neuronal, est une sorte de réseau neuronal contrefait dans lequel les associations entre les hubs n'encadrent pas les cycles.

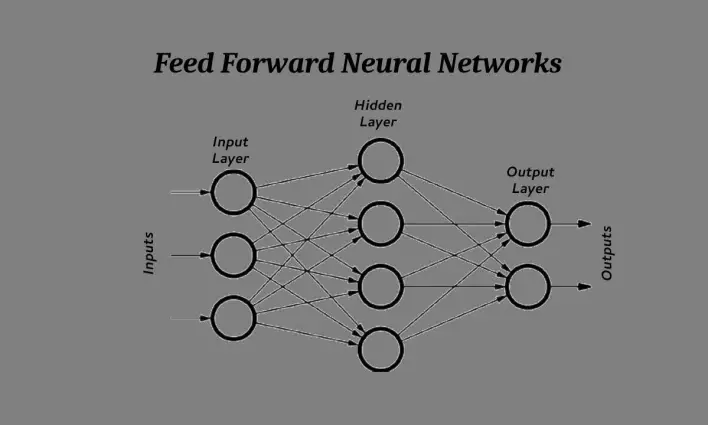

Définition et structure de base

En son centre, un réseau neuronal à action directe comprend des couches de hubs interconnectés, ou neurones, coordonnés progressivement. Chaque couche reçoit les informations de la couche précédente et transmet son résultat à la couche suivante sans pratiquement aucun cercle de critique. Cette progression unidirectionnelle des données de la contribution au rendement décrit la nature rétroactive de ces réseaux.

Comparaison avec d'autres types de réseaux de neurones

Contrairement aux réseaux de neurones récurrents (RNN), qui possèdent des associations de critiques leur permettant d'afficher un comportement dynamique et transitoire, les réseaux de neurones à action directe ont besoin de telles associations répétitives.

Cette qualification rend les réseaux à action directe particulièrement adaptés aux entreprises nécessitant des mappages de rendement d'informations statiques, comme la disposition des images ou les problèmes de rechute. Alors que les RNN réussissent à gérer des informations successives, les réseaux à action directe réussissent dans des entreprises où chaque information est exempte de sources de données passées.

Fondamentalement, les réseaux de neurones à réaction directe offrent une ingénierie directe pour le traitement des informations, prenant une décision célèbre dans différentes applications d'IA. Nous devrions approfondir les composantes et le fonctionnement de ces organisations pour acquérir une compréhension complète de leurs capacités et de leurs obstacles.

Lire aussi : Deep Learning vs Machine Learning : principales différences

Composants d'un réseau neuronal Feed Forward

Nous devrions plonger dans les parties ahurissantes qui composent un réseau neuronal à action directe, éclairant les fonctions internes de cette puissante conception de raisonnement informatisé.

Couche d'entrée

La couche d’informations sert de porte permettant aux informations d’entrer dans le réseau neuronal. Chaque neurone de cette couche traite un élément ou une qualité de l'information.

Par exemple, dans une tâche de reconnaissance d’image, chaque neurone pourrait être lié à une estimation de pixel. La couche d'informations transmet simplement les informations aux couches suivantes, démarrant ainsi la progression des données dans l'organisation.

Calques masqués

Installées entre les couches d'informations et de résultats, les couches secrètes sont le lieu où se produit la magie du calcul. Ces couches comprennent des neurones interconnectés, chacun effectuant des calculs pondérés sur l'information.

Le nombre de couches secrètes et le nombre de neurones dans chaque couche sont des limites de plan pivot qui ont un impact sur la capacité de l'organisation à obtenir des exemples complexes à partir d'informations.

Grâce à des changements progressifs dans les couches secrètes, l'organisation extrait des informations de niveau plus élevé, en travaillant avec l'expérience éducative explicite de la mission.

Couche de sortie

Au zénith du réseau neuronal se trouve la couche de résultats, où l'organisation délivre ses prévisions ou regroupements. Les neurones de cette couche traitent les résultats potentiels ou les classes de travail à effectuer.

Par exemple, dans un problème d'ordre double, la couche de résultats pourrait contenir deux neurones, chacun montrant la probabilité d'avoir une place dans l'une des deux classes. La couche résultante intègre les données traitées via les couches secrètes et crée le dernier résultat du réseau neuronal à action directe.

Comprendre les tâches et les communications particulières de ces éléments est fondamental pour comprendre l'utilité et les capacités des réseaux de neurones à action directe. Maintenant, que diriez-vous d’approfondir les travaux de mise en acte qui gèrent la manière de se comporter des neurones individuels à l’intérieur de ces couches ?

Fonctions d'activation

Que diriez-vous d'effectuer le travail critique des capacités de mise en œuvre dans le domaine des réseaux de neurones à action directe, révélant ainsi un aperçu de leur importance pour façonner en profondeur la manière de se comporter de l'organisation et permettre des calculs complexes ?

Objectif et types de fonctions d'activation

Les fonctions d'activation agissent comme des changements non linéaires appliqués à la quantité pondérée de contributions à chaque neurone, introduisant la non-linéarité dans l'organisation et lui permettant d'apprendre des connexions complexes dans les informations. Ils jouent un rôle essentiel dans la décision du résultat d’un neurone et, donc, de l’ensemble du réseau neuronal.

Il existe différents types de capacités d'initiation, chacune possédant des propriétés remarquables et un caractère raisonnable pour diverses missions. Comprendre les qualités et les ramifications de ces capacités est indispensable pour réellement planifier et préparer les réseaux de neurones à action directe.

Fonctions d'activation courantes utilisées dans les réseaux à action directe

Dans l’espace des réseaux neuronaux à action directe, quelques capacités de mise en acte ont acquis une certaine visibilité en raison de leur viabilité et de leur compétence informatique. Parmi celles-ci, la capacité sigmoïde modifiée en unité droite (ReLU) et la capacité de digression exagérée (tanh) sont généralement utilisées.

Chaque capacité de mise en œuvre présente des propriétés indubitables, ayant un impact sur la capacité de l'organisation à obtenir et à résumer des informations. En étudiant les qualités et les manières de se comporter de ces capacités d'initiation normales, nous pouvons acquérir des expériences sur leurs effets sur l'exécution du réseau et la rationalisation des procédures.

Propagation vers l'avant

Nous devrions nous plonger dans le cours crucial de la propagation vers l’avant dans l’espace des réseaux de neurones à action directe, en démêlant le système par lequel ces organisations transforment les informations d’entrée en prévisions ou en arrangements significatifs.

Explication du processus de propagation vers l'avant

La propagation vers l'avant, autrement appelée transmission directe, est le système principal par lequel les informations d'entrée traversent le réseau neuronal, couche par couche, pour finalement produire un résultat. Le cycle commence par la couche d'informations, où chaque neurone reçoit des valeurs d'informations distinctes. Ces entrées sont ensuite pondérées et additionnées, incorporant les paramètres appris (poids) associés à chaque connexion.

De cette manière, les qualités ultérieures passent par la capacité d'actionnement de chaque neurone dans les couches secrètes, introduisant de la non-linéarité dans l'organisation et permettant des calculs complexes. Cette progression consécutive des données se poursuit à travers les couches secrètes jusqu'à arriver à la couche de résultats, où les dernières attentes ou dispositions sont livrées.

L'engendrement ultérieur caractérise le cœur des réseaux neuronaux à réaction directe, travaillant avec l'interprétation des informations d'information en éléments de connaissances remarquables à travers des changements progressifs à travers les couches de l'organisation.

Rôle des pondérations et des biais

Les limites connues sous le nom de charges et de prédispositions, qui gèrent le changement des informations lorsqu'elles traversent le réseau neuronal, sont fondamentales pour le processus de propagation vers l'avant. Les charges traitent de la force des associations entre les neurones, dirigeant l'impact des valeurs d'information sur l'actionnement des neurones résultants.

Les biais, en revanche, servent de paramètres supplémentaires qui introduisent de la flexibilité et permettent au réseau d'apprendre des modèles complexes à partir des données.

Lors de la propagation vers l'avant, l'information est augmentée en fonction des charges particulières et ajoutée aux inclinaisons de chaque neurone, façonnant les niveaux d'initiation et décidant du résultat de l'organisation.

En modifiant ces limites grâce à la méthode impliquée dans la préparation, les réseaux de neurones à action directe peuvent réussir à tirer parti des informations et à ajuster leur façon de se comporter pour atteindre les objectifs souhaités.

Formation d'un réseau neuronal Feed Forward

Nous devrions nous plonger dans le cours imprévisible de la préparation d’un réseau neuronal à action directe, en ouvrant les instruments par lesquels ces organisations obtiennent des informations et en ajustant leurs limites pour réaliser une exécution idéale.

Aperçu du processus de formation

La préparation d'un réseau neuronal à action directe comprend l'introduction itérative d'informations de préparation marquées dans l'organisation et la modification de ses limites pour limiter la distinction entre les résultats attendus et réels. Ce cycle vise à faire progresser la capacité de synthèse de l'organisation depuis la préparation de l'information jusqu'aux modèles cachés, améliorant ainsi sa précision prémonitoire. À travers des cycles progressifs, l'organisation affine ses représentations intérieures, travaillant étape par étape sur son exposition sur le travail qui doit être accompli.

Algorithme de rétropropagation

Le calcul de rétropropagation est essentiel à la préparation des réseaux de neurones à réaction directe, ce qui permet de calculer efficacement les angles des limites du réseau. Le calcul fonctionne en engendrant des erreurs à l’envers dans l’organisation, en les attribuant aux neurones individuels à la lumière de leur engagement envers l’erreur des attentes générales.

En modifiant de manière itérative les charges et les prédispositions vers le chemin qui limite l'erreur, la rétropropagation fonctionne avec la combinaison de l'organisation vers un arrangement idéal. Ce processus itératif de passes avant et arrière permet à l'organisation d'obtenir des exemples complexes à partir d'informations et d'affiner ses représentations internes sur le long terme.

Techniques d'optimisation de descente de gradient

Les méthodes d'amélioration de la plongée en angle complètent le calcul de rétropropagation en dirigeant les actualisations des limites de l'organisation vers la trajectoire de la chute la plus abrupte de la scène d'erreur.

Ces procédures, comme la descente de gradient stochastique (SGD) et ses variations, modifient le taux d'apprentissage, mettent à jour les règles pour accélérer les combinaisons et empêchent le dépassement des minima proches.

En explorant efficacement l'espace limite des couches élevées, les stratégies d'amélioration des baisses d'inclinaison permettent aux réseaux neuronaux à réaction anticipée de se combiner pour former un arrangement idéal mondial, améliorant ainsi leur exécution prémonitoire et leur capacité de spéculation.

Lire aussi : Quelle est la méthodologie de l’apprentissage par renforcement profond ?

Applications des réseaux de neurones Feed Forward

En étudiant les différentes scènes d'utilisation, les réseaux neuronaux à réaction se présentent comme des dispositifs adaptables dotés d'une utilité incontournable dans différents espaces, de l'ordre des images aux résultats cliniques. Leur capacité intrinsèque à traiter des informations complexes et à apprendre des exemples imprévisibles en fait des ressources importantes dans le domaine de l’IA.

Classement des images

Dans le domaine de la vision sur PC, les réseaux de neurones à action directe ont bouleversé l'ordre des images en triant précisément les images dans des classes prédéfinies.

Utilisant des structures de réseaux neuronaux convolutifs (CNN), les réseaux à réaction décomposent les reflets au niveau des pixels et les représentations progressives pour reconnaître des éléments, des scènes ou des exemples dans les images.

Des véhicules indépendants aux cadres de reconnaissance faciale, les réseaux neuronaux à action directe alimentent de nombreuses applications basées sur des images, améliorant ainsi l'efficacité et la précision des tâches de reconnaissance visuelle.

Traitement du langage naturel

Les réseaux neuronaux à action directe trouvent de larges applications dans le traitement du langage naturel (NLP), où ils réussissent des tâches telles que l'examen d'opinion, la caractérisation de texte et la reconnaissance de substances nommées.

Grâce à des réseaux de neurones récurrents (RNN) ou à des conceptions de transformateurs, les réseaux à réaction traitent des informations consécutives, extrayant la signification sémantique et les données contextuelles du texte.

Leur polyvalence face aux subtilités étymologiques et leur capacité à détecter des conditions à longue portée en font des appareils clés dans la création d'applications PNL robustes, allant des chatbots aux cadres d'interprétation du langage.

Prévisions financières

Dans le domaine monétaire, les réseaux de neurones à réaction jouent un rôle important dans la prévision des modèles de marché, des coûts boursiers et des évaluations des paris monétaires.

En décomposant les informations authentiques et les indicateurs financiers, les réseaux de rétroaction maîtrisent les exemples et les relations cachés, permettant ainsi des chiffres exacts et une orientation éclairée.

Leur capacité à gérer des connexions non linéaires et à s’adapter à l’évolution des situations économiques en fait des instruments fondamentaux pour les experts monétaires, les courtiers et les sociétés commerciales qui tentent de prendre le dessus sur la scène unique de la monnaie.

Lire aussi : L'IA dans les tendances du marché des matières premières : de la prédiction à la réalité

Diagnostic médical

Dans le domaine des soins médicaux, les réseaux neuronaux à réaction directe offrent des voies prometteuses pour détecter, deviner et organiser une thérapie. En disséquant les informations d’imagerie clinique, les enregistrements électroniques de bien-être et les successions génomiques, les réseaux de rétroaction aident à distinguer les conceptions démontrant différentes maladies et affections.

De l'identification des particularités des tableaux cliniques à la prévision des résultats des patients, ces organisations font appel à des experts des services médicaux possédant des connaissances importantes et des appareils d'aide au choix, travaillant enfin à la compréhension de l'examen et des résultats du traitement.

Défis et limites

L'exploration du paysage des réseaux de neurones à réaction révèle un tas de difficultés et de restrictions qui doivent être résolues pour libérer leur capacité maximale à résoudre des problèmes ahurissants dans différents espaces.

Comprendre ces obstacles est fondamental pour concevoir des procédures viables visant à modérer leurs effets et à encourager la progression du raisonnement informatisé.

Surapprentissage

L'une des difficultés essentielles rencontrées par les réseaux de neurones à action directe est le risque de surajustement, dans lequel le modèle capte des agitations et des exemples insignifiants à partir des informations de préparation, ce qui incite à des spéculations malheureuses sur des modèles discrets.

Le surapprentissage se produit lorsque l’organisation s’avère excessivement ahurissante par rapport aux informations accessibles, favorisant la mémoire plutôt que l’apprentissage.

Des systèmes tels que les méthodes de régularisation, l'expansion des informations et l'arrêt précoce sont utilisés pour lutter contre le surajustement et inciter l'organisation à obtenir des représentations significatives à partir des informations.

Dégradés qui disparaissent et explosent

Un autre défi inhérent à la formation des réseaux neuronaux à action directe est le problème des gradients qui disparaissent ou explosent, dans lesquels les pentes diminuent considérablement ou se développent de manière extravagante à mesure qu'elles se propagent à l'envers dans l'organisation pendant la préparation.

Cette particularité peut bloquer le montage de l’organisation et contrecarrer sa capacité à apprendre. Des stratégies, par exemple la coupe d'angle, la déclaration prudente du poids et le travail d'initiation qui soulagent l'immersion d'inclinaison, sont utilisées pour aborder ce test et équilibrer l'interaction de préparation.

Complexité informatique

Les réseaux de neurones à action directe sont souvent aux prises avec une complexité informatique, en particulier à mesure que la taille et la profondeur du réseau augmentent. Le grand nombre de limites et de calculs associés à la préparation d’organisations à grande échelle peut mettre à rude épreuve les ressources informatiques et entraver les hypothèses en cours dans les applications pragmatiques.

Des méthodes telles que l'élagage de modèle, la quantification et la parallélisation sont utilisées pour diminuer la complexité informatique et améliorer la compétence des réseaux neuronaux à action directe, permettant ainsi leur envoi dans des conditions d'actifs.

Conclusion

En conclusion, dans l'ensemble, ce guide exhaustif a fait un saut profond dans la complexité des réseaux de neurones à action directe, révélant un aperçu de leur ingénierie, de leurs cycles de préparation, de leurs applications et de leurs difficultés.

De la compréhension des éléments des organisations à réaction directe à l'étude de leurs différentes applications dans différents espaces, par exemple la disposition des images, la gestion normale du langage, la détermination monétaire et l'analyse clinique, nous avons révélé l'effet significatif que ces organisations ont sur le domaine de l'homme. fait de la matière grise.

Les réseaux de neurones feed-forward agissent comme des points de soutien centraux dans l’amélioration de cadres astucieux, stimulant le développement et cultivant les progrès dans différentes entreprises. Alors que nous continuons à dévoiler les secrets des organisations feed-forward et à repousser les limites de la matière grise créée par l'homme, nous vous invitons à partager vos réflexions et vos expériences dans les remarques ci-dessous.

N'oubliez pas de diffuser l'information en communiquant ces données étonnantes à vos compagnons et partenaires. Ensemble, nous devrions partir en excursion vers l’ouverture de la capacité maximale des réseaux de neurones à action directe et façonner le sort éventuel de l’intelligence artificielle.