Ce site Web vous permet de cloner la voix de n'importe qui en moins de 30 secondes

Publié: 2024-01-04Avez-vous déjà souhaité que la voix captivante de Morgan Freeman raconte votre quotidien ? Ou peut-être avez-vous imaginé votre GPS parlant avec les tons sensuels de Scarlett Johansson ?

Grâce à un nouvel outil innovant de MyShell.ai, appelé OpenVoice, tout cela et bien plus encore sont désormais à portée de main.

Alors c'est quoi? OpenVoice est un outil de clonage vocal instantané qui peut imiter n'importe quelle voix à partir d'un court échantillon audio.

Mais la vraie magie est que cela ne se limite pas à imiter la voix de quelqu'un ; il sélectionne essentiellement toutes ses caractéristiques uniques.

OpenVoice permet un contrôle granulaire des styles de voix, notamment l'émotion, l'accent, le rythme, les pauses et l'intonation, une fonctionnalité que les autres outils de clonage vocal n'offrent tout simplement pas.

La technologie fonctionne en dissociant autant que possible les composants d'une voix, ce qui signifie que le ton, le style et le langage sont traités comme des éléments individuels.

Cela permet de manipuler indépendamment la voix, le style et la langue de base, offrant un niveau de personnalisation impressionnant.

Ce qui distingue vraiment OpenVoice de ses prédécesseurs, comme ElevenLabs, est sa capacité de clonage vocal multilingue sans tir. Cela signifie qu'OpenVoice peut imiter des voix dans des langues qui ne sont pas incluses dans son ensemble de formation.

Donc, si vous avez toujours voulu que votre livre audio soit lu en français par la voix d'un anglophone, OpenVoice est là pour vous.

Comment cloner une voix avec OpenVoice de MyShell

Bien que la technologie soit complexe, l’utilisation d’OpenVoice est étonnamment simple.

Tout ce qu'il faut, c'est un court clip audio du locuteur souhaité, et en quelques secondes, vous pouvez générer un discours avec la voix de cette personne, dans plusieurs langues et avec une gamme d'émotions et de styles.

Voici un guide étape par étape sur la façon d'utiliser OpenVoice de MyShell en fonction des instructions fournies sur leur page GitHub :

Bien que la technologie soit complexe, l’utilisation d’OpenVoice est étonnamment simple.

Tout ce qu'il faut, c'est un court clip audio du locuteur souhaité, et en quelques secondes, vous pouvez générer un discours avec la voix de cette personne, dans plusieurs langues et avec une gamme d'émotions et de styles.

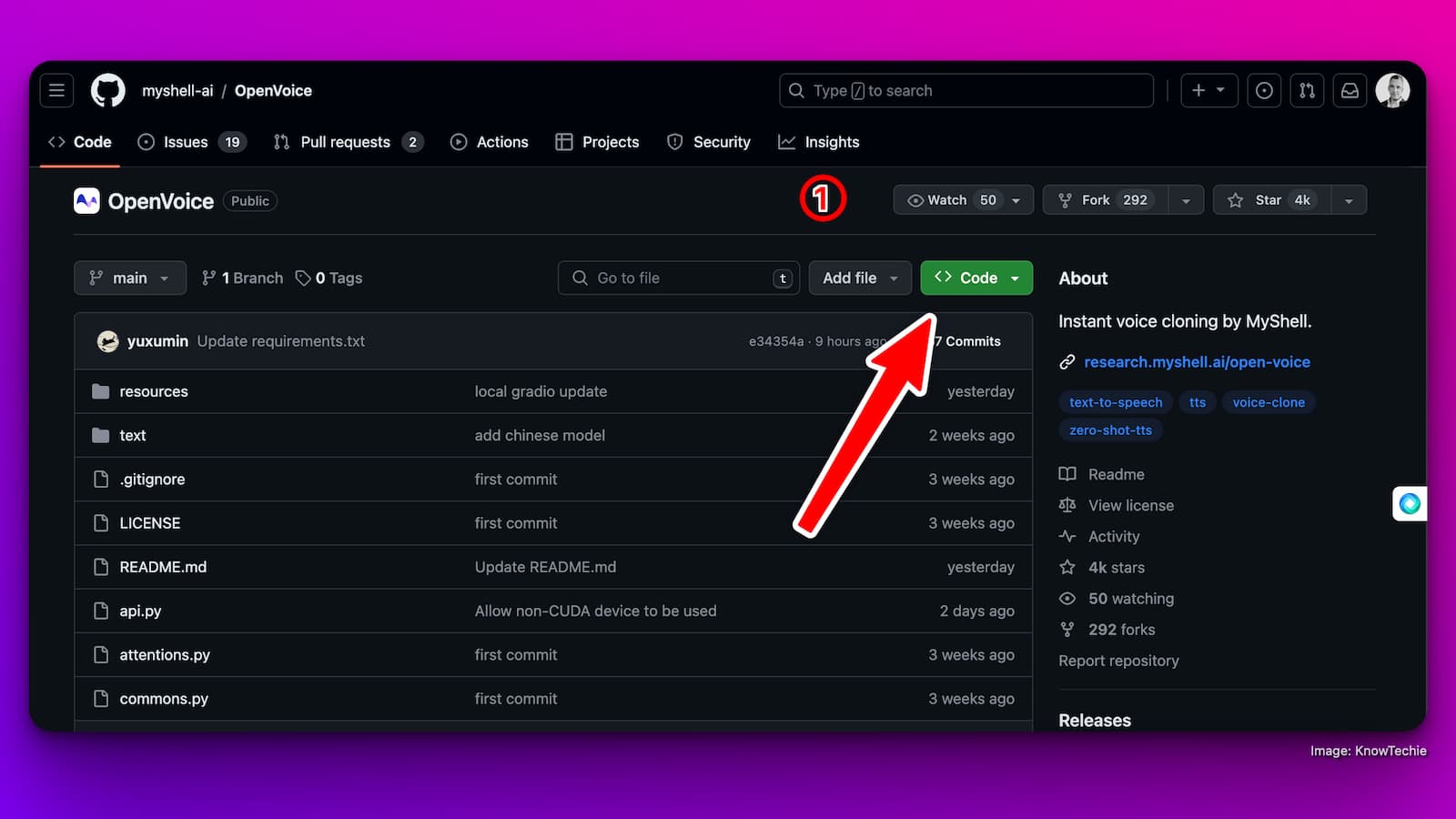

Cloner le référentiel OpenVoice

Vous pouvez le faire en accédant au référentiel OpenVoice GitHub et en cliquant sur le bouton vert « Code ». Cliquez ensuite sur « Télécharger ZIP » pour télécharger les fichiers du référentiel sur votre système local.

Télécharger le zip

Cliquez ensuite sur « Télécharger ZIP » pour télécharger les fichiers du référentiel sur votre système local.

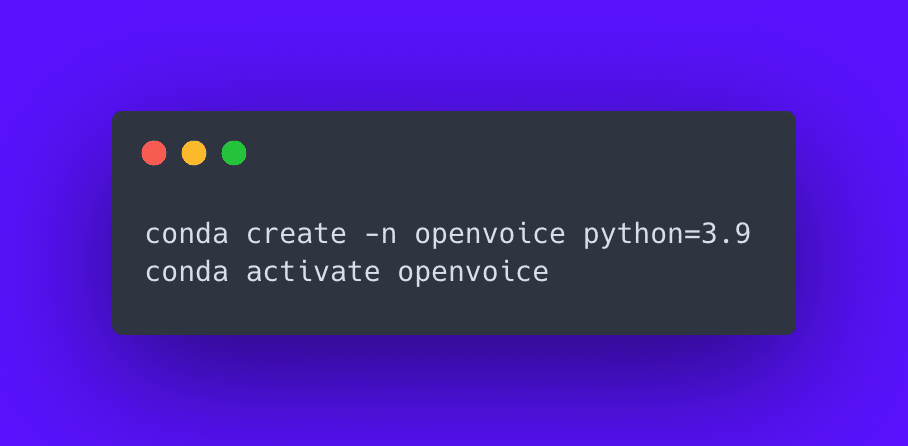

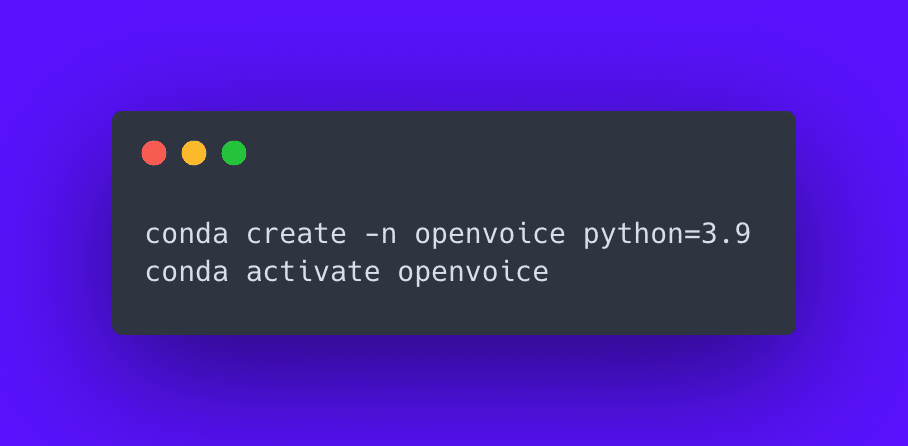

Créer et activer un environnement Python

Créez un nouvel environnement Python et activez-le. Si vous utilisez Anaconda, vous pouvez le faire avec les commandes suivantes dans votre terminal :

conda create -n openvoice python=3.9

conda activer openvoiceInstaller les packages requis

Pour installer les packages requis, vous pouvez le faire avec les commandes suivantes dans votre terminal :

conda install pytorch==1.13.1 torchvision==0.14.1 torchaudio==0.13.1 pytorch-

cuda=11.7 -c pytorch -c nvidia

pip install -r exigences.txtTéléchargez le point de contrôle à partir d'ici et extrayez-le dans le dossier

checkpoints.

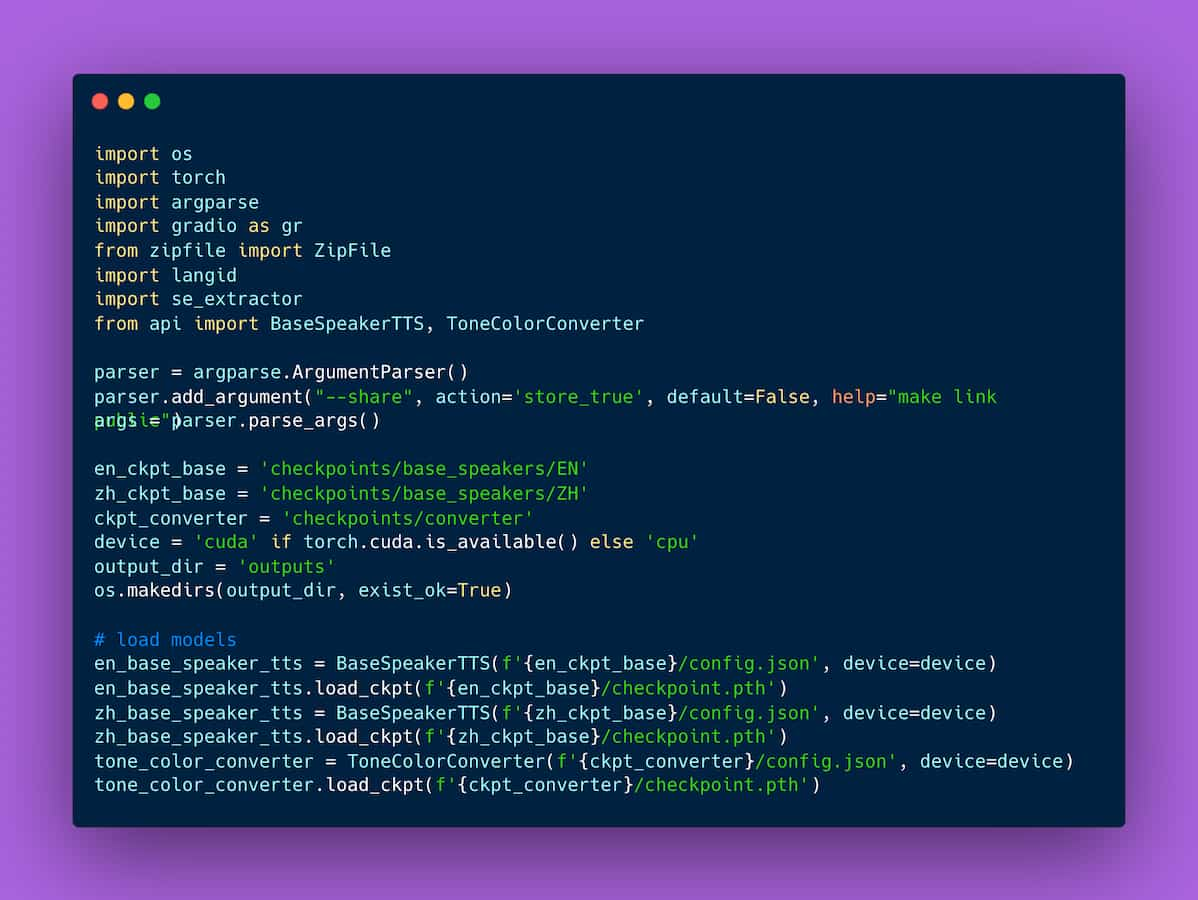

Comment utiliser OpenVoice

Remarque : les choses deviennent ici un peu techniques. Si vous n'avez aucune expérience en codage ou n'êtes pas familier avec les environnements Python, cela va probablement vous dépasser. Mais si vous appréciez un peu de punition, alors allons de l'avant.

- Contrôle flexible du style vocal : vous pouvez voir un exemple de la façon dont OpenVoice permet un contrôle flexible du style sur la voix clonée dans

demo_part1.ipynb. - Clonage vocal multilingue : vous pouvez voir un exemple de langues vues ou invisibles dans l'ensemble de formation MSML dans

demo_part2.ipynb. - Démo Gradio : Vous pouvez lancer une démo Gradio locale avec la commande suivante dans votre terminal :

python -m openvoice_app --shareUtilisation avancée : le modèle d'enceinte de base peut être remplacé par n'importe quel modèle (dans n'importe quelle langue et style) que vous préférez.

Vous pouvez utiliser la fonction se_extractor.get_se comme démontré dans la démo pour extraire l'intégration de la couleur du ton pour le nouveau haut-parleur de base.

2.5 Conseils pour générer une parole naturelle : Il existe de nombreuses méthodes TTS à un ou plusieurs locuteurs qui peuvent générer une parole naturelle, qui sont facilement disponibles.

En remplaçant simplement le modèle d'enceinte de base par le modèle que vous préférez, vous pouvez pousser le naturel de la parole au niveau que vous désirez.

Combien coûte OpenVoice ?

Le service est actuellement gratuit et l'équipe de MyShell.ai a mis le code source et le modèle formé à disposition sur GitHub, permettant aux développeurs d'expérimenter et d'étendre la technologie.

Quel est le potentiel d’OpenVoice ?

OpenVoice n'est pas seulement un gadget amusant.

Il a le potentiel de révolutionner les secteurs, du divertissement et des médias, où il pourrait être utilisé pour doubler des films ou créer des chatbots personnalisés, jusqu'à l'accessibilité, où il pourrait donner une voix à ceux qui ont perdu la leur.

Bien que le potentiel d'utilisation abusive, comme la contrefaçon audio ou le vol d'identité, soit préoccupant, l'équipe de MyShell.ai s'engage à suivre les directives éthiques et à explorer les garanties pour empêcher une telle utilisation abusive.

En termes de rapidité et de précision, OpenVoice surpasse ses concurrents. L’outil est efficace sur le plan informatique et l’équipe affirme qu’il peut générer une seconde de parole en seulement 85 millisecondes.

OpenVoice est un aperçu passionnant de l'avenir de la technologie vocale.

Avec sa capacité à cloner n’importe quelle voix instantanément, les possibilités semblent infinies. Alors pourquoi ne pas essayer et voir qui vous pourriez devenir ?

Les cerveaux derrière cette centrale incluent Zengyi Qin des couloirs du MIT et de MyShell, Wenliang Zhao et Xumin Yu, tous deux de l'Université Tsinghua et enfin Ethan Sun de MyShell.

Avez-vous des idées à ce sujet ? Écrivez-nous ci-dessous dans les commentaires ou portez la discussion sur notre Twitter ou Facebook.

Recommandations des rédacteurs :

- À qui appartient ElevenLabs ?

- Qu’est-ce qu’ElevenLabs ?

- Le pari de Figma sur l'IA de FigJam rendra les réunions plus supportables

- L'IA Copilot de Microsoft prend son envol sur iOS

Juste un avertissement : si vous achetez quelque chose via nos liens, nous pouvons recevoir une petite part de la vente. C'est l'une des façons dont nous gardons les lumières allumées ici. Cliquez ici pour en savoir plus.