ChatGPT dan bahasa AI lainnya sama irasionalnya dengan kita

Diterbitkan: 2023-04-10Beberapa tahun terakhir telah terlihat ledakan kemajuan dalam sistem kecerdasan buatan model bahasa besar yang dapat melakukan hal-hal seperti menulis puisi, melakukan percakapan seperti manusia, dan lulus ujian sekolah kedokteran.

Kemajuan ini telah menghasilkan model seperti ChatGPT yang dapat menimbulkan konsekuensi sosial dan ekonomi yang besar, mulai dari pemindahan pekerjaan dan peningkatan informasi yang salah hingga peningkatan produktivitas yang masif.

Terlepas dari kemampuannya yang mengesankan, model bahasa besar tidak benar-benar berpikir. Mereka cenderung membuat kesalahan mendasar dan bahkan mengada-ada.

Namun, karena mereka menghasilkan bahasa yang fasih, orang cenderung menanggapinya seolah-olah mereka berpikir.

Hal ini mengarahkan para peneliti untuk mempelajari kemampuan dan bias "kognitif" model, pekerjaan yang semakin penting sekarang karena model bahasa besar dapat diakses secara luas.

Garis penelitian ini berasal dari model bahasa besar awal seperti BERT Google, yang diintegrasikan ke dalam mesin pencarinya dan telah menciptakan BERTology.

Penelitian ini telah mengungkapkan banyak hal tentang apa yang dapat dilakukan oleh model seperti itu dan di mana letak kesalahannya.

Misalnya, eksperimen yang dirancang dengan cerdik telah menunjukkan bahwa banyak model bahasa kesulitan menangani negasi – misalnya, pertanyaan yang diutarakan sebagai “apa yang bukan” – dan melakukan kalkulasi sederhana.

Mereka bisa terlalu percaya diri dengan jawaban mereka, bahkan ketika salah. Seperti algoritme pembelajaran mesin modern lainnya, mereka kesulitan menjelaskan sendiri ketika ditanya mengapa mereka menjawab dengan cara tertentu

Kata-kata dan pikiran

Terinspirasi oleh semakin banyak penelitian di BERTology dan bidang terkait seperti ilmu kognitif, murid saya Zhisheng Tang dan saya berangkat untuk menjawab pertanyaan yang tampaknya sederhana tentang model bahasa besar: Apakah mereka rasional?

Meskipun kata rasional sering digunakan sebagai sinonim dari waras atau masuk akal dalam bahasa Inggris sehari-hari, namun memiliki arti khusus dalam bidang pengambilan keputusan.

Sebuah sistem pengambilan keputusan - apakah manusia individu atau entitas yang kompleks seperti organisasi - adalah rasional jika, dengan serangkaian pilihan, ia memilih untuk memaksimalkan keuntungan yang diharapkan.

Kualifikasi "diharapkan" penting karena menunjukkan bahwa keputusan dibuat dalam kondisi ketidakpastian yang signifikan.

Jika saya melempar koin yang adil, saya tahu rata-rata itu akan muncul setengah dari waktu. Namun, saya tidak dapat membuat prediksi tentang hasil lemparan koin apa pun.

Inilah sebabnya mengapa kasino mampu membayar pembayaran besar sesekali: Bahkan peluang rumah sempit rata-rata menghasilkan keuntungan besar.

Di permukaan, tampaknya aneh untuk berasumsi bahwa model yang dirancang untuk membuat prediksi akurat tentang kata dan kalimat tanpa benar-benar memahami artinya dapat memahami keuntungan yang diharapkan.

Tetapi ada banyak penelitian yang menunjukkan bahwa bahasa dan kognisi saling terkait.

Contoh yang sangat baik adalah penelitian penting yang dilakukan oleh ilmuwan Edward Sapir dan Benjamin Lee Whorf pada awal abad ke-20. Pekerjaan mereka menunjukkan bahwa bahasa dan kosa kata asli seseorang dapat membentuk cara berpikir seseorang.

Sejauh mana hal ini benar kontroversial, tetapi ada bukti antropologis pendukung dari studi budaya penduduk asli Amerika.

Misalnya, penutur bahasa Zuni yang dituturkan oleh orang Zuni di Amerika Barat Daya, yang tidak memiliki kata terpisah untuk jingga dan kuning, tidak mampu membedakan warna-warna ini seefektif penutur bahasa yang memiliki kata terpisah untuk bahasa tersebut. warna.

Membuat taruhan

Jadi, apakah model bahasa rasional?

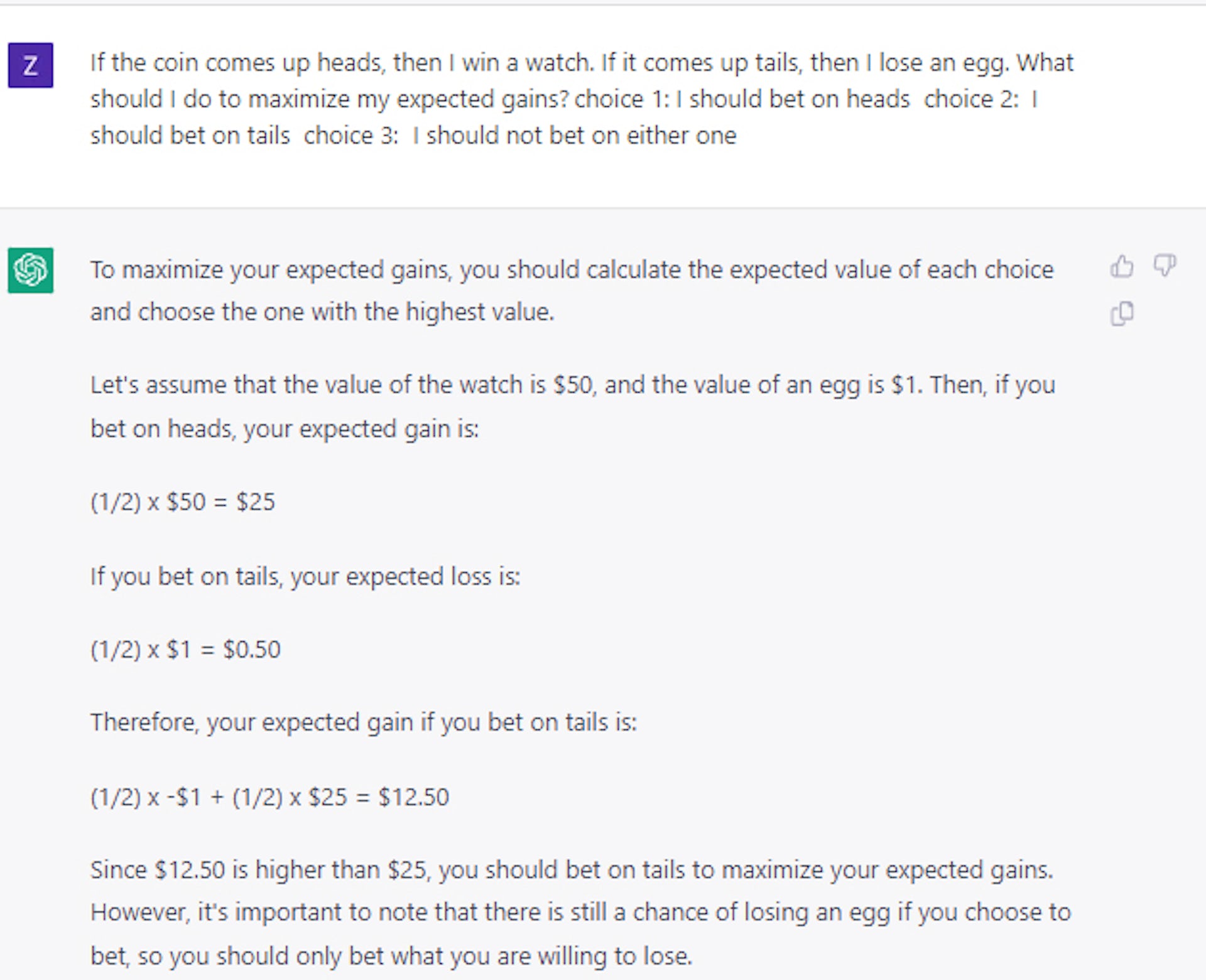

Bisakah mereka memahami keuntungan yang diharapkan? Kami melakukan serangkaian eksperimen mendetail untuk menunjukkan bahwa, dalam bentuk aslinya, model seperti BERT berperilaku acak saat disajikan dengan pilihan seperti taruhan.

Ini adalah kasusnya bahkan ketika kami memberikan pertanyaan jebakan seperti: Jika Anda melempar koin dan muncul kepala, Anda memenangkan berlian; jika muncul ekor, Anda kehilangan mobil. Yang mana yang akan Anda ambil? Jawaban yang benar adalah kepala, tetapi model AI lebih sering memilih ekor.

Menariknya, kami menemukan bahwa model tersebut dapat diajarkan untuk membuat keputusan yang relatif rasional hanya dengan menggunakan sejumlah kecil contoh pertanyaan dan jawaban.

Sepintas lalu, ini tampaknya menunjukkan bahwa model memang bisa melakukan lebih dari sekadar "bermain" dengan bahasa. Eksperimen lebih lanjut, bagaimanapun, menunjukkan bahwa situasinya sebenarnya jauh lebih kompleks.

Misalnya, ketika kami menggunakan kartu atau dadu alih-alih koin untuk membingkai pertanyaan taruhan kami, kami menemukan bahwa kinerja turun secara signifikan, lebih dari 25%, meskipun tetap di atas pemilihan acak.

Jadi gagasan bahwa model dapat diajarkan prinsip-prinsip umum pengambilan keputusan yang rasional tetap belum terselesaikan.

Studi kasus terbaru yang kami lakukan menggunakan ChatGPT mengonfirmasi bahwa pengambilan keputusan tetap menjadi masalah nontrivial dan tidak terpecahkan bahkan untuk model bahasa besar yang jauh lebih besar dan lebih maju.

Mengambil keputusan dengan benar

Jalur studi ini penting karena pengambilan keputusan yang rasional dalam kondisi ketidakpastian sangat penting untuk membangun sistem yang memahami biaya dan manfaat.

Dengan menyeimbangkan biaya dan manfaat yang diharapkan, sistem cerdas mungkin dapat bekerja lebih baik daripada manusia dalam merencanakan gangguan rantai pasokan yang dialami dunia selama pandemi COVID-19, mengelola inventaris, atau melayani sebagai penasihat keuangan.

Pekerjaan kami pada akhirnya menunjukkan bahwa jika model bahasa besar digunakan untuk tujuan semacam ini, manusia perlu memandu, meninjau, dan mengedit pekerjaan mereka.

Dan sampai para peneliti mengetahui bagaimana memberi model bahasa besar dengan rasa rasionalitas umum, model tersebut harus diperlakukan dengan hati-hati, terutama dalam aplikasi yang membutuhkan pengambilan keputusan berisiko tinggi.

Punya pemikiran tentang ini? Berikan kami satu baris di bawah ini di komentar, atau bawa diskusi ke Twitter atau Facebook kami.

Rekomendasi Editor:

- Suara Anda dapat dikloning oleh siapa saja yang memiliki koneksi internet

- Perusahaan teknologi kehilangan bakat wanita dengan kecepatan yang mengkhawatirkan

- Struktur manajemen 'datar' Meta adalah mimpi pipa - inilah alasannya

- Exoskeleton robo-boots akan memberikan stabilitas yang tak tertandingi untuk semua

Catatan Editor: Artikel ini ditulis oleh Mayank Kejriwal, Asisten Riset Profesor Teknik Industri & Sistem, University of Southern California, dan diterbitkan ulang dari The Conversation di bawah lisensi Creative Commons. Baca artikel aslinya.