Come rilevare ChatGPT e plagio AI

Pubblicato: 2023-06-22ChatGPT ha capovolto il mondo accademico e quello degli affari con la sua capacità di generare testi coerenti e ben scritti su praticamente qualsiasi argomento al mondo in pochi secondi.

Le sue notevoli capacità hanno visto studenti di tutti i livelli educativi rivolgersi al chatbot – così come ai suoi rivali, come Bard – per scrivere saggi complessi che altrimenti richiederebbero ore per essere completati.

Ciò ha dato il via a una conversazione globale su un nuovo fenomeno, spesso definito "plagio di ChatGPT". Questa guida copre gli strumenti che le aziende e le istituzioni educative utilizzano per rilevare il plagio di ChatGPT, i pericoli di imbrogliare con ChatGPT e se l'utilizzo di ChatGPT conta come plagio.

- Come rilevare il plagio di ChatGPT

- Dama di plagio AI e ChatGPT più popolari

- I controllori di contenuti AI funzionano davvero?

- L'utilizzo di ChatGPT o Bard è in realtà un plagio?

- I pericoli di barare con ChatGPT

- ChatGPT plagia?

- Bard plagia?

- Altri strumenti di intelligenza artificiale plagiano?

- Dovrei usare ChatGPT per i miei saggi o il mio lavoro?

Come rilevare il plagio di ChatGPT

Per rilevare il plagio di ChatGPT, è necessario un controllo dei contenuti AI. I controllori di contenuti AI scansionano corpi di testo per determinare se sono stati prodotti da un chatbot come ChatGPT o Bard o da un essere umano. Tuttavia, come vedremo più avanti, questi strumenti sono tutt'altro che affidabili.

È leggermente più difficile rilevare il plagio quando si tratta di codice, qualcosa che ChatGPT può anche generare abilmente. Non esiste proprio lo stesso ecosistema di strumenti di rilevamento AI per il codice come per i contenuti.

Tuttavia, se ti trovi in un ambiente universitario, ad esempio, e stai inviando codice ben oltre il tuo livello tecnico, il tuo professore o docente potrebbe avere dei sospetti molto ragionevoli che tu abbia chiesto a ChatGPT di aiutarti.

Recensiti gli strumenti per il controllo del plagio AI e ChatGPT più popolari

Dal lancio di ChatGPT nel novembre 2022, molte aziende e istituzioni educative hanno prodotto controllori di contenuti AI, che affermano di essere in grado di distinguere tra contenuti generati artificialmente e contenuti creati da esseri umani. Ora, molte aziende utilizzano anche il chatbot Bard di Google, che utilizza un modello linguistico diverso.

Tuttavia, la presunta accuratezza anche degli strumenti di rilevamento dei contenuti di intelligenza artificiale più rinomati è fortemente contestata e si sono già concretizzati casi giudiziari tra studenti falsamente accusati di utilizzare contenuti di intelligenza artificiale e istruzione.

La linea di fondo è questa: nessuno strumento in questo spazio è accurato al 100%, ma alcuni sono molto meglio di altri.

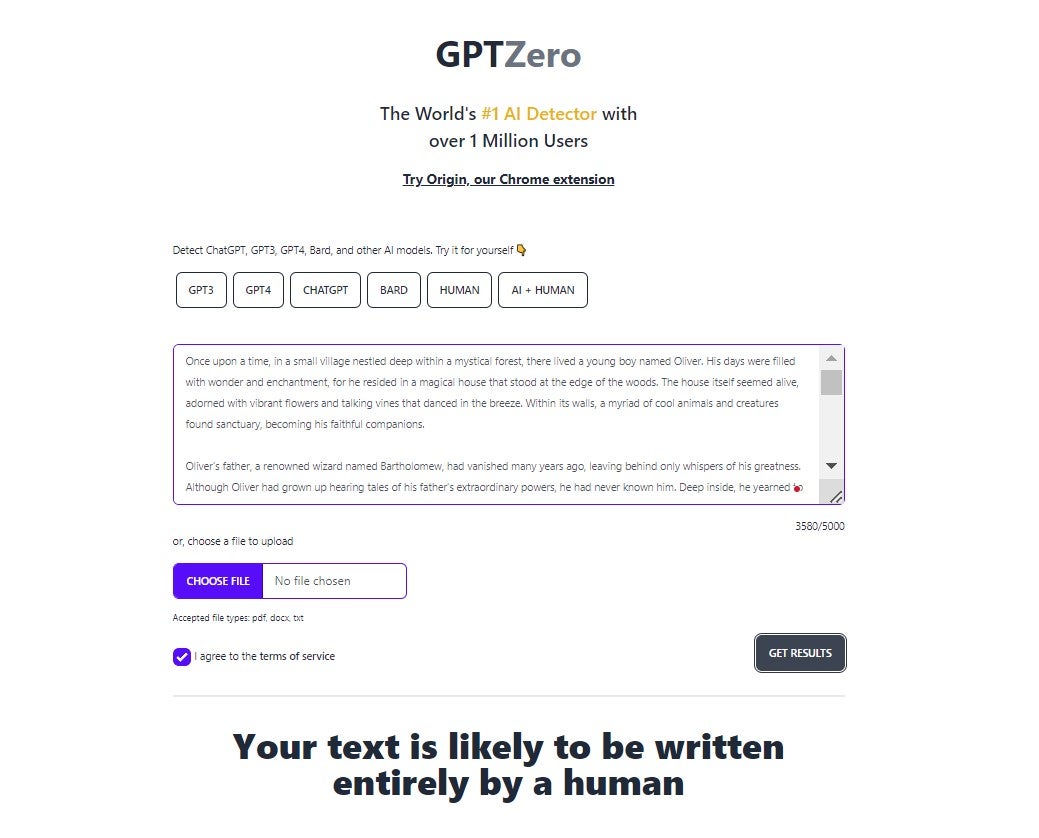

GPTZero

GPTZero è un popolare strumento gratuito di rilevamento dei contenuti AI che afferma di essere "il rilevatore AI più accurato in tutti i casi d'uso, verificato da più fonti indipendenti".

Tuttavia, ad aprile, uno studente di storia della UC Davis ha dimostrato che GPTZero, uno strumento di rilevamento dei contenuti AI utilizzato dal suo professore, non era corretto quando ha etichettato il suo saggio come generato dall'IA.

Abbiamo testato GPTZero chiedendo a ChatGPT di scrivere un racconto. GPTZero, sfortunatamente, non è stato in grado di dire che il contenuto è stato scritto da uno strumento di intelligenza artificiale:

Originalità.ai

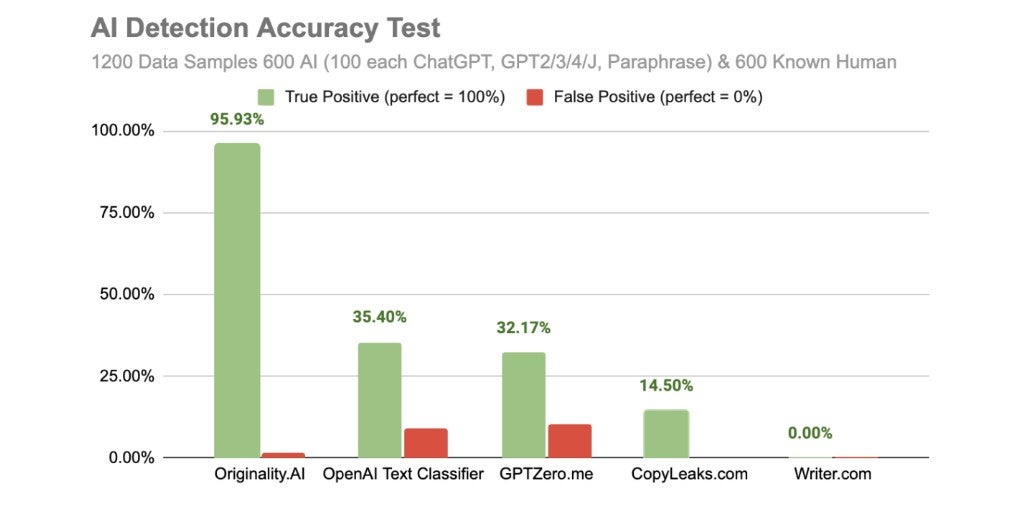

Originality.ai è sicuramente uno degli strumenti di rilevamento dei contenuti AI più accurati attualmente disponibili.

La società ha condotto il proprio studio sugli strumenti di rilevamento dei contenuti AI nell'aprile di quest'anno, all'interno del quale ha alimentato 600 blocchi di testo generati artificialmente e 600 generati dall'uomo al proprio sistema di rilevamento dei contenuti, nonché altri strumenti popolari che affermano di fare simili .

Come puoi vedere dai risultati di seguito, Originality.ai ha superato tutti gli strumenti inclusi nel test:

L'unico aspetto negativo di Originality.ai è che non esiste un piano gratuito e non puoi nemmeno provarlo gratuitamente come puoi fare con le altre app incluse in questo articolo. costa $ 20 per 2.000 crediti, che ti permetteranno di controllare 200.000 parole.

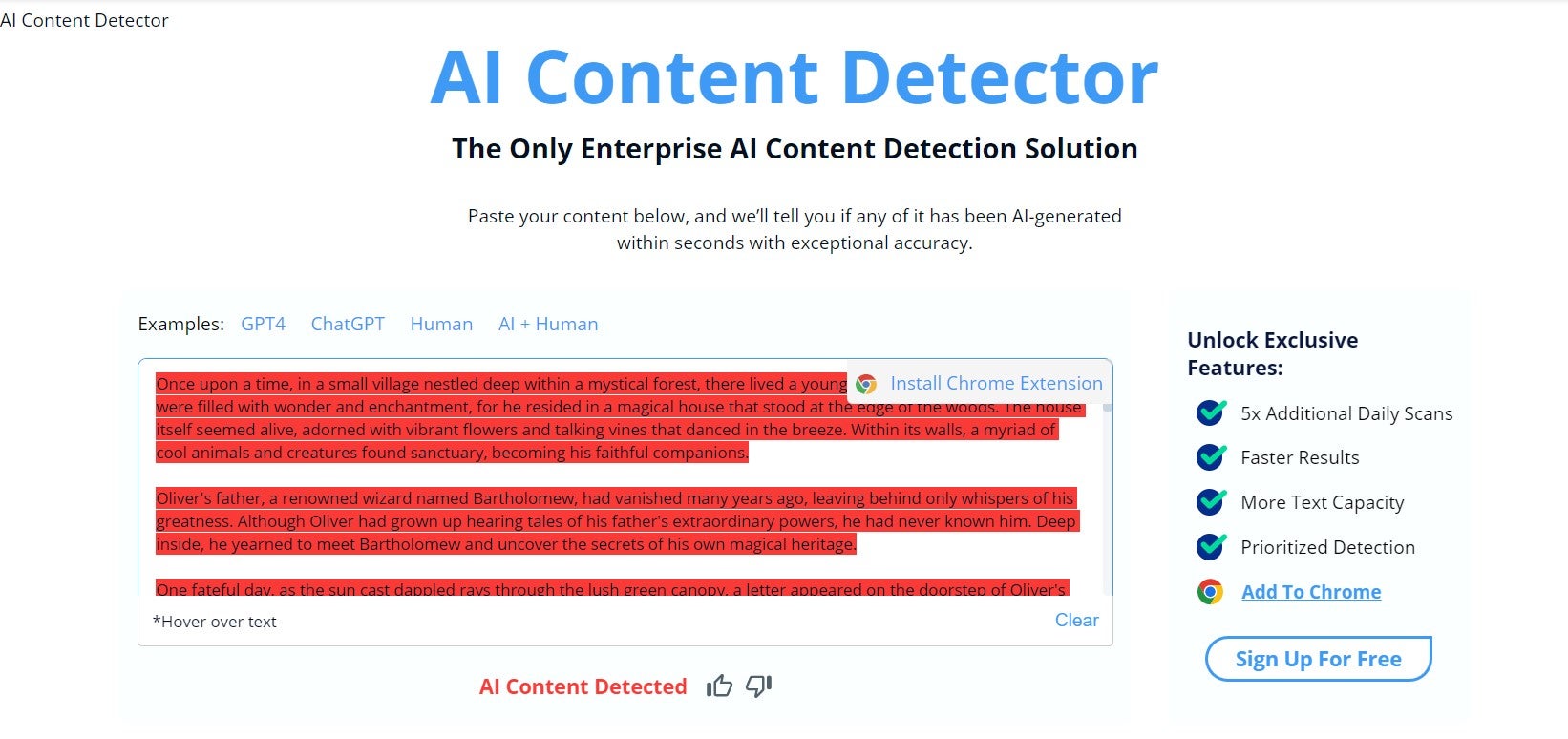

Copyleaks Rilevatore di contenuto AI

Copyleaks è un rilevatore di contenuti AI gratuito che afferma di essere in grado di distinguere tra copia generata dall'uomo e generata dall'IA con una precisione del 99,12%.

Copyleaks ti dirà anche se aspetti specifici di un documento o passaggio sono stati scritti dall'intelligenza artificiale, anche se altre parti sembrano essere state scritte da un essere umano.

Copyleaks afferma di essere in grado di rilevare i contenuti generati dall'intelligenza artificiale creati da "ChatGPT, GPT-4, GPT-3, Jasper e altri" e afferma persino che "una volta usciti i modelli più recenti, saremo in grado di rilevarli automaticamente".

CopyLeaks costa $ 8,33 al mese per 1.200 crediti (250 parole di copia per credito).

In un test condotto da TechCrunch nel febbraio 2023, tuttavia, Copyleaks ha erroneamente classificato vari tipi diversi di copia generata dall'intelligenza artificiale, tra cui un articolo di notizie, una voce dell'enciclopedia e una lettera di accompagnamento come generata dall'uomo.

Inoltre, lo studio di Originality.ai citato sopra lo ha trovato accurato solo nel 14,50% dei casi, ben lontano dall'affermazione di accuratezza del 99,12% fatta da CopyLeaks.

Tuttavia, quando l'abbiamo testato, sembrava essere in grado di rilevare che il testo che abbiamo inserito è stato generato da ChatGPT:

Rilevatore AI Turnitin

Turnitin è una società di rilevamento del plagio con sede negli Stati Uniti che viene impiegata da una varietà di università per scansionare il lavoro dei propri studenti. Turnitin è progettato per rilevare tutti i tipi di plagio, ma ad aprile ha rivelato che da tempo investe in un team incentrato sull'intelligenza artificiale.

Turnitin afferma che può "rilevare la presenza di scrittura AI con una confidenza del 98% e un tasso di falsi positivi inferiore all'1% nel nostro ambiente di laboratorio controllato".

Tuttavia, la società afferma anche che il contenuto se contrassegna un contenuto come generato dall'intelligenza artificiale, questo dovrebbe essere trattato come "un'indicazione, non un'accusa". La vera accuratezza del rilevatore AI di Turnitin è stata contestata dal Washington Post, così come da altre fonti.

Il software di rilevamento dei contenuti AI di Turnitin è attualmente gratuito, ma la società afferma in una FAQ sul suo sito Web che passerà a un programma di licenza a pagamento nel gennaio 2024, il cui prezzo non è specificato.

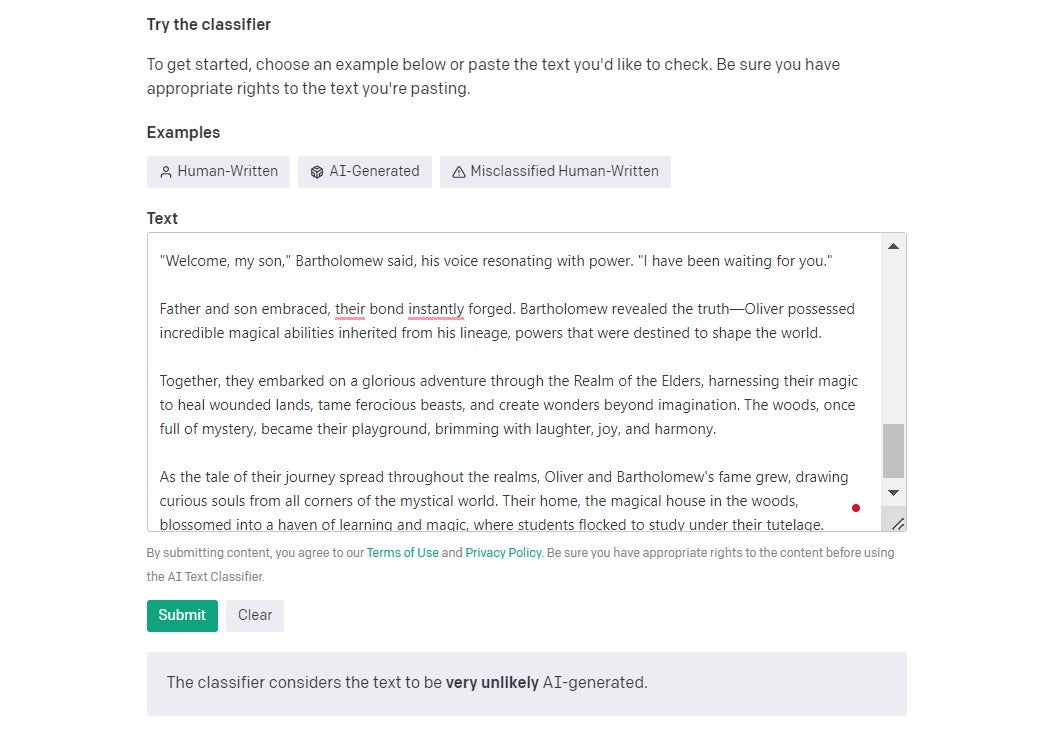

Classificatore di testo OpenAI

Non volendo essere manovrati dai controllori di contenuti AI di terze parti, gli stessi OpenAI hanno rilasciato un software progettato per classificare se il contenuto è stato generato dall'IA.

Il documento o il testo inserito deve superare i 1000 caratteri di lunghezza. Una volta inserito il documento, OpenAI ti dirà quasi istantaneamente quanto è probabile che sia stato generato da esseri umani.

Ho pubblicato un estratto da un recente articolo di Tech.co, scritto da uno scrittore - che OpenAI ha giustamente stabilito che era "molto improbabile" che fosse stato scritto da AI.

Nello stesso articolo di TechCrunch a cui abbiamo fatto riferimento in precedenza, la pubblicazione afferma che OpenAI stima che il suo classificatore di testo perda il 74% dei contenuti generati dall'intelligenza artificiale. È un bene che siano così onesti anche su questo: quando abbiamo condotto un secondo test, utilizzando un breve racconto generato da ChatGPT, non ha rilevato il fatto che fosse generato dall'intelligenza artificiale:

Il rilevamento dei contenuti AI funziona davvero?

Nessuno strumento di rilevamento dei contenuti AI è affidabile al 100%: i nostri test lo dimostrano in modo abbastanza clamoroso.

Tuttavia, nessuno degli strumenti di cui abbiamo discusso oggi afferma di essere accurato al 100% e pochissimi affermano di essere assolutamente privi di falsi positivi. Altri, come GPTZero, pubblicano disclaimer sul prendere i loro risultati come vangelo.

Un certo numero di studenti universitari accusati di utilizzare l'intelligenza artificiale per produrre saggi sono già stati costretti a dimostrare che il loro lavoro era originale.

In Texas, a marzo, un professore ha falsamente bocciato un'intera classe di studenti dopo averli accusati ingiustamente di utilizzare ChatGPT per scrivere saggi. C'è anche una raccolta di rapporti – e studi come quello condotto da Originality.ai – che suggeriscono che anche i controllori di plagio più capaci non sono così accurati come affermano.

Anche il rilevatore di contenuto AI di Turnitin non è infallibile. Nel recente test relativamente piccolo condotto dal Washington Post di cui abbiamo discusso in precedenza, la sua accuratezza è stata di gran lunga inferiore al 98% che affermano di essere in grado di produrre.

Originality.ai, d'altra parte, è sicuramente uno dei più robusti disponibili e anche la sua tecnologia di rilevamento non è sempre corretta.

Inoltre, se esistono falsi positivi a qualsiasi titolo, gli studenti avranno sempre spazio per affermare che il loro lavoro è originale ed è stato semplicemente identificato erroneamente.

Sta usando ChatGPT o Bard Plagiarism?

È discutibile se ChatGPT sia in realtà un plagio. Oxford Languages definisce il plagio come "la pratica di prendere il lavoro o le idee di qualcun altro e farle passare per proprie".

ChatGPT non è una persona e non riproduce semplicemente il lavoro e le idee di altre persone quando genera una risposta. Quindi, secondo la definizione del dizionario, non è vero e proprio plagio.

Anche se lo facesse, se fossi onesto sulla sua provenienza (ad esempio ChatGPT), probabilmente, non sarebbe comunque un plagio.

Tuttavia, alcune scuole e università hanno regole di plagio di vasta portata e considerano l'utilizzo di chatbot per scrivere saggi in quanto tali. Uno studente della Furman University ha fallito la sua laurea in filosofia a dicembre dopo aver usato ChatGPT per scrivere il suo saggio. In un altro caso, un professore della Northern Michigan University ha riferito di aver sorpreso due studenti a usare il chatbot per scrivere saggi per la loro classe.

L'uso di ChatGPT per generare saggi e poi spacciarli per il proprio lavoro è forse meglio descritto come "barare" ed è decisamente "disonesto".

Lo scopo di scrivere un saggio è mostrare che sei in grado di produrre pensieri originali, comprendere concetti rilevanti, considerare attentamente argomenti contrastanti, presentare informazioni in modo chiaro e citare le tue fonti.

C'è pochissima differenza tra l'utilizzo di ChatGPT in questo modo e il pagamento di un altro studente per scrivere il tuo saggio per te, il che è, ovviamente, barare.

Per quanto riguarda Bard di Google, la risposta è un po' più complicata. La stessa linea di logica usata sopra si applica a Bard così come a ChatGPT, ma Bard è stato rovinato da accuse di plagio e ha citato erroneamente cose che estrae da Internet in un modo che ChatGPT non ha. Quindi, l'uso di Bard potrebbe portarti a plagiare inavvertitamente altre fonti ( più su questo sotto ).

I pericoli di barare con ChatGPT

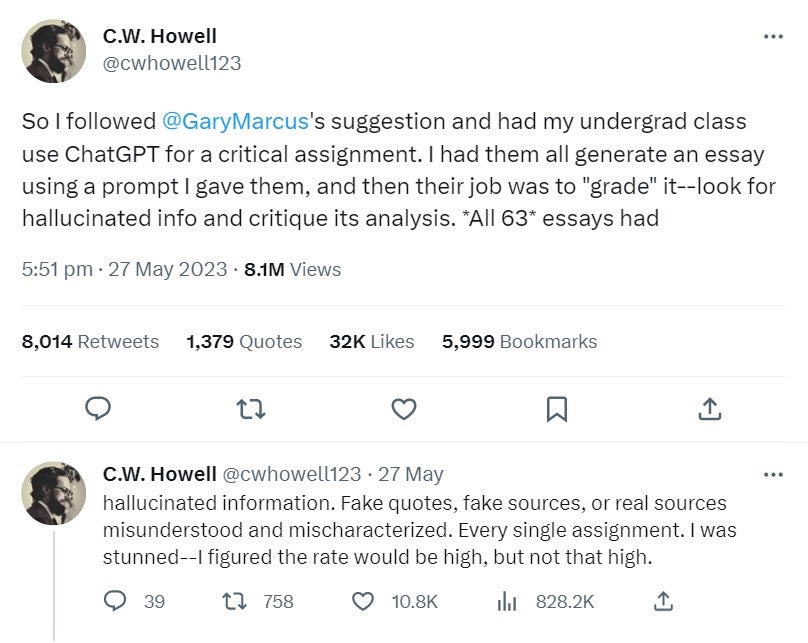

Christopher Howell, Adjunct Assistant Professor presso la Elon University, ha recentemente chiesto a un gruppo di studenti di utilizzare ChatGPT per un compito critico e quindi valutare i saggi che ha prodotto per loro.

Ha riferito in un lungo thread su Twitter (la cui prima parte è nella foto sotto) che tutti i 63 studenti che hanno partecipato hanno trovato una qualche forma di "allucinazione" - comprese citazioni false e fonti false e male interpretate - nei loro compiti.

ChatGPT plagia nelle sue risposte?

No: ChatGPT non estrae informazioni da altre fonti e semplicemente le mette insieme, frase per frase. Questo è un malinteso su come funzionano i Transformer generativi pre-addestrati.

ChatGPT - o più precisamente il modello linguistico GPT - viene addestrato su un enorme set di dati di documenti, materiale del sito Web e altro testo.

Utilizza algoritmi per trovare sequenze e modelli linguistici all'interno dei suoi set di dati. È quindi possibile generare paragrafi, frasi e parole in base a ciò che il modello linguistico ha appreso sul linguaggio dalle sequenze in questi set di dati.

Questo è il motivo per cui se poni a ChatGPT la stessa domanda contemporaneamente da due dispositivi diversi, le sue risposte sono generalmente estremamente simili, ma ci saranno comunque variazioni e, a volte, offre risposte completamente diverse.

Bard plagia nelle sue risposte?

Il più grande rivale di ChatGPT, Bard di Google, ha avuto molti più problemi con il plagio dei contenuti dal suo lancio rispetto alla sua controparte più popolare. Il sito Web di tecnologia Tom's Hardware ha scoperto che Bard aveva plagiato uno dei suoi articoli e poi si è scusato quando uno del suo staff lo ha chiamato.

Più recentemente, nel maggio 2023, PlagiarismCheck ha dichiarato a Yahoo News di aver generato 35 parti di testo con Bard e di averne trovato plagiato oltre il 5% in 25 di esse semplicemente parafrasando contenuti esistenti già pubblicati su Internet.

Una grande differenza tra Bard e ChatGPT che può forse spiegare questo è che Bard può cercare risposte su Internet, motivo per cui tende a gestire meglio le domande relative agli eventi dopo il 2021, con cui ChatGPT ha difficoltà. Tuttavia, questo sembra anche significare che estrae i dati dalle fonti in modo meno originale e cita le sue fonti più spesso.

Questi esempi potrebbero essere stati dei punti deboli, ma è bene conoscere i rischi se stai usando Bard per un lavoro importante.

Altri strumenti di intelligenza artificiale plagiano?

Sfortunatamente sì, e alcune aziende si sono già messe in imbarazzo utilizzando strumenti di intelligenza artificiale che hanno plagiato i contenuti. Ad esempio, è stato scoperto che CNET, uno dei siti tecnologici più grandi del mondo, utilizzava uno strumento di intelligenza artificiale per generare articoli e non era affatto trasparente al riguardo. Si è scoperto che circa la metà degli articoli pubblicati da CNET utilizzando l'intelligenza artificiale includeva alcune informazioni errate.

A peggiorare le cose, Futurism, che ha avviato un'indagine sul plagio dell'IA di CNET, ha affermato che "il comportamento scorretto del bot varia dalla copia letterale a modifiche moderate a riformulazioni significative, il tutto senza accreditare adeguatamente l'originale".

Gli strumenti di intelligenza artificiale che non generano contenuti unici e originali, siano essi arte o testo, hanno il potenziale per plagiare contenuti che sono già stati pubblicati su Internet. È importante capire esattamente come funziona il modello linguistico utilizzato dal tuo strumento di intelligenza artificiale e avere anche una stretta supervisione sul contenuto che sta producendo, altrimenti potresti finire nella stessa posizione di CNET.

Dovresti usare ChatGPT per saggi o lavoro?

Utilizzo di ChatGPT per i saggi

Il fatto che ChatGPT non estragga semplicemente risposte da altre fonti e unisca insieme frasi significa che le aziende sono state in grado di utilizzare ChatGPT per una varietà di attività diverse senza preoccuparsi dei problemi di copyright.

Ma la sua meccanica interna significa anche che spesso ha allucinazioni e commette errori. È tutt'altro che perfetto - e sebbene sia allettante convincere ChatGPT a scrivere il tuo saggio per l'università o il college, ti sconsigliamo.

Le linee guida specifiche per l'invio di ogni istituto scolastico saranno leggermente diverse, ovviamente, ma è molto probabile che sia già considerato "imbroglio" o plagio "nella tua università o scuola. Inoltre, indipendentemente da quanto siano accurati, le istituzioni educative utilizzano rilevatori di contenuti AI, che miglioreranno nel tempo.

Utilizzo di ChatGPT al lavoro

Naturalmente, molte persone utilizzano già ChatGPT al lavoro : si sta rivelando utile in una vasta gamma di settori e aiuta i lavoratori in tutti i tipi di ruoli a risparmiare tempo prezioso nelle attività quotidiane.

Tuttavia, se utilizzi ChatGPT al lavoro, ti consigliamo di essere aperto con il tuo manager o supervisore al riguardo, soprattutto se lo utilizzi per attività importanti come la scrittura di rapporti per stakeholder esterni.

Consigliamo inoltre vivamente di modificare pesantemente e di rivedere attentamente tutto il lavoro che stai utilizzando ChatGPT, Bard o qualsiasi altro strumento di intelligenza artificiale per generare. Non è saggio inserire informazioni personali o aziendali sensibili in qualsiasi chatbot, poiché non ci sono molte informazioni pubbliche su dove sono archiviate queste chat o sull'infrastruttura di sicurezza di OpenAI.

Utilizzo di altri strumenti di intelligenza artificiale per saggi o lavoro

Ovviamente, Bard e ChatGPT non sono gli unici chatbot AI disponibili. Tuttavia, saremmo riluttanti a fornire il nostro supporto a strumenti di intelligenza artificiale più piccoli che non sono supportati da potenti modelli linguistici. Non avranno le stesse risorse ed è improbabile che tu li trovi utili se fai esperimenti con il loro utilizzo per lavoro.

Tuttavia, si applicano ancora le stesse regole: sii aperto con il tuo manager e ottieni l'approvazione per utilizzarli, non inserire dati aziendali sensibili e rivedi sempre le risposte che ti vengono fornite.