ChatGPT と AI 盗作を検出する方法

公開: 2023-06-22ChatGPT は、地球上のほぼすべての主題について、一貫したよく書かれたコピーを数秒で生成できる能力により、学術界とビジネス界をひっくり返しました。

その驚くべき能力により、あらゆる教育レベルの学生が、 Bardなどのライバルだけでなく、チャットボットを利用して、他の方法では完了するまでに何時間もかかる複雑なエッセイを書くようになりました。

これにより、「ChatGPT 盗作」と呼ばれることが多い新しい現象に関する世界的な議論が始まりました。 このガイドでは、ChatGPT の盗作を検出するために企業や教育機関が使用しているツール、ChatGPT を使用した不正行為の危険性、および ChatGPT の使用がそもそも盗作とみなされるかどうかについて説明します。

- ChatGPT の盗作を検出する方法

- 最も人気のある AI および ChatGPT 盗作チェッカー

- AI コンテンツ チェッカーは実際に機能しますか?

- ChatGPT または Bard の使用は実際に盗作ですか?

- ChatGPT を使用した不正行為の危険性

- ChatGPT は盗用しますか?

- 吟遊詩人は盗作をしますか?

- 他の AI ツールも盗用しますか?

- エッセイや仕事に ChatGPT を使用する必要がありますか?

ChatGPT の盗作を検出する方法

ChatGPT の盗作を検出するには、AI コンテンツ チェッカーが必要です。 AI コンテンツ チェッカーはテキストの本文をスキャンして、そのテキストが ChatGPT や Bard などのチャットボットによって作成されたのか、それとも人間によって作成されたのかを判断します。 ただし、後で説明するように、これらのツールは信頼性からは程遠いです。

コードに関しては、盗作を検出するのが少し難しくなりますが、ChatGPT でも同様に生成できます。 コード用の AI 検出ツールのエコシステムは、コンテンツ用とまったく同じではありません。

ただし、たとえば、あなたが大学の環境にいて、自分の技術レベルをはるかに超えたコードを提出している場合、教授や講師は、あなたが ChatGPT に助けを求めたのではないかと非常に合理的な疑いを持つかもしれません。

最も人気のある AI および ChatGPT 盗作チェッカー ツールのレビュー

2022 年 11 月に ChatGPT が発表されて以来、多くの企業や教育機関が、人工的に生成されたコンテンツと人間が作成したコンテンツを区別できると主張する AI コンテンツ チェッカーを開発してきました。 現在、多くの企業が Google のチャットボット Bard も使用していますが、これは別の言語モデルを使用しています。

しかし、最も評判の高い AI コンテンツ検出ツールであっても、その精度については激しく論争があり、AI コンテンツを使用したとして不当に告発された学生と教育との間の訴訟がすでに現実化しています。

結論は次のとおりです。この分野で 100% 正確なツールはありませんが、一部のツールは他のツールよりもはるかに優れています。

GPTゼロ

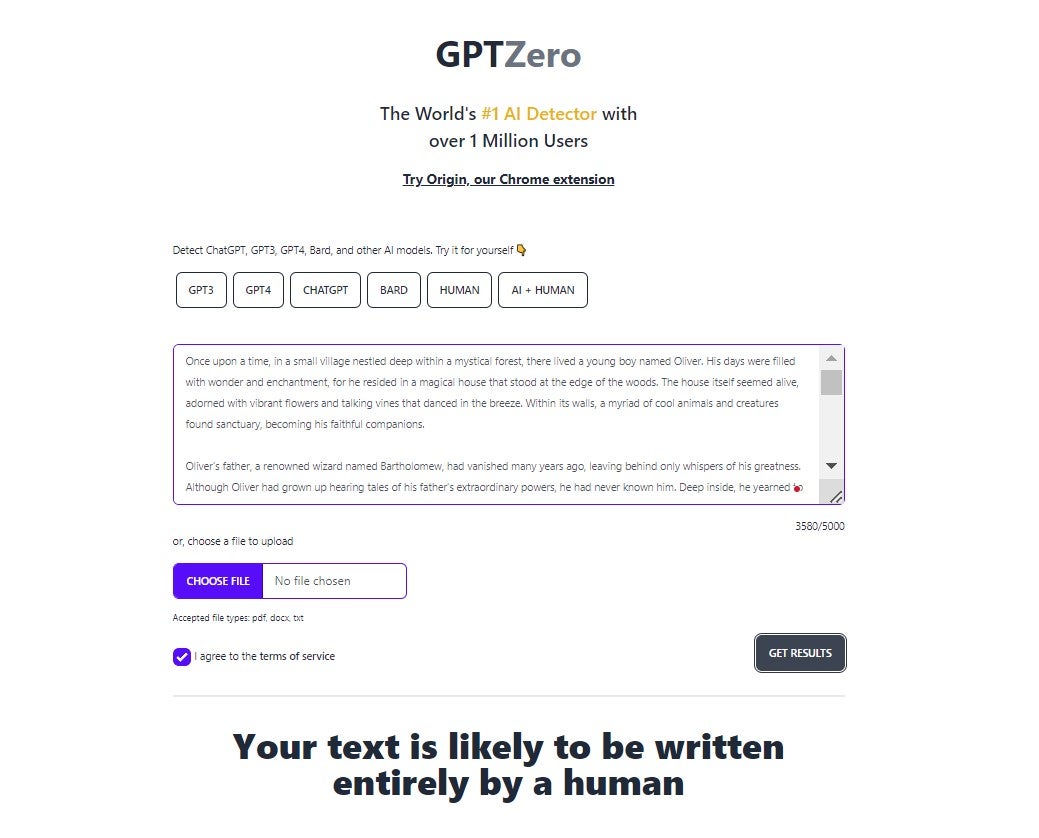

GPTZero は人気のある無料の AI コンテンツ検出ツールで、「複数の独立した情報源によって検証され、あらゆるユースケースにわたって最も正確な AI 検出器」であると主張しています。

しかし、4月に遡ると、カリフォルニア大学デービス校の歴史学生は、GPTZero(教授が使用しているAIコンテンツ検出ツール)が彼の論文にAI生成とラベル付けしたのは誤りであることを証明した。

ChatGPT に短編小説を書くように依頼して、GPTZero をテストしました。 残念ながら、GPTZero はコンテンツが AI ツールによって書かれたものであるかどうかを判断できませんでした。

オリジナリティ.ai

Originality.ai は、現在利用可能な AI コンテンツ検出ツールの中で最も正確なツールの 1 つであることは確かです。

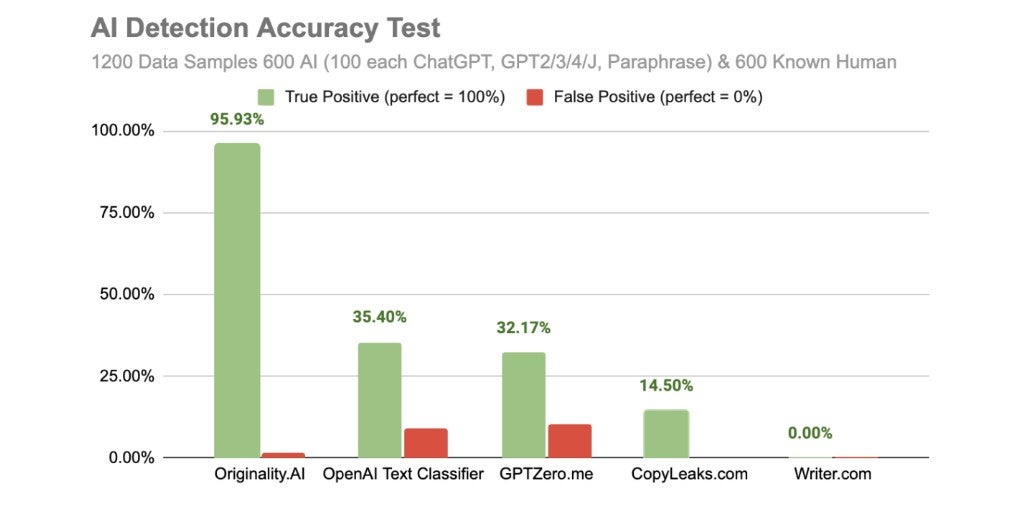

同社は今年 4 月に AI コンテンツ検出ツールに関する独自の調査を実施し、その中で人工的に生成された 600 個のテキスト ブロックと人間が生成した 600 個のテキスト ブロックを独自のコンテンツ検出システムや、同様の機能を主張する他の一般的なツールに供給しました。 。

以下の結果からわかるように、Originality.ai はテストに含まれたすべてのツールよりも優れたパフォーマンスを示しました。

Originality.ai の唯一の欠点は、無料プランがなく、この記事に含まれている他のアプリのように無料でテストすることさえできないことです。 2,000 クレジットで 20 ドルかかり、200,000 単語をチェックできるようになります。

コピーリークス AI コンテンツ検出器

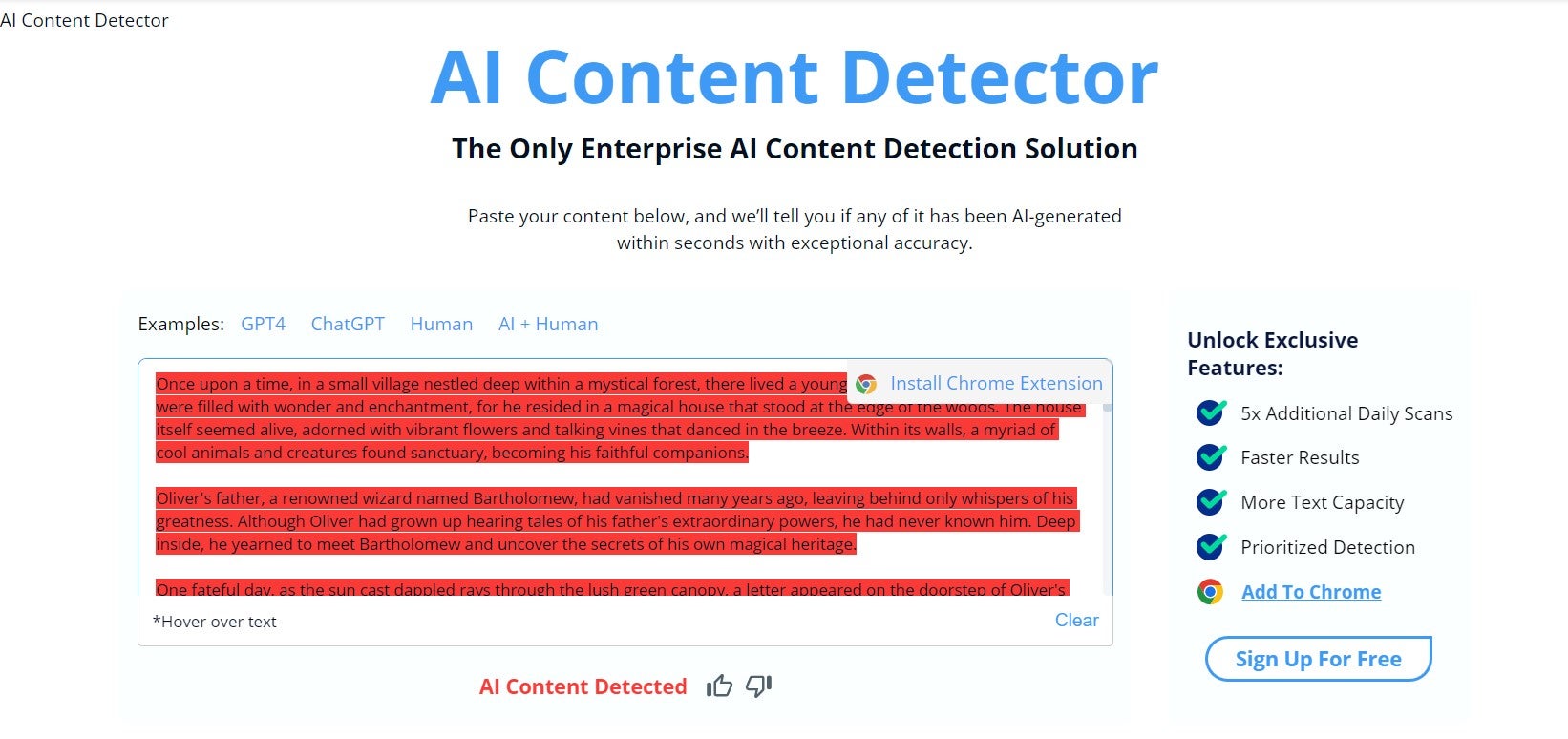

Copyleaks は無料で使用できる AI コンテンツ検出器で、人間が作成したコピーと AI が作成したコピーを 99.12% の精度で区別できると主張しています。

Copyleaks は、文書や文章の他の部分が人間によって書かれたように見える場合でも、その文書や文章の特定の部分が AI によって書かれたかどうかも教えてくれます。

Copyleaks は、「ChatGPT、GPT-4、GPT-3、Jasper など」によって作成された AI 生成コンテンツを検出できると述べ、さらに「新しいモデルが登場すれば、自動的に検出できるようになる」とも主張しています。

CopyLeaks 1,200 クレジットで月額 8.33 ドル (1 クレジットあたり 250 ワードのコピー)。

しかし、2023年2月にTechCrunchが実施したテストでは、コピーリークスは、ニュース記事、百科事典の項目、カバーレターなど、AIが生成したさまざまなタイプのコピーを人間が生成したものとして誤って分類した。

さらに、上で参照した Originality.ai の調査では、14.50% のケースでのみ正確であることが判明しました。これは、CopyLeaks が主張する 99.12% の精度とは程遠いものです。

ただし、テストしてみると、入力したテキストが ChatGPT によって生成されたものであることが認識できたようです。

Turnitin AI 検出器

Turnitin は米国に本拠を置く盗作検出会社で、さまざまな大学が学生の研究成果をスキャンするために導入しています。 Turnitin はあらゆる種類の盗作を検出するように設計されているが、4 月にはしばらくの間 AI に焦点を当てたチームに投資していることを明らかにした。

Turnitin は、「管理されたラボ環境において、98% の信頼性と 1% 未満の誤検知率で AI 書き込みの存在を検出できる」と述べています。

ただし同社は、コンテンツにAI生成のフラグを立てた場合、これは「告発ではなく指摘」として扱うべきだとも述べている。 Turnitin の AI 検出器の真の精度については、ワシントン ポストや他の情報源によって異議が唱えられています。

Turnitin の AI コンテンツ検出ソフトウェアは現在無料ですが、同社は Web サイトの FAQ で、2024 年 1 月に有料ライセンス プログラムに移行する予定であると述べています (価格は明記されていません)。

OpenAI テキスト分類子

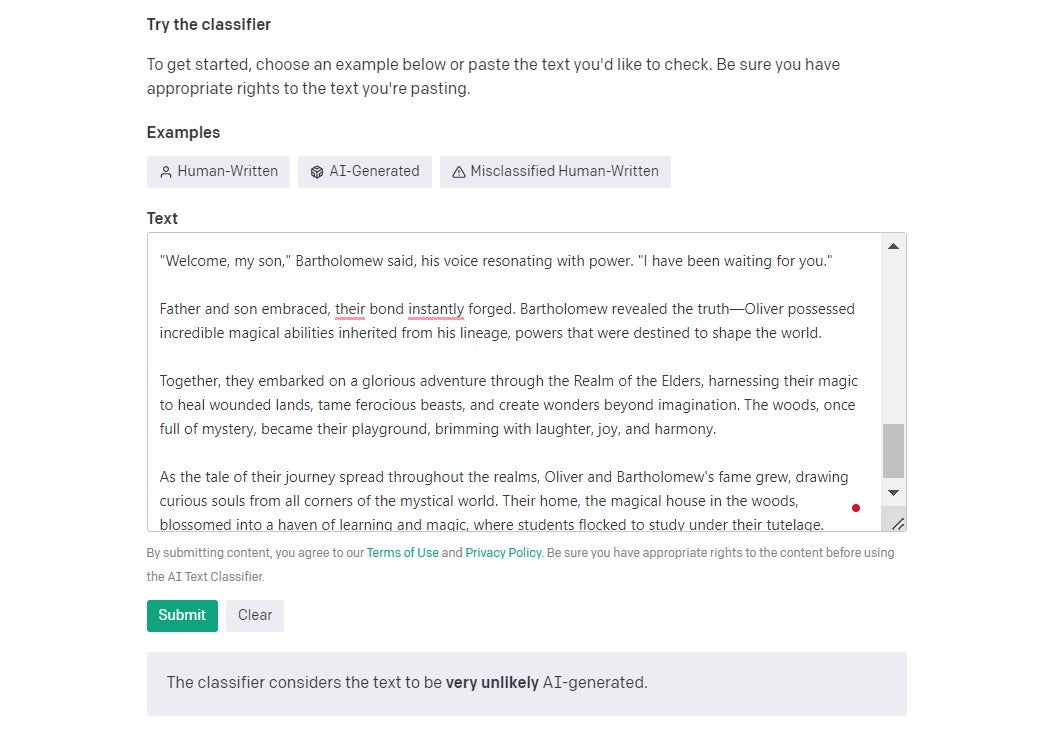

サードパーティの AI コンテンツ チェッカーに出し抜かれることを望まない OpenAI は、コンテンツが AI によって生成されたかどうかを分類するように設計されたソフトウェアをリリースしました。

入力する文書またはテキストの長さは 1000 文字を超える必要があります。 文書を入力すると、OpenAI はその文書が人間によって生成されたものであると考える可能性をほぼ瞬時に示します。

私は、ライターによって書かれた最近の Tech.co 記事からの抜粋を投稿しました。OpenAI は、この記事が AI によって書かれたものである可能性は「非常に低い」と正当に判断しました。

先ほど参照した TechCrunch の記事と同じ記事で、OpenAI はテキスト分類器が AI で生成されたコンテンツの 74% を見逃していると推定していると述べています。 彼らがこれについても正直であるのは良いことです。ChatGPT によって生成された短いストーリーを使用して 2 回目のテストを実施したとき、それが AI によって生成されたという事実は認識されませんでした。

AI コンテンツ検出は実際に機能しますか?

AI コンテンツ検出ツールは 100% 信頼できるものではありません。私たちのテストでは、それがかなりはっきりと証明されています。

ただし、今日説明したツールはどれも実際に 100% 正確であると主張するものはなく、誤検知が完全にないと主張するツールはほとんどありません。 GPTZero のような他の企業は、結果を福音として受け入れることについての免責事項を投稿しています。

人工知能を使ってエッセイを作成したとして告発された多くの大学生は、すでに自分たちの作品がオリジナルであることを証明するよう求められている。

テキサス州では3月、ある教授がChatGPTを使って小論文を書いていると不当に告発し、クラス全員を不合格にした。 また、最も有能な盗作チェッカーでさえ、彼らが主張するほど正確ではないことを示唆する一連のレポートや、Originality.ai によって実施された調査のようなものもあります。

Turnitin の AI コンテンツ検出器でさえ、絶対確実というわけではありません。 先ほど説明したワシントン・ポスト紙が最近行った比較的小規模なテストでは、その精度は彼らが達成できると主張する 98% には遠く及ばなかった。

一方、Originality.ai は確かに入手可能なものの中でより堅牢なものの 1 つであり、その検出テクノロジーさえ常に正しいとは限りません。

さらに、何らかの形で誤検知が存在する場合、学生が自分の作品がオリジナルであり、単に誤認されただけであると主張する余地が常に存在します。

ChatGPT または Bard の使用は盗作ですか?

ChatGPT が実際に盗作であるかどうかは議論の余地があります。 オックスフォード・ランゲージズは、盗作を「他人の作品やアイデアを盗用し、自分のもののように偽装する行為」と定義しています。

ChatGPT は人間ではありません。また、答えを生成するときに他の人の作業やアイデアを単に再現するわけでもありません。 したがって、辞書の定義によれば、これは完全な盗作ではありません。

たとえそれが行われていたとしても、それがどこから来たのか(つまり、ChatGPT)について正直であれば、おそらく、それはとにかく盗作ではないでしょう。

ただし、一部の学校や大学では、広範な盗作規則があり、チャットボットを使用してエッセイを書くことを検討しています。 ファーマン大学のある学生は、ChatGPT を使用してエッセイを書いた後、12 月に哲学の学位を取得できませんでした。 別のケースでは、ノーザンミシガン大学の教授が、クラスのエッセイを書くためにチャットボットを使用している2人の学生を捕まえたと報告しました。

ChatGPT を使用してエッセイを生成し、それを自分の作品として宣伝することは、おそらく「不正行為」と表現したほうが適切であり、間違いなく「不誠実」です。

エッセイを書くことの要点は、独自の考えを生み出し、関連する概念を理解し、矛盾する議論を注意深く検討し、情報を明確に提示し、出典を引用する能力があることを示すことです。

この方法で ChatGPT を使用することと、別の学生にお金を払ってエッセイを書いてもらうことの間には、ほとんど違いはありません。もちろん、これは不正行為です。

Google の Bard に関しては、答えはもう少し複雑です。 上記で使用したのと同じロジックが ChatGPT と同様に Bard にも当てはまりますが、Bard は盗作の告発と、ChatGPT とは異なる方法でインターネットから取得したものを誤って引用したことによって傷ついています。 そのため、Bard を使用すると、うっかり他のソースを盗用してしまう可能性があります (これについては後述します)。

ChatGPT は応答を盗用しますか?

いいえ – ChatGPT は他のソースから情報を引き出して、単に文ごとに情報を詰め込んでいるわけではありません。 これは、Generative Pre-trained Transformers がどのように機能するかについての誤解です。

ChatGPT (より正確には GPT 言語モデル) は、ドキュメント、Web サイトの資料、その他のテキストの巨大なデータセットでトレーニングされます。

アルゴリズムを使用して、データセット内の言語シーケンスとパターンを見つけます。 言語モデルがこれらのデータセット内のシーケンスから言語について学習した内容に基づいて、段落、文、単語を生成できます。

2 つの異なるデバイスから同時に ChatGPT に同じ質問をすると、その答えは通常非常に似ていますが、それでもばらつきがあり、場合によってはまったく異なる答えが返されるのはこのためです。

Bard は応答を盗用しますか?

ChatGPT の最大のライバルである Google の Bard は、サービス開始以来、より人気のある同等のサービスよりもはるかに多くのコンテンツ盗用の問題を抱えています。 テクノロジー関連のウェブサイト「Tom's Hardware」は、Bardが記事の1つを盗用していたことを発見し、スタッフの1人がそれを指摘すると謝罪した。

最近では、2023 年 5 月に、PlagiarismCheck が Yahoo News に語ったところによると、Bard を使って 35 個のテキストを生成し、そのうち 25 個のテキストの 5% 以上が、インターネット上で既に公開されている既存のコンテンツを言い換えただけで盗用されていたことが判明しました。

おそらくこれを説明できる Bard と ChatGPT の大きな違いの 1 つは、Bard はインターネットで回答を検索できることです。そのため、ChatGPT が苦手とする 2021 年以降のイベントに関連する質問をより適切に処理する傾向があります。 ただし、これは、あまり独創的ではない方法でソースからデータを取得し、そのソースをより頻繁に引用することも意味しているようです。

これらの例は単なるブリップかもしれませんが、重要な仕事に Bard を使用する場合は、そのリスクを知っておくと良いでしょう。

他の AI ツールも盗用しますか?

残念ながら、そのとおりです。一部の企業は、コンテンツを盗用した AI ツールを使用して、すでに恥をかかせています。 たとえば、世界最大のテクノロジー サイトの 1 つである CNET は、記事の生成に AI ツールを使用していることが判明しましたが、それについてはまったく透明ではありませんでした。 米CNETがAIを活用して公開した記事の約半数に、誤った情報が含まれていることが判明した。

さらに悪いことに、CNETのAI盗作に関する調査を開始したFuturismは、「ボットの不正行為は、原文を適切にクレジットすることなく、逐語的なコピーから中程度の編集、大幅な言い換えに至るまで多岐にわたる」と述べた。

アートであれテキストであれ、独自のオリジナル コンテンツを生成しない AI ツールは、すでにインターネット上に公開されているコンテンツを盗用する可能性があります。 AI ツールが使用している言語モデルがどのように機能するかを正確に理解し、生成するコンテンツを厳密に監視することが重要です。そうしないと、CNET と同じ立場になる可能性があります。

ChatGPT はエッセイや仕事に使用する必要がありますか?

ChatGPT をエッセイに使用する

ChatGPT が単に他のソースから回答を引き出して文章をマッシュアップするだけではないという事実は、企業が著作権の問題を心配することなく、ChatGPT をさまざまなタスクに使用できることを意味します。

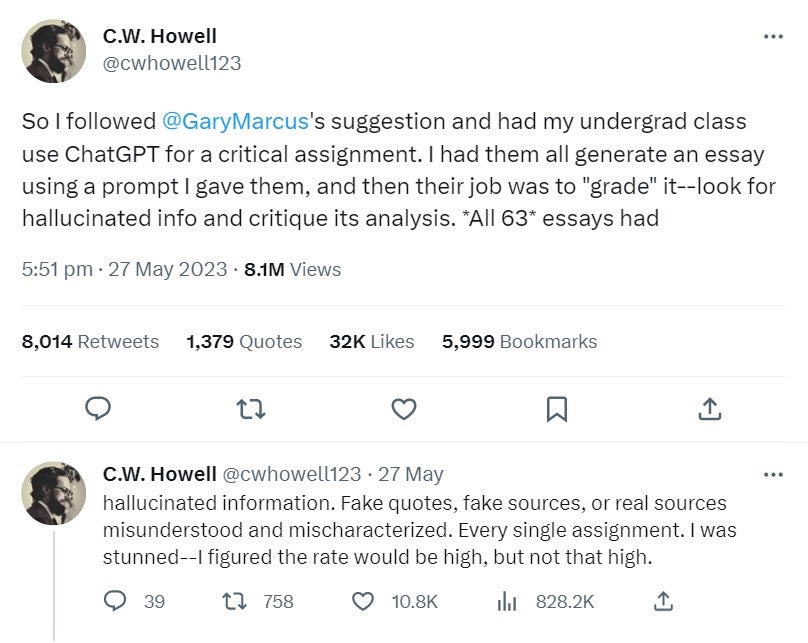

しかし、その内部機構により、幻覚が見られたり、間違いを犯したりすることがよくあります。 これは完璧とは程遠く、ChatGPT に大学のエッセイを書いてもらいたくなるかもしれませんが、それはお勧めしません。

もちろん、各教育機関の具体的な提出ガイドラインは若干異なりますが、大学や学校ではすでに「不正行為」または「盗作」とみなされている可能性が非常に高いです。 さらに、精度に関係なく、教育機関は AI コンテンツ検出器を使用しており、時間の経過とともに改善されます。

職場での ChatGPT の使用

もちろん、多くの人がすでに職場で ChatGPT を使用しています。ChatGPT は幅広い業界で有用であることが証明されており、あらゆる種類の役割の従業員が日常業務で貴重な時間を節約するのに役立ちます。

ただし、職場で ChatGPT を使用している場合、特に外部関係者向けのレポート作成などの重要な活動に ChatGPT を使用している場合は、そのことについてマネージャーまたは監督者にオープンにすることをお勧めします。

また、ChatGPT、Bard、またはその他の AI ツールを使用して生成しているすべての作業を大幅に編集し、綿密にレビューすることを強くお勧めします。 これらのチャットの保存場所や OpenAI のセキュリティ インフラストラクチャに関する公開情報はあまりないため、機密の個人情報や企業情報をチャットボットに含めることは賢明ではありません。

エッセイや仕事に他の AI ツールを使用する

もちろん、Bard と ChatGPT だけが AI チャットボットではありません。 ただし、強力な言語モデルに支えられていない小規模な AI ツールのサポートを放棄することには躊躇します。 これらはリソースがそれほど豊富ではないため、仕事で使用してみてもそれほど有用であるとは考えられません。

ただし、同じルールが依然として適用されます。マネージャーに対してオープンに接し、使用について承認を得てください。会社の機密データは入力せず、与えられた回答を常に確認してください。