軍事技術における自律戦争の台頭

公開: 2023-07-06軍事技術は急速に進歩しており、それに伴い自律戦争が台頭しており、これには深い意味と倫理的考慮が伴います。 この記事では、自律型戦争の多面的な状況を掘り下げ、この最先端テクノロジーが戦場に与える影響を探ります。

人工知能と自律システムの統合がますます普及するにつれて、軍事技術におけるこのパラダイムシフトに伴う利点、リスク、倫理的側面を検討することが重要です。

これらの複雑な問題に取り組むことで、軍事技術の分野で自律戦争の台頭によって生じる課題と責任について、より深い理解を促進することを目指しています。

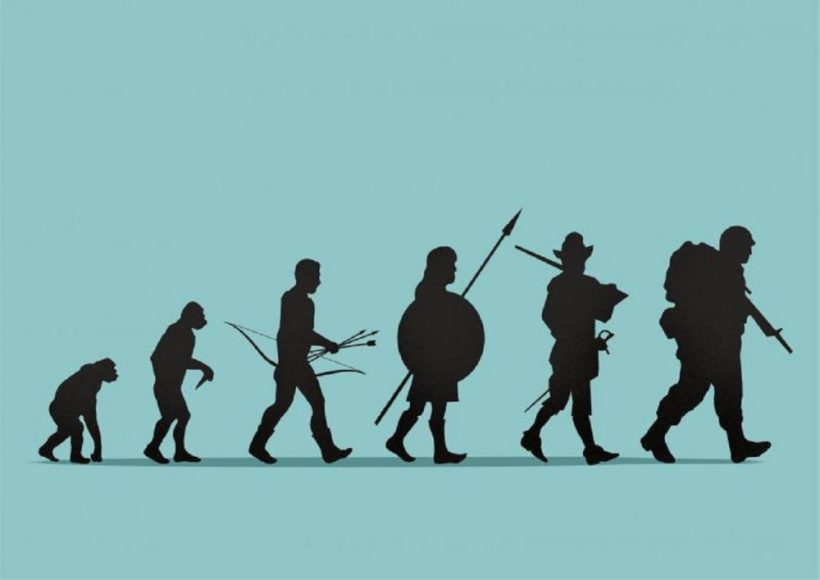

戦争の進化:

軍事技術は歴史を通じて目覚ましい進化を遂げ、戦争の性質を根本的に作り変えてきました。 古代から現代に至るまで、軍事技術の進歩は紛争の結果を形作る上で重要な役割を果たしてきました。 自律システムの統合は、この進行中の進化における重要なマイルストーンとなり、戦争の戦い方に革命をもたらします。

さらに、軍事技術における自律システムの導入により、戦争の新時代が到来しました。 これらのシステムは高度な自律性で動作し、戦闘シナリオにおいて人間が直接介入する必要性を減らします。 高度なアルゴリズムと機械学習によりリアルタイムの意思決定が可能になり、データ分析を通じて軍事能力が大幅に強化されます。

さらに、自律技術は海戦にもその範囲を広げています。 無人水上艦艇や水中ドローンは、地雷の探知と除去、情報収集、さらには攻撃作戦など、さまざまな目的に配備されています。 これらの進歩により海軍の能力が強化され、海軍がより効率的かつ効果的に活動できるようになります。

無人航空機 (UAV) は軍事作戦の基礎となっており、監視、偵察、精密攻撃などのさまざまな機能を提供します。 高度なセンサーとナビゲーション システムを備えた自律型船舶は、海上監視と防衛能力を強化します。 自律運用可能な水中ドローンは貴重な情報を収集し、海軍の水中領域の認識に貢献します。

しかし、自治戦争の台頭により、倫理的考慮が最前線に立つようになりました。 自動化のレベルが高まるにつれて、意思決定の権限は人間のオペレーターからアルゴリズムや人工知能に移行します。 このことは、説明責任、予期せぬ結果の可能性、生死にかかわる決定を機械に委任することの倫理的影響についての疑問を引き起こします。

自律型戦争: ゲームチェンジャー:

自律戦争は戦争技術のパラダイムシフトを表しており、新しい時代の戦闘能力と戦術を導入します。 自律システムの統合により、戦争の様相は変化し、前例のない利点と課題がもたらされています。

第一に、自律戦争は軍事的精度と精度を異常な程度まで高めます。 高度なセンサーと目標認識システムを備えた無人航空機 (UAV) は、比類のない精度で敵目標を特定し、攻撃することができます。 無人地上車両 (UGV) などの地上自律システムは、兵站、監視、さらには直接戦闘を支援し、人間の兵士が直面するリスクを軽減します。

さらに、自律システムの利用により、戦場での状況認識が向上します。 自律型プラットフォームは、リアルタイムのデータ収集と分析を通じて、軍司令官に意思決定のための重要な情報を提供します。 この強化された状況認識により、動的で複雑な戦闘状況への迅速かつ効果的な対応が可能になります。

さらに、自律戦闘により作戦効率が大幅に向上します。 これらのシステムは疲労することなく継続的に動作できるため、24 時間の監視、偵察、交戦機能が可能になります。 人間の介入が減り、自動化が進むことで意思決定と対応時間が短縮され、軍事作戦の有効性が高まります。

しかし、自治戦争の台頭は倫理的な懸念とリスクも引き起こします。 人間の判断や意思決定プロセスへの依存が減ると、意図しない結果が生じる可能性があります。 責任の問題と自律システムにおけるエラーの可能性は、武力紛争における自律システムの使用を管理するための堅牢な倫理ガイドラインと法的枠組みを確立することの重要性を浮き彫りにしています。

倫理的な懸念とリスク:

自律システムを軍事技術に統合すると、重大な倫理的懸念とリスクが生じ、慎重に対処する必要があります。 これらの進歩は否定できない利点をもたらしますが、同時に批判的な検討を必要とする課題ももたらします。

まず、倫理上の大きな懸念の 1 つは、関与プロセスにおける人間の判断と意思決定の役割の減少を中心に展開しています。 自律システムはアルゴリズムと人工知能に依存しているため、説明責任と責任について疑問が生じます。 人間の介入がないと、意思決定プロセスにおいて意図しない結果やエラーが発生する可能性があります。

さらに、軍事作戦における自律システムの使用は、道徳的な影響と非人間化に関する懸念を引き起こします。 重要なタスクや決定を機械に委任すると、人間が戦争の結果から遠ざかってしまうリスクがあります。 この孤立感は軍人や社会全体の心理的健康に影響を与える可能性があり、伝統的に武力紛争に関連付けられてきた責任感や共感力を麻痺させる可能性があります。

さらに、軍事技術の急速な進歩は、自律システムの潜在的な誤用または悪用に関する懸念をもたらします。 悪意のある攻撃者は、民間人を標的にしたり、サイバー攻撃を実行したりするなど、破壊的な目的で自律型テクノロジーの脆弱性を悪用する可能性があります。 これは、自律機能の悪用を防ぐための厳格な保護措置、安全な設計原則、および包括的なリスク評価の重要性を強調しています。

しかし、自律戦争における倫理的懸念に対処するには、包括的なアプローチが必要です。 技術革新と倫理的配慮の間で適切なバランスをとることが不可欠です。 自律システムの開発と展開は法的および道徳的枠組みを遵守し、国際人道法、比例性、戦闘員と非戦闘員の区別の順守を確保する必要があります。

人道的および民間への影響:

自律型戦闘技術の軍事への統合は、人道的および民間への影響に関して重大な懸念を引き起こします。 自律システムは精度と効率の点で利点をもたらしますが、非戦闘員や人道的活動に影響を与える可能性のあるリスクももたらします。

まず、民間人の犠牲者が増加する可能性について懸念が高まっている。 ターゲット認識およびエンゲージメント機能の進歩にもかかわらず、自律システムには依然として誤認またはエラーのリスクが存在します。 これらの誤りは、無実の民間人に意図しない危害をもたらし、武力紛争における区別と比例の原則を損なう可能性があります。

さらに、自律システムの展開は人道活動や援助の提供に影響を与える可能性があります。 戦場に無人プラットフォームが存在すると、影響を受けた住民を支援する取り組みが複雑になる可能性があります。 人道支援団体や援助従事者は、自律システムが動作する環境で困難に直面する可能性があり、困っている人たちに手を差し伸べて支援する能力が妨げられる可能性があります。

さらに、自律戦闘技術は、民間人への危害に対する道徳的責任と説明責任について疑問を引き起こします。 意思決定における人間のオペレーターの役割が減少すると、人道法違反の可能性や民間人に引き起こされる危害について誰が責任を負うべきかという疑問が生じます。 これらの懸念に対処するには、責任と説明責任の明確な境界線を確立することが重要になります。

しかし、これらの懸念に対処し、自治戦争による人道的および民間への影響を軽減するための取り組みが行われています。 ジュネーブ条約などの国際的な法的枠組みは、武力紛争の実施と民間人の保護に関するガイドラインを提供します。 自律システムがこれらの原則に準拠し、人道的配慮を念頭に置いて設計されていることを確認することが不可欠です。

国際安全保障と軍備管理:

自律戦闘技術の出現は、国際的な安全保障と軍備管理の取り組みに独特の課題をもたらしています。 高度なシステムの急速な導入によりセキュリティ パラダイムが混乱し、安定性を維持し、意図しないエスカレーションを防ぐための対策が必要になります。

第一に、自律戦争技術の普及は、国家間の軍備競争の力学に対する懸念を引き起こします。 軍事力の強化を目指す国々は、自律システムの開発と展開の競争サイクルを引き起こす可能性があります。 これは軍拡競争を煽り、国家間の緊張を高める可能性があり、効果的な軍備管理措置が必要となる。

さらに、自律システムの独特の特性により、従来の軍備管理の枠組みが複雑になります。 これらのシステムは高度な自律性で動作することができるため、その活動を規制および監視することが困難になります。 人間による制御がないとコンプライアンスとエスカレーションの懸念が生じ、軍備管理のための効果的な検証方法が必要になります。

さらに、自律戦闘技術の世界的な普及により、安定性を維持し、これらのシステムの拡散を防ぐという課題が生じています。 国家間または非国家主体間のこのような高度な技術の移転は、地域および世界の安全保障に重大な影響を与える可能性があります。 自律戦争の制御不能な拡大によるリスクを軽減するには、国際協力と強力な軍備管理が不可欠です。

しかし、これらの課題に対処し、自律戦争の時代における国際安全保障を促進するための取り組みが行われています。 国家間の多国間対話と協力は、信頼醸成措置、透明性、情報共有を促進することができます。 自律システムに関する世界的な規範と合意を確立することで、自律システムの開発、展開が規制され、責任ある行動が促進され、意図しない結果が軽減されます。

人工知能 (AI) の役割:

人工知能 (AI) は、自律型戦争クラウド技術の開発と運用において極めて重要な役割を果たし、軍事能力の将来を形成します。 AI は自律システムの重要なコンポーネントとして、戦場での高度なデータ分析、意思決定、適応的な対応を可能にします。

まず、AI は自律システムのデータ処理能力を強化します。 AI アルゴリズムはリアルタイムでデータを分析し、パターンや異常を特定し、膨大な情報から貴重な洞察を抽出します。 これにより、軍隊は正確かつタイムリーな情報に基づいて情報に基づいた意思決定を行うことが可能となり、状況認識と作戦効率が向上します。

さらに、AI は自律システムに適応機能と学習機能を与えます。 機械学習アルゴリズムを通じて、これらのシステムは継続的に分析し、変化する環境や戦闘シナリオに適応できます。 過去の経験から学習してパフォーマンスを最適化し、時間の経過とともに精度と運用効率を向上させることができます。

さらに、AI により、自律システムが自律的にターゲットを特定し、関与することが可能になります。 高度な AI アルゴリズムは、センサー データを分析し、パターンを認識し、ターゲットの選択と関与に関して独立した決定を下すことができます。 これにより、リアルタイムの意思決定における人間のオペレーターへの依存が軽減され、応答時間が短縮され、軍事作戦の全体的な効率が向上します。

ただし、自律戦争における AI の役割には課題もあります。 AI アルゴリズムの複雑さと大規模なデータセットへの依存により、脆弱性と敵対的攻撃の可能性についての懸念が生じます。 AI システムをハッキング、改ざん、または悪意のある操作から保護することは、戦場での完全性と信頼性を確保するために重要になります。

政策と法的枠組み:

自律戦闘技術を軍事作戦に統合するには、包括的な政策と法的枠組みの開発が必要です。 これらの枠組みは、武力紛争において自律システムによってもたらされる特有の課題や倫理的考慮事項に対処する上で重要な役割を果たします。

まず、自律戦闘技術の開発、配備、使用を管理するための政策枠組みを確立する必要があります。 これらのポリシーは、責任ある倫理的な行動を保証するガイドラインと原則を概説する必要があります。 人間の監視、説明責任、透明性、民間人の生命とインフラの保護などの問題に取り組む必要がある。

さらに、国際人道法 (IHL) およびその他の関連条約の遵守を規制および強制するには、法的枠組みが不可欠です。 これらの枠組みは、武力紛争における自律システムに関連する法的地位と責任を明確にする必要があります。 また、責任、説明責任、IHL原則に基づく自律型兵器使用の合法性についても取り組むべきである。

さらに、統一的な政策や法的枠組みを確立するには国際協力が不可欠です。 武力紛争の世界的な性質を考慮すると、自律戦闘技術を規制するための調和のとれたアプローチが不可欠です。 州間の協力により、ベストプラクティスの共有が促進され、倫理基準に関する合意が促進され、効果的な執行メカニズムが可能になります。

しかし、政策および法的枠組みの開発と実施は課題に直面しています。 軍事技術の急速な進歩は、多くの場合、対応する規制の開発を上回ります。 技術革新のペースに追いつき、国際的な合意を促進し、効果的な執行メカニズムを確保するには、継続的な取り組みと適応性が必要です。

一般の認識と議論:

自律型戦闘技術の出現は、その影響と結果に関する国民の激しい認識と議論を引き起こしました。 防衛技術の使用が進化するにつれて、国民の懸念、期待、倫理的考慮事項を理解し、それに対処することが不可欠です。

第一に、国民の認識は、自治戦争をめぐる言説を形成する上で重要な役割を果たします。 自律機能を備えた先進技術の導入は、人々の間で魅力と不安の両方を呼び起こす可能性があります。 民間人への危害や人間の制御の侵食の可能性などの国民の懸念を理解し、それに対処することは、透明性と信頼を促進するために非常に重要です。

さらに、公開討論は、自治戦争に関連する政策、規制、倫理基準を形成する上で重要な役割を果たします。 軍事技術の影響、リスク、利点に関する多様な視点と議論は、情報に基づいた意思決定に貢献し、民主的な説明責任を促進します。 こうした議論に国民を参加させることは、国民の声が確実に聞き入れられ、検討されるようにするために極めて重要です。

さらに、自律型戦闘技術に対する一般の理解と認識は、社会の受け入れと支持に影響を与える可能性があります。 オープンで包括的なコミュニケーション チャネル、教育的取り組み、テクノロジーの謎を解く取り組みは、情報に基づいた公共の議論に貢献し、自律システムの機能と限界についてのよりバランスのとれた理解を促進することができます。

ただし、一般の人々の認識や議論は、誤解、偏見、誤った情報によって影響を受ける可能性もあります。 自律戦争技術の複雑さには、技術概念と国民の理解との間のギャップを埋めるための効果的なコミュニケーション戦略が必要です。 透明でアクセスしやすい情報は、誤解に対処する取り組みと並行して、より情報に基づいた建設的な公開討論を促進することができます。

結論:

結論として、軍事技術における自律戦争の台頭は、能力、課題、倫理的考慮の新時代をもたらします。 戦争の進化を目の当たりにすると、自律システムの影響を慎重に評価し、自律システムが引き起こす倫理的懸念に対処することが不可欠です。

人間による制御の低下による潜在的なリスクから、国際安全保障や民間人の福利への影響に至るまで、包括的なアプローチが必要です。 強力な政策、国際協力、国民の関与、透明性を通じて、私たちは自治戦争の倫理的な未来を形作ります。

以下のコメントセクションでご意見やフィードバックを共有し、このトピックに関する有意義な議論を促進することをお勧めします。 私たちの人間性を定義する価値観と原則を守りながら、軍事技術の可能性を受け入れながら、一緒に前進する道を歩んでいきましょう。