Jak wykryć plagiat ChatGPT i AI

Opublikowany: 2023-06-22ChatGPT wywrócił świat akademicki i biznesowy do góry nogami dzięki swojej zdolności do generowania spójnej, dobrze napisanej kopii na praktycznie każdy temat na ziemi w ciągu kilku sekund.

Jego niezwykłe możliwości sprawiły, że uczniowie na wszystkich poziomach edukacji zwracają się do chatbota – a także jego rywali, takich jak Bard – do pisania złożonych esejów, których ukończenie zajęłoby wiele godzin.

Rozpoczęło to globalną dyskusję na temat nowego zjawiska, często określanego jako „plagiat ChatGPT”. Ten przewodnik omawia narzędzia używane przez firmy i instytucje edukacyjne do wykrywania plagiatu ChatGPT, niebezpieczeństwa związane z oszukiwaniem w ChatGPT oraz to, czy korzystanie z ChatGPT w ogóle liczy się jako plagiat.

- Jak wykryć plagiat ChatGPT

- Najpopularniejsze narzędzia do sprawdzania plagiatu AI i ChatGPT

- Czy narzędzia do sprawdzania treści AI rzeczywiście działają?

- Czy korzystanie z ChatGPT lub Bard jest rzeczywiście plagiatem?

- Niebezpieczeństwa związane z oszukiwaniem za pomocą ChatGPT

- Czy ChatGPT plagiatuje?

- Czy Bard popełnia plagiat?

- Czy inne narzędzia AI są plagiatami?

- Czy powinienem używać ChatGPT do moich esejów lub pracy?

Jak wykryć plagiat ChatGPT

Aby wykryć plagiat ChatGPT, potrzebujesz narzędzia do sprawdzania treści AI. Kontrolery treści AI skanują treść tekstu, aby ustalić, czy został on utworzony przez chatbota, takiego jak ChatGPT lub Bard, czy też przez człowieka. Jednak, jak omówimy później, narzędzia te są dalekie od niezawodności.

Nieco trudniej jest wykryć plagiat, jeśli chodzi o kod, coś, co ChatGPT może również skutecznie wygenerować. Nie ma takiego samego ekosystemu narzędzi do wykrywania AI dla kodu, jak dla treści.

Jeśli jednak jesteś na przykład w środowisku uniwersyteckim i przesyłasz kod znacznie przekraczający twój poziom techniczny, twój profesor lub wykładowca może mieć bardzo uzasadnione podejrzenia, że poprosiłeś ChatGPT o pomoc.

Recenzja najpopularniejszych narzędzi do sprawdzania plagiatu AI i ChatGPT

Od czasu uruchomienia ChatGPT w listopadzie 2022 r. wiele firm i instytucji edukacyjnych stworzyło narzędzia do sprawdzania treści AI, które twierdzą, że są w stanie odróżnić treści generowane sztucznie od treści tworzonych przez ludzi. Teraz wiele firm korzysta również z chatbota Google Bard, który używa innego modelu językowego.

Jednak rzekoma dokładność nawet najbardziej renomowanych narzędzi do wykrywania treści AI jest przedmiotem ostrych dyskusji, a sprawy sądowe między uczniami fałszywie oskarżonymi o korzystanie z treści AI a edukacją już się zmaterializowały.

Najważniejsze jest to, że żadne narzędzie w tej przestrzeni nie jest w 100% dokładne, ale niektóre są znacznie lepsze od innych.

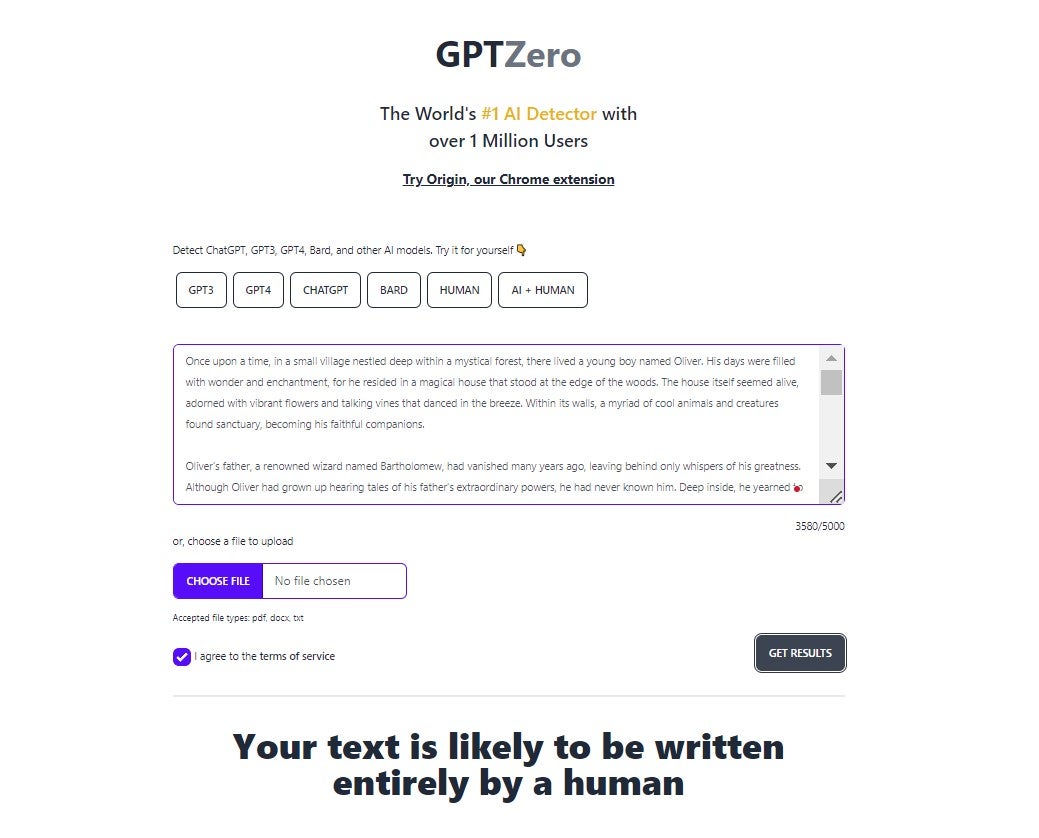

GPTZero

GPTZero to popularne, bezpłatne narzędzie do wykrywania treści AI, które twierdzi, że jest „najdokładniejszym wykrywaczem AI w różnych przypadkach użycia, zweryfikowanym przez wiele niezależnych źródeł”.

Jednak w kwietniu student historii na Uniwersytecie Kalifornijskim w Davis udowodnił, że GPTZero – narzędzie do wykrywania treści AI używane przez jego profesora – było błędne, gdy oznaczyło jego esej jako wygenerowany przez sztuczną inteligencję.

Przetestowaliśmy GPTZero, prosząc ChatGPT o napisanie krótkiej historii. GPTZero niestety nie był w stanie stwierdzić, czy treść została napisana przez narzędzie AI:

Oryginalność.ai

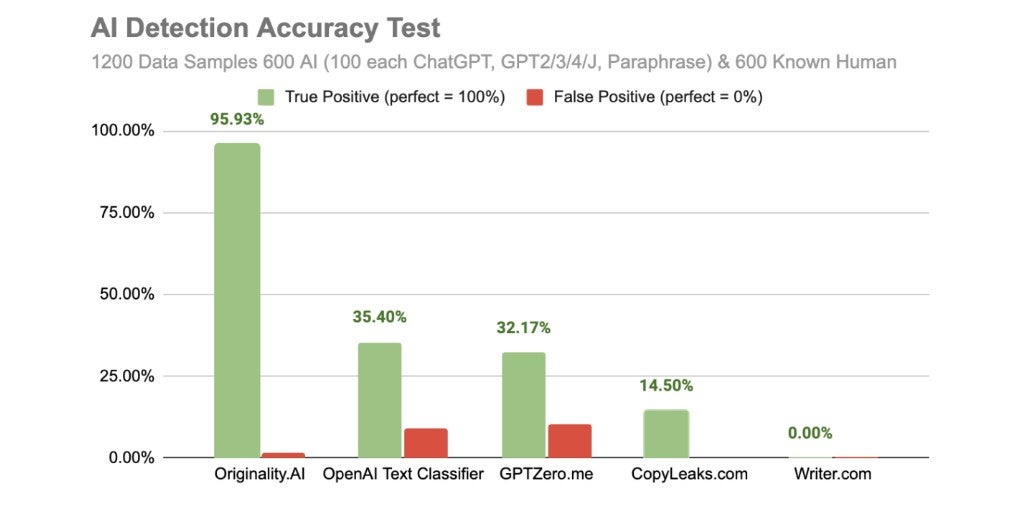

Originality.ai jest z pewnością jednym z dokładniejszych obecnie dostępnych narzędzi do wykrywania treści AI.

Firma przeprowadziła własne badanie narzędzi do wykrywania treści AI w kwietniu tego roku, w ramach którego dostarczyła 600 sztucznie wygenerowanych i 600 wygenerowanych przez człowieka bloków tekstu do własnego systemu wykrywania treści, a także inne popularne narzędzia, które twierdzą, że robią to samo .

Jak widać z poniższych wyników, Originality.ai przewyższył wszystkie narzędzia uwzględnione w teście:

Jedynym minusem Originality.ai jest to, że nie ma darmowego planu i nie można go nawet przetestować za darmo, tak jak w przypadku innych aplikacji zawartych w tym artykule. kosztuje 20 $ za 2000 kredytów, które pozwolą ci sprawdzić 200 000 słów.

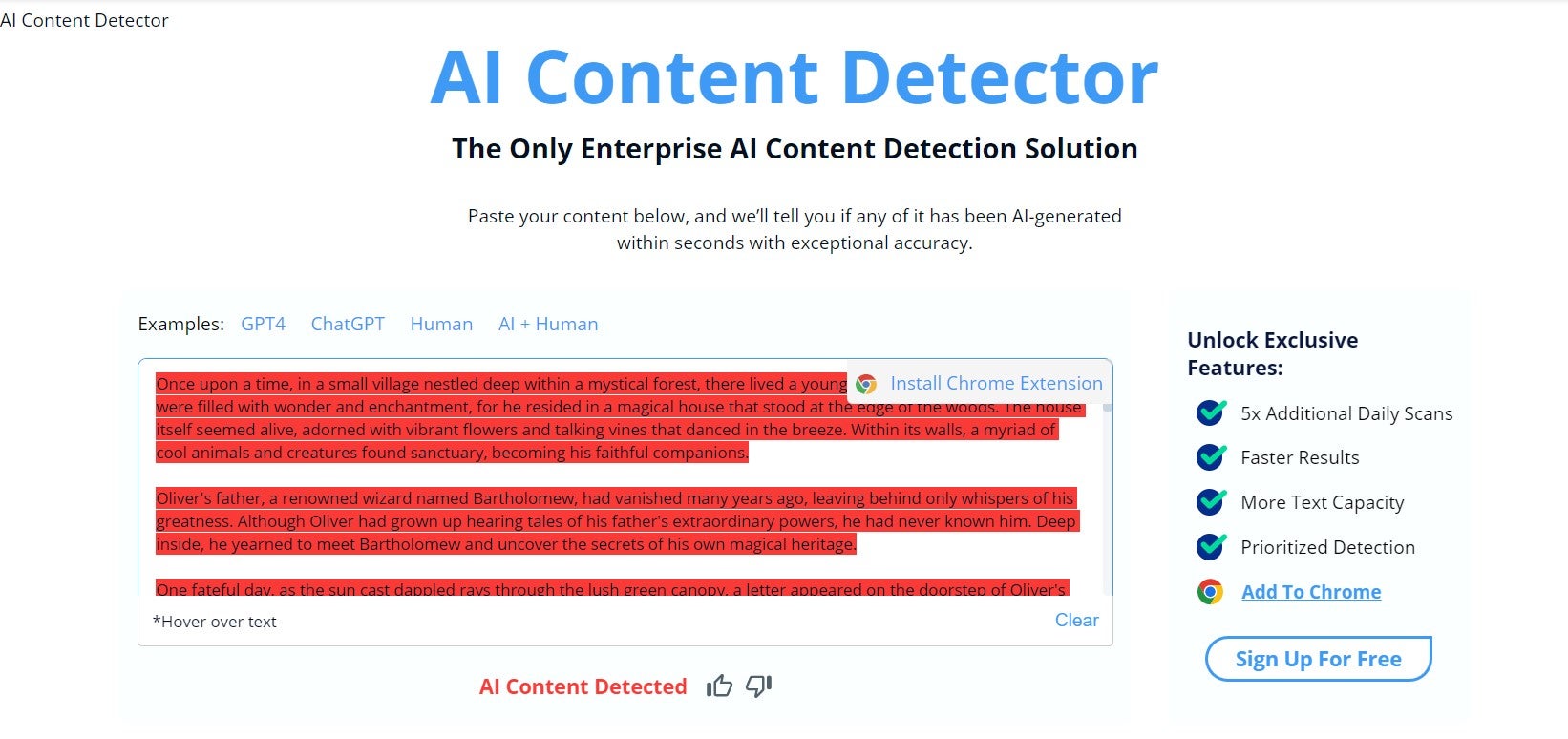

Copyleaks AI Content Detector

Copyleaks to darmowy wykrywacz treści AI, który twierdzi, że jest w stanie odróżnić kopię wygenerowaną przez człowieka od kopii wygenerowanej przez sztuczną inteligencję z dokładnością 99,12%.

Copyleaks powie ci również, czy określone aspekty dokumentu lub fragmentu zostały napisane przez sztuczną inteligencję, nawet jeśli inne części wydają się być napisane przez człowieka.

Copyleaks twierdzi, że jest w stanie wykrywać treści generowane przez sztuczną inteligencję, tworzone przez „ChatGPT, GPT-4, GPT-3, Jasper i inne”, a nawet twierdzi, że „gdy pojawią się nowsze modele, będziemy w stanie automatycznie je wykryć”.

CopyLeaks kosztuje 8,33 USD miesięcznie za 1200 kredytów (250 słów kopii na kredyt).

Jednak w teście przeprowadzonym przez TechCrunch w lutym 2023 r. Copyleaks błędnie sklasyfikował różne rodzaje kopii generowanych przez sztuczną inteligencję, w tym artykuł z wiadomościami, wpis w encyklopedii i list przewodni, jako wygenerowane przez człowieka.

Co więcej, badanie przeprowadzone przez Originality.ai, o którym mowa powyżej, wykazało, że jest ono dokładne tylko w 14,50% przypadków – co jest dalekie od twierdzenia CopyLeaks o 99,12% dokładności.

Jednak kiedy go przetestowaliśmy, wydawało się, że jest w stanie wykryć, że wprowadzony tekst został wygenerowany przez ChatGPT:

Detektor sztucznej inteligencji Turnitin

Turnitin to amerykańska firma zajmująca się wykrywaniem plagiatów, która jest wdrażana przez różne uniwersytety w celu skanowania prac ich studentów. Turnitin ma wykrywać wszelkiego rodzaju plagiaty, ale w kwietniu ujawnił, że od jakiegoś czasu inwestuje w zespół skupiony na sztucznej inteligencji.

Turnitin mówi, że może „wykrywać obecność pisma AI z 98% pewnością i mniej niż jednym procentem fałszywie dodatnich wyników w naszym kontrolowanym środowisku laboratoryjnym”.

Jednak firma twierdzi również, że treść, jeśli oznaczy fragment treści jako wygenerowany przez sztuczną inteligencję, powinna być traktowana jako „wskazówka, a nie oskarżenie”. Prawdziwa dokładność detektora AI firmy Turnitin została zakwestionowana przez Washington Post, a także inne źródła.

Oprogramowanie do wykrywania treści AI firmy Turnitin jest obecnie bezpłatne, ale firma mówi w często zadawanych pytaniach na swojej stronie internetowej, że w styczniu 2024 r. przechodzi na płatny program licencyjny – którego cena nie jest określona.

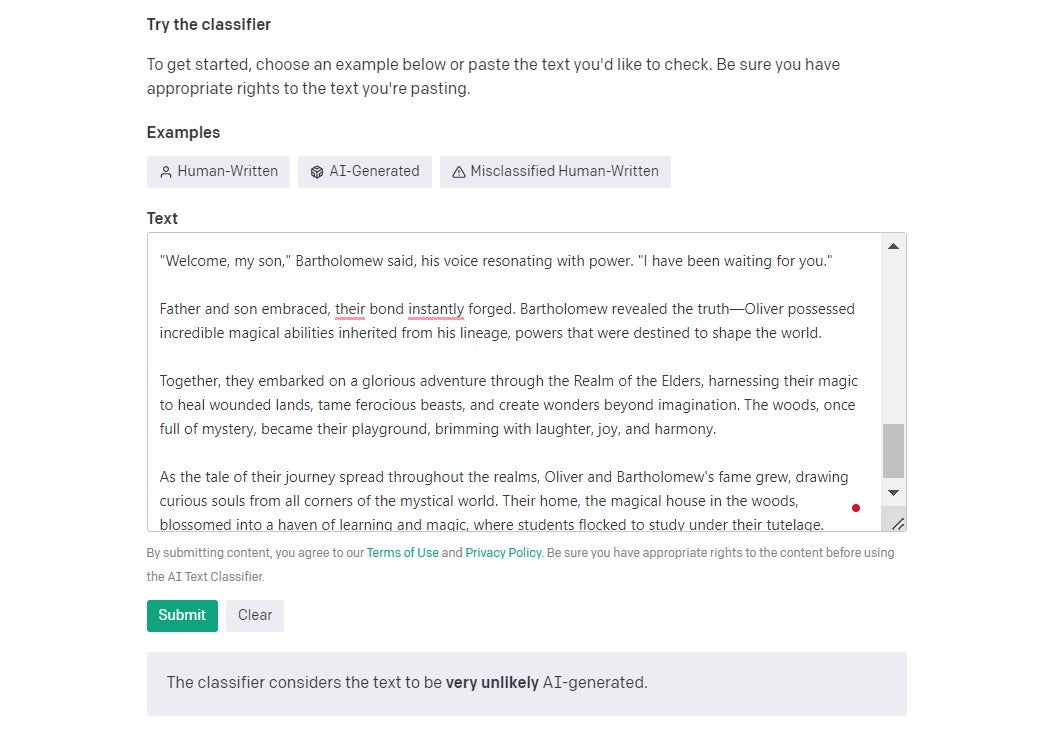

Klasyfikator tekstu OpenAI

Nie chcąc dać się wymanewrować zewnętrznym kontrolerom treści AI, sami OpenAI wypuścili oprogramowanie przeznaczone do klasyfikowania, czy treść została wygenerowana przez sztuczną inteligencję.

Wprowadzony dokument lub tekst musi mieć ponad 1000 znaków. Po wprowadzeniu dokumentu OpenAI niemal natychmiast poinformuje Cię, jakie jest prawdopodobieństwo, że został wygenerowany przez ludzi.

Opublikowałem fragment niedawnego artykułu Tech.co, napisanego przez pisarza – który OpenAI słusznie określił jako „bardzo mało prawdopodobne”, aby został napisany przez AI.

W tym samym artykule TechCrunch, o którym wspominaliśmy wcześniej, publikacja mówi, że OpenAI szacuje, że jego klasyfikator tekstu pomija 74% treści generowanych przez AI. To dobrze, że są tak szczerzy w tej sprawie – kiedy przeprowadziliśmy drugi test, używając krótkiej historii wygenerowanej przez ChatGPT, nie wykryto, że została ona wygenerowana przez sztuczną inteligencję:

Czy wykrywanie treści AI faktycznie działa?

Żadne narzędzie do wykrywania treści AI nie jest w 100% niezawodne – nasze testy dobitnie to potwierdzają.

Jednak żadne z narzędzi, o których dzisiaj rozmawialiśmy, nie jest w rzeczywistości w 100% dokładne, a bardzo niewiele twierdzi, że jest całkowicie wolne od fałszywych alarmów. Inni, jak GPTZero, zamieszczają zastrzeżenia dotyczące traktowania ich wyników jako ewangelii.

Wielu studentów uniwersytetów oskarżonych o wykorzystywanie sztucznej inteligencji do tworzenia esejów zostało już zmuszonych do udowodnienia, że ich praca jest oryginalna.

W marcu w Teksasie profesor fałszywie oblał całą klasę studentów po tym, jak niesłusznie oskarżył ich o używanie ChatGPT do pisania esejów. Istnieje również zbiór raportów – i badań, takich jak to przeprowadzone przez Originality.ai – które sugerują, że nawet najzdolniejsi kontrolerzy plagiatu nie są tak dokładni, jak twierdzą.

Nawet wykrywacz treści AI firmy Turnitin nie jest niezawodny. W niedawnym, stosunkowo małym teście przeprowadzonym przez Washington Post, o którym mówiliśmy wcześniej, jego dokładność była znacznie mniejsza niż 98%, które, jak twierdzą, są w stanie wyprodukować.

Z drugiej strony Originality.ai jest z pewnością jednym z bardziej niezawodnych dostępnych — i nawet jego technologia wykrywania nie zawsze jest właściwa.

Poza tym, jeśli w jakikolwiek sposób istnieją fałszywe alarmy, zawsze będzie miejsce dla uczniów, aby twierdzić, że ich praca jest oryginalna i po prostu została błędnie zidentyfikowana.

Czy korzystanie z ChatGPT lub Bard jest plagiatem?

Można dyskutować, czy ChatGPT w ogóle jest plagiatem. Oxford Languages definiuje plagiat jako „praktykę polegającą na przejmowaniu czyjejś pracy lub pomysłów i przedstawianiu ich jako własnych”.

ChatGPT nie jest osobą i nie polega po prostu na reprodukowaniu pracy i pomysłów innych osób podczas generowania odpowiedzi. Tak więc, zgodnie z definicją słownikową, nie jest to jawny plagiat.

Nawet gdyby to robił, gdybyś był szczery co do tego, skąd pochodzi (tj. ChatGPT), prawdopodobnie i tak nie byłby to plagiat.

Jednak niektóre szkoły i uniwersytety mają daleko idące zasady antyplagiatowe i rozważają wykorzystanie chatbotów do pisania esejów jako takich. Jeden student z Furman University nie zdał dyplomu z filozofii w grudniu po tym, jak użył ChatGPT do napisania swojego eseju. W innym przypadku profesor z Uniwersytetu Północnego Michigan zgłosił, że przyłapał dwóch studentów na używaniu chatbota do pisania esejów dla swojej klasy.

Używanie ChatGPT do generowania esejów, a następnie przedstawianie ich jako własnej pracy, jest prawdopodobnie lepiej opisane jako „oszukiwanie” i zdecydowanie „nieuczciwe”.

Celem napisania eseju jest pokazanie, że jesteś w stanie tworzyć oryginalne myśli, rozumieć odpowiednie koncepcje, uważnie rozważać sprzeczne argumenty, jasno przedstawiać informacje i cytować źródła.

Istnieje bardzo mała różnica między używaniem ChatGPT w ten sposób a płaceniem innemu uczniowi za napisanie twojego eseju – co jest oczywiście oszustwem.

W odniesieniu do Google's Bard, odpowiedź jest nieco bardziej skomplikowana. Ta sama logika zastosowana powyżej ma zastosowanie do Bard, jak i do ChatGPT, ale Bard został zakłócony przez oskarżenia o plagiat i nieprawidłowe cytowanie rzeczy, które pobiera z Internetu w sposób, w jaki ChatGPT nie. Tak więc używanie Barda może prowadzić do nieumyślnego plagiatu innych źródeł ( więcej na ten temat poniżej ).

Niebezpieczeństwa związane z oszukiwaniem za pomocą ChatGPT

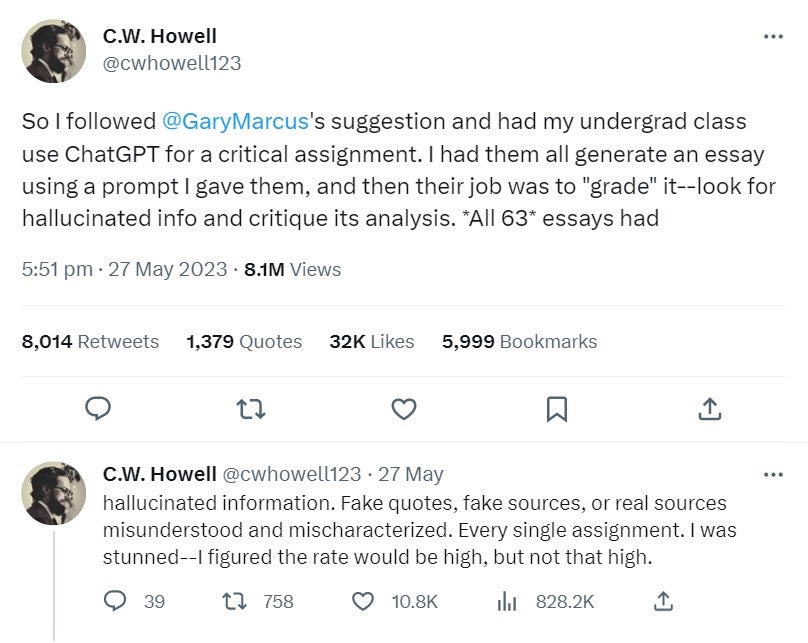

Christopher Howell, adiunkt na Uniwersytecie Elon, niedawno poprosił grupę studentów, aby użyli ChatGPT do zadania krytycznego, a następnie ocenili opracowane dla nich eseje.

Poinformował w długim wątku na Twitterze (którego pierwsza część jest przedstawiona poniżej), że wszyscy 63 uczniowie, którzy brali udział, znaleźli jakąś formę „halucynacji” – w tym fałszywe cytaty oraz fałszywe i źle zinterpretowane źródła – w swoich zadaniach.

Czy ChatGPT popełnia plagiat w swoich odpowiedziach?

Nie – ChatGPT nie pobiera informacji z innych źródeł i po prostu nie łączy ich ze sobą, zdanie po zdaniu. Jest to nieporozumienie, jak działają wstępnie wyszkolone transformatory generatywne.

ChatGPT – a dokładniej model językowy GPT – jest szkolony na ogromnym zbiorze danych dokumentów, materiałów ze stron internetowych i innego tekstu.

Wykorzystuje algorytmy do znajdowania sekwencji językowych i wzorców w swoich zbiorach danych. Akapity, zdania i słowa mogą być następnie generowane na podstawie tego, czego model języka nauczył się o języku z sekwencji w tych zestawach danych.

Dlatego jeśli zadasz ChatGPT to samo pytanie w tym samym czasie z dwóch różnych urządzeń, jego odpowiedzi są zwykle bardzo podobne – ale nadal będą występować różnice, a czasami oferuje zupełnie inne odpowiedzi.

Czy Bard popełnia plagiat w swoich odpowiedziach?

Największy rywal ChatGPT, Google's Bard, miał znacznie więcej problemów z plagiatowaniem treści od czasu jego uruchomienia niż jego bardziej popularny odpowiednik. Witryna technologiczna Tom's Hardware odkryła, że Bard splagiatował jeden ze swoich artykułów, a następnie zaczął przepraszać, gdy jeden z jej pracowników to nazwał.

Niedawno, w maju 2023 r., PlagiarismCheck powiedział Yahoo News, że wygenerowali 35 fragmentów tekstu za pomocą Barda i stwierdzili, że w 25 z nich doszło do plagiatu powyżej 5%, po prostu parafrazując istniejące treści już opublikowane w Internecie.

Jedną dużą różnicą między Bardem a ChatGPT, która być może może to wyjaśnić, jest to, że Bard może przeszukiwać Internet w poszukiwaniu odpowiedzi, dlatego lepiej radzi sobie z pytaniami dotyczącymi wydarzeń po 2021 roku, z którymi ChatGPT się boryka. Wydaje się jednak, że oznacza to również, że pobiera dane ze źródeł w mniej oryginalny sposób i częściej cytuje swoje źródła.

Te przykłady mogły być blipami, ale dobrze jest znać ryzyko, jeśli używasz Barda do ważnych zadań.

Czy inne narzędzia AI są plagiatami?

Niestety tak – i niektóre firmy już się zawstydziły, używając narzędzi AI, które splagiatowały treści. Na przykład stwierdzono, że CNET – jedna z największych witryn technologicznych na świecie – używa narzędzia sztucznej inteligencji do generowania artykułów i wcale nie była na ten temat przejrzysta. Stwierdzono, że około połowa artykułów opublikowanych przez CNET przy użyciu sztucznej inteligencji zawierała nieprawidłowe informacje.

Co gorsza, firma Futurism, która wszczęła dochodzenie w sprawie plagiatu sztucznej inteligencji CNET, stwierdziła, że „niewłaściwe zachowanie bota waha się od dosłownego kopiowania, przez umiarkowane edycje, po znaczące przeredagowanie, a wszystko to bez odpowiedniego uznania oryginału”.

Narzędzia sztucznej inteligencji, które nie generują unikalnych, oryginalnych treści – czy to dzieł sztuki, czy tekstu – mogą potencjalnie plagiatować treści, które zostały już opublikowane w Internecie. Ważne jest, aby dokładnie zrozumieć, w jaki sposób działa model języka, z którego korzysta Twoje narzędzie AI, a także mieć ścisły nadzór nad tworzoną przez nie treścią, w przeciwnym razie możesz znaleźć się w takiej samej sytuacji jak CNET.

Czy powinieneś używać ChatGPT do esejów lub pracy?

Używanie ChatGPT do esejów

Fakt, że ChatGPT nie tylko pobiera odpowiedzi z innych źródeł i miesza zdania razem, oznacza , że firmy mogą używać ChatGPT do różnych zadań bez martwienia się o prawa autorskie.

Ale jego wewnętrzna mechanika oznacza również, że często ma halucynacje i popełnia błędy. Daleko mu do ideału – i chociaż kuszące jest nakłonienie ChatGPT do napisania eseju na uniwersytet lub studia, odradzamy to.

Szczegółowe wytyczne każdej instytucji edukacyjnej będą oczywiście nieco inne, ale jest bardzo prawdopodobne, że jest to już uważane za „oszukiwanie” lub plagiat na Twojej uczelni lub w szkole. Ponadto, niezależnie od tego, jak dokładne są, instytucje edukacyjne używają wykrywaczy treści AI, które z czasem będą się poprawiać.

Korzystanie z ChatGPT w pracy

Oczywiście wiele osób korzysta już z ChatGPT w pracy – okazuje się ono przydatne w wielu branżach i pomaga pracownikom na różnych stanowiskach zaoszczędzić cenny czas na codziennych zadaniach.

Jeśli jednak korzystasz z ChatGPT w pracy, radzimy otwarcie porozmawiać o tym ze swoim kierownikiem lub przełożonym – zwłaszcza jeśli używasz go do ważnych czynności, takich jak pisanie raportów dla zewnętrznych interesariuszy.

Zdecydowanie zalecamy zarówno intensywną edycję, jak i dokładne przeglądanie całej pracy, którą generujesz za pomocą ChatGPT, Bard lub dowolnego innego narzędzia AI. Nierozsądne jest umieszczanie poufnych danych osobowych lub firmowych w jakimkolwiek chatbocie, ponieważ nie ma zbyt wielu publicznych informacji o tym, gdzie te czaty są przechowywane lub o infrastrukturze bezpieczeństwa OpenAI.

Używanie innych narzędzi AI do esejów lub pracy

Oczywiście Bard i ChatGPT nie są jedynymi chatbotami AI. Wahalibyśmy się jednak, czy wspierać jakiekolwiek mniejsze narzędzia AI, które nie są wspierane przez zaawansowane modele językowe. Nie będą tak dobrze wyposażone i jest mało prawdopodobne, że uznasz je za przydatne, jeśli poeksperymentujesz z używaniem ich do pracy.

Jednak nadal obowiązują te same zasady – bądź otwarty ze swoim przełożonym i uzyskaj zgodę na korzystanie z nich, nie wprowadzaj żadnych wrażliwych danych firmy i zawsze przeglądaj udzielone odpowiedzi.