Jak uruchomić głęboką AI na Androidzie: przewodnik krok po kroku

Opublikowany: 2025-02-14Od momentu uruchomienia Chatgpt szybko stał się jednym z najlepszych modeli. Google nadrabia zaległości z modelem Gemini, a prawie każda firma w 2025 r. Zintegrowała sztuczną inteligencję do swoich aplikacji i zbudowała wokół niego usługi.

Wynika to również po kosztach. Openai wlewa miliardy dolarów na rozwój Chatgpt; Jednak jedna chińska firma AI z modelem DeepSeek, która prawie odpowiada możliwościom modelu czołowego rozumowania Chatgpt, najwyraźniej została opracowana za ułamkiem kosztów.

To osiągnęło rynek amerykański i zmusiło nas do przemyślenia rozwoju chatbotów i LLM AI. Deepseek jest tak destrukcyjny, że teraz możesz uruchomić modele rozumowania LLM znane z ich możliwości myślenia przed odpowiedzią na pytania lokalnie na urządzeniu. Mamy już szczegółowy przewodnik na temat tego, jak uruchamiać DeepSeek lokalnie w systemie Windows i Mac. W tym przewodniku przyjrzymy się instalacji i uruchomieniu modelu Deepseek R1 lokalnie na smartfonie z Androidem.

Spis treści

Minimalne wymagania dotyczące urządzenia do instalacji i uruchamiania Deepeek na urządzeniu

Ponieważ LLM wymaga zasobów do funkcjonowania, istnieją minimalne wymagania systemowe do instalowania i korzystania z DeepSeek R1 lokalnie na urządzeniu. Pamiętaj, że są to wymagania systemowe dla mniejszego modelu 1,5B. Model 7,8 32 mld, 70 miliardów wymaga również wyższych wymagań systemowych.

| Specyfikacje | Minimalna specyfikacja |

| BARAN | 8 GB lub więcej |

| Edytor | Snapdragon 8 gen 2 lub równoważny |

| Składowanie | Co najmniej 12 GB wolnej przestrzeni |

| OS | Android 12 lub później |

Mając to na uwadze, jeśli chcesz flagowy smartfon z Androidem z wymaganiami systemowymi, przejdźmy do przewodnika krok po kroku i zainstaluj i uruchom AI Deepseek na swoim urządzeniu.

Przewodnik krok po kroku, aby uruchomić Deepseek lokalnie na urządzeniu

Możesz zainstalować i uruchomić głęboką poszukiwanie sztucznej inteligencji lokalnie na urządzeniu na kilka sposobów. W tym poście dowiesz się, jak używać termun do instalowania i uruchamiania lokalnych modeli AI lokalnie. Wymaga to jednak pracy z terminalem; Jeśli chcesz łatwej metody, możesz użyć aplikacji PocketPal AI. Zobacz drugą metodę.

Krok 1: Zainstaluj termux

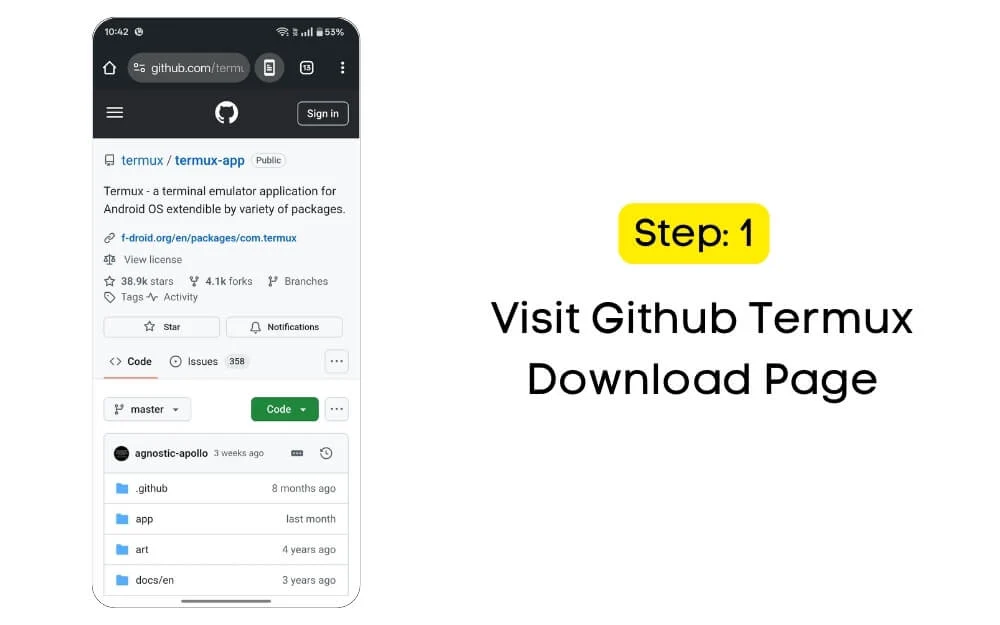

Krok 1.1: Pobierz aplikację termux z oficjalnej strony GitHub.

Terminux to terminal emulator Android, która wprowadza swój wiersz poleceń do urządzeń mobilnych, takich jak Android. Umożliwia wykonywanie programów wiersza poleceń, instalacji pakietów Linux, wykonania poleceń Shell i umożliwia instalowanie narzędzi takich jak Python i SSH na urządzeniu. Co najważniejsze, w przeciwieństwie do wielu aplikacji, nie wymaga dostępu do korzeni, co oznacza, że każdy może zainstalować tę aplikację bez rootowania lub jailbracji urządzenia, dzięki czemu jest bezpieczna i łatwa w użyciu dla firm.

Aplikacja nie jest dostępna w Google Play Store lub App Store po usunięciu ze sklepu Play. Możesz jednak łatwo zainstalować go ze źródeł i stron zewnętrznych, takich jak GitHub. Mamy również szczegółowy przewodnik na temat oficjalnych i bezpiecznych linków dla termux. Możesz odwiedzić nasz przewodnik i zainstalować najnowsze APK.

W tym przewodniku możesz zainstalować termux ze strony GitHub.

Krok 1.2: Odwiedź stronę do pobrania Github termux

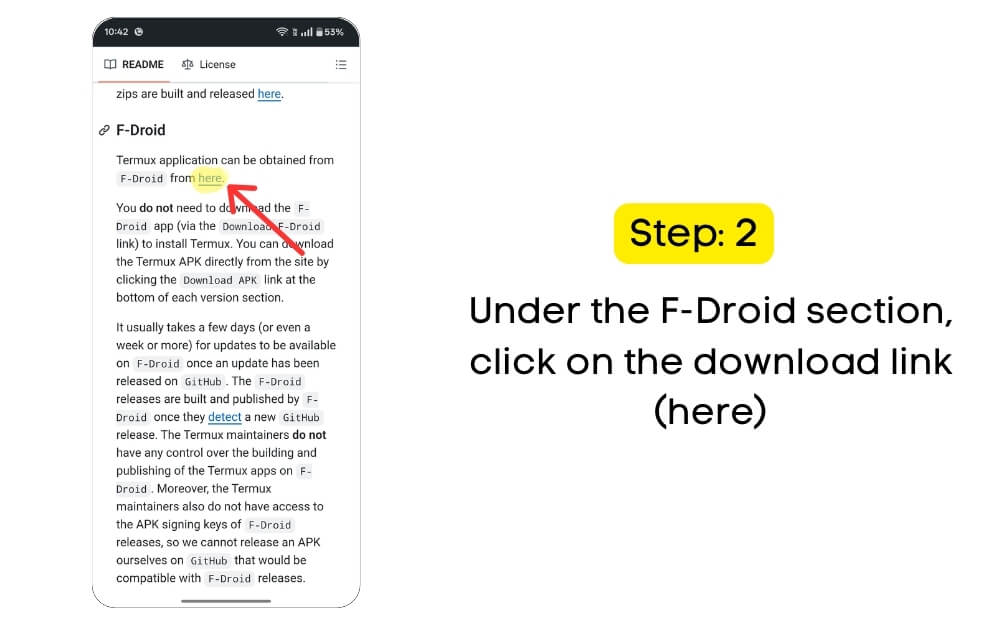

Krok 1.3: Przewiń w dół i w sekcji F-DRIOD kliknij link do pobrania (tutaj) lub możesz użyć tego linku bezpośredniego pobierania, aby odwiedzić stronę F-Drop.

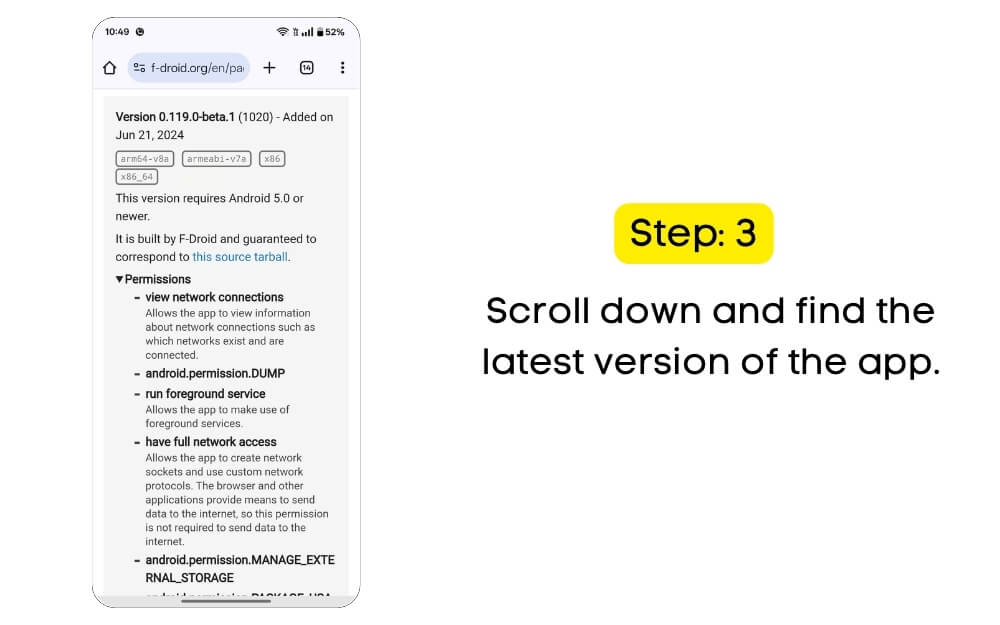

Krok 1.4: Przewiń w dół i znajdź najnowszą wersję aplikacji (po napisaniu tego artykułu najnowsza wersja to 0.119.0-beta.1 (1020); działało dla mnie dobrze; jeśli masz problemy, możesz pobrać Wersja STABLA.

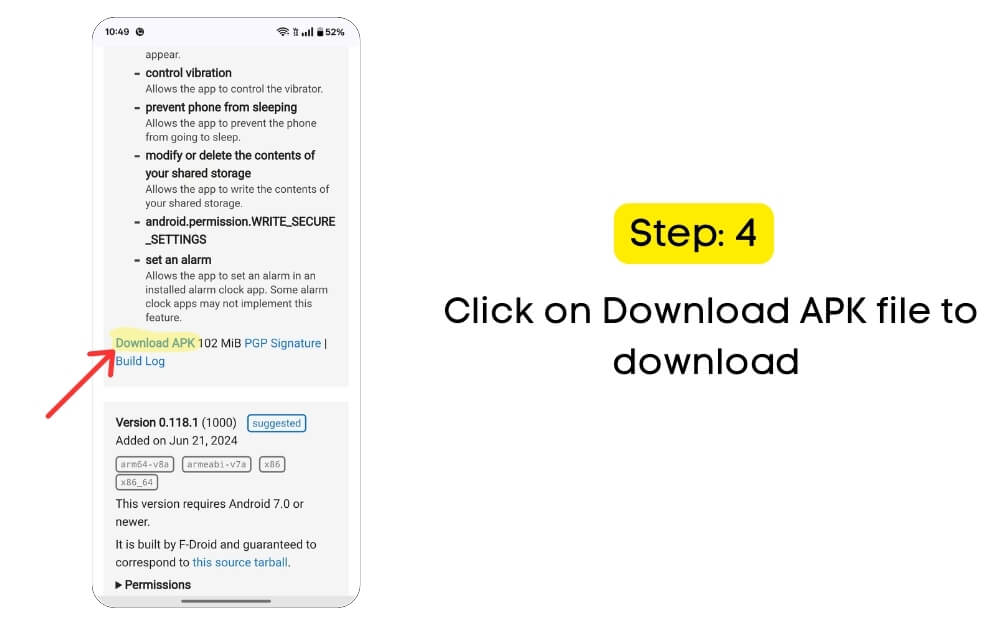

Krok 1.5: Kliknij plik Pobierz APK , aby pobrać.

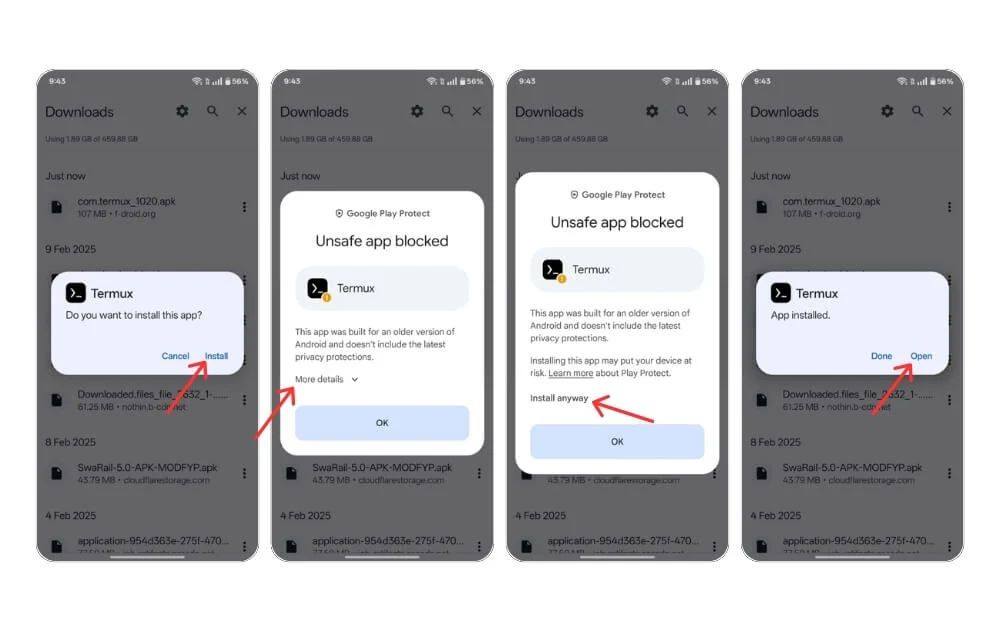

Krok 1.6 : Przejdź do pobranego pliku i kliknij instalację . Jeśli potrzebujesz uprawnień, włącz „ Instaluj z nieznanych źródeł” w ustawieniach Androida. Zainstaluj i otwórz termux na swoim urządzeniu.

Krok 1.7: Jeśli istnieje monit bezpieczeństwa, kliknij opcję więcej i dotknij opcji instalacji , a aplikacja zostanie pomyślnie zainstalowana na urządzeniu.

Krok 1.7: Jeśli istnieje monit bezpieczeństwa, kliknij opcję więcej i dotknij opcji instalacji , a aplikacja zostanie pomyślnie zainstalowana na urządzeniu.

Krok 2: Teraz skonfigurujmy termux

Tam musisz skonfigurować termux, aby uruchomić na swoim urządzeniu.

Aby to zrobić, otwórz pozwolenie na przechowywanie aplikacji i dotacji. Domyślnie termux nie ma zgody na dostęp do plików telefonicznych po zainstalowaniu aplikacji. Korzystając z tego polecenia, możesz udzielić uprawnień do dostępu do plików Androida, odczytu i przechowywania danych oraz korzystania z poleceń zarządzania plikami.

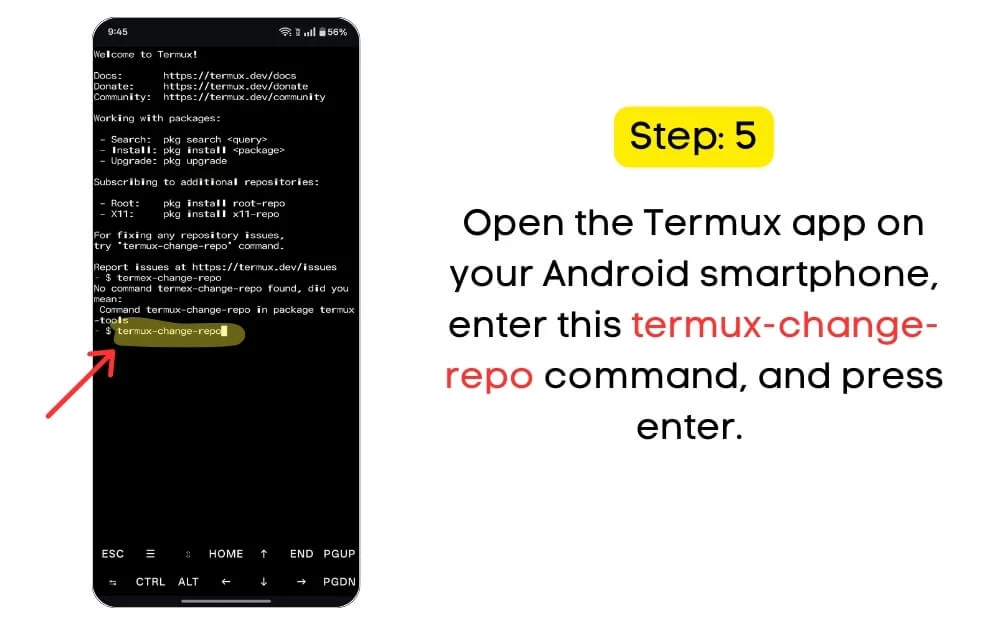

Krok 2.1: Otwórz aplikację Termax na smartfonie z Androidem, wprowadź to polecenie i naciśnij ENTER. termux-change-repo

Jednak robiąc to, możesz napotkać typowe błędy, takie jak błąd „odmowy uprawnień”, który występuje, gdy Android zaprzecza przyznaniu pozwolenia. Przejdź do Ustawienia> Zezwolenie na aplikację w celu ustalenia tego i ręczne włączenie uprawnień do przechowywania.

Kolejnym typowym błędem, przed którymi stoją użytkownicy, jest błąd „ Brak takiego pliku lub katalogu ”, co oznacza, że pamięć nie jest inicjowana. W takim przypadku zamknij aplikację termux , ponownie ją otwórz, wymuszaj jej zatrzymanie i ponownie otwórz po uruchomieniu polecenia.

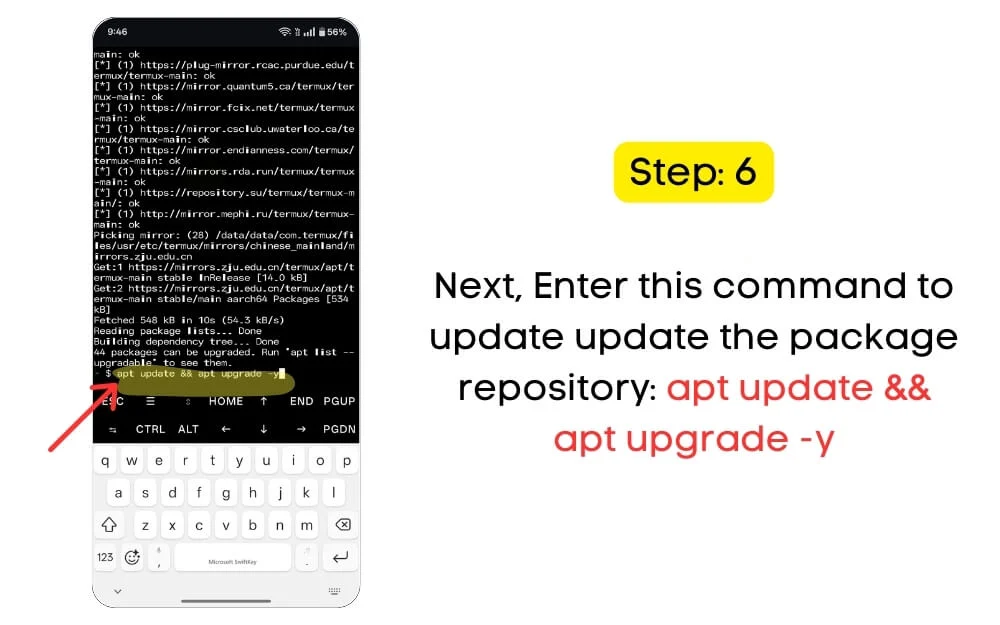

Krok 2.2: Następnie musisz zaktualizować repozytorium pakietów. Możesz użyć poniższego polecenia, aby zaktualizować repozytorium pakietów. W aplikacji termux wprowadź to polecenie: aktualizacja apt && Apt Upgrade -y

Musisz zaktualizować repozytorium termux, aby zaktualizować wszystkie pakiety. Pomoże to uzyskać najnowsze łatki bezpieczeństwa i zapobiec problemom kompatybilności. Jednak podczas tego wykonując, upewnij się, że masz aktywne połączenie internetowe, aby pobierać najnowsze pakiety z serwera i zainstalować je w aplikacji Termax.

Krok 3. Następnie zainstaluj Proot Distro & Debian 12

Następnie musisz zainstalować Proot-Distro i Debian w ramach termux. Pakiet ProOT umożliwia uruchamianie dystrybucji Linux, takich jak Debian lub Ubuntu Inside Termax.

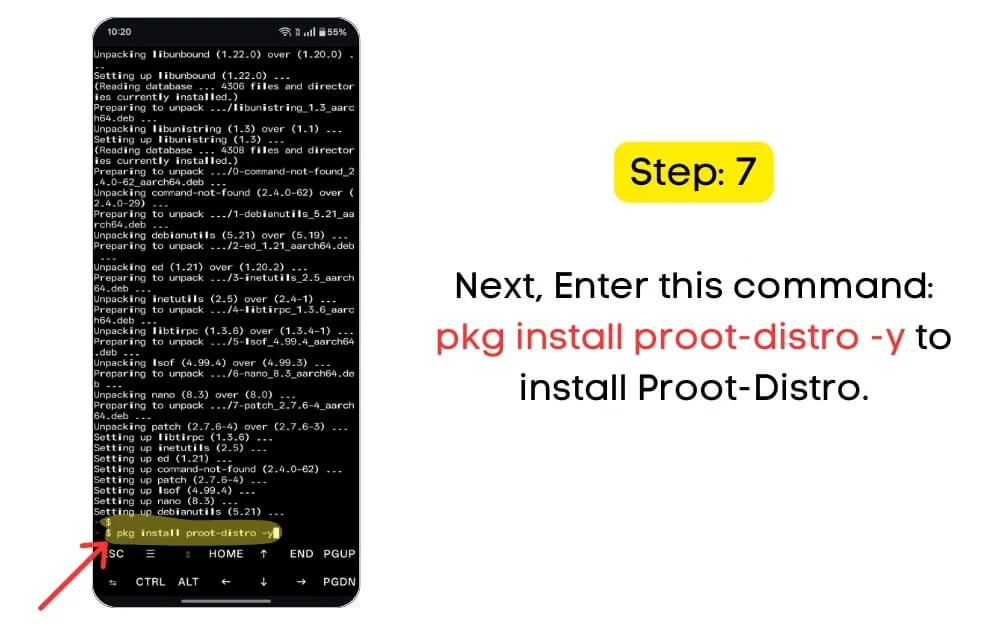

Krok 3.1: Aby zainstalować Proot Distro , wprowadź to polecenie: PKG zainstaluj proot -distro -y w aplikacji termux i naciśnij ENTER.

Robiąc to, napotkanie błędu „ nie znalezionego pakietu” oznacza, że termux nie został zaktualizowany. Ponownie uruchom APT UPDATE && APT Upgrade -y Command, a także upewnij się, że masz aktywne połączenie internetowe podczas korzystania z tego polecenia.

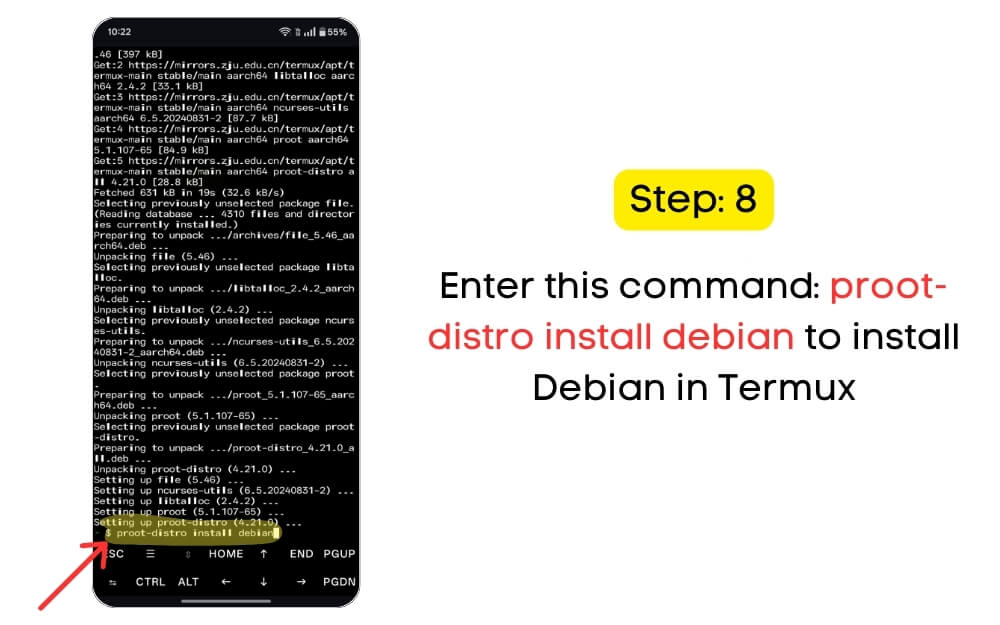

Następnie musisz zainstalować Debiana w termux. Debian to bezpłatna i open source Linux, która jest lekka i działa na Androidzie za pomocą Proot-Distro. Możesz zainstalować najnowszą wersję Debiana przy użyciu poniższego polecenia. Upewnij się również, że masz wystarczającą pamięć na urządzeniu i stabilne połączenie internetowe.

Krok 3.2: Wprowadź to polecenie w terminalu: Proot-Distro Instal Debian

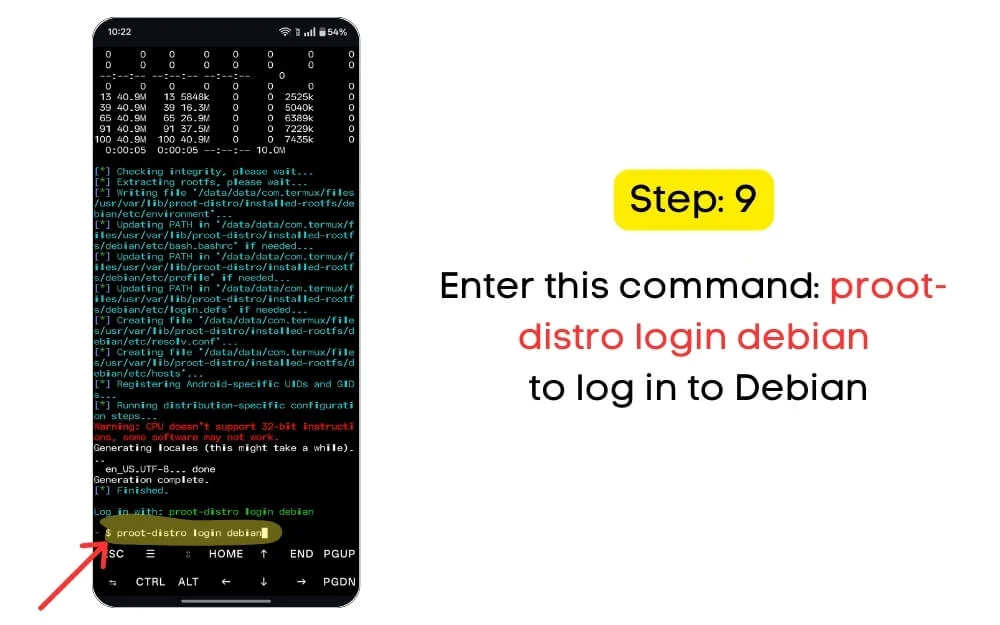

Krok 3.3: Następnie musisz zalogować się do Debiana za pomocą następującego polecenia: Proot-Distro Login Debian.

Krok 4. Zainstaluj Tmux i Ollama, aby zainstalować i używać Deepseek R1

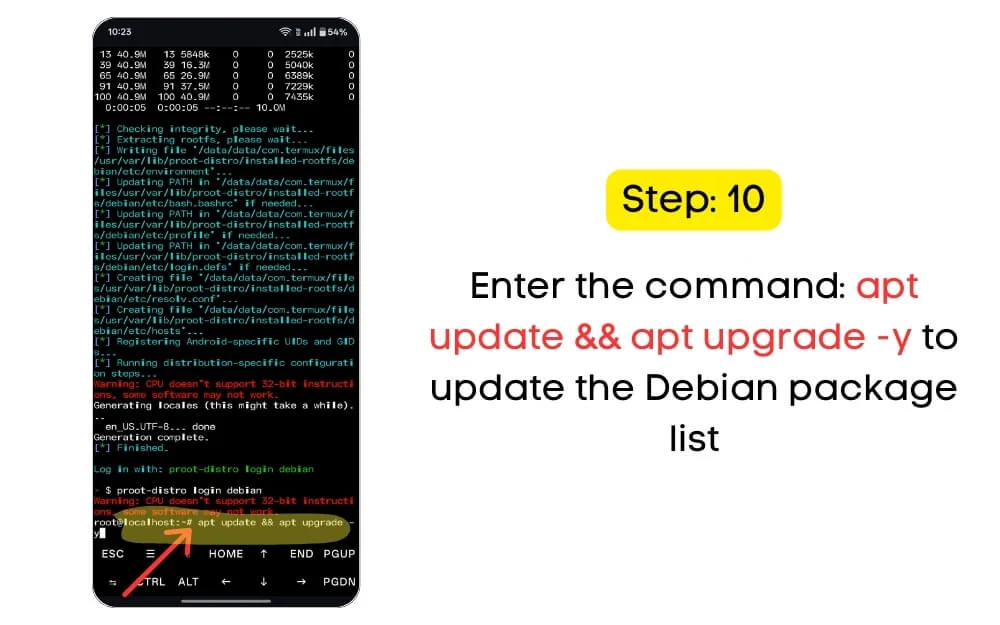

Następnie musisz zainstalować Tmux i Ollama na swoim urządzeniu, aby uruchomić Deepseek R1 lokalnie. Aby to zrobić, najpierw musisz zaktualizować listę pakietów Debian. Możesz użyć następującego polecenia, aby zaktualizować wszystkie listy pakietów Debiana do najnowszych wersji.

Krok 4.1: Wprowadź następujące polecenie: APT Update && Apt Upgrade -y, aby zaktualizować listę pakietów Debian.

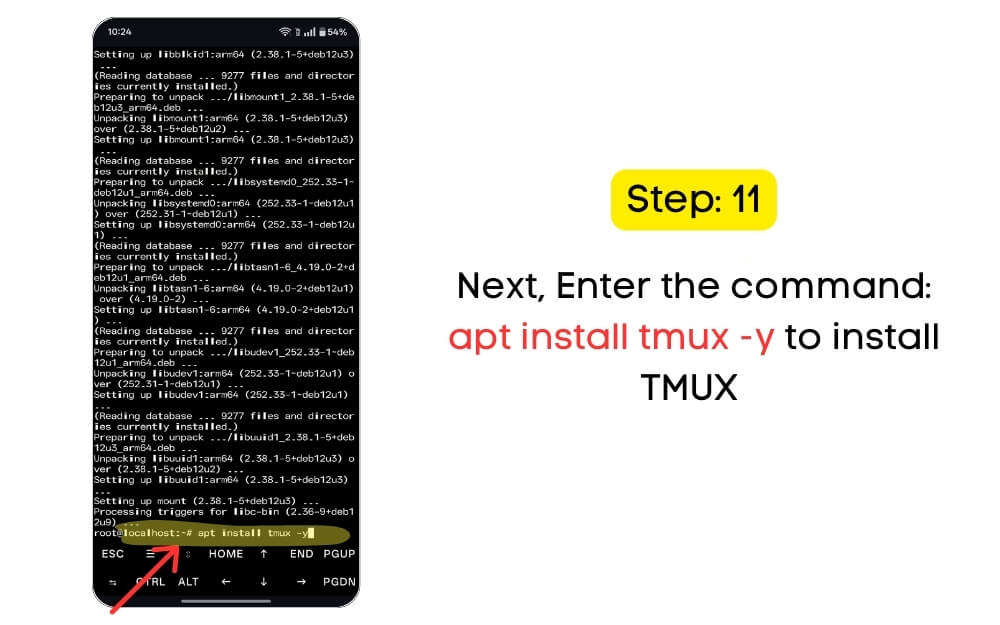

Następnie musisz zainstalować TMUX, aby zarządzać wieloma sesjami terminali. TMUX umożliwia uruchamianie wielu sesji terminalu w jednym oknie. Głównym powodem instalacji TMUX jest to, że pomaga utrzymać model AI działający w tle, nawet jeśli przypadkowo odłączysz. Ma również inne korzyści, takie jak podział terminalu na wiele patelów w celu lepszego wielozadaniowości i wykonywania wielu zadań jednocześnie.

Krok 4.2: Użyj następującego polecenia: Apt Zainstaluj Tmux -y , aby zainstalować TMUX

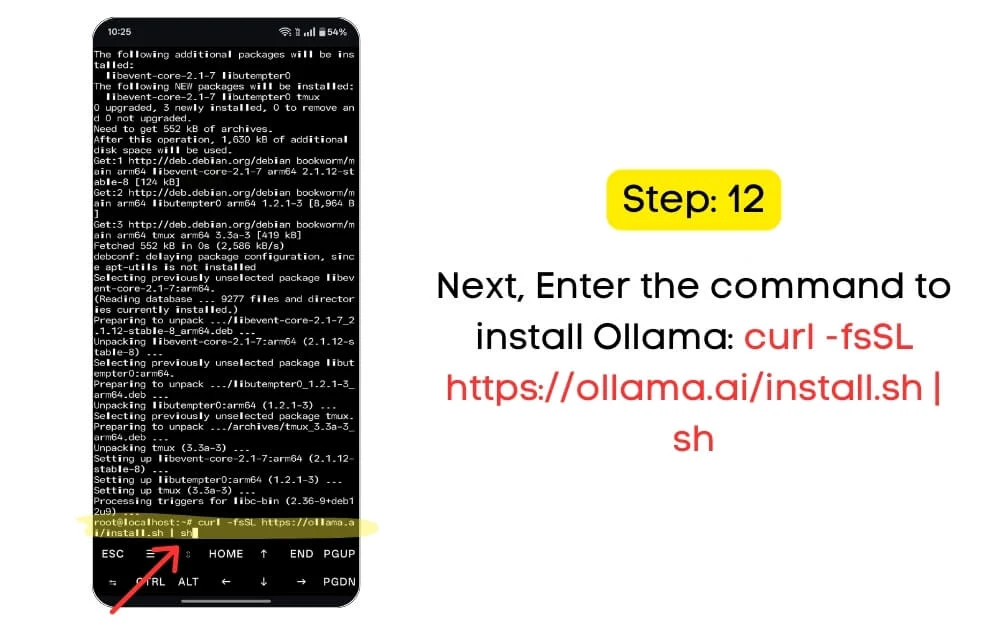

Następnie musisz zainstalować Ollama, narzędzie zaprojektowane dla Androida, które pozwala uruchamiać modele AI lokalnie na urządzeniu. Możesz uruchomić DeepSeek R1 i Meta Lama lokalnie na urządzeniu za pomocą tego narzędzia. Obsługuje również interfejsy offline AI, takie jak Chatgpt.

Krok 4.3: Po zrobieniu tego wszystkiego musisz zainstalować i uruchomić Deepseek R1 lokalnie na swoim urządzeniu. Użyj następującego polecenia, aby zainstalować Ollama: curl -fssl https://ollama.ai/install.sh | cii

Krok 5. Zainstaluj i uruchom Deepseek R1

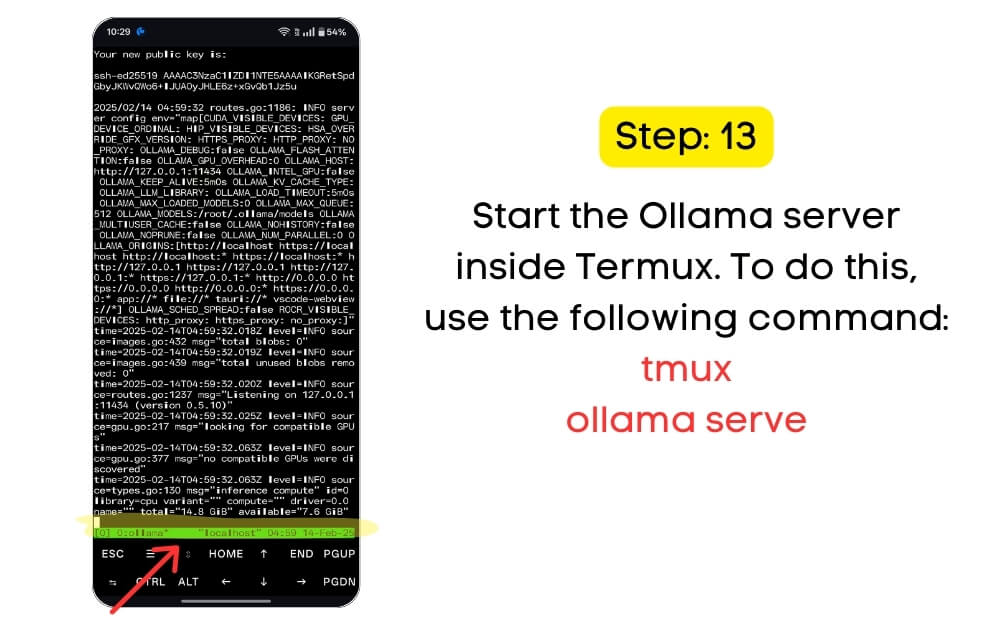

Następnie musisz uruchomić serwer Ollama w termux. Aby to zrobić, użyj następującego polecenia:

Krok 5.1: Krok Start Ollama Server Inside Tmux: Tmux Ollama Serwer

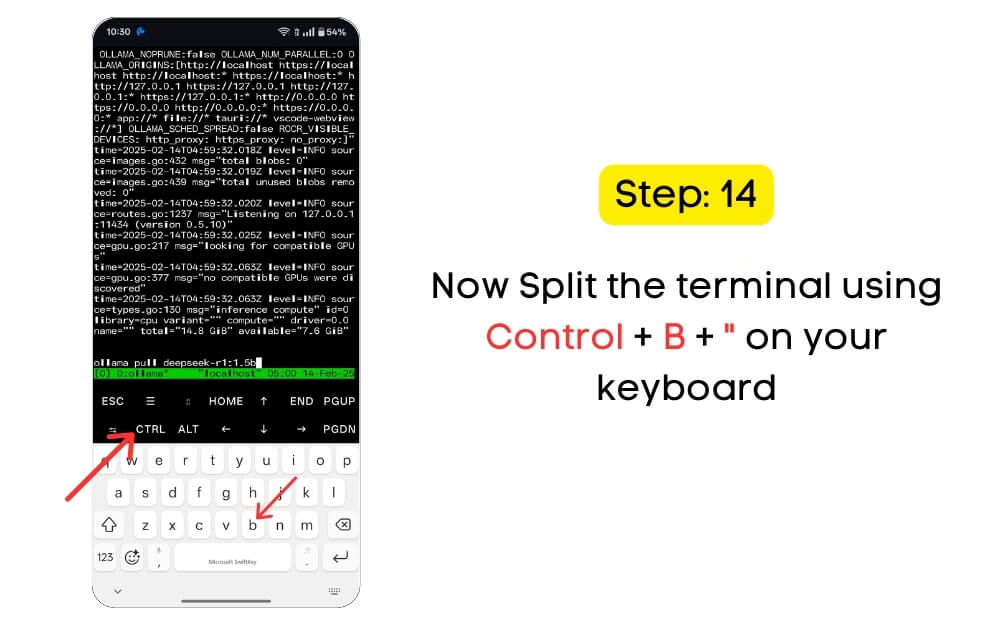

Krok 5.2: Otwórz nowe okno TMUX i podziel terminal na wiele patelów. Może to być pomocne podczas uruchamiania modelu AI w jednym panelu, monitorowaniu dzienników lub wprowadzaniu poleceń w innym terminalu. Użyj następującego skrótu, aby podzielić terminale: kliknij Control+B+”

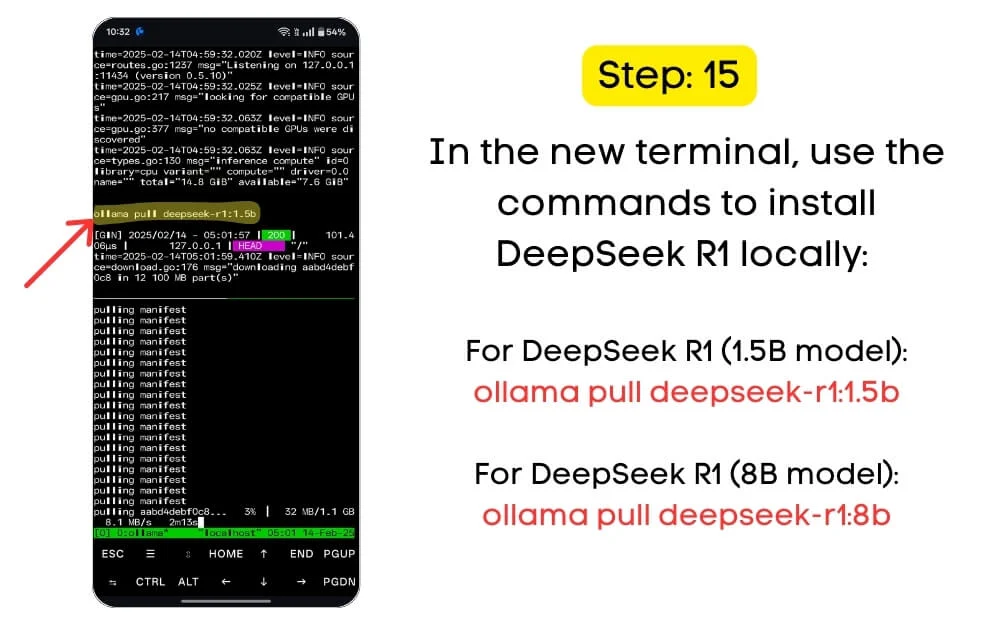

Następnie musisz zainstalować lokalnie model Deepseek R1 1.5B na swoim urządzeniu. Istnieje kilka modeli dla modeli Deepseek R1. Ponieważ Android ma ograniczone zasoby, a uruchamianie tych modeli lokalnie wymaga wielu zasobów, model 1,5B jest najbardziej niezawodnym modelem dla większości urządzeń z Androidem. Oto lista modeli, które obsługuje Deepseek R1.

Wariant modelu | Wymagania przechowywania | Min Wymagania |

|---|---|---|

Deepseek-R1: 1,5b | 1,1 GB | Ram: 8 GB - Procesor: Snapdragon 8 Gen 2 lub równoważny - Przechowywanie: 12 GB Wolna przestrzeń |

Deepseek-R1: 7b | 4,4 GB | - Ram: 8 GB - Procesor: Snapdragon 8 Gen 2 lub równoważny - Przechowywanie: 12 GB Wolna przestrzeń |

Deepseek-R1: 8b | 4,9 GB | Ram: 8 GB - Procesor: Snapdragon 8 Gen 2 lub równoważny - Przechowywanie: 12 GB Wolna przestrzeń |

Deepseek-R1: 14b | 9,0 GB | - Ram: 8 GB - Procesor: Snapdragon 8 Gen 2 lub równoważny - Przechowywanie: 12 GB Wolna przestrzeń |

Deepseek-R1: 32b | 22 GB | - Ram: 8 GB - Procesor: Snapdragon 8 Gen 2 lub równoważny - Przechowywanie: 12 GB Wolna przestrzeń |

Deepseek-R1: 70b | 43 GB | - Ram: 8 GB - Procesor: Snapdragon 8 Gen 2 lub równoważny - Przechowywanie: 12 GB Wolna przestrzeń |

Pobierz model lokalny DeepSeek R1 1.5B za pomocą następującego polecenia. To pobiera i zapisuje go na twoim urządzeniu. Upewnij się, że urządzenie ma minimum wymaganą pamięć dla każdego modelu.

Krok 5.3: W nowych oknach termux użyj polecenia, aby zainstalować Deepseek R1 (model 1,5B): Ollama Pull Deepseek-R1: 1,5B

Możesz zainstalować model 8B za pomocą tego samego polecenia, jeśli masz flagowe urządzenie z wysokiej klasy. Podobnie, jeśli masz inne urządzenia z wysokiej klasy, możesz zainstalować model parametrów 15B na swoim urządzeniu.

Dla twoich informacji, im więcej parametrów modelu, tym bardziej zdolny jest model. W większości przypadków użycia model parametrów 1,5B jest łatwym wyborem dla tylko rozmów. Jednak model parametrów 8B jest rozsądny i często zalecany, jeśli chcesz więcej wiedzy i lepszej wydajności.

To wszystko. Teraz pomyślnie zainstalowałeś Deepseek R1 na swoim urządzeniu. Teraz, gdy DeepSeek R1 jest zainstalowany, możesz użyć termux do uruchamiania go lokalnie na urządzeniu.

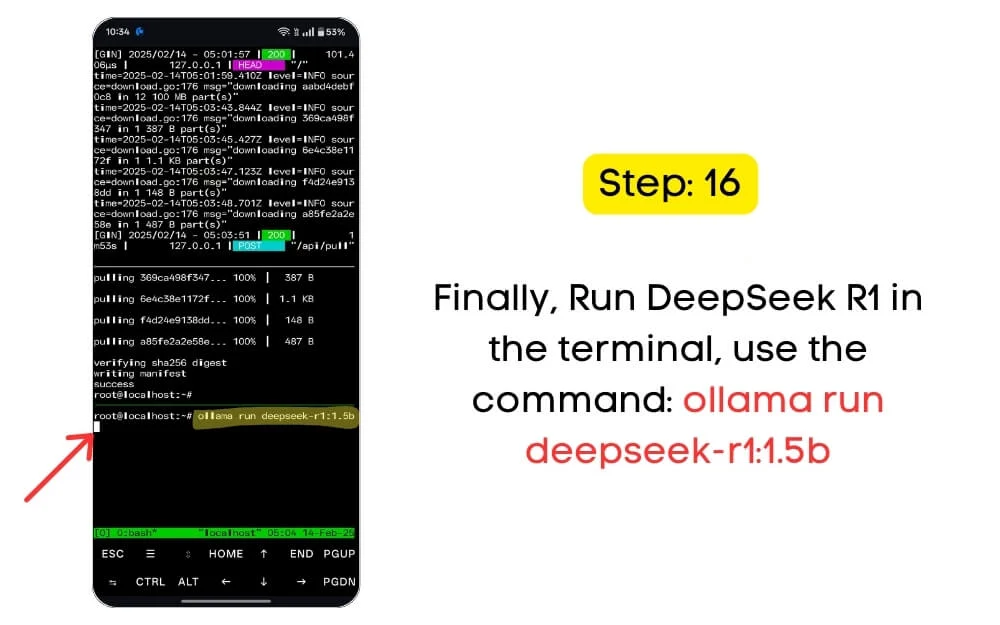

Krok 6. Uruchom Deepeek na swoim urządzeniu

Krok 6.1: Aby uruchomić Deepseek R1 w terminalu, użyj polecenia: Ollama Run Deepseek-R1: 1.5b.

Upewnij się, że używasz poprawnego numeru modelu w poleceniu. Jeśli zainstalowałeś model 1.5B, użyj tej samej nazwy modelu w poleceniu. Jeśli zainstalowałeś model 8B, użyj polecenia.

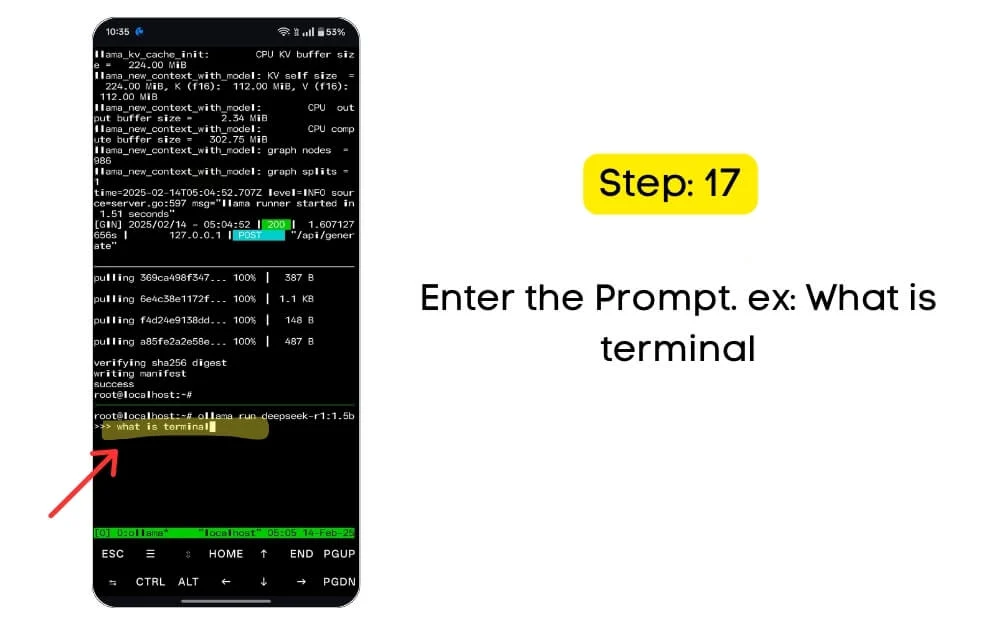

Teraz możesz spróbować interakcja z modelem za pomocą wprowadzania tekstu. Ponieważ wszystko działa przez terminal, nie będzie GUI (graficzny interfejs użytkownika) do interakcji z Chatgpt; Możesz użyć wprowadzania tekstu i uzyskać wyniki w tym samym terminalu.

W zależności od lokalnej mocy przechowywania i przetwarzania urządzenia model wygeneruje dane wyjściowe na podstawie dostępnych zasobów. Oto najczęstsze skróty termux do zarządzania sesjami AI lokalnie na urządzeniu. Możesz użyć Ctrl + C, aby zatrzymać model AI, Ctrl + D do wyjścia, powrotu do modelu i innych.

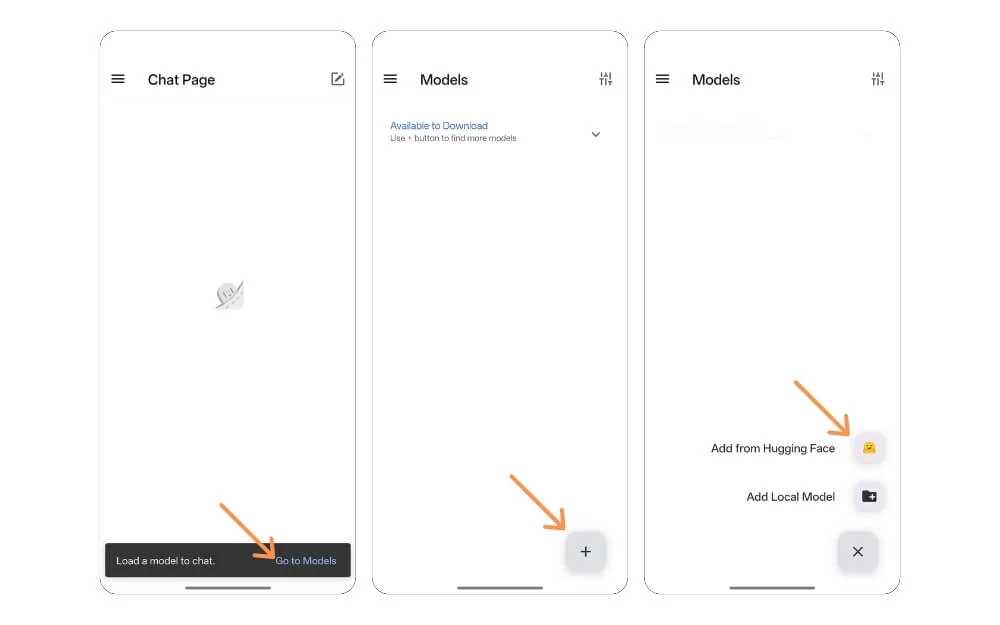

Użyj PocketPal, aby uruchomić Deepseek R1 lokalnie na urządzeniu

Jeśli uważasz, że powyższa metoda jest przytłaczająca, możesz użyć PocketPal AI, bezpłatnej aplikacji, która instaluje i uruchamia modele AI lokalnie na urządzeniu. Postępuj zgodnie z poniższymi krokami.

Krok 1: Zainstaluj aplikację PocketPal ze sklepu Google Play.

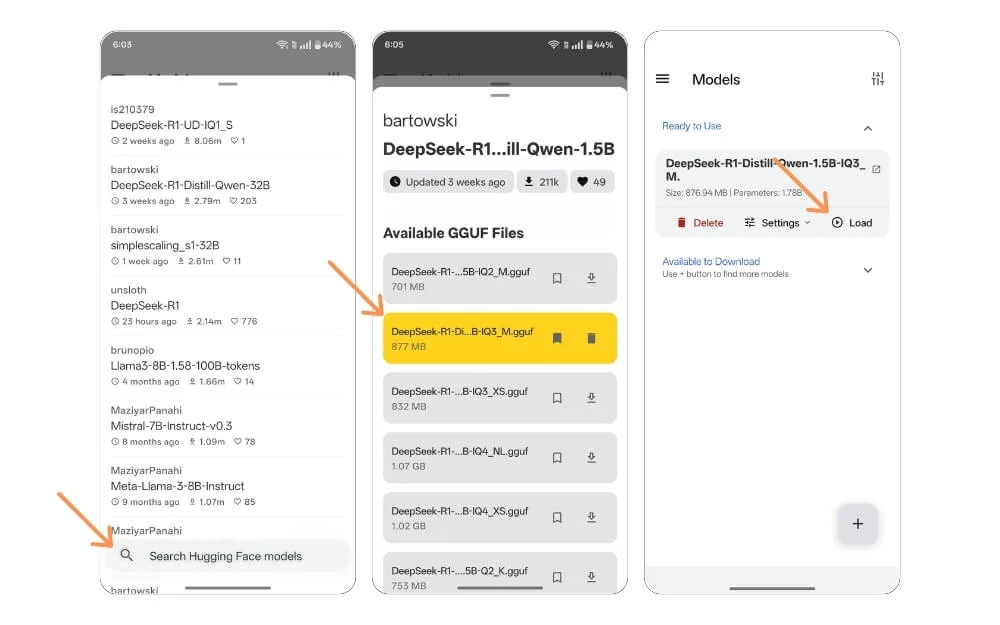

Krok 2: Otwórz aplikację i przejdź do modeli

Krok 3: Kliknij ikonę Plus i dotknij Dodaj z przytulania twarzy.

Krok 4: Użyj paska wyszukiwania w przycisku i wyszukaj modele Deepseek R1.

Krok 5: Wybierz model na podstawie limitu przechowywania urządzenia i kliknij ikonę pobierania . Poczekaj na pobranie modelu.

Krok 6: Po pobraniu wróć do ekranu głównego, wybierz model i kliknij ładunek.

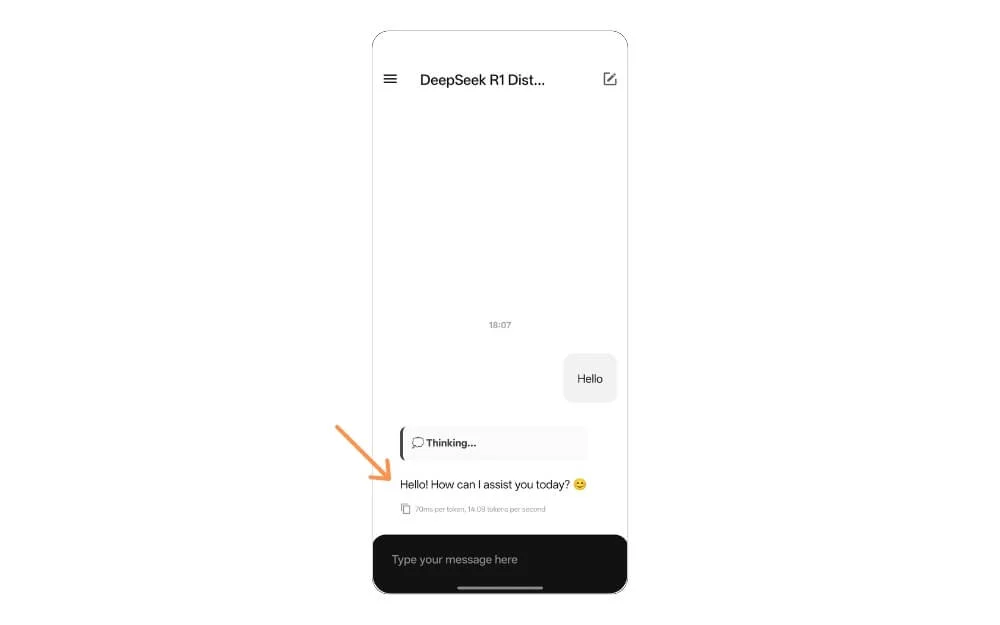

To będzie ładować Deepseek R1 lokalnie na urządzeniu. W przeciwieństwie do powyższej metody, daje on interfejs graficzny czatu do interakcji z modelem. W razie potrzeby możesz również wyłączyć połączenie internetowe.

Uruchom model AI lokalnie na telefonie komórkowym

Mimo że Deepseek jest destrukcyjny i bardzo korzystny dla konsumenta, kilka raportów twierdzi, że Deepseek może wysyłać dane do chińskich firm. Dzięki temu modelowi działającemu na urządzeniu dane pozostają na twoim urządzeniu. Ponadto, jeśli masz dobre specyfikacje dla flagowego smartfona, Deepeek jest szybszy i nie ma wolnego czasu ładowania, co jest na ogół w przypadku modeli chmur. Wszystko to sprawia, że DeepSeek R1 jest doskonałym zasobem do instalowania, uruchamiania i korzystania z LLM lokalnie na urządzeniu.

Udostępniłem twoją szczegółową, kompleksową pomoc krok po kroku. Jeśli podczas instalowania nadal napotykasz jakiekolwiek problemy lub błędy, możesz komentować poniżej, a ja postaram się Ci pomóc. Mam nadzieję, że ten przewodnik jest pomocny. Sprawdź także nasz przewodnik po instalacji DeepSeek lokalnie na komputerach Mac i Windows; Byłoby to bardzo pomocne w przypadku pracy zawodowej i studenckiej.