Golpes de clonagem de voz de IA: 1 em 4 adultos já visados

Publicados: 2023-05-02Você acha que poderia dizer a diferença entre uma mensagem de voz de alguém que você ama e uma mensagem de voz gerada por IA? Bem, os golpistas que usam a tecnologia de clonagem de voz de IA para fraudar vítimas inocentes certamente esperam que você não consiga - e agora eles estão mais ativos do que nunca.

Uma pesquisa realizada recentemente pela McAfee descobriu que um quarto dos adultos já foi alvo de golpes de voz de IA, com a esmagadora maioria perdendo dinheiro suado como resultado. Também revelou que a maioria dos adultos compartilha sua voz em plataformas de mídia social e outros espaços online pelo menos uma vez por semana – o que dá aos criminosos exatamente o que eles precisam para realizar esse tipo de golpe repetidamente.

Então, como os golpes de clonagem de voz de IA realmente funcionam, quão comum é e como você pode identificar um golpe de clonagem de voz de IA? Nós olhamos mais de perto.

- O que é um golpe de clonagem de voz AI?

- Como a clonagem de voz AI realmente funciona

- Quão comuns são os golpes de clone de voz AI?

- Como saber se uma mensagem é um golpe de clone de voz AI

O que é um golpe de clonagem de voz AI?

Um golpe de clonagem de voz AI é qualquer golpe que usa arquivos de áudio gerados artificialmente para enganar as vítimas, fazendo-as pensar que seus entes queridos estão em perigo ou precisam de assistência financeira urgente e os contataram para obter ajuda.

Em um golpe desse tipo, um fraudador exibirá um clipe de um sujeito falando – geralmente extraído da mídia social – por meio de um gerador de voz de IA. Usando o aprendizado de máquina, o gerador analisará a cadência, o tom e o tom do clipe inicial e, em seguida, permitirá que o fraudador produza um áudio original e exclusivo que imita a voz dos sujeitos quase perfeitamente.

O golpista enviará essas gravações para amigos e parentes do sujeito por meio de aplicativos como o WhatsApp, esperando que eles não consigam distinguir entre seu ente querido e uma versão de sua voz gerada por IA.

Como é comum em outros golpes online , o golpista tentará injetar um senso de urgência e angústia em sua correspondência, a fim de induzir o alvo a agir de forma precipitada ou errática.

Em um caso recente, um golpista de voz de IA tentou convencer uma mãe nos Estados Unidos de que sua filha havia sido sequestrada pela clonagem da voz da criança.

Preocupantemente, um golpista iniciante não achará difícil descobrir os arquivos de áudio de que precisará para atingir uma vítima - na verdade, é provável que eles sejam mimados pela escolha.

Uma pesquisa de maio de 2023 publicada pela McAfee envolvendo mais de 7.000 pessoas de sete países diferentes descobriu que 53% dos entrevistados disseram que compartilham sua voz online pelo menos uma vez por semana. Na Índia, esse número foi de 86%.

Como a clonagem de voz realmente funciona

A clonagem de voz AI só é possível com uma ferramenta AI chamada gerador de voz AI. Em poucas palavras, os geradores de voz AI transformam arquivos de texto em fala (geralmente chamados de ferramenta “texto para fala” ou “TTS”).

Os geradores de voz AI usam aprendizado de máquina para aprender a falar de maneiras específicas, analisando informações de arquivos de áudio de pessoas falando. Os geradores então aplicam o que aprenderam para ler arquivos de texto fornecidos pelos usuários e gerar conteúdo de áudio original.

Muitos desses geradores têm vozes personalizadas que você pode selecionar para ler seu texto, bem como vozes de celebridades para escolher - mas outros permitem que você grave sua própria voz e crie conteúdo de áudio subsequente.

A ferramenta de conversão de texto em fala Descript.com oferece um autodescrito “gerador de voz de última geração que cria um clone ultrarrealista de sua própria voz”.

Os geradores de voz AI agora estão amplamente disponíveis para todos os tipos de dispositivos. Esses programas agregam muito valor às pessoas que têm dificuldade de leitura ou simplesmente aprendem melhor ao ouvir o áudio do que ao ler a palavra escrita.

Eles também são usados por empresas de publicidade que não têm orçamento para contratar um dublador caro para seu conteúdo de marketing.

O sucesso e o uso generalizado do ChatGPT colocaram um foco renovado em ferramentas de IA de todas as formas e tamanhos, incluindo aquelas que podem ser usadas para clonagem de áudio. Apesar de seus usos nobres, agora existe um pequeno ecossistema de ferramentas TTS AI que podem, infelizmente, ser abusadas para fins nefastos, incluindo enganar pessoas.

Quão comuns são os golpes de clone de voz AI?

Na pesquisa recém-lançada da McAfee, a gigante da segurança cibernética descobriu que 1 em cada 4 adultos entrevistados experimentou um golpe de voz de IA.

77% dos visados relataram que perderam dinheiro devido ao golpe. A McAfee relata que, desses 77%, “mais de um terço perdeu mais de US$ 1.000, enquanto 7% foram enganados entre US$ 5.000 e US$ 15.000”.

As vítimas nos EUA são as que mais perdem, revela a pesquisa. 11% das vítimas dos EUA que perderam dinheiro por meio de golpes de clonagem de voz de IA perderam entre US$ 5.000 e US$ 15.000.

Como saber se uma mensagem é um esquema de clone de voz AI

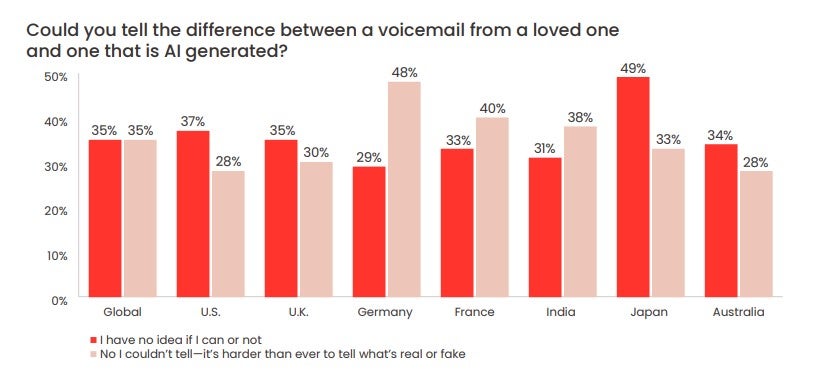

A pesquisa da McAfee também descobriu que 70% das pessoas disseram que não tinham certeza se seriam capazes de dizer a diferença entre uma voz de IA e uma voz humana.

Quase um terço (28%) dos entrevistados nos Estados Unidos disseram que não seriam capazes de diferenciar uma mensagem de voz deixada por um “impostor artificial”, como diz a McAfee, e um ente querido.

Lembre-se de que os golpistas podem replicar a voz de um ente querido, mas controlar o número ou a conta do WhatsApp dele é muito mais difícil.

Pode ser difícil agir com calma quando parece que um de seus parentes ou amigos está em perigo. Mas com os golpes de voz de IA se tornando cada vez mais comuns, é importante que você o faça. Existem alguns sinais de que uma mensagem de voz AI pode ser uma farsa:

- Um método de contato incomum (por exemplo, um número desconhecido)

- Solicitações imediatas de grandes quantias de dinheiro

- Solicitações de transferência de dinheiro por meios incomuns (por exemplo, vales-presente ou criptomoedas)

- Uma exigência de que você não conte a ninguém sobre a ligação/incidente

Com isso em mente, eis o que a FTC recomenda que você faça:

- Ligue para o número que deixou a mensagem para verificar quem é

- Ligue para seu ente querido ou amigo em seu número pessoal

- Envie uma mensagem para a família e amigos próximos da pessoa em questão

Se você não conseguir fazer contato, é importante informar imediatamente as autoridades. Para aqueles de vocês que ainda não foram alvo de um desses golpes, mas querem garantir que não sejam vítimas de um, estabeleça uma palavra de segurança com sua família e amigos.

Este é um código que significa que você e seus entes queridos podem se identificar uns com os outros e é uma das melhores maneiras de garantir que você não seja vítima de um golpe de voz de IA. Isso será particularmente útil para familiares idosos e, se nunca for escrito, pode ser bastante simples.

Também é importante acompanhar os métodos, técnicas e formatos mais recentes que os golpistas de voz de IA estão usando para extorquir as vítimas. Além de estar atento e tratar as chamadas de números desconhecidos com extrema cautela, manter o ouvido no chão geralmente é a melhor coisa que você pode fazer.