De ce AI Therapy Chatbots sunt ultima dilemă etică

Publicat: 2023-10-31Chatboții generativi de inteligență artificială precum ChatGPT sunt folosiți pentru a eficientiza procesele la locul de muncă, pentru a scrie cod și chiar pentru a scrie scripturi pentru seturi de comedie stand-up. În SUA, unde cazurile de anxietate și depresie ating cote record, iar sprijinul profesional rămâne întins, nu este de mirare că utilizatorii folosesc și tehnologia pentru a-și gestiona sănătatea mintală.

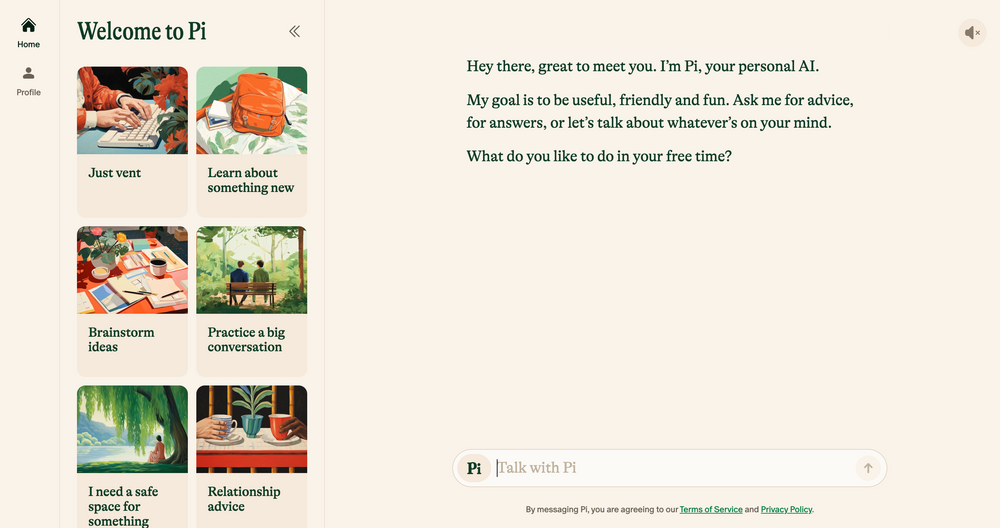

Chatbot-urile AI precum Elomia, Pi și Woebot oferă asistență accesibilă și personalizată 24/7, bazată pe tehnici de terapie încercate și testate. De la a ajuta utilizatorii să evite listele lungi de așteptare până la reducerea stigmatizării legate de accesarea ajutorului, beneficiile lor sunt uriașe. Se poate compara vreodată IA generativă – care este încă predispusă la greșeli, halucinații și părtiniri – cu empatia urechii umane?

Am vorbit cu cadre universitare, psihologi și terapeuți practicanți pentru a face lumină asupra modului în care tehnologia emergentă ar putea modela viitorul terapiei. De asemenea, discutăm latura mai umbrită a terapiei cu inteligență artificială și indicăm care sunt preocupările etice care trebuie abordate astăzi. Iată ce am găsit.

AI Chatbots: noua generație de robot terapeuți

De când chatbot-ul ChatGPT al OpenAI a fost lansat în noiembrie anul trecut, în magazinele de aplicații a apărut o armată de imitatori de chatbot – de la aplicații de uz general precum Google Bard și Claude AI până la simulatoare de personaje Marvel mai puțin convenționale.

Această piață în plină dezvoltare a dus, de asemenea, la creșterea chatbot-urilor de terapie AI – aplicații care folosesc AI generativă pentru a imita sfaturile și îndrumările oferite de terapeuți calificați și profesioniști în sănătate mintală.

Doriți să navigați pe web în mod privat? Sau arăți ca și cum ai fi în altă țară?

Doriți să navigați pe web în mod privat? Sau arăți ca și cum ai fi în altă țară?

Obțineți o reducere uriașă de 86% la Surfshark cu această ofertă Tech.co de Black Friday. ![]()

Exemplele majore includ Pi un autoproclamat „companion de chat prietenos” care acționează ca o placă de sunet și oferă suport emoțional; Replika, un program chatbot care imită stilul de vorbire și personalitatea utilizatorilor săi; și Earkick, un instrument de urmărire a anxietății conceput pentru a vă ajuta să vă conectați și să lucrați cu emoțiile dificile.

„Platformele bazate pe inteligență artificială oferă confidențialitate, reducând stigmatizarea adesea asociată cu căutarea de ajutor pentru probleme de sănătate mintală.” – Ryan Sultan, psihiatru certificat și profesor la Universitatea Columbia

La fel ca cele mai bune aplicații de sănătate mintală , multe dintre aceste aplicații se laudă deja cu descărcări de șase cifre – iar popularitatea lor nu este deloc surprinzătoare. Din cauza lipsei de psihologi, psihiatri și asistenți sociali calificați, plus o creștere a cererii de servicii în întreaga țară, SUA se confruntă în prezent cu una dintre cele mai grave crize de sănătate mintală înregistrate.

Costul ridicat al terapiei tradiționale și tabuurile în jurul sănătății mintale îi descurajează pe mulți să urmărească opțiuni convenționale, creând un gol pentru alternative mai discrete și mai accesibile.

Dovezile timpurii sugerează că și ele sunt eficiente. Descoperirile lui Earkick de la AI Chatbot au arătat că starea de spirit a utilizatorului său s-a îmbunătățit cu 34%, iar nivelul de anxietate a scăzut cu 32% după ce a rămas cu aplicația timp de cinci luni. Cu toate acestea, oricât de succes ar fi aceste aplicații în atenuarea anxietăților minore, ele cu siguranță nu sunt panaceul pentru sănătatea mintală pe care l-am așteptat cu toții.

Chatbots AI nepotriviți pentru stări grave de sănătate mintală

Primirea de sfaturi sensibile, aprobate de terapeut de la un chatbot de buzunar, va fi, fără îndoială, de ajutor pentru mulți. Cu toate acestea, cei care suferă de afecțiuni grave de sănătate mintală, cum ar fi depresia, schizofrenia și tulburarea bipolară, vor fi probabil lăsați pe scurt.

Tulburările mintale sunt complexe, puternic nuanțate și unice pentru fiecare persoană pe care o afectează. În unele cazuri, acestea sunt cel mai bine gestionate cu medicamente care pot fi prescrise corect numai de profesioniști medicali calificați. În timp ce modelele lingvistice mari (LLM) au evoluat vertiginos în ultimii ani, rezultatele lor nu vor putea niciodată să înlocuiască expertiza clinică, empatia și compasiunea oferite de psihiatri, psihologi și terapeuți.

„Apreciez că algoritmii s-au îmbunătățit, dar în cele din urmă nu cred că vor aborda realitățile sociale mai dezordonate în care se află oamenii atunci când caută ajutor”, – Julia Brown, profesor de antropologie la Universitatea din California, San Francisco

Vindecătorul psihic strategic Aanant Bisht crede, de asemenea, că AI, în starea sa actuală, va fi incapabil să ajute călătoria complexă de vindecare a fiecărui utilizator. „Este, de asemenea, esențial să se evite simplificarea excesivă a problemelor complexe de sănătate mintală și să încurajeze utilizatorii să caute ajutor profesional atunci când este necesar”, spune Bisht pentru Tech.co.

O altă îngrijorare comună exprimată de experții cu care am vorbit este diagnosticarea medicală greșită. Comunitatea de sănătate mintală are o problemă de lungă durată cu identificarea corectă a tulburărilor psihice complexe și severe, iar dependența puternică de AI ar putea exacerba această problemă, din cauza tehnologiilor limitate, a setului de date nereprezentativ și a incapacității de a interpreta nuanțele umane.

Rezultatele acestui lucru pot fi, de asemenea, dure. Diagnosticarea greșită a sănătății mintale duce adesea la tratament și sprijin inadecvat, presiuni mentale suplimentare și scepticism pe termen lung față de sistemul medical. Acesta nu este singurul motiv pentru care inteligența artificială nu este aptă să depășească scaunul terapeutului în forma sa actuală.

AI este defectuoasă și învăluită în provocări etice

Creșterea rapidă a IA generativă nu a venit fără consecințe. Pe măsură ce tehnologia continuă să se dezvolte cu o viteză vertiginoasă, reglementările în jurul utilizării sale au întârziat să ajungă din urmă, contribuind la un șir de provocări etice legate de confidențialitatea datelor, părtinire încorporată și utilizare abuzivă.

Aceste preocupări nu sunt unice pentru terapie, dar natura sensibilă a sănătății mintale înseamnă că cadrele etice sunt în centrul oricărei relații terapeutice bune. Cu un cod de etică oficial al AI inexistent în prezent, utilizatorii care se bazează pe chatbot în loc de profesioniști calificați pentru consiliere sau alt sprijin pentru sănătate mintală este extrem de problematic.

Confidențialitatea datelor este o problemă majoră. Chatboți precum ChatGPT s-au abătut frecvent în apă caldă pentru că nu au reușit să protejeze datele utilizatorilor . Pentru ca utilizatorii să se simtă confortabil să discute despre informații private, cu caracter personal, companiile de inteligență artificială vor trebui să aibă o strategie de protecție a datelor care să acorde prioritate confidențialității.

„Natura intimă și sensibilă a conversațiilor terapeutice necesită un nivel inegalabil de protecție a datelor.” – Dr. Langham, psiholog la Impulse Therapy

Un alt factor important de care trebuie să fii conștient este părtinirea învățării automate. Toate sistemele AI se bazează pe date de antrenament predeterminate, care includ adesea părtiniri umane încorporate, chiar dacă variabilele sensibile precum rasa și sexul sunt eliminate.

Potrivit lui Bayu Prihandito, CEO al companiei de coaching de viață Life Architekture , dacă AI este instruit pe date părtinitoare, „ar putea perpetua sau exacerba părtinirile existente, ducând la recomandări inechitabile de tratament”. Este posibil ca aceste prejudecăți încorporate să aibă un impact mai mare asupra persoanelor din grupurile minoritare, subliniind importanța supravegherii umane și a seturilor de date de formare diverse și reprezentative.

AI ca asistent al terapeuților, nu înlocuitor

Însoțitorii prietenoși precum Pi și Woebot vor crește doar în popularitate pe măsură ce utilizatorii continuă să caute modalități accesibile de a-și completa bunăstarea mentală. Cu toate acestea, din cauza unei game largi de preocupări etice, inteligența artificială nu este pregătită să înlocuiască rolul terapiei tradiționale și nici nu ar trebui să fie vreodată.

Acest lucru nu înseamnă însă că tehnologia emergentă nu va avea un impact masiv asupra practicii în ansamblu. Cei mai mulți dintre practicanții cu care am vorbit cred că, desfășurând lucrări groaznice, cum ar fi triajul, instrumentele AI le vor putea oferi mai mult timp și energie pentru a le pune în alte domenii ale practicii.

„Deși nu poate înlocui conexiunea umană profundă pe care o oferă terapeuții, poate servi ca un instrument complementar.” – Aanant Bish, antrenor psihic de afaceri

„AI ar putea gestiona evaluările inițiale, monitorizarea continuă și să ofere sprijin pentru cazuri mai puțin complexe, permițându-ne să ne concentrăm pe situații mai severe sau mai delicate”, a spus Bayu Prihandito pentru Tech.co, adăugând: „ Este ca și cum ai avea un set suplimentar de mâini care sunt întotdeauna disponibil."

Profesorul Columbia și psihiatru certificat Sultan este de acord, spunând Tech.co că în cinci ani, AI va completa probabil terapia tradițională prin eficientizarea sarcinilor administrative, ajutând practicienii să creeze planuri de tratament mai personalizate și „ creând modele hibride care combină expertiza umană cu AI- instrumente conduse pentru a îmbunătăți tratamentul”.

Acest lucru sugerează că departe de a epuiza practica umanității sale, AI are de fapt puterea de a elibera abilități umane precum empatia, conexiunea și compasiunea, ajutând clienții să beneficieze și mai mult de serviciu.

Cu toate acestea, îngrijirea sănătății mintale este o chestiune serioasă și poate fi adesea o chestiune de viață sau de moarte. Înainte ca AI să devină asistentul fiecărui terapeut sau, într-adevăr, să-i înlocuiască, trebuie luate în considerare reglementări stricte în ceea ce privește implementarea și utilizarea sa.

Până nu va ajunge un astfel de moment, potențialul clar al chatbot-urilor AI de a îmbunătăți accesul la asistență pentru sănătate mintală nu poate fi pe deplin conciliat cu riscurile pe care le prezintă. Într-o lume în care dilemele etice sunt adesea egale pentru curs, aceasta este pur și simplu prea mare pentru a fi ignorată.