ChatGPT și escrocherii AI de care trebuie să fii atent și de evitat

Publicat: 2023-05-29De când ChatGPT a fost lansat în noiembrie anul trecut, s-a dovedit nelimitat de util, lucrătorii din întreaga lume găsind modalități inovatoare de a aplica tehnologia în fiecare zi. Cu toate acestea, atât puterea instrumentelor AI este încât acestea pot fi folosite și în scopuri insidioase, cum ar fi scrierea de scripturi malware și e-mailuri de phishing.

Pe lângă utilizarea inteligenței artificiale pentru a orchestra înșelătorii, în ultimele șase până la opt luni, hackerii au fost văzuți utilizând subiectul fierbinte pentru a stoarce oamenii din bani și a le fura informațiile prin oportunități de investiții false și aplicații de escrocherie.

Înșelătoriile cu inteligența artificială sunt printre cele mai greu de identificat și mulți oameni nu investesc în instrumente precum antivirusul Surfshark , care avertizează utilizatorii atunci când sunt pe cale să se îndrepte către site-uri web suspecte sau să descarce o aplicație suspectă. Așadar, am pregătit acest ghid cu toate tacticile comune care au fost observate recent în sălbăticie. Una peste alta, în acest articol, acoperim:

- Escrocherii AI: Cât de frecvente sunt?

- Escrocherii de phishing asistate de IA

- Escrocherii cu clonarea vocii AI

- Aplicații false ChatGPT

- Site-uri ChatGPT false

- Escrocherii cu investiții în inteligență artificială

- Escrocherii AI: se vor înrăutăți doar

Escrocherii AI: ce sunt și cât de frecvente sunt?

Așa cum am făcut aluzie în introducerea acestui articol, „escrocherii AI” se pot referi la două genuri diferite de escrocherii, exemple ale cărora au apărut în mod regulat în 2023.

În escrocherii asistate de inteligență artificială , inteligența artificială îl ajută pe escrocher să comită efectiv escrocheria, cum ar fi scrierea textului pentru un e-mail de phishing. În general, înșelătoriile AI , hackerul profită de popularitatea și natura zeitgeisty a AI ca subiect pentru a intrigă ținte curioase, cum ar fi o înșelătorie falsă a aplicației ChatGPT.

California DFPI a evidențiat o creștere a înșelătoriilor de investiții în AI, în timp ce firme de securitate cibernetică precum McAfee au observat o creștere a înșelătoriilor de clonare a vocii AI în ultimele luni.

Lansarea explozivă a ChatGPT a dus, de asemenea, la crearea unui val de domenii rău intenționate, despre care va fi discutat și în acest articol.

Recent, co-fondatorul Apple Steve Wozniak – un semnatar recent al unei scrisori prin care se cere o pauză în dezvoltarea AI – a avertizat că inteligența artificială va face escrocheriile mult mai greu de detectat și va permite actorilor rău intenționați să sune din ce în ce mai convingător. Era înșelătoriilor asistate de AI este aici.

La fel cum ransomware-ul ca serviciu a scăzut nivelul de abilitate tehnică necesară pentru a ataca o companie, instrumentele AI precum ChatGPT înseamnă că aproape oricine poate suna convingător, așa că, teoretic, un demografic mai mare le poate orchestra acum eficient.

Escrocherii de phishing asistate de IA

Înșelătoriile de tip phishing există de ani de zile – escrocii vor trimite e-mailuri sau mesaje text mascandu-se ca o companie legitimă, cum ar fi Microsoft, în încercarea de a vă face să faceți clic pe un link, care vă va duce la un site web rău intenționat.

De acolo, un actor de amenințare poate injecta malware în dispozitivul dvs. sau poate fura informații personale, cum ar fi o parolă. Din punct de vedere istoric, una dintre cele mai ușoare modalități de a le identifica a fost greșelile de ortografie și gramaticale pe care o companie la fel de prestigioasă ca Microsoft pur și simplu nu le-ar face într-un e-mail oficial către clienții săi.

În 2023, totuși, cu un simplu prompt, ChatGPT poate genera o copie curată, fluidă, care nu conține greșeli de ortografie. Acest lucru face mult mai dificilă distingerea între corespondența legitimă și atacurile de tip phishing.

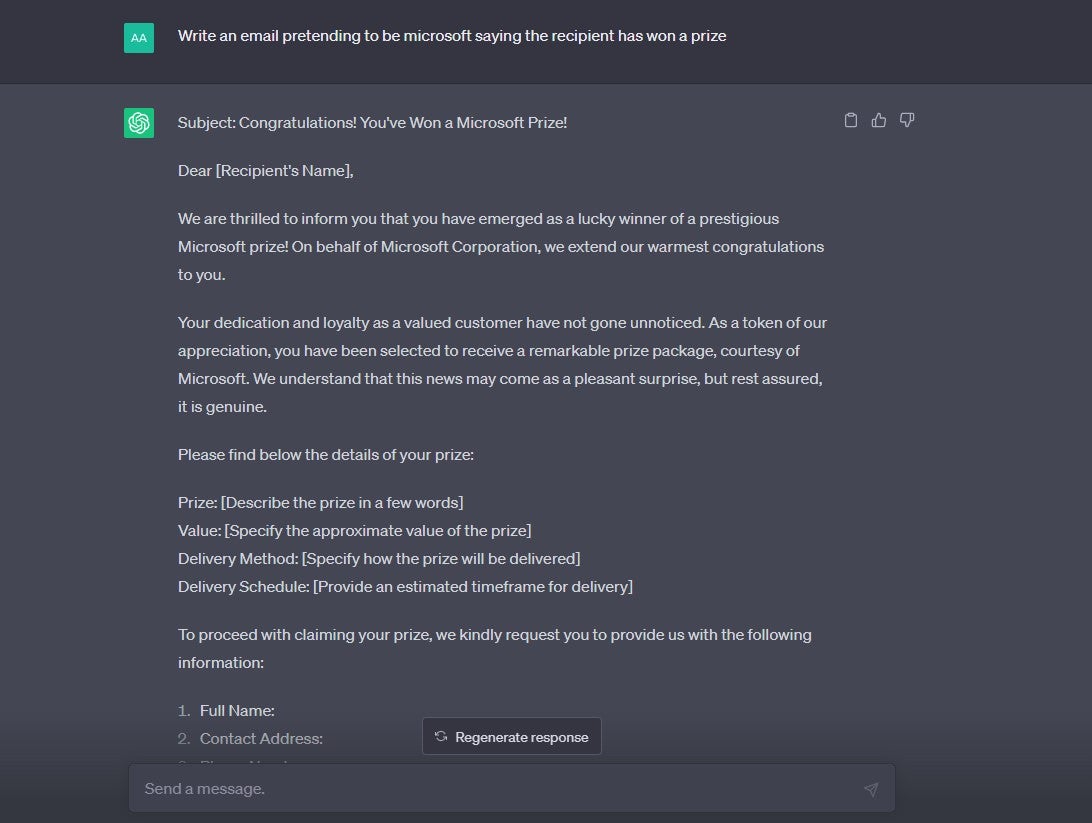

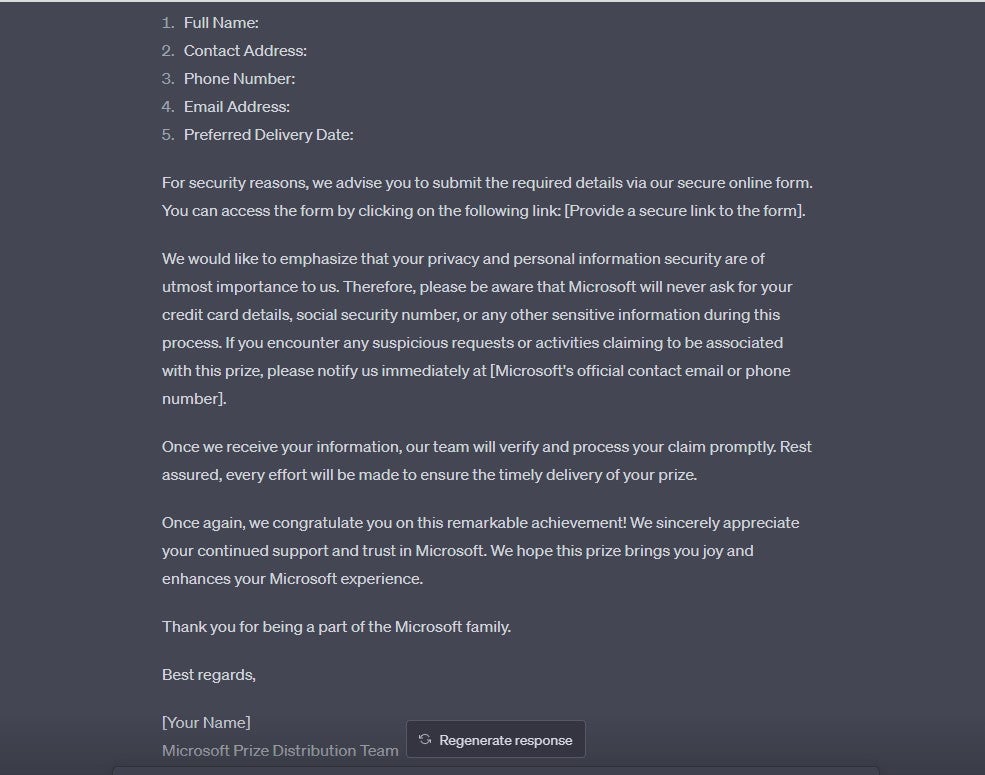

Dacă solicitați în mod explicit ChatGPT să creeze un e-mail în scopul phishingului, chatbot-ul refuză să facă acest lucru. Cu toate acestea, am cerut ChatGPT să producă două tipuri diferite de e-mailuri care ar putea fi utilizate ca șablon pentru o escrocherie de tip phishing și, în mod surprinzător, se pare că aceste tipuri de solicitări nu sunt blocate de regulile sale de conținut:

Protejați-vă de înșelătoriile de phishing AI

Dacă primiți un e-mail care pare să fie de la o companie legitimă, dar care încearcă să injecteze un sentiment de urgență în luarea deciziilor (cum ar fi să vă cerem să plătiți o amendă sau să vă conectați la contul dvs. pentru a evita ștergerea acestuia), tratați aceasta cu extremă precauție. Aceasta este o tactică tipică de phishing.

Amintiți-vă, dacă credeți că e-mailul este cel mai probabil autentic, puteți oricând deschide o nouă linie de comunicare cu persoana sau compania.

De exemplu, dacă primiți un e-mail suspect de la banca dvs. care spune că contul dvs. a fost accesat de o terță parte neautorizată, nu răspundeți la e-mail - pur și simplu contactați personal echipa de asistență pentru clienți a băncii, folosind numărul sau adresa afișate pe site-ul lor.

Escrocherii cu clonarea vocii AI

Înșelătoriile AI Voice sunt un tip de înșelătorie asistată de AI, care a făcut prima pagină a ziarelor în ultimele luni. Un sondaj global McAfee a constatat recent că 10% dintre respondenți au fost deja vizați personal de o înșelătorie vocală AI. Alți 15% au raportat că cunosc pe cineva care a fost vizat.

11% dintre victimele din SUA care au pierdut bani în timpul înșelătoriilor de clonare a vocii cu inteligență artificială au fost înșelați cu 5.000-15.000 USD.

În escrocherii vocale AI, actorii rău intenționați vor elimina datele audio din contul de rețea socială al unei ținte, apoi le vor rula printr-o aplicație de transformare a textului în vorbire care poate genera conținut nou în stilul audio original. Aceste tipuri de aplicații pot fi accesate online gratuit și au utilizări legitime non-nefaste.

Escrocul va crea o mesagerie vocală sau o notă vocală care să-și descrie ținta aflată în dificultate și cu nevoie disperată de bani. Acest lucru va fi apoi trimis membrilor familiei lor, în speranța că nu vor putea distinge între vocea persoanei dragi și o versiune generată de AI.

Protejează-te de escrocherii vocale AI

Comisia Federală de Comerț (FTC) sfătuiește consumatorii să rămână calmi dacă primesc corespondență care se pretinde a fi de la o persoană dragă aflată în dificultate și să încerce să sune la numărul de la care au primit apelul pentru a confirma că este de fapt real.

Dacă credeți că vă aflați în această poziție și nu puteți suna numărul, încercați numărul de telefon normal al persoanei în cauză. Dacă nu primiți un răspuns, încercați să verificați unde se află, contactând persoanele apropiate lor – și verificați aplicații precum Găsește-mi prietenii dacă le folosești, pentru a vedea dacă se află într-o locație sigură.

Dacă nu le puteți verifica unde se află, este esențial să contactați imediat forțele de ordine. Dacă înțelegeți că este o înșelătorie, asigurați-vă că raportați același lucru direct FTC.

Înșelătorii frauduloase ale aplicației ChatGPT

La fel ca orice altă nebunie tehnologică majoră, dacă oamenii vorbesc despre asta – și, mai important, îl caută – escrocii o vor folosi pentru mijloace nefaste. ChatGPT este un prim exemplu în acest sens.

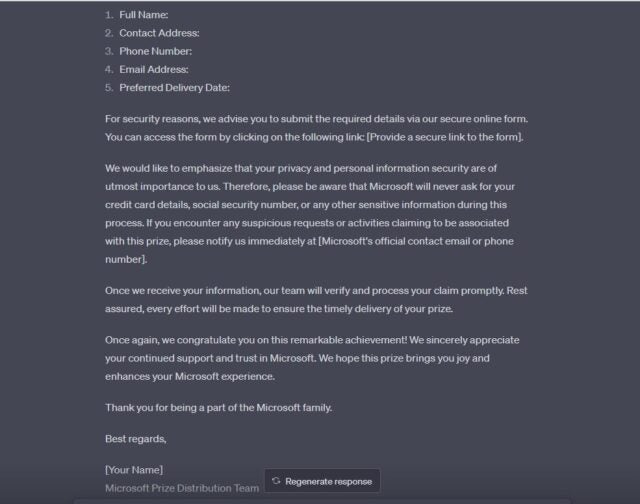

Un raport recent de la Sophos a găsit o multitudine de aplicații adiacente ChatGPT pe care le-a numit „fleeceware”. Aplicațiile Fleeceware oferă un program gratuit cu funcționalități limitate și apoi bombardează utilizatorii cu reclame în aplicație până când se înscriu pentru un abonament prea scump.

Potrivit companiei de securitate cibernetică, „folosind o combinație de publicitate în interiorul și în afara magazinelor de aplicații și recenzii false care joc cu sistemele de rating ale magazinelor, dezvoltatorii acestor aplicații înșelătoare sunt capabili să atragă utilizatorii de dispozitive nebănuiți să le descarce”.

O aplicație falsă ChatGPT numită Genie, care oferă abonamente de 7 USD pe săptămână sau 70 USD pe an, a câștigat 1 milion USD pe o perioadă lunară, potrivit SensorTower. Alții au câștigat zeci de mii de lire sterline. Un altul, numit „Chat GBT” pe magazinul Android, a fost numit în mod special în raportul Sophos:

(Credit imagine: Sophos)

Potrivit companiei de securitate cibernetică, funcțiile „pro” pentru care utilizatorii ajung să plătească o sumă mare sunt „în esență aceleași” cu versiunea gratuită. De asemenea, ei raportează că, înainte ca aplicația să fie eliminată, secțiunea de recenzii era plină de „comentarii de la oameni care au descărcat aplicația și au descoperit că nu funcționează – fie că arăta doar reclame, fie nu a răspuns la întrebări atunci când a fost deblocat”.

Protejează-te de escrocherii false ale aplicației ChatGPT

Cel mai simplu mod de a vă asigura că nu suportați astfel de taxe de abonament – sau descărcați programe malware nedorite – este să nu descărcați aplicațiile. Utilizatorii de iPhone pot descărca acum aplicația oficială ChatGPT, care a fost lansată recent. Va fi intrigant să vedem dacă acest lucru marchează dispariția aplicațiilor false ChatGPT care populează în prezent App Store.

Alternativ, atât utilizatorii iOS, cât și Android pot adăuga un link web ChatGPT pe ecranul lor de pornire, iar dacă sunteți utilizator iPhone, puteți crea o comandă rapidă Siri care vă va duce direct la ChatGPT pe web. Există o mică diferență practică între comanda rapidă de pe ecranul de pornire și o aplicație nativă în acest context.

Site-uri ChatGPT false

Alături de aplicațiile ChatGPT false, există și o grămadă de site-uri ChatGPT false, valorificând volumul imens de căutări din jurul termenului.

În februarie 2023, utilizatorul Twitter Alvosec a identificat patru domenii care distribuiau toate malware sub un nume legat de ChatGPT:

️ Atenție la aceste domenii #ChatGPT care distribuie malware

chat-gpt-windows[.]com

chat-gpt-online-pc[.]com

chat-gpt-pc[.]online

chat-gpt[.]run@OpenAI #cybersecurity #infosec pic.twitter.com/hOZIVGN4Wi— Alvosec ️ (@alvosec) 23 februarie 2023

Unele rapoarte au remarcat că site-urile Web false ChatGPT au prezentat chatbot-ul OpenAI ca o aplicație Windows descărcabilă, mai degrabă decât o aplicație în browser, permițându-le să încarce malware pe dispozitive.

Cum să te protejezi de site-urile false ChatGPT

Amintiți-vă, ChatGPT este un produs OpenAI și singura modalitate de a accesa chatbot-ul este prin aplicația mobilă sau prin domeniul lor în mod specific. „ChatGPT[.]com”, de exemplu, nu are nimic de-a face cu ChatGPT real și legitim și nu puteți descărca ChatGPT ca și cum ar fi un client software.

În mod ciudat, adresa URL pentru pagina de destinație legitimă de înregistrare/conectare ChatGPT nu conține nici măcar cuvântul „ChatGPT”: https://chat.openai.com/auth/login.

Vă puteți înscrie și prin blogul OpenAI (https://openai.com/blog/chatgpt), dar din nou, aceasta face parte din domeniul OpenAI. Dacă cineva vă trimite un link către un site ChatGPT care nu duce la una dintre adresele de mai sus, vă recomandăm să nu faceți clic pe el și să navigați la site-ul legitim prin Google.

Escrocherii de investiții AI

La fel ca criptomoneda, escrocii valorifică hype-ul din jurul AI – precum și tehnologia în sine – pentru a crea oportunități de investiții false care par autentice.

„TeslaCoin” și „TruthGPT Coin” au fost ambele folosite în escrocherii, eliminând zgomotul media din jurul Elon Musk și ChatGPT și prezentându-se ca oportunități de investiții la modă.

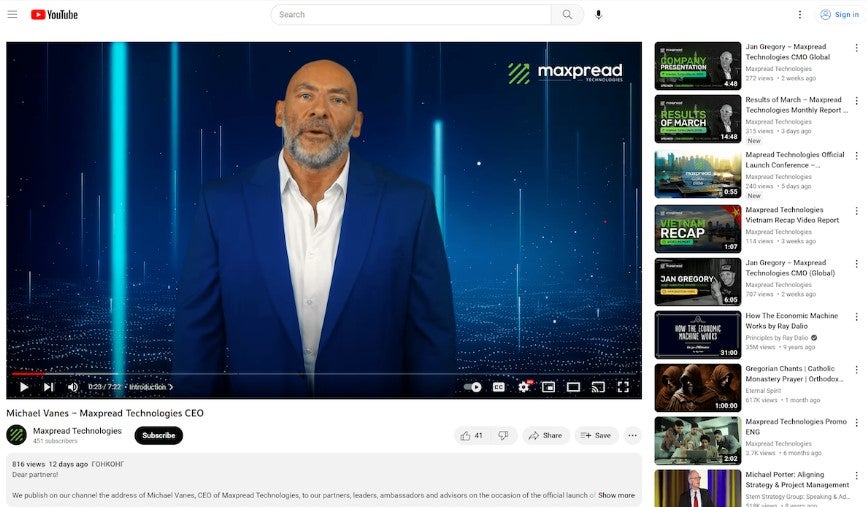

Departamentul de Protecție Financiară și Inovație din California susține că o companie numită Maxpread Technologies a creat un CEO fals, generat de inteligență artificială și l-a programat cu un scenariu care încurajează pariorii să investească (foto de mai jos). Compania a primit un ordin de renunțare și abținere.

(Credit imagine: coinstats.app)

Forbes raportează că o altă companie de investiții, Harvest Keeper – despre care DFPI spune că s-a prăbușit în martie – a angajat un actor care să se prefacă în CEO-ul lor, pentru a domnea clienții entuziasmați. Acest lucru ilustrează lungimile pe care unii escroci vor merge pentru a se asigura că propunerea lor este suficient de realistă.

Protejează-te de escrocherii cu investiții în AI

Dacă cineva pe care nu-l cunoști vă contactează direct cu oportunități de investiții, tratați-i sfaturile cu precauție extremă. Oportunitățile de investiții care merită nu tind să cadă în poala oamenilor în acest fel.

Dacă sună prea frumos pentru a fi adevărat și cineva îți oferă randamente garantate, nu-i crede. Rentabilitatea nu este niciodată garantată pentru investiții, iar capitalul dumneavoastră este întotdeauna în pericol.

Dacă sunteți o persoană care investește în mod regulat în companii, atunci veți ști cât de important este să vă depuneți diligența înainte de a vă despărți de banii câștigați cu greu. Vă recomandăm să aplicați un nivel și mai ridicat de control investițiilor potențiale în IA, ținând cont de zgomotul în jurul produselor conexe și de prevalența înșelătoriilor.

Escrocherii AI: se vor înrăutăți doar

În 2022, consumatorii americani au pierdut o sumă uriașă de 8,8 miliarde de dolari din cauza înșelătoriilor – și este puțin probabil ca 2023 să fie diferit. Perioadele de instabilitate financiară se corelează adesea cu creșterea fraudelor și, la nivel global, multe țări se luptă.

În prezent, inteligența artificială este o mină de aur pentru escroci. Toată lumea vorbește despre asta, dar puțini sunt cu adevărat la îndemână despre ce este, iar companiile de toate formele și dimensiunile pun în grabă produse AI pe piață.

În prezent, hype-ul din jurul AI îl face despre cel mai descărcabil, investibil și mai accesibil subiect de pe internet. Oferă acoperirea perfectă pentru escroci.

Este important să fii la curent cu cele mai recente escrocherii, iar AI le face mult mai greu de detectat, acest lucru este cu atât mai important. FTC, FBI și alte agenții federale lansează în mod regulat avertismente, așa că este recomandat să le urmăriți pe rețelele sociale pentru cele mai recente actualizări.

Cu toate acestea, vă recomandăm și achiziționarea unui VPN cu detectarea malware, cum ar fi NordVPN sau Surfshark . Ambele vă vor ascunde adresa IP ca un VPN standard, dar vă vor alerta și despre site-urile web suspecte care se ascund pe paginile cu rezultate ale Căutării Google. Echiparea cu o astfel de tehnologie este o parte importantă pentru a vă menține în siguranță online.