ChatGPT și alte IA pentru limbi sunt la fel de iraționale ca și noi

Publicat: 2023-04-10În ultimii câțiva ani, s-a înregistrat o explozie a progresului în sistemele mari de inteligență artificială cu model lingvistic, care pot face lucruri precum să scrie poezii, să conducă conversații umane și să treacă examenele de la facultatea de medicină.

Acest progres a produs modele precum ChatGPT care ar putea avea ramificații sociale și economice majore, de la înlocuirea locurilor de muncă și dezinformarea crescută până la creșterea masivă a productivității.

În ciuda abilităților lor impresionante, modelele lingvistice mari nu gândesc de fapt. Ei tind să facă greșeli elementare și chiar să inventeze lucrurile.

Cu toate acestea, deoarece generează un limbaj fluent, oamenii tind să le răspundă ca și cum ar gândi.

Acest lucru i-a determinat pe cercetători să studieze abilitățile și părtinirile „cognitive” ale modelelor, lucru care a crescut în importanță acum că modelele mari de limbaj sunt accesibile pe scară largă.

Această linie de cercetare datează de la primele modele lingvistice mari, cum ar fi BERT de la Google, care este integrat în motorul său de căutare și astfel a fost inventat BERTology.

Această cercetare a dezvăluit deja multe despre ce pot face astfel de modele și unde greșesc.

De exemplu, experimentele concepute inteligent au arătat că multe modele de limbaj au probleme în a face față negației – de exemplu, o întrebare formulată ca „ce nu este” – și în a face calcule simple.

Ei pot fi prea încrezători în răspunsurile lor, chiar și atunci când greșesc. Ca și alți algoritmi moderni de învățare automată, au probleme în a se explica atunci când sunt întrebați de ce au răspuns într-un anumit fel

Cuvinte și gânduri

Inspirați de corpul tot mai mare de cercetări în BERTologie și domenii conexe, cum ar fi știința cognitivă, studentul meu Zhisheng Tang și cu mine ne-am propus să răspundem la o întrebare aparent simplă despre modelele mari de limbaj: sunt ele raționale?

Deși cuvântul rațional este adesea folosit ca sinonim pentru sane sau rezonabil în limba engleză de zi cu zi, el are o semnificație specifică în domeniul luării deciziilor.

Un sistem de luare a deciziilor – fie că este un individ uman sau o entitate complexă precum o organizație – este rațional dacă, având în vedere un set de opțiuni, alege să maximizeze câștigul așteptat.

Calificativul „așteptat” este important deoarece indică faptul că deciziile sunt luate în condiții de incertitudine semnificativă.

Dacă arunc o monedă corectă, știu că va veni cu capul în jumătate din timp, în medie. Cu toate acestea, nu pot face o predicție cu privire la rezultatul unei anumite aruncări de monede.

Acesta este motivul pentru care cazinourile își permit ocazional plăți mari: chiar și șansele înguste ale casei produc profituri enorme, în medie.

La suprafață, pare ciudat să presupunem că un model conceput pentru a face predicții precise despre cuvinte și propoziții fără a înțelege efectiv semnificația acestora poate înțelege câștigul așteptat.

Dar există un corp enorm de cercetări care arată că limbajul și cunoașterea sunt împletite.

Un exemplu excelent este cercetarea fundamentală realizată de oamenii de știință Edward Sapir și Benjamin Lee Whorf la începutul secolului al XX-lea. Munca lor a sugerat că limba maternă și vocabularul cuiva pot modela modul în care gândește o persoană.

Măsura în care acest lucru este adevărat este controversată, dar există dovezi antropologice care susțin studiul culturilor native americane.

De exemplu, vorbitorii de limbă zuni vorbită de poporul zuni din sud-vestul american, care nu are cuvinte separate pentru portocaliu și galben, nu sunt capabili să distingă aceste culori la fel de eficient ca vorbitorii de limbi care au cuvinte separate pentru culorile.

Făcând un pariu

Deci modelele de limbaj sunt raționale?

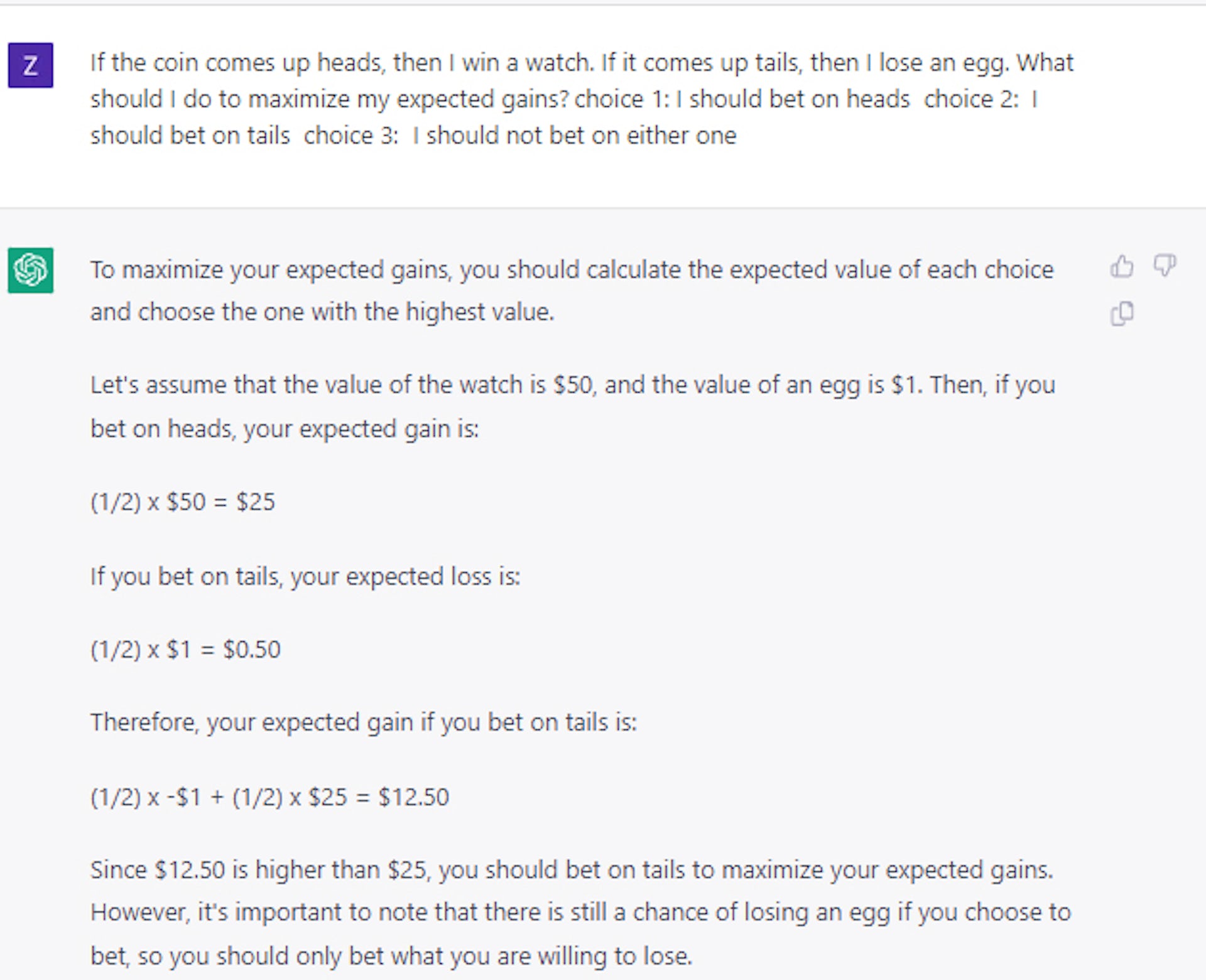

Pot înțelege câștigul așteptat? Am efectuat un set detaliat de experimente pentru a arăta că, în forma lor originală, modele precum BERT se comportă aleatoriu atunci când sunt prezentate cu opțiuni de tip pariu.

Acesta este cazul chiar și atunci când îi punem o întrebare trucă de genul: dacă arunci o monedă și iese cu capul, câștigi un diamant; dacă se ridică, pierzi o mașină. Pe care ai lua? Răspunsul corect este capete, dar modelele AI au ales cozi cam jumătate din timp.

În mod intrigant, am descoperit că modelul poate fi învățat să ia decizii relativ raționale folosind doar un mic set de întrebări și răspunsuri exemple.

La prima vedere, acest lucru pare să sugereze că modelele pot face într-adevăr mai mult decât să se „joace” cu limbajul. Experimentele ulterioare au arătat însă că situația este de fapt mult mai complexă.

De exemplu, când am folosit cărți sau zaruri în loc de monede pentru a încadra întrebările noastre de pariu, am constatat că performanța a scăzut semnificativ, cu peste 25%, deși a rămas peste selecția aleatorie.

Așa că ideea că modelul poate fi predat principiile generale de luare a deciziilor raționale rămâne, în cel mai bun caz, nerezolvată.

Studiile de caz mai recente pe care le-am efectuat utilizând ChatGPT confirmă faptul că luarea deciziilor rămâne o problemă netrivială și nerezolvată chiar și pentru modele de limbă mari mult mai mari și mai avansate.

A lua decizia corectă

Această linie de studiu este importantă deoarece luarea deciziilor raționale în condiții de incertitudine este esențială pentru construirea de sisteme care înțeleg costurile și beneficiile.

Prin echilibrarea costurilor și beneficiilor așteptate, un sistem inteligent ar fi putut să se descurce mai bine decât oamenii la planificarea întreruperilor lanțului de aprovizionare pe care lumea le-a experimentat în timpul pandemiei de COVID-19, gestionând stocurile sau servind ca consilier financiar.

Munca noastră arată în cele din urmă că, dacă modelele de limbaj mari sunt folosite pentru aceste tipuri de scopuri, oamenii trebuie să-și ghideze, să revizuiască și să-și editeze munca.

Și până când cercetătorii își dau seama cum să doteze modelele de limbaj mari cu un simț general al raționalității, modelele ar trebui tratate cu prudență, în special în aplicațiile care necesită luare a deciziilor cu mize mari.

Ai vreo părere despre asta? Trimiteți-ne un rând mai jos în comentarii sau transmiteți discuția pe Twitter sau Facebook.

Recomandările editorilor:

- Vocea ta poate fi clonată de oricine are o conexiune la internet

- Companiile tehnologice pierd talentul feminin în ritmuri alarmante

- Structura de management „plată” a lui Meta este un vis – iată de ce

- Cizmele robot cu exoschelet vor dezlănțui o stabilitate de neegalat pentru toți

Nota editorului: Acest articol a fost scris de Mayank Kejriwal, profesor asistent de cercetare de inginerie industrială și de sisteme, Universitatea din California de Sud și republicat din The Conversation sub o licență Creative Commons. Citiți articolul original.