Мошенничество с клонированием голоса ИИ: каждый четвертый взрослый уже стал жертвой

Опубликовано: 2023-05-02Как вы думаете, сможете ли вы отличить голосовую почту от кого-то, кого вы любите, от голосовой почты, созданной ИИ? Что ж, мошенники, использующие технологию клонирования голоса ИИ для обмана ничего не подозревающих жертв, конечно же, надеются, что вы не сможете — и сейчас они более активны, чем когда-либо.

Опрос, недавно проведенный McAfee, показал, что четверть взрослых уже стали жертвами голосового мошенничества с искусственным интеллектом, в результате чего подавляющее большинство потеряло с трудом заработанные деньги. Выяснилось также, что большинство взрослых делятся своим мнением в социальных сетях и других онлайн-пространствах не реже одного раза в неделю, что дает злоумышленникам именно то, что им нужно для повторения такого рода мошенничества снова и снова.

Итак, как на самом деле работает мошенничество с клонированием голоса ИИ, насколько оно распространено и как вы можете обнаружить мошенничество с клонированием голоса ИИ? Смотрим поближе.

- Что такое мошенничество с клонированием голоса ИИ?

- Как на самом деле работает клонирование голоса ИИ

- Насколько распространены мошенничества с голосовыми клонами AI?

- Как узнать, является ли сообщение мошенническим голосовым клоном AI

Что такое мошенничество с клонированием голоса ИИ?

Мошенничество с клонированием голоса ИИ — это любое мошенничество, в котором используются искусственно сгенерированные аудиофайлы, чтобы обмануть жертв, заставив их думать, что их близкие находятся в опасности или нуждаются в срочной финансовой помощи, и обратились к ним за помощью.

В мошенничестве такого рода мошенник запускает клип субъекта, говорящего — часто скопированный из социальных сетей — через генератор голоса ИИ. Используя машинное обучение, генератор проанализирует частоту, тон и высоту исходного клипа, а затем позволит мошеннику создать уникальный оригинальный звук, который почти идеально имитирует голос субъекта.

Затем мошенник отправит эти записи друзьям и родственникам жертвы через такие приложения, как WhatsApp, надеясь, что они не смогут отличить любимого человека от созданной искусственным интеллектом версии его голоса.

Как и в случае с другими онлайн-мошенничествами , мошенник попытается придать своей переписке ощущение безотлагательности и беспокойства, чтобы подтолкнуть цель к необдуманным или беспорядочным действиям.

В одном недавнем случае мошенник с искусственным интеллектом пытался убедить мать в США, что ее дочь была похищена, путем клонирования голоса ребенка.

Кстати, начинающему мошеннику не составит труда найти аудиофайлы, которые ему понадобятся, чтобы нацелиться на жертву — на самом деле, они, скорее всего, будут избалованы выбором.

Опрос, опубликованный McAfee в мае 2023 года с участием более 7000 человек из семи разных стран, показал, что 53% респондентов заявили, что делятся своим мнением в Интернете не реже одного раза в неделю. В Индии этот показатель составил 86%.

Как на самом деле работает клонирование голоса

Клонирование голоса ИИ возможно только с помощью инструмента ИИ, называемого генератором голоса ИИ. Вкратце, генераторы голоса ИИ превращают текстовые файлы в речь (часто называемые инструментом «текст в речь» или «TTS»).

Генераторы голоса ИИ используют машинное обучение, чтобы научиться говорить определенным образом, анализируя информацию из аудиофайлов говорящих людей. Затем генераторы применяют полученные знания для чтения текстовых файлов, предоставленных пользователями, и генерируют оригинальный аудиоконтент.

У многих из этих генераторов есть собственные голоса, которые вы можете выбрать для чтения текста, а также голоса знаменитостей на выбор, но другие позволяют вам записывать свой собственный голос и создавать последующий аудиоконтент.

Инструмент преобразования текста в речь Descript.com предлагает самопровозглашенный «современный генератор голоса, который создает ультрареалистичный клон вашего собственного голоса».

Голосовые генераторы AI теперь широко доступны для всех типов устройств. Эти программы приносят большую пользу людям, которые испытывают трудности с чтением или просто лучше учатся, слушая аудио, а не читая написанное.

Они также используются рекламными компаниями, у которых нет бюджета, чтобы нанять дорогого озвучивателя для своего маркетингового контента.

Успех и широкое использование ChatGPT вновь привлекли внимание к инструментам искусственного интеллекта всех форм и размеров, включая те, которые можно использовать для клонирования аудио. Несмотря на их благородное использование, в настоящее время существует небольшая экосистема инструментов искусственного интеллекта TTS, которыми, к сожалению, можно злоупотреблять в гнусных целях, включая мошенничество.

Насколько распространены мошенничества с голосовыми клонами AI?

В недавно опубликованном опросе McAfee гигант кибербезопасности обнаружил, что каждый четвертый опрошенный взрослый сталкивался с голосовым мошенничеством с помощью ИИ.

77% пострадавших сообщили, что потеряли деньги из-за мошенничества. McAfee сообщает, что из этих 77% «более трети потеряли более 1000 долларов, а 7% были обмануты на сумму от 5000 до 15000 долларов».

Опрос показывает, что жертвы в США теряют больше всего. 11% жертв в США, которые потеряли деньги из-за мошенничества с клонированием голоса ИИ, потеряли от 5000 до 15000 долларов.

Как узнать, является ли сообщение мошенническим клонированием голосового ИИ

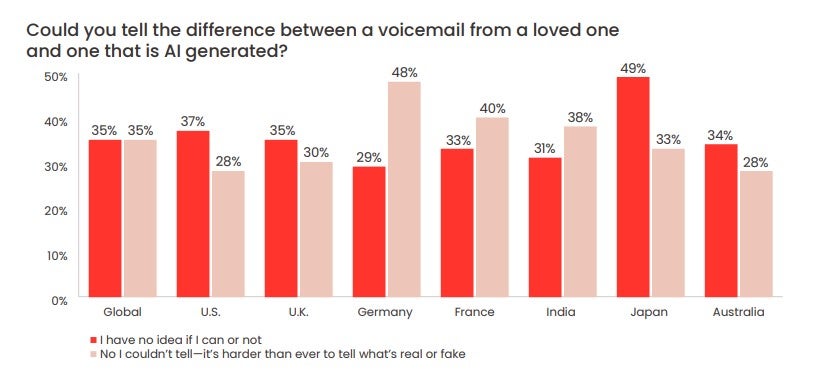

Опрос McAfee также показал, что 70% людей заявили, что они «не уверены», смогут ли они отличить голос ИИ от человеческого.

Почти треть (28%) респондентов из США заявили, что не смогут отличить голосовое сообщение, оставленное «искусственным самозванцем», как выражается McAfee, от сообщения любимого человека.

Помните, что мошенники могут воспроизвести голос любимого человека, но получить контроль над номером любимого человека или учетной записью WhatsApp намного сложнее.

Может быть трудно вести себя спокойно, когда звучит так, будто кто-то из ваших родственников или друзей в беде. Но поскольку голосовое мошенничество с искусственным интеллектом становится все более распространенным явлением, важно, чтобы вы это сделали. Есть несколько признаков того, что голосовое сообщение ИИ может быть мошенническим:

- Необычный способ связи (например, неизвестный номер)

- Немедленные запросы на большие суммы денег

- Запросы на перевод денег необычным способом (например, подарочные карты или криптовалюта)

- Требование никому не рассказывать о звонке/происшествии

Имея это в виду, вот что FTC советует вам делать:

- Позвоните по номеру, который оставил вам сообщение, чтобы проверить, кто это

- Позвоните любимому человеку или другу на личный номер

- Сообщение семье и близким друзьям человека, о котором идет речь

Если вы не можете установить контакт, важно, чтобы вы немедленно сообщили в правоохранительные органы. Для тех из вас, кто еще не стал жертвой одного из этих мошенников, но хочет убедиться, что вы не станете его жертвой, установите стоп-слово со своей семьей и друзьями.

Это код, который означает, что вы и ваши близкие можете идентифицировать себя друг с другом, является одним из лучших способов гарантировать, что вы не станете жертвой голосового мошенничества с искусственным интеллектом. Это будет особенно полезно для пожилых членов семьи, и если это никогда не будет записано, это может быть довольно просто.

Также важно быть в курсе последних методов, приемов и форматов, которые голосовые мошенники используют для вымогательства у жертв. Наряду с бдительностью и крайней осторожностью в отношении звонков с неизвестных номеров, держать ухо востро — часто лучшее, что вы можете сделать.