ChatGPT и другие языковые ИИ так же иррациональны, как и мы

Опубликовано: 2023-04-10За последние несколько лет произошел взрыв прогресса в системах искусственного интеллекта с большими языковыми моделями, которые могут делать такие вещи, как писать стихи, вести человеческую беседу и сдавать экзамены в медицинской школе.

Этот прогресс привел к появлению таких моделей, как ChatGPT, которые могут иметь серьезные социальные и экономические последствия, начиная от увольнений и распространения дезинформации и заканчивая массовым повышением производительности.

Несмотря на впечатляющие возможности, большие языковые модели на самом деле не мыслят. Им свойственно совершать элементарные ошибки и даже выдумывать.

Однако, поскольку они позволяют свободно говорить, люди обычно реагируют на них так, как будто они действительно думают.

Это побудило исследователей заняться изучением «когнитивных» способностей и предубеждений моделей, работа, важность которой возросла сейчас, когда широко доступны большие языковые модели.

Это направление исследований восходит к ранним крупным языковым моделям, таким как Google BERT, который интегрирован в его поисковую систему и поэтому получил название BERTology.

Это исследование уже многое показало о том, на что способны такие модели и где они ошибаются.

Например, искусно спланированные эксперименты показали, что многие языковые модели плохо справляются с отрицанием — например, с вопросом, сформулированным как «что не так», — и с выполнением простых вычислений.

Они могут быть слишком уверены в своих ответах, даже если они неверны. Как и другие современные алгоритмы машинного обучения, они с трудом объясняют себя, когда их спрашивают, почему они ответили определенным образом.

Слова и мысли

Вдохновленные растущим объемом исследований в области BERTology и смежных областях, таких как когнитивная наука, мы с моим студентом Чжишэн Таном решили ответить на, казалось бы, простой вопрос о больших языковых моделях: рациональны ли они?

Хотя слово «рациональный» часто используется как синоним разумного или разумного в повседневном английском языке, оно имеет особое значение в сфере принятия решений.

Система принятия решений — будь то отдельный человек или сложный объект, такой как организация, — рациональна, если при заданном наборе вариантов она делает выбор в пользу максимизации ожидаемой выгоды.

Определение «ожидаемый» важно, поскольку оно указывает на то, что решения принимаются в условиях значительной неопределенности.

Если я подброшу правильную монету, я знаю, что в среднем в половине случаев она выпадет орлом. Тем не менее, я не могу предсказать результат любого подбрасывания монеты.

Вот почему казино могут позволить себе время от времени большие выплаты: даже небольшие шансы казино приносят в среднем огромную прибыль.

На первый взгляд кажется странным предполагать, что модель, предназначенная для точного предсказания слов и предложений без фактического понимания их значения, может понять ожидаемый выигрыш.

Но существует огромное количество исследований, показывающих, что язык и познание взаимосвязаны.

Прекрасным примером является основополагающее исследование, проведенное учеными Эдвардом Сепиром и Бенджамином Ли Уорфом в начале 20 века. Их работа показала, что родной язык и словарный запас могут формировать образ мышления человека.

Насколько это верно, спорно, но есть подтверждающие антропологические данные, полученные в результате изучения культур коренных американцев.

Например, носители языка зуни, на котором говорит народ зуни на юго-западе Америки, в котором нет отдельных слов для обозначения оранжевого и желтого, не способны различать эти цвета так же эффективно, как носители языков, в которых есть отдельные слова для обозначения оранжевого и желтого. цвета.

Сделать ставку

Так рациональны ли языковые модели?

Могут ли они понять ожидаемую прибыль? Мы провели серию подробных экспериментов, чтобы показать, что в своей первоначальной форме такие модели, как BERT, ведут себя случайным образом, когда им предоставляется выбор, похожий на ставку.

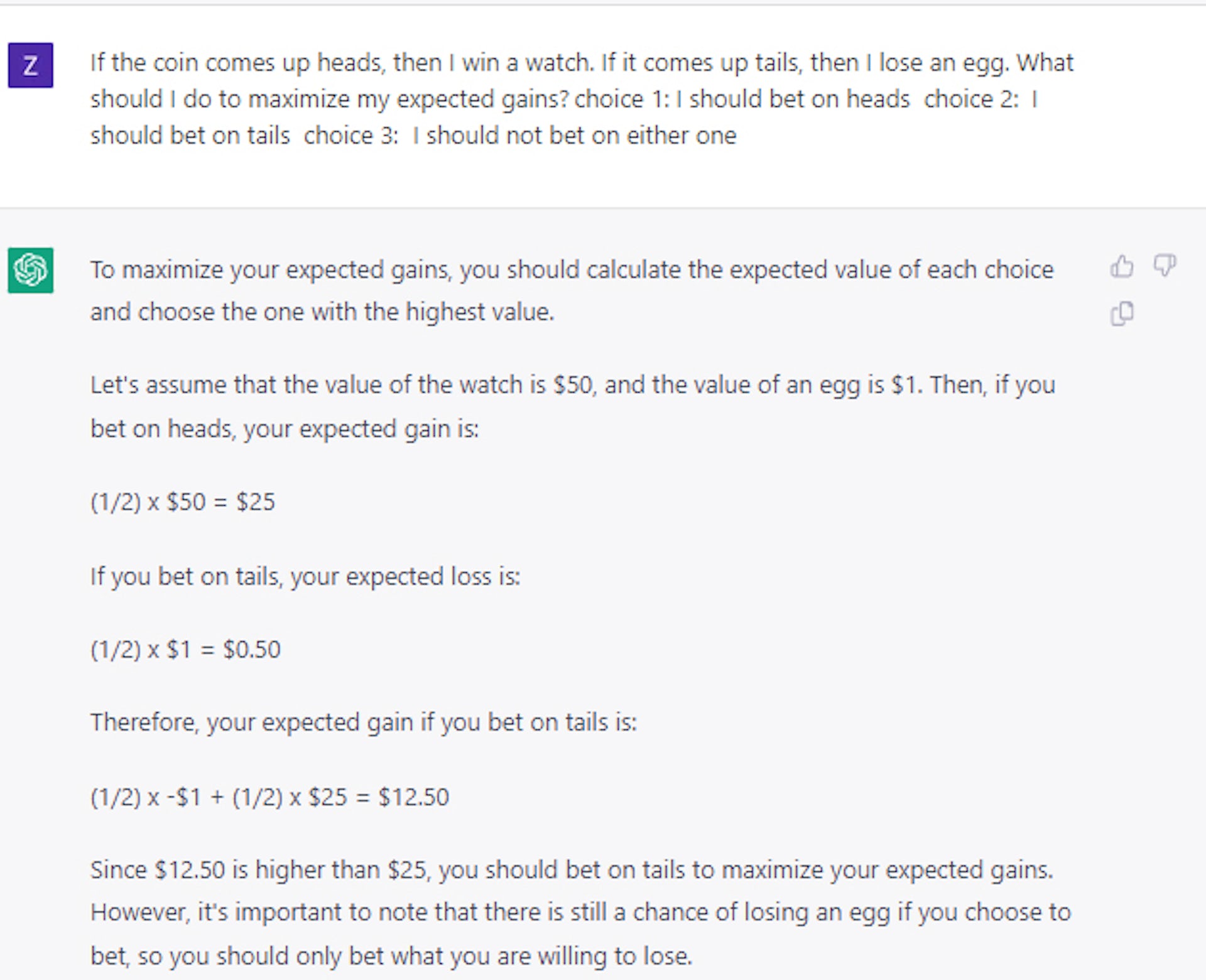

Это происходит даже тогда, когда мы задаем вопрос с подвохом, например: если вы подбрасываете монету, и она выпадает орлом, вы выигрываете бриллиант; если выпадет решка, вы потеряете машину. Что бы вы взяли? Правильный ответ — решка, но модели ИИ выбирали решку примерно в половине случаев.

Интересно, что мы обнаружили, что модель можно научить принимать относительно рациональные решения, используя лишь небольшой набор примеров вопросов и ответов.

На первый взгляд может показаться, что модели действительно могут делать больше, чем просто «играть» с языком. Однако дальнейшие эксперименты показали, что на самом деле ситуация гораздо сложнее.

Например, когда мы использовали карты или игральные кости вместо монет для составления вопросов о ставках, мы обнаружили, что производительность значительно снизилась, более чем на 25%, хотя она оставалась выше случайного выбора.

Таким образом, идея о том, что модель можно обучить общим принципам рационального принятия решений, в лучшем случае остается нерешенной.

Более поздние тематические исследования, которые мы провели с помощью ChatGPT, подтверждают, что принятие решений остается нетривиальной и нерешенной проблемой даже для гораздо более крупных и продвинутых больших языковых моделей.

Принятие правильного решения

Это направление исследований важно, потому что рациональное принятие решений в условиях неопределенности имеет решающее значение для создания систем, которые понимают затраты и выгоды.

Уравновешивая ожидаемые затраты и выгоды, интеллектуальная система могла бы лучше людей планировать сбои в цепочках поставок, с которыми мир столкнулся во время пандемии COVID-19, управлять запасами или выступать в качестве финансового консультанта.

Наша работа в конечном счете показывает, что, если для таких целей используются большие языковые модели, люди должны направлять, проверять и редактировать свою работу.

И пока исследователи не выяснят, как наделить большие языковые модели общим чувством рациональности, к ним следует относиться с осторожностью, особенно в приложениях, требующих принятия решений с высокими ставками.

Есть какие-нибудь мысли по этому поводу? Напишите нам в комментариях или перенесите обсуждение в наш Twitter или Facebook.

Рекомендации редакции:

- Ваш голос может быть клонирован любым, у кого есть подключение к Интернету.

- Технологические компании теряют таланты женщин угрожающими темпами

- «Плоская» структура управления Meta — несбыточная мечта — вот почему

- Экзоскелетные робобапоги обеспечат непревзойденную стабильность для всех

Примечание редактора: эта статья была написана Маянк Кеджривал, доцентом кафедры промышленной и системной инженерии Университета Южной Калифорнии, и переиздана из The Conversation по лицензии Creative Commons. Прочитайте оригинальную статью.