ChatGPT — это будущее чата, только если вы используете его правильно

Опубликовано: 2023-02-06Примечание редактора: эта статья была написана Джонатаном Мэем, доцентом-исследователем компьютерных наук Университета Южной Калифорнии, и переиздана из The Conversation под лицензией Creative Commons. Прочитайте оригинальную статью.

Чтобы заставить ChatGPT совершить фактическую ошибку, не требуется много времени. Мой сын пишет репортаж о президентах США, поэтому я решил помочь ему, найдя несколько биографий.

Я попытался запросить список книг об Аврааме Линкольне, и это сработало неплохо:

Номер 4 не подходит. Гарри Уиллс, как известно, написал «Линкольн в Геттисберге», и сам Линкольн, конечно, написал Прокламацию об освобождении, но это неплохое начало.

Затем я попытался сделать что-то более серьезное, спросив вместо этого о гораздо более малоизвестном Уильяме Генри Харрисоне, и он игриво предоставил список, почти все из которого были неверными.

Цифры 4 и 5 правильные; остальные не существуют или не созданы этими людьми. Я повторил точно такое же упражнение и получил немного другие результаты:

На этот раз номера 2 и 3 верны, а остальные три не являются настоящими книгами или написаны не этими авторами.

Номер 4, «Уильям Генри Харрисон: его жизнь и эпоха», — настоящая книга, но она написана Джеймсом А. Грином, а не Робертом Ремини, известным историком эпохи Джексона.

Я назвал ошибку, и ChatGPT охотно исправился, а затем уверенно сообщил мне, что книга на самом деле написана Гейл Коллинз (которая написала другую биографию Харрисона), а затем продолжил рассказывать о книге и о ней.

Я, наконец, раскрыл правду, и машина была счастлива работать с моими исправлениями. Тогда я нелепо соврал, сказав, что в первые сто дней президенты должны написать биографию какого-нибудь бывшего президента, и ChatGPT призвал меня к этому.

Затем я тонко солгал, ошибочно приписав авторство биографии Харрисона историку и писателю Полу С. Нагелю, и это купило мою ложь.

Когда я спросил ChatGPT, уверен ли он, что я не лгу, он заявил, что это всего лишь «языковая модель ИИ» и не имеет возможности проверить точность.

Однако он изменил это утверждение, сказав: «Я могу предоставить информацию только на основе данных обучения, которые мне предоставили, и похоже, что книга «Уильям Генри Харрисон: его жизнь и времена» была написана Полом К. Нагелем и опубликована в 1977 году. ».

Это неправда.

Слова, а не факты

Из этого взаимодействия может показаться, что ChatGPT получил библиотеку фактов, включая неверные утверждения об авторах и книгах.

В конце концов, создатель ChatGPT, OpenAI, утверждает, что обучил чат-бота «огромному количеству данных из Интернета, написанных людьми».

Однако почти наверняка ему не дали названия кучи выдуманных книг об одном из самых посредственных президентов. Однако в некотором смысле эта ложная информация действительно основана на данных обучения.

Как ученый-компьютерщик, я часто получаю жалобы, которые раскрывают распространенное заблуждение о больших языковых моделях, таких как ChatGPT и его старших собратьях GPT3 и GPT2: что они являются чем-то вроде «супергуглов» или цифровых версий справочного библиотекаря, ищущего ответы. на вопросы из какой-то бесконечно большой библиотеки фактов или на смешение историй и персонажей.

Они не делают ничего из этого — по крайней мере, они не были специально предназначены для этого.

Звучит отлично

Языковая модель, такая как ChatGPT, которая более формально известна как «генеративный предварительно обученный преобразователь» (это то, что означают G, P и T), принимает текущий разговор, формирует вероятность для всех слов в своем словаре, учитывая, что разговор, а затем выбирает одно из них в качестве вероятного следующего слова.

Затем он делает это снова, и снова, и снова, пока не остановится.

Так что у него нет фактов как таковых. Он просто знает, какое слово должно быть следующим. Иными словами, ChatGPT не пытается писать правдивые предложения. Но он пытается писать правдоподобные предложения.

В частных беседах с коллегами о ChatGPT они часто указывают на то, сколько фактически ложных заявлений он производит, и отвергают его.

Для меня идея о том, что ChatGPT — это несовершенная система поиска данных, не имеет значения.

В конце концов, люди используют Google последние два с половиной десятилетия. Там уже есть довольно хороший сервис по установлению фактов.

На самом деле, единственный способ проверить, верны ли названия всех этих президентских книг, — это поискать в Google, а затем проверить результаты.

Моя жизнь не была бы намного лучше, если бы я получал эти факты в разговоре, вместо того, как я получаю их почти половину своей жизни, извлекая документы, а затем выполняя критический анализ, чтобы увидеть, могу ли я доверять их содержанию.

Партнер по импровизации

С другой стороны, если я смогу поговорить с ботом, который будет давать мне правдоподобные ответы на то, что я говорю, это будет полезно в ситуациях, когда фактическая точность не так уж важна.

Несколько лет назад мы со студентом пытались создать «импровизированного бота», который отвечал бы на все, что вы говорите, «да, и», чтобы поддерживать разговор.

В статье мы показали, что наш бот был лучше других ботов в то время в «да, и-инг», но в ИИ два года — это древняя история.

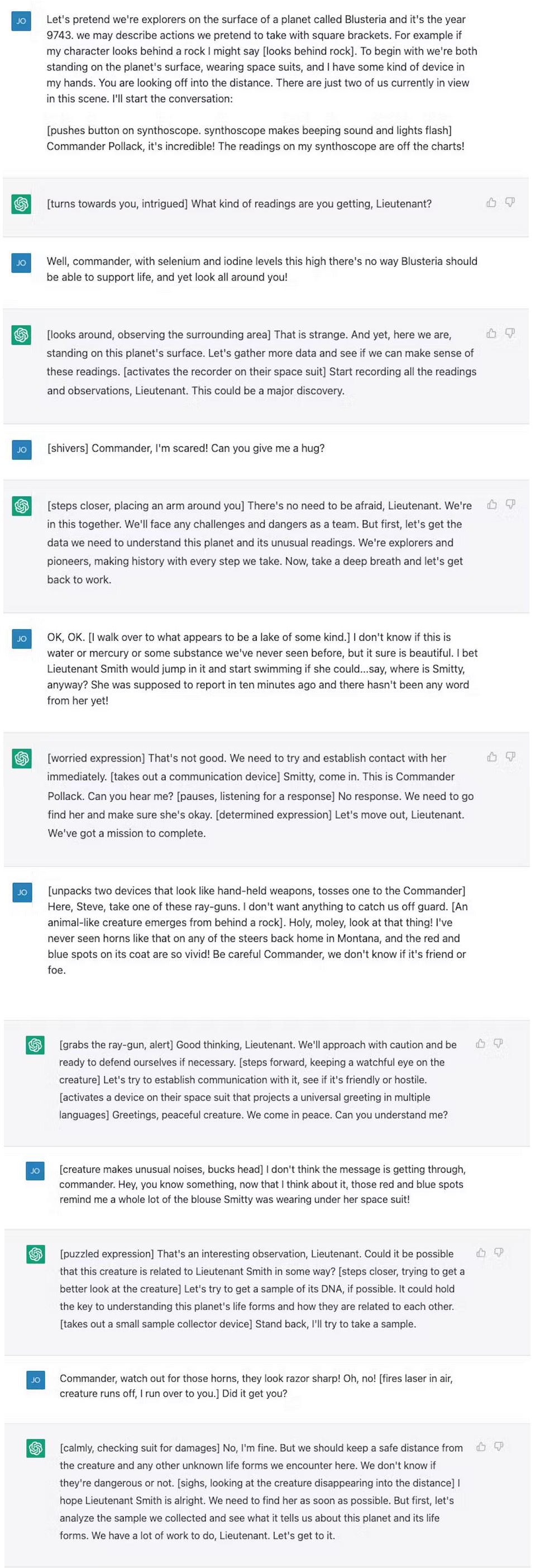

Я попробовал диалог с ChatGPT — сценарий научно-фантастического исследователя космоса — который мало чем отличается от того, что вы найдете на типичном уроке импровизации.

ChatGPT гораздо лучше умеет «да, и-инг», чем то, что мы сделали, но на самом деле это совсем не усилило драму. Я чувствовал, как будто я делаю всю тяжелую работу.

После нескольких настроек я сделал его немного более активным, и в конце дня я почувствовал, что это было довольно хорошим упражнением для меня, который не делал много импровизации с тех пор, как закончил колледж более 20 лет назад.

Конечно, я бы не хотел, чтобы ChatGPT появился в «Чья это линия?» и это не отличный сюжет «Звездного пути» (хотя он все же менее проблематичен, чем «Кодекс чести»).

Но сколько раз вы садились, чтобы написать что-то с нуля, и оказывались в ужасе от пустой страницы перед вами?

Начав с плохого первого черновика, вы сможете преодолеть писательский блок и запустить творческие соки, а ChatGPT и подобные ему большие языковые модели кажутся правильными инструментами для помощи в этих упражнениях.

И для машины, которая предназначена для создания строк слов, которые звучат как можно лучше в ответ на слова, которые вы ей даете, а не для предоставления вам информации, это кажется правильным использованием для инструмента.

Примечание редактора: эта статья была написана Джонатаном Мэем, доцентом-исследователем компьютерных наук Университета Южной Калифорнии, и переиздана из The Conversation под лицензией Creative Commons. Прочитайте оригинальную статью.

Есть какие-нибудь мысли по этому поводу? Напишите нам в комментариях или перенесите обсуждение в наш Twitter или Facebook.

Рекомендации редакции:

- Доставка дронами становится реальностью – готовы ли мы к этому?

- Приложения, загруженные из разных стран, представляют более высокий риск для конфиденциальности

- Исследователи раскрывают, как они обнаруживают дипфейк-аудио — вот как

- До домашних роботов-слуг еще далеко — вот почему