เหตุใดแชทบอทบำบัดด้วย AI จึงเป็นประเด็นที่กลืนไม่เข้าคายไม่ออกทางจริยธรรมขั้นสูงสุด

เผยแพร่แล้ว: 2023-10-31แชทบอท AI เจนเนอเรชั่น เช่น ChatGPT กำลังถูกใช้เพื่อปรับปรุงกระบวนการในที่ทำงาน เขียนโค้ด และแม้แต่เขียนสคริปต์สำหรับชุดสแตนด์อัพคอมเมดี้ ในสหรัฐอเมริกา ซึ่งกรณีของความวิตกกังวลและภาวะซึมเศร้าพุ่งสูงสุดเป็นประวัติการณ์ และการสนับสนุนจากผู้เชี่ยวชาญยังคงขยายออกไป ไม่น่าแปลกใจเลยที่ผู้ใช้ใช้เทคโนโลยีนี้เพื่อช่วยจัดการสุขภาพจิตของตน

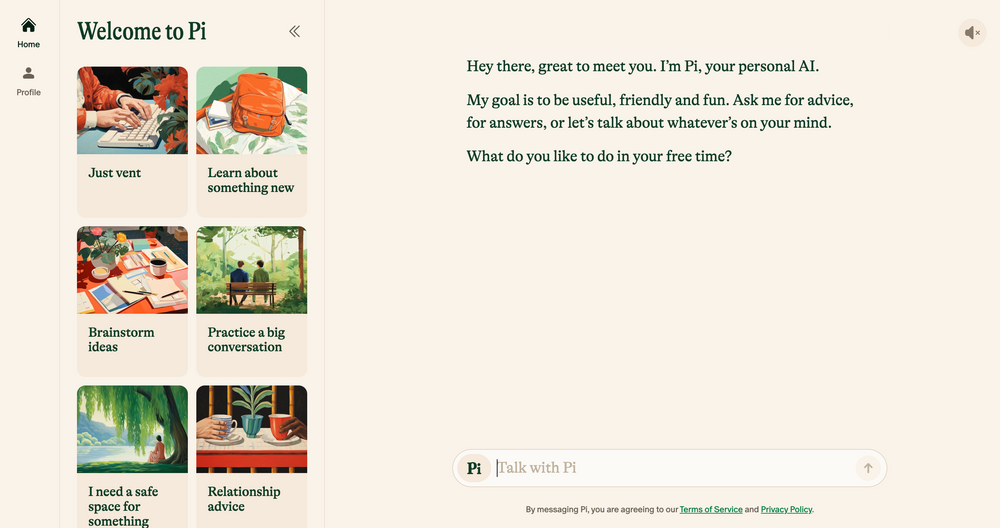

แชทบอท AI เช่น Elomia, Pi และ Woebot ให้การสนับสนุนราคาไม่แพงและเป็นส่วนตัวตลอด 24 ชั่วโมงทุกวัน โดยอิงตามเทคนิคการบำบัดที่ผ่านการทดลองและทดสอบแล้ว ตั้งแต่การช่วยให้ผู้ใช้ไม่ต้องรอรายการรอนานไปจนถึงการลดความอัปยศในการเข้าถึงความช่วยเหลือ ประโยชน์ของพวกเขามีมากมาย AI กำเนิดซึ่งยังคงมีแนวโน้มที่จะเกิดข้อผิดพลาด ภาพหลอน และ อคติ จะสามารถเปรียบเทียบกับความเห็นอกเห็นใจของหูมนุษย์ได้หรือไม่

เราได้พูดคุยกับนักวิชาการ นักจิตวิทยา และนักบำบัดเพื่อทำความเข้าใจว่าเทคโนโลยีที่เกิดขึ้นใหม่มีแนวโน้มที่จะกำหนดอนาคตของการบำบัดอย่างไร นอกจากนี้เรายังหารือถึงด้านที่ร่มรื่นกว่าของการบำบัดด้วย AI และระบุว่าข้อกังวลด้านจริยธรรมใดที่ต้องได้รับการแก้ไขในวันนี้ นี่คือสิ่งที่เราพบ

AI Chatbots: นักบำบัดหุ่นยนต์รุ่นใหม่

นับตั้งแต่แชทบอต ChatGPT ของ OpenAI เปิดตัวครั้งแรกเมื่อเดือนพฤศจิกายนปีที่แล้ว กองทัพผู้ลอกเลียนแบบแชทบอทจำนวนมากได้ขยายออกไปในร้านแอป ตั้งแต่แอปใช้งานทั่วไป เช่น Google Bard และ Claude AI ไปจนถึงโปรแกรมจำลองตัวละคร Marvel ทั่วไป

ตลาดที่กำลังขยายตัวนี้ยังได้นำไปสู่การเพิ่มขึ้นของแชทบอทบำบัดด้วย AI ซึ่งเป็นแอปที่ใช้ AI เจนเนอเรชั่นเพื่อเลียนแบบคำแนะนำและคำแนะนำที่นำเสนอโดยนักบำบัดที่มีคุณสมบัติเหมาะสมและผู้เชี่ยวชาญด้านสุขภาพจิต

ต้องการท่องเว็บแบบส่วนตัวหรือไม่? หรือดูเหมือนอยู่ประเทศอื่น?

ต้องการท่องเว็บแบบส่วนตัวหรือไม่? หรือดูเหมือนอยู่ประเทศอื่น?

รับส่วนลด Surfshark มากถึง 86% ด้วยข้อเสนอ Tech.co Black Friday ![]()

ตัวอย่างที่สำคัญ ได้แก่ Pi ที่ประกาศตัวเองว่าเป็น "เพื่อนคุยที่เป็นมิตร" ซึ่งทำหน้าที่เป็นกระดานสนทนาและให้การสนับสนุนทางอารมณ์ Replika โปรแกรมแชทบอทที่เลียนแบบสไตล์การพูดและบุคลิกภาพของผู้ใช้ และ Earkick เครื่องติดตามความวิตกกังวลที่ออกแบบมาเพื่อช่วยให้คุณบันทึกและจัดการกับอารมณ์ที่ยากลำบาก

“แพลตฟอร์มที่ใช้ AI มอบความเป็นส่วนตัว ลดการตีตราที่มักเกี่ยวข้องกับการขอความช่วยเหลือสำหรับปัญหาสุขภาพจิต” – Ryan Sultan จิตแพทย์ที่ผ่านการรับรองและศาสตราจารย์จากมหาวิทยาลัยโคลัมเบีย

เช่นเดียวกับ แอปด้านสุขภาพจิตที่ดีที่สุด แอปเหล่านี้จำนวนมากมียอดดาวน์โหลดถึงหกหลักแล้ว และความนิยมของแอปเหล่านี้ก็ไม่น่าแปลกใจเลย เนื่องจากการขาดแคลนนักจิตวิทยา จิตแพทย์ และนักสังคมสงเคราะห์ที่มีคุณสมบัติเหมาะสม บวกกับความต้องการบริการที่เพิ่มสูงขึ้นทั่วประเทศ ขณะนี้สหรัฐฯ กำลังต่อสู้กับวิกฤตสุขภาพจิตที่เลวร้ายที่สุดครั้งหนึ่งในประวัติศาสตร์

ค่าใช้จ่ายที่สูงของการบำบัดแบบดั้งเดิมและข้อห้ามเกี่ยวกับสุขภาพจิตยังเป็นอุปสรรคต่อหลายๆ คนจากการทำตามทางเลือกแบบเดิมๆ ทำให้เกิดช่องว่างสำหรับทางเลือกที่รอบคอบและราคาไม่แพงมากขึ้น

หลักฐานเบื้องต้นบ่งชี้ว่ามีประสิทธิภาพเช่นกัน การค้นพบของ Earkick ของ AI Chatbot เผยให้เห็นว่าอารมณ์ของผู้ใช้ดีขึ้น 34% และระดับความวิตกกังวลลดลง 32% หลังจากใช้งานแอปเป็นเวลาห้าเดือน อย่างไรก็ตาม แม้ว่าแอปเหล่านี้สามารถบรรเทาความวิตกกังวลเล็กๆ น้อยๆ ได้สำเร็จพอๆ กับแอปเหล่านี้ แต่ก็ไม่ใช่ยาครอบจักรวาลสำหรับสุขภาพจิตที่เราทุกคนรอคอยอย่างแน่นอน

AI Chatbots ไม่เหมาะสำหรับสภาวะสุขภาพจิตที่ร้ายแรง

การได้รับคำแนะนำที่สมเหตุสมผลและได้รับการอนุมัติจากนักบำบัดจากแชทบอทขนาดพกพาจะเป็นประโยชน์สำหรับหลาย ๆ คนอย่างไม่ต้องสงสัย อย่างไรก็ตาม ผู้ที่ทุกข์ทรมานจากภาวะสุขภาพจิตขั้นรุนแรง เช่น ภาวะซึมเศร้า โรคจิตเภท และโรคไบโพลาร์ มักจะถูกปล่อยให้เปลี่ยนแปลงไปในระยะสั้น

ความผิดปกติทางจิตมีความซับซ้อน ละเอียดอ่อนมาก และมีลักษณะเฉพาะในแต่ละคนที่ได้รับผลกระทบ ในบางกรณี ควรจัดการด้วยยาที่แพทย์ผู้เชี่ยวชาญที่มีคุณสมบัติเหมาะสมเท่านั้นที่สามารถจ่ายยาได้อย่างถูกต้องเท่านั้น แม้ว่าโมเดลภาษาขนาดใหญ่ (LLM) ได้พัฒนาอย่างก้าวกระโดดในช่วงไม่กี่ปีที่ผ่านมา แต่ผลงานของพวกเขาจะไม่สามารถทดแทนความเชี่ยวชาญทางคลินิก ความเห็นอกเห็นใจ และความเห็นอกเห็นใจจากจิตแพทย์ นักจิตวิทยา และนักบำบัดได้

“ฉันชื่นชมอัลกอริธึมที่ได้รับการปรับปรุง แต่ท้ายที่สุดแล้ว ฉันไม่คิดว่าพวกเขาจะจัดการกับความเป็นจริงทางสังคมที่ยุ่งเหยิงกว่าที่ผู้คนเผชิญอยู่เมื่อพวกเขาต้องการความช่วยเหลือ” – Julia Brown ศาสตราจารย์ด้านมานุษยวิทยาจากมหาวิทยาลัยแคลิฟอร์เนีย ซานฟรานซิสโก

Aanant Bisht ผู้รักษาพลังจิตเชิงกลยุทธ์ยังเชื่อว่า AI ในสถานะปัจจุบันจะไม่สามารถช่วยเหลือเส้นทางการรักษาที่ซับซ้อนของผู้ใช้ทุกคนได้ “สิ่งสำคัญคือต้องหลีกเลี่ยงปัญหาสุขภาพจิตที่ซับซ้อนมากเกินไป และส่งเสริมให้ผู้ใช้ขอความช่วยเหลือจากผู้เชี่ยวชาญเมื่อจำเป็น” Bisht กล่าวกับ Tech.co

ข้อกังวลทั่วไปอีกประการหนึ่งที่แสดงโดยผู้เชี่ยวชาญที่เราพูดคุยด้วยคือการวินิจฉัยทางการแพทย์ผิดพลาด ชุมชนสุขภาพจิตมีปัญหาที่มีมายาวนานโดยระบุความผิดปกติทางจิตเวชที่ซับซ้อนและรุนแรงได้อย่างถูกต้อง และการพึ่งพา AI อย่างหนักอาจทำให้ปัญหานี้รุนแรงขึ้น เนื่องจากเทคโนโลยีมีจำกัด ชุดข้อมูลที่ไม่ได้เป็นตัวแทน และไม่สามารถตีความความแตกต่างของมนุษย์ได้

ผลลัพธ์ของสิ่งนี้ก็สามารถเกิดขึ้นได้เช่นกัน การวินิจฉัยผิดพลาดด้านสุขภาพจิตมักนำไปสู่การรักษาและการสนับสนุนที่ไม่เพียงพอ ความกดดันทางจิตเพิ่มเติม และความกังขาต่อระบบการแพทย์ในระยะยาว นี่ไม่ใช่เหตุผลเดียวว่าทำไมปัญญาประดิษฐ์ไม่เหมาะที่จะแซงเก้าอี้นักบำบัดในรูปแบบปัจจุบัน

AI มีข้อบกพร่องและถูกปกคลุมไปด้วยความท้าทายด้านจริยธรรม

การเพิ่มขึ้นอย่างรวดเร็วของ Generative AI ไม่ได้เกิดขึ้นโดยไม่มีผลกระทบ ในขณะที่เทคโนโลยียังคงพัฒนาอย่างรวดเร็ว กฎระเบียบเกี่ยวกับการใช้งานก็ล่าช้า ซึ่งก่อให้เกิดความท้าทายด้านจริยธรรมที่เกี่ยวข้องกับความเป็นส่วนตัวของข้อมูล อคติที่ฝังตัว และการใช้งานในทางที่ผิด

ข้อกังวลเหล่านี้ไม่ได้เกิดขึ้นเฉพาะกับการบำบัด แต่ธรรมชาติที่ละเอียดอ่อนของสุขภาพจิตหมายความว่ากรอบการทำงานด้านจริยธรรมเป็นหัวใจสำคัญของความสัมพันธ์ในการรักษาที่ดี เนื่องจากปัจจุบันไม่มีหลัก จริยธรรม AI อย่างเป็นทางการ ผู้ใช้ที่ต้องใช้แชทบอทแทนผู้เชี่ยวชาญที่มีคุณสมบัติเหมาะสมในการให้คำปรึกษาหรือการสนับสนุนด้านสุขภาพจิตอื่นๆ จึงเป็นปัญหาอย่างมาก

ความเป็นส่วนตัวของข้อมูลถือเป็นประเด็นสำคัญประการหนึ่ง Chatbots เช่น ChatGPT มักจะตกลงไปในน้ำร้อนเนื่องจาก ไม่สามารถปกป้องข้อมูลผู้ใช้ได้ เพื่อให้ผู้ใช้รู้สึกสบายใจที่จะพูดคุยเกี่ยวกับข้อมูลส่วนตัว บริษัท AI จะต้องมีกลยุทธ์การปกป้องข้อมูลที่เข้าใจผิดได้ซึ่งจัดลำดับความสำคัญของการรักษาความลับ

“ ธรรมชาติของการสนทนาเพื่อการบำบัดที่ใกล้ชิดและละเอียดอ่อนนั้นต้องการ การปกป้องข้อมูลในระดับที่ไม่มีใครเทียบได้” – ดร.แลงแฮม นักจิตวิทยาจาก Impulse Therapy

ปัจจัยสำคัญอีกประการหนึ่งที่ต้องระวังคืออคติของการเรียนรู้ของเครื่อง ระบบ AI ทั้งหมดอาศัยข้อมูลการฝึกอบรมที่กำหนดไว้ล่วงหน้า ซึ่งมักจะมีอคติของมนุษย์ฝังอยู่ แม้ว่าตัวแปรที่ละเอียดอ่อน เช่น เชื้อชาติและเพศ จะถูกลบออกไปก็ตาม

ตามคำกล่าวของ Bayu Prihandito ซีอีโอของบริษัท Life Coach Life Architekture หาก AI ได้รับการฝึกอบรมเกี่ยวกับข้อมูลที่มีอคติ “มันอาจทำให้อคติที่มีอยู่คงอยู่หรือทำให้รุนแรงขึ้น ซึ่งนำไปสู่คำแนะนำในการรักษาที่ไม่เท่าเทียมกัน” อคติในตัวเหล่านี้มีแนวโน้มที่จะส่งผลกระทบต่อผู้คนจากกลุ่มชนกลุ่มน้อยมากขึ้นเช่นกัน โดยเน้นถึงความสำคัญของการกำกับดูแลของมนุษย์และชุดข้อมูลการฝึกอบรมที่หลากหลายและเป็นตัวแทน

AI ในฐานะผู้ช่วยนักบำบัด ไม่ใช่การทดแทน

เพื่อนที่เป็นมิตรอย่าง Pi และ Woebot จะได้รับความนิยมมากขึ้นเรื่อยๆ เมื่อผู้ใช้ยังคงค้นหาวิธีที่เข้าถึงได้เพื่อเสริมสุขภาพจิตของพวกเขา อย่างไรก็ตาม เนื่องจากข้อกังวลด้านจริยธรรมที่หลากหลาย ปัญญาประดิษฐ์จึงไม่พร้อมที่จะเข้ามาแทนที่บทบาทของการบำบัดแบบเดิมๆ และไม่ควรจะเปลี่ยนเลย

นี่ไม่ได้เป็นการบอกว่าเทคโนโลยีที่เกิดขึ้นใหม่จะไม่ส่งผลกระทบอย่างใหญ่หลวงต่อการปฏิบัติโดยรวม ผู้ฝึกหัดส่วนใหญ่ที่เราพูดคุยด้วยเชื่อว่าเครื่องมือ AI จะสามารถให้เวลาและพลังงานแก่พวกเขามากขึ้นในการนำไปใช้ในด้านอื่น ๆ ของการฝึกปฏิบัติโดยการทำงานหนักเช่น Triaging

“แม้ว่าจะไม่สามารถแทนที่ความสัมพันธ์อันลึกซึ้งของมนุษย์ที่นักบำบัดมอบให้ได้ แต่ก็สามารถใช้เป็นเครื่องมือเสริมได้” – อานันท์ บิช โค้ชพลังจิตธุรกิจ

“AI สามารถจัดการการประเมินเบื้องต้น การติดตามอย่างต่อเนื่อง และให้การสนับสนุนกรณีที่ซับซ้อนน้อยกว่า ช่วยให้เราสามารถมุ่งเน้นไปที่สถานการณ์ที่รุนแรงหรือละเอียดอ่อนมากขึ้น” Bayu Prihandito กล่าวกับ Tech.co โดยเสริมว่า “ มันเหมือนกับการมีมือพิเศษที่คอยช่วยเหลืออยู่เสมอ มีอยู่."

ศาสตราจารย์แห่งโคลัมเบียและจิตแพทย์ที่ได้รับการรับรอง Sultan เห็นด้วย โดยบอกกับ Tech.co ว่าในอีก 5 ปีข้างหน้า AI มีแนวโน้มที่จะเสริมการบำบัดแบบดั้งเดิมด้วย การปรับปรุงประสิทธิภาพงานด้านการบริหาร ช่วยให้ผู้ปฏิบัติงานสร้างแผนการรักษาที่เป็นส่วนตัวมากขึ้น และ " สร้างแบบจำลองไฮบริดที่ผสมผสานความเชี่ยวชาญของมนุษย์เข้ากับ AI- เครื่องมือขับเคลื่อนเพื่อเพิ่มประสิทธิภาพการรักษา”

สิ่งนี้ชี้ให้เห็นว่า นอกเหนือจากการบั่นทอนแนวทางปฏิบัติของมนุษยชาติแล้ว AI ยังมีพลังในการเพิ่มทักษะของมนุษย์ เช่น การเอาใจใส่ การเชื่อมโยง และความเห็นอกเห็นใจ ช่วยให้ลูกค้าได้รับประโยชน์จากบริการมากยิ่งขึ้น

อย่างไรก็ตาม การดูแลสุขภาพจิตเป็นเรื่องที่จริงจังและมักเป็นเรื่องของชีวิตและความตาย ก่อนที่ AI จะกลายเป็นผู้ช่วยของนักบำบัดทุกคนหรือแทนที่ AI จริงๆ จำเป็นต้องพิจารณากฎระเบียบที่เข้มงวดเกี่ยวกับการปรับใช้และการใช้งาน

จนกว่าจะถึงเวลาดังกล่าว ศักยภาพที่ชัดเจนของแชทบอทแบบ AI ที่จะปรับปรุงการเข้าถึงการสนับสนุนด้านสุขภาพจิตนั้นยังไม่สามารถประนีประนอมกับความเสี่ยงที่เกิดขึ้นได้ทั้งหมด ในโลกที่ประเด็นขัดแย้งด้านจริยธรรมมักจะไม่เหมือนกัน ประเด็นนี้ใหญ่เกินกว่าจะเพิกเฉยได้