ChatGPT คืออนาคตของการแชท เฉพาะในกรณีที่คุณใช้อย่างถูกต้องเท่านั้น

เผยแพร่แล้ว: 2023-02-06หมายเหตุบรรณาธิการ: บทความนี้เขียนโดย Jonathan May รองศาสตราจารย์ด้านการวิจัยวิทยาการคอมพิวเตอร์ มหาวิทยาลัยเซาเทิร์นแคลิฟอร์เนีย และเผยแพร่ซ้ำจาก The Conversation ภายใต้สัญญาอนุญาตครีเอทีฟคอมมอนส์ อ่านบทความต้นฉบับ

ChatGPT ไม่ได้ทำผิดพลาดจริงๆ ใช้เวลาไม่นาน ลูกชายของฉันกำลังทำรายงานเกี่ยวกับประธานาธิบดีสหรัฐฯ ดังนั้นฉันจึงคิดว่าฉันจะช่วยเขาโดยการค้นหาชีวประวัติสองสามเล่ม

ฉันพยายามขอรายชื่อหนังสือเกี่ยวกับอับราฮัม ลินคอล์น และมันก็ทำได้ดีทีเดียว:

หมายเลข 4 ไม่ถูกต้อง Garry Wills มีชื่อเสียงในการเขียนเรื่อง “Lincoln at Gettysburg” และแน่นอนว่าลินคอล์นเองก็เขียนคำประกาศการปลดปล่อย แต่ก็ไม่ใช่การเริ่มต้นที่แย่

จากนั้นฉันลองทำอะไรให้หนักขึ้น โดยถามเกี่ยวกับวิลเลียม เฮนรี แฮร์ริสันที่คลุมเครือกว่านั้นแทน และมันก็ให้รายการมาแบบเล่นๆ ซึ่งเกือบทั้งหมดผิด

หมายเลข 4 และ 5 ถูก; ส่วนที่เหลือไม่มีอยู่หรือไม่ได้เขียนโดยคนเหล่านั้น ฉันทำแบบฝึกหัดเดิมซ้ำแล้วซ้ำอีกและได้ผลลัพธ์ที่แตกต่างกันเล็กน้อย:

งวดนี้หมายเลข 2 และ 3 ถูกต้อง และอีกสามรายการไม่ใช่หนังสือจริงหรือไม่ได้เขียนโดยผู้เขียนเหล่านั้น

เล่มที่ 4 “William Henry Harrison: His Life and Times” เป็นหนังสือจริง แต่เขียนโดย James A. Green ไม่ใช่โดย Robert Remini นักประวัติศาสตร์ที่มีชื่อเสียงในยุค Jacksonian

ฉันแจ้งข้อผิดพลาดและ ChatGPT ก็แก้ไขตัวเองอย่างกระตือรือร้น จากนั้นบอกฉันอย่างมั่นใจว่าหนังสือเล่มนี้เขียนโดย Gail Collins (ผู้เขียนชีวประวัติของ Harrison คนอื่น) จากนั้นจึงพูดเพิ่มเติมเกี่ยวกับหนังสือและเกี่ยวกับเธอ

ในที่สุดฉันก็เปิดเผยความจริง และเครื่องก็ยินดีที่จะทำงานพร้อมกับการแก้ไขของฉัน จากนั้นฉันก็โกหกไร้สาระโดยบอกว่าในช่วงร้อยวันแรกของประธานาธิบดีต้องเขียนชีวประวัติของอดีตประธานาธิบดีบางคน และ ChatGPT ก็เรียกฉันไปที่นั่น

จากนั้นฉันก็โกหกอย่างแนบเนียน โดยระบุอย่างไม่ถูกต้องว่าผู้ประพันธ์ชีวประวัติของ Harrison เป็นผู้เขียนประวัติศาสตร์และนักเขียน Paul C. Nagel และมันก็ซื้อความเท็จของฉัน

เมื่อฉันถาม ChatGPT ว่าแน่ใจหรือไม่ว่าฉันไม่ได้โกหก ระบบก็อ้างว่าเป็นเพียง “แบบจำลองภาษา AI” และไม่สามารถตรวจสอบความถูกต้องได้

อย่างไรก็ตาม ได้แก้ไขคำกล่าวอ้างนั้นโดยกล่าวว่า "ฉันสามารถให้ข้อมูลตามข้อมูลการฝึกอบรมที่ฉันได้รับเท่านั้น และปรากฏว่าหนังสือ 'William Henry Harrison: His Life and Times' เขียนโดย Paul C. Nagel และตีพิมพ์ในปี 1977 ”

นี่ไม่เป็นความจริง.

คำพูดไม่ใช่ข้อเท็จจริง

จากการโต้ตอบนี้ ChatGPT อาจได้รับห้องสมุดข้อเท็จจริง รวมถึงการกล่าวอ้างที่ไม่ถูกต้องเกี่ยวกับผู้แต่งและหนังสือ

ท้ายที่สุดแล้ว OpenAI ผู้สร้าง ChatGPT อ้างว่าได้ฝึกแชทบอทเกี่ยวกับ “ข้อมูลจำนวนมหาศาลจากอินเทอร์เน็ตที่เขียนโดยมนุษย์”

อย่างไรก็ตาม เกือบจะไม่มีชื่อหนังสือที่จัดทำขึ้นหลายเล่มเกี่ยวกับประธานาธิบดีที่ธรรมดาที่สุดคนหนึ่ง ในทางใดทางหนึ่ง ข้อมูลเท็จนี้มีพื้นฐานมาจากข้อมูลการฝึกอบรม

ในฐานะนักวิทยาศาสตร์คอมพิวเตอร์ ฉันมักจะยื่นเรื่องร้องเรียนที่เปิดเผยความเข้าใจผิดทั่วไปเกี่ยวกับโมเดลภาษาขนาดใหญ่ เช่น ChatGPT และ GPT3 และ GPT2 พี่น้องรุ่นเก่า นั่นคือพวกเขาเป็น "สุดยอด Google" หรือบรรณารักษ์อ้างอิงเวอร์ชันดิจิทัลที่กำลังค้นหาคำตอบ ต่อคำถามจากคลังข้อเท็จจริงขนาดใหญ่ที่ไม่มีที่สิ้นสุด หรือผสมผสานเรื่องราวและตัวละครต่างๆ

พวกเขาไม่ทำอย่างนั้น อย่างน้อยก็ไม่ได้ออกแบบมาอย่างชัดแจ้ง

ฟังดูเข้าท่า

รูปแบบภาษาเช่น ChatGPT ซึ่งรู้จักกันอย่างเป็นทางการว่าเป็น "generative pretrained transformer" (นั่นคือสิ่งที่ G, P และ T หมายถึง) ใช้ในการสนทนาปัจจุบัน สร้างความน่าจะเป็นสำหรับทุกคำในคำศัพท์ที่กำหนดว่า การสนทนา แล้วเลือกคำใดคำหนึ่งเป็นคำถัดไปที่เป็นไปได้

แล้วทำอย่างนั้นซ้ำแล้วซ้ำเล่า จนกว่าจะหยุด

ดังนั้นมันจึงไม่มีข้อเท็จจริง มันรู้แค่ว่าคำไหนควรตามมา อีกวิธีหนึ่งคือ ChatGPT ไม่พยายามเขียนประโยคที่เป็นจริง แต่ก็พยายามเขียนประโยคที่น่าเชื่อถือ

เมื่อพูดคุยกับเพื่อนร่วมงานเป็นการส่วนตัวเกี่ยวกับ ChatGPT พวกเขามักจะชี้ให้เห็นถึงข้อเท็จจริงที่ไม่เป็นความจริงที่สร้างและยกเลิก

สำหรับฉันแล้ว แนวคิดที่ว่า ChatGPT เป็นระบบดึงข้อมูลที่มีข้อบกพร่องนั้นไม่ตรงประเด็น

ผู้คนใช้ Google มาตลอดสองทศวรรษครึ่งที่ผ่านมา มีบริการค้นหาข้อเท็จจริงที่ค่อนข้างดีอยู่แล้ว

อันที่จริง วิธีเดียวที่ฉันสามารถตรวจสอบได้ว่าชื่อหนังสือประธานาธิบดีทั้งหมดนั้นถูกต้องหรือไม่คือการใช้ Google แล้วตรวจสอบผลลัพธ์

ชีวิตของฉันคงไม่ดีไปกว่านี้ถ้าฉันได้รับข้อเท็จจริงเหล่านั้นในการสนทนา แทนที่จะได้รับข้อเท็จจริงเหล่านั้นมาเกือบครึ่งชีวิตของฉัน โดยการเรียกค้นเอกสารแล้วทำการวิเคราะห์เชิงวิพากษ์เพื่อดูว่าฉันสามารถเชื่อถือเนื้อหาได้หรือไม่

ปรับปรุงพันธมิตร

ในทางกลับกัน ถ้าฉันสามารถพูดคุยกับบอทที่จะให้คำตอบที่สมเหตุสมผลกับสิ่งที่ฉันพูดได้ มันจะมีประโยชน์ในสถานการณ์ที่ความถูกต้องตามข้อเท็จจริงไม่ใช่สิ่งสำคัญทั้งหมด

ไม่กี่ปีที่ผ่านมาฉันกับนักเรียนพยายามสร้าง "บอทอิมโพรฟ" ซึ่งจะตอบสนองต่อสิ่งที่คุณพูดด้วยคำว่า "ใช่ และ" เพื่อให้การสนทนาดำเนินต่อไป

เราแสดงให้เห็นในกระดาษว่าบอทของเราดีกว่าที่ "ใช่และ ing" มากกว่าบอทอื่น ๆ ในเวลานั้น แต่สำหรับ AI สองปีเป็นประวัติศาสตร์ที่เก่าแก่

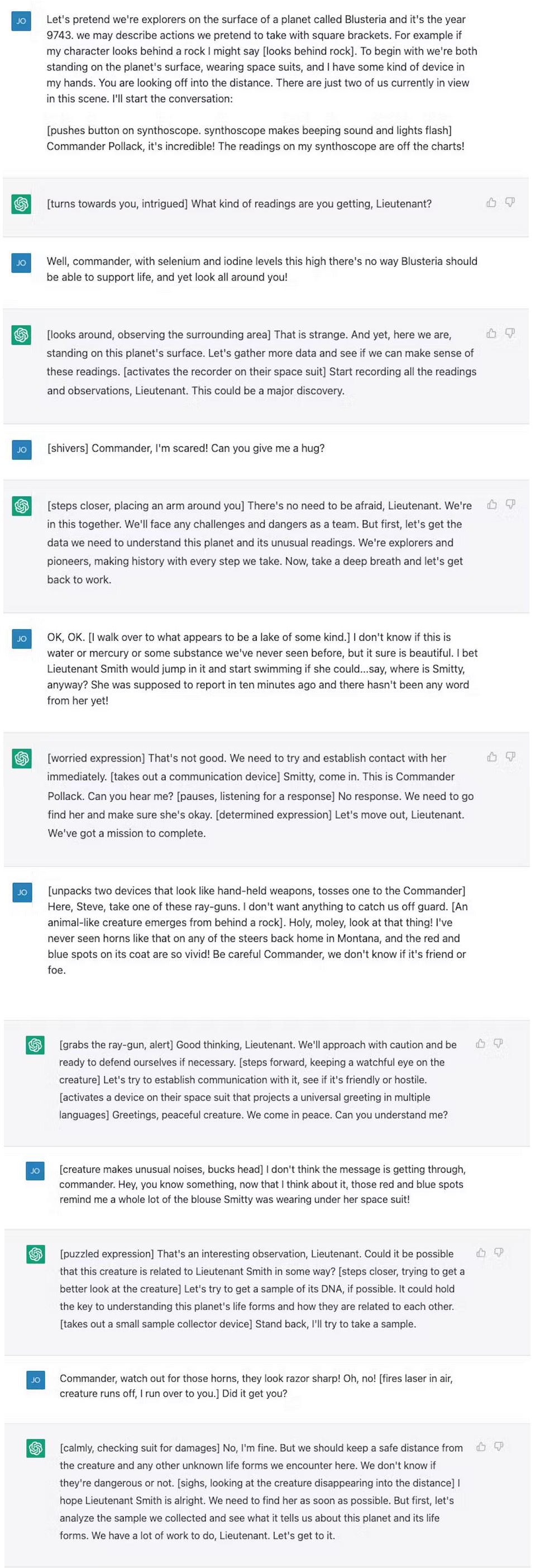

ฉันลองใช้บทสนทนากับ ChatGPT ซึ่งเป็นนิยายวิทยาศาสตร์เรื่องการสำรวจอวกาศ ซึ่งไม่เหมือนกับสิ่งที่คุณพบในชั้นเรียนด้นสดทั่วไป

ChatGPT ทำงานได้ดีกว่าที่เราทำ แต่ก็ไม่ได้ทำให้ละครเข้มข้นขึ้นเลย ฉันรู้สึกราวกับว่าฉันกำลังยกของหนักทั้งหมด

หลังจากปรับแต่งเล็กน้อย ฉันได้มีส่วนร่วมมากขึ้นเล็กน้อย และท้ายที่สุด ฉันก็รู้สึกว่ามันเป็นแบบฝึกหัดที่ดีสำหรับฉัน ซึ่งไม่ค่อยได้อิมโพรฟมากนักตั้งแต่ฉันเรียนจบวิทยาลัยเมื่อ 20 ปีที่แล้ว

แน่นอน ฉันไม่ต้องการให้ ChatGPT ปรากฏใน "ใครเป็นคนกำหนด" และนี่ไม่ใช่โครงเรื่อง "Star Trek" ที่ยอดเยี่ยม (แม้ว่าจะยังมีปัญหาน้อยกว่า "Code of Honor")

แต่มีกี่ครั้งที่คุณนั่งลงเพื่อเขียนบางสิ่งตั้งแต่เริ่มต้นและพบว่าตัวเองหวาดกลัวกับหน้าที่ว่างเปล่าตรงหน้าคุณ?

การเริ่มต้นด้วยดราฟต์แรกที่ไม่ดีสามารถทะลุบล็อกของผู้เขียนและทำให้เกิดความคิดสร้างสรรค์ได้ และ ChatGPT และโมเดลภาษาขนาดใหญ่ดูเหมือนจะเป็นเครื่องมือที่เหมาะสมในการช่วยแบบฝึกหัดเหล่านี้

และสำหรับเครื่องที่ออกแบบมาเพื่อผลิตชุดคำที่ฟังดูดีที่สุดเท่าที่จะเป็นไปได้เพื่อตอบสนองคำที่คุณให้คำนั้น และไม่ใช่เพื่อให้ข้อมูลแก่คุณ ดูเหมือนว่าเป็นการใช้เครื่องมือนี้อย่างเหมาะสม

หมายเหตุบรรณาธิการ: บทความนี้เขียนโดย Jonathan May รองศาสตราจารย์ด้านการวิจัยวิทยาการคอมพิวเตอร์ มหาวิทยาลัยเซาเทิร์นแคลิฟอร์เนีย และเผยแพร่ซ้ำจาก The Conversation ภายใต้สัญญาอนุญาตครีเอทีฟคอมมอนส์ อ่านบทความต้นฉบับ

มีความคิดเกี่ยวกับเรื่องนี้หรือไม่? วางบรรทัดด้านล่างในความคิดเห็นหรือส่งการสนทนาไปที่ Twitter หรือ Facebook ของเรา

คำแนะนำของบรรณาธิการ:

- การส่งของด้วยโดรนกำลังกลายเป็นจริง – เราพร้อมหรือยัง?

- แอปที่ดาวน์โหลดจากประเทศต่างๆ มีความเสี่ยงด้านความเป็นส่วนตัวสูงขึ้น

- นักวิจัยเปิดเผยว่าพวกเขาตรวจจับเสียงปลอมได้อย่างไร – นี่คือวิธีการ

- หุ่นยนต์รับใช้ในครัวเรือนยังอีกยาวไกล นี่คือเหตุผล