Yapay Zeka Terapisi Chatbotları Neden Nihai Etik İkilemdir?

Yayınlanan: 2023-10-31ChatGPT gibi üretken yapay zeka sohbet robotları, işyeri süreçlerini kolaylaştırmak, kod yazmak ve hatta stand-up komedi setleri için senaryolar yazmak için kullanılıyor. Anksiyete ve depresyon vakalarının rekor seviyelere ulaştığı ve profesyonel desteğin sınırlı olduğu ABD'de, kullanıcıların zihinsel sağlıklarını yönetmeye yardımcı olmak için de bu teknolojiden yararlanmaları sürpriz değil.

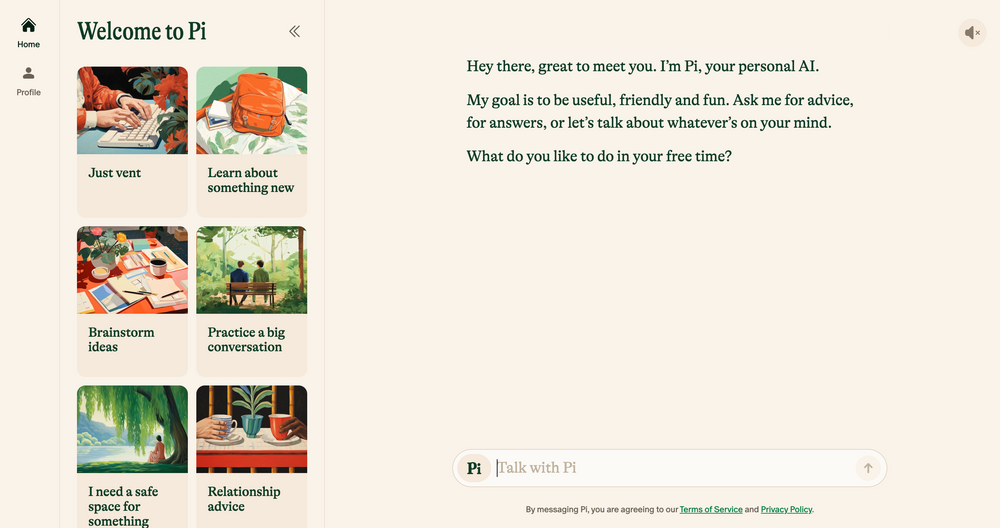

Elomia, Pi ve Woebot gibi yapay zeka sohbet robotları, denenmiş ve test edilmiş terapi tekniklerine dayalı olarak 7/24 uygun fiyatlı, kişiselleştirilmiş destek sunar. Kullanıcıların uzun bekleme listelerini atlatmasına yardımcı olmaktan, yardıma erişim konusundaki damgalamayı azaltmaya kadar, faydaları çok büyük. Hala hatalara, halüsinasyonlara ve önyargılara açık olan üretken yapay zeka, insan kulağının empatisiyle kıyaslanabilir mi?

Yeni ortaya çıkan teknolojinin terapinin geleceğini nasıl şekillendireceğine ışık tutmak için akademisyenler, psikologlar ve pratisyen terapistlerle konuştuk. Ayrıca yapay zeka terapisinin daha karanlık tarafını da tartışıyoruz ve bugün hangi etik kaygıların ele alınması gerektiğini belirliyoruz. İşte bulduklarımız.

Yapay Zekalı Sohbet Robotları: Yeni Nesil Robot Terapistleri

OpenAI'nin sohbet robotu ChatGPT'nin ilk kez geçtiğimiz Kasım ayında piyasaya sürülmesinden bu yana, Google Bard ve Claude AI gibi genel kullanım uygulamalarından daha az geleneksel Marvel karakter simülatörlerine kadar, uygulama mağazalarında bir sohbet robotu kopyaları ordusu ortaya çıktı.

Bu gelişen pazar, nitelikli terapistler ve ruh sağlığı profesyonelleri tarafından sunulan tavsiye ve rehberliği taklit etmek için üretken yapay zekayı kullanan uygulamalar olan yapay zeka terapi sohbet robotlarının da yükselişine yol açtı.

Web'e özel olarak göz atmak ister misiniz? Yoksa başka bir ülkedeymişsiniz gibi mi görünüyorsunuz?

Web'e özel olarak göz atmak ister misiniz? Yoksa başka bir ülkedeymişsiniz gibi mi görünüyorsunuz?

Tech.co'nun bu Kara Cuma teklifiyle Surfshark'ta %86'lık devasa bir indirim kazanın. ![]()

Başlıca örnekler arasında, bir ses tahtası görevi gören ve duygusal destek sunan, kendi deyimiyle "dostça sohbet arkadaşı" olan Pi; Kullanıcılarının konuşma tarzını ve kişiliğini taklit eden bir chatbot programı olan Replika; ve zor duyguları kaydetmenize ve bunların üstesinden gelmenize yardımcı olmak için tasarlanmış bir kaygı izleyici olan Earkick.

"Yapay zeka tabanlı platformlar mahremiyet sunarak zihinsel sağlık sorunları için yardım aramanın getirdiği damgalanmayı azaltıyor." – Ryan Sultan, Sertifikalı Psikiyatrist ve Columbia Üniversitesi Profesörü

En iyi zihinsel sağlık uygulamaları gibi, bu uygulamaların birçoğu zaten altı rakamlı indirme sayısına sahip ve popülerlikleri pek de şaşırtıcı değil. Nitelikli psikolog, psikiyatrist ve sosyal hizmet uzmanı eksikliğinin yanı sıra ülke genelinde hizmetlere olan talebin artması nedeniyle ABD şu anda tarihteki en kötü akıl sağlığı krizlerinden biriyle boğuşuyor.

Geleneksel terapinin yüksek maliyeti ve zihinsel sağlıkla ilgili tabular da birçok kişiyi geleneksel seçenekleri izlemekten caydırıyor ve daha ihtiyatlı, uygun fiyatlı alternatifler için bir boşluk yaratıyor.

İlk kanıtlar bunların da etkili olduğunu gösteriyor. AI Chatbot'tan Earkick'in kendi bulguları, uygulamayı beş ay boyunca kullanmaya devam ettikten sonra kullanıcısının ruh halinin %34 oranında arttığını ve kaygı düzeylerinin %32 oranında düştüğünü ortaya çıkardı. Bununla birlikte, bu uygulamalar küçük endişeleri gidermede ne kadar başarılı olsa da, kesinlikle hepimizin beklediği zihinsel sağlık ilacı değiller.

Yapay Zekalı Chatbotlar Ciddi Ruh Sağlığı Durumlarına Uygun Değil

Cep boyutunda bir sohbet robotundan mantıklı, terapist onaylı tavsiyeler almak şüphesiz birçok kişiye yardımcı olacaktır. Ancak depresyon, şizofreni ve bipolar bozukluk gibi ciddi zihinsel sağlık sorunları yaşayanlar muhtemelen kısa sürede değişime uğrayacak.

Zihinsel bozukluklar karmaşıktır, çok ince ayrıntılara sahiptir ve etkiledikleri her kişiye özgüdür. Bazı durumlarda, yalnızca kalifiye tıp uzmanları tarafından doğru şekilde reçete edilebilecek ilaçlarla en iyi şekilde yönetilirler. Büyük dil modelleri (LLM'ler) son yıllarda büyük bir hızla evrim geçirse de, çıktıları hiçbir zaman psikiyatristler, psikologlar ve terapistler tarafından sağlanan klinik uzmanlığın, empatinin ve şefkatin yerini alamayacak.

San Francisco'daki California Üniversitesi'nden antropoloji profesörü Julia Brown, "Algoritmaların geliştiğini takdir ediyorum, ancak sonuçta insanların yardım ararken içinde bulundukları daha karmaşık sosyal gerçekliklere hitap edeceklerini düşünmüyorum" dedi.

Stratejik psişik şifacı Aanant Bisht, mevcut haliyle yapay zekanın her kullanıcının karmaşık şifa yolculuğuna yardımcı olamayacağına da inanıyor. Bisht, Tech.co'ya şunları söylüyor: "Karmaşık zihinsel sağlık sorunlarının aşırı basitleştirilmesinden kaçınmak ve kullanıcıları gerektiğinde profesyonel yardım almaya teşvik etmek de çok önemli."

Konuştuğumuz uzmanların dile getirdiği bir diğer yaygın endişe ise tıbbi yanlış teşhistir. Akıl sağlığı camiasının, karmaşık ve ciddi psikiyatrik bozuklukları doğru bir şekilde tanımlama konusunda uzun süredir devam eden bir sorunu vardır ve yapay zekaya aşırı güvenmek, teknolojilerin sınırlı olması, temsili olmayan veri setleri ve insani nüansları yorumlayamama nedeniyle bu sorunu muhtemelen daha da kötüleştirebilir.

Bunun sonuçları da çok çarpıcı olabilir. Akıl sağlığına yönelik yanlış teşhisler sıklıkla yetersiz tedavi ve desteğe, ek zihinsel baskılara ve tıbbi sisteme karşı uzun vadeli şüpheciliğe yol açar. Yapay zekanın mevcut haliyle terapist koltuğunu geçemeyecek olmasının tek nedeni bu değil.

Yapay Zeka Kusurludur ve Etik Zorluklarla Örtülmüştür

Üretken yapay zekanın hızlı yükselişi sonuçsuz kalmadı. Teknoloji baş döndürücü bir hızla gelişmeye devam ettikçe, kullanımına ilişkin düzenlemelerin yavaş yavaş yetişmesi, veri gizliliği, yerleşik önyargı ve kötüye kullanımla ilgili bir dizi etik zorluğun ortaya çıkmasına katkıda bulunuyor.

Bu kaygılar terapiye özgü değildir ancak ruh sağlığının hassas doğası, etik çerçevelerin her iyi terapötik ilişkinin merkezinde yer aldığı anlamına gelir. Şu anda resmi bir AI etik kuralları bulunmadığından, kullanıcıların danışmanlık veya diğer zihinsel sağlık desteği için nitelikli profesyoneller yerine sohbet robotlarına güvenmesi son derece sorunludur.

Veri gizliliği önemli bir konudur. ChatGPT gibi sohbet robotları , kullanıcı verilerini koruyamadıkları için sık sık kendilerini zor durumda bırakıyor. Kullanıcıların özel, kişisel bilgileri tartışırken kendilerini rahat hissetmeleri için yapay zeka şirketlerinin gizliliğe öncelik veren kusursuz bir veri koruma stratejisine sahip olmaları gerekecek.

" Terapötik konuşmaların samimi ve hassas doğası, benzersiz düzeyde veri koruması gerektirir." – Dr. Langham, Dürtü Terapisinde psikolog

Dikkat edilmesi gereken bir diğer önemli faktör de makine öğrenimi önyargısıdır. Tüm yapay zeka sistemleri, ırk ve cinsiyet gibi hassas değişkenler çıkarılsa bile genellikle yerleşik insan önyargılarını içeren önceden belirlenmiş eğitim verilerine dayanır.

Yaşam koçu şirketi Life Architekture'un CEO'su Bayu Prihandito'ya göre , eğer yapay zeka önyargılı veriler üzerine eğitilirse "mevcut önyargıları sürdürebilir veya şiddetlendirebilir, bu da adaletsiz tedavi önerilerine yol açabilir". Bu yerleşik önyargıların azınlık gruplarından insanları da daha fazla etkilemesi muhtemeldir, bu da insan gözetiminin ve çeşitli ve temsili eğitim veri setlerinin önemini vurgulamaktadır.

Terapistin Asistanı Olarak Yapay Zeka, Yerine Geçen Değil

Pi ve Woebot gibi dost canlısı yoldaşların popülaritesi, kullanıcılar zihinsel sağlıklarını desteklemek için erişilebilir yollar aramaya devam ettikçe artacak. Ancak çok çeşitli etik kaygılar nedeniyle yapay zeka, geleneksel terapinin rolünün yerini almaya hazır değil ve asla da olmamalı.

Ancak bu, gelişen teknolojinin bir bütün olarak uygulama üzerinde büyük bir etkisi olmayacağı anlamına gelmiyor. Konuştuğumuz uygulayıcıların çoğu, yapay zeka araçlarının, öncelik belirleme gibi zorlu çalışmaları gerçekleştirerek, uygulamanın diğer alanlarına ayırmaları için onlara daha fazla zaman ve enerji verebileceğine inanıyor.

"Terapistlerin sunduğu derin insani bağın yerini alamasa da tamamlayıcı bir araç olarak hizmet edebilir." – Aanant Bish, iş psişik koçu

Bayu Prihandito Tech.co'ya şunları söyledi: "Yapay zeka ilk değerlendirmeleri, sürekli izlemeyi gerçekleştirebilir ve daha az karmaşık vakalar için destek sağlayarak daha ciddi veya hassas durumlara odaklanmamıza olanak sağlayabilir." mevcut."

Columbia profesörü ve sertifikalı psikiyatrist Sultan da aynı fikirde ve Tech.co'ya beş yıl içinde yapay zekanın idari görevleri kolaylaştırarak, uygulayıcıların daha kişiselleştirilmiş tedavi planları oluşturmasına yardımcı olarak ve " insan uzmanlığını yapay zeka ile birleştiren hibrit modeller yaratarak " geleneksel terapiyi büyük olasılıkla tamamlayacağını söyledi. Tedaviyi geliştirmek için tahrikli araçlar”.

Bu, yapay zekanın insani pratiğini tüketmek şöyle dursun, aslında empati, bağlantı kurma ve şefkat gibi insani becerileri serbest bırakma ve müşterilerin hizmetten daha fazla faydalanmasına yardımcı olma gücüne sahip olduğunu gösteriyor.

Ancak zihinsel sağlığın korunması ciddi bir iştir ve çoğu zaman bir ölüm kalım meselesi olabilir. Yapay zeka her terapistin asistanı haline gelmeden veya aslında onların yerini almadan önce, onun konuşlandırılması ve kullanımına ilişkin katı düzenlemelerin dikkate alınması gerekiyor.

Böyle bir zaman gelene kadar yapay zeka sohbet robotlarının zihinsel sağlık desteğine erişimi iyileştirme konusundaki açık potansiyeli, bunların oluşturduğu risklerle tam olarak bağdaştırılamaz. Etik ikilemlerin sıklıkla eşit olduğu bir dünyada, bu durum göz ardı edilemeyecek kadar büyüktür.