如何在Android上本地运行DeepSeek AI:逐步指南

已发表: 2025-02-14自推出以来,Chatppt已迅速成为顶级车型之一。 Google一直在追赶其双子座模型,几乎所有公司在2025年将AI集成到了他们的应用程序中,并围绕它构建了服务。

这也有代价。 Openai一直在为Chatgpt开发投入数十亿美元。但是,一家具有DeepSeek模型的中国人工智能公司几乎与Chatgpt最高推理模型的能力相匹配,显然是以一小部分成本开发的。

这已经打入了美国市场,使我们重新考虑了AI聊天机器人和LLM的开发。 DeepSeek是如此的破坏性,以至于您现在可以运行以其思维功能而闻名的LLM推理模型,然后再在设备上回答您的本地问题。我们已经有一个详细的指南,介绍了如何在窗户和Mac上本地运行DeepSeek。在本指南中,我们将考虑在您的Android智能手机上本地安装和运行DeepSeek R1模型。

目录

在您的设备上本地安装和运行DeepSeek的最低设备要求

由于LLM需要资源才能运行,因此在设备上本地安装和使用DeepSeek R1有设定的最低系统要求。请记住,这些是较小1.5B型号的系统要求。 7,8,32B,700亿款的模型也需要更高的系统要求。

| 规格 | 最低规格 |

| 内存 | 8GB或更多 |

| 处理器 | Snapdragon 8 Gen 2或同等 |

| 贮存 | 至少12GB的自由空间 |

| 操作系统 | Android 12或更高版本 |

考虑到这一点,如果您想要具有系统需求的Android旗舰智能手机,请访问逐步指南,然后在设备上安装并运行DeepSeek AI。

逐步指南在设备上本地运行DeepSeek

您可以通过多种方式在设备上本地安装和运行Deep Aig。在这篇文章中,您将学习如何在本地安装和运行本地AI模型。但是,这需要与终端合作;如果需要一种简单的方法,则可以使用PocketPal AI应用程序。请参阅第二种方法。

步骤1:安装术语

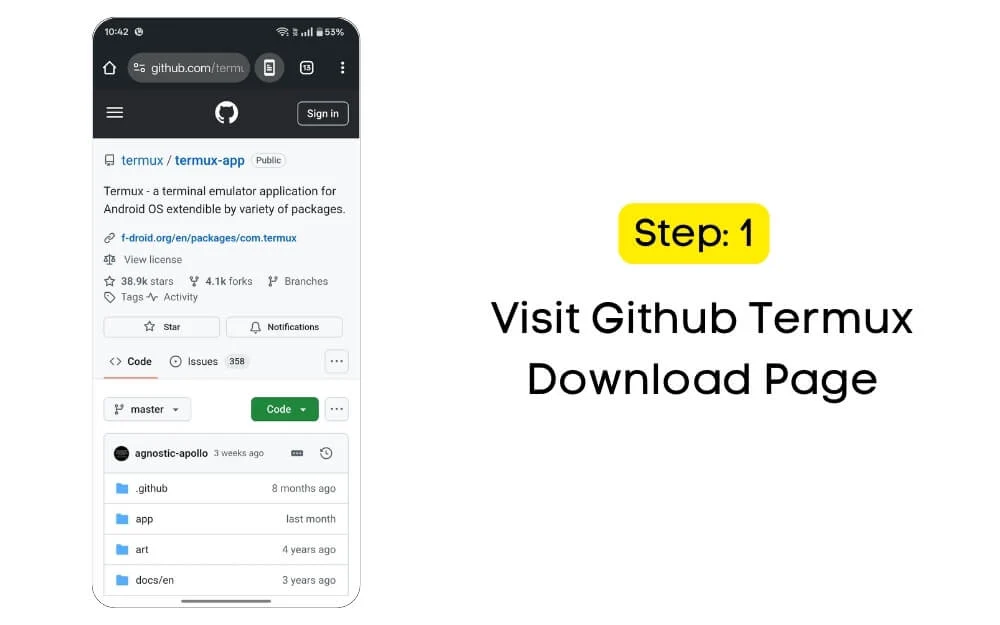

步骤1.1:从官方GitHub页面下载Termux应用程序。

Termux是终端模拟器Android应用程序,它将其命令线带到Android等移动设备。它使您可以执行命令行程序,安装Linux软件包,执行Shell命令,并允许您在设备上安装诸如Python和SSH之类的工具。最重要的是,与许多应用程序不同,它不需要root访问,这意味着任何人都可以安装此应用而无需扎根或越狱设备,从而使其安全易于使用。

该应用程序从Play商店中删除后,该应用程序在Google Play商店或App Store上不可用。但是,您可以轻松地从第三方来源和GitHub等网站安装它。我们还提供了有关Termux的官方和安全链接的详细指南。您可以访问我们的指南并安装最新的APK。

对于本指南,您可以从GitHub页面安装Termux。

步骤1.2:访问github termux下载页面

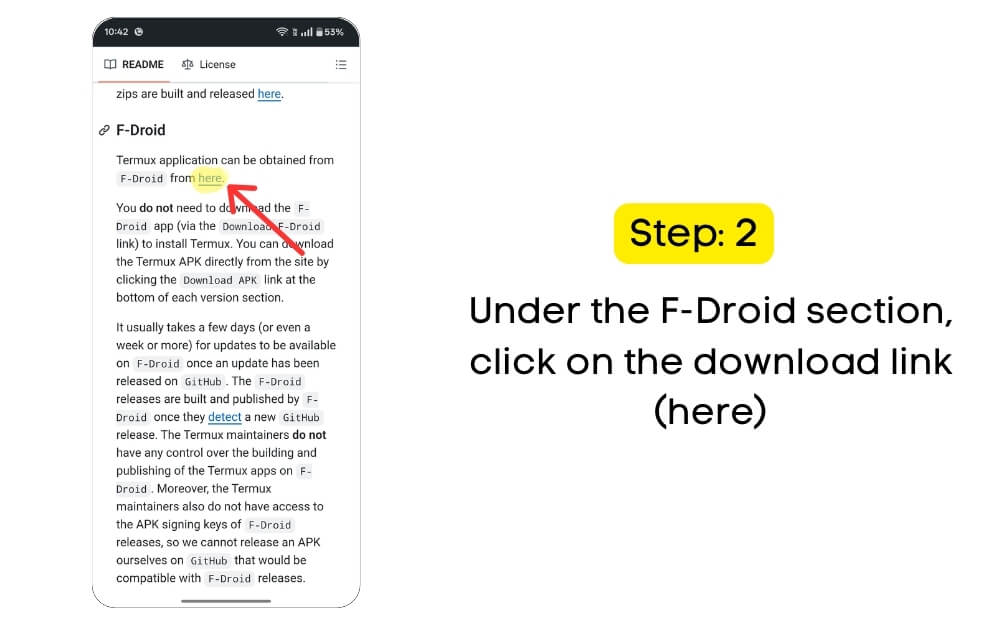

步骤1.3:向下滚动,在F-DRIOOD部分下,单击下载链接(此处) ,或者您可以使用此直接下载链接访问F-Drop页面。

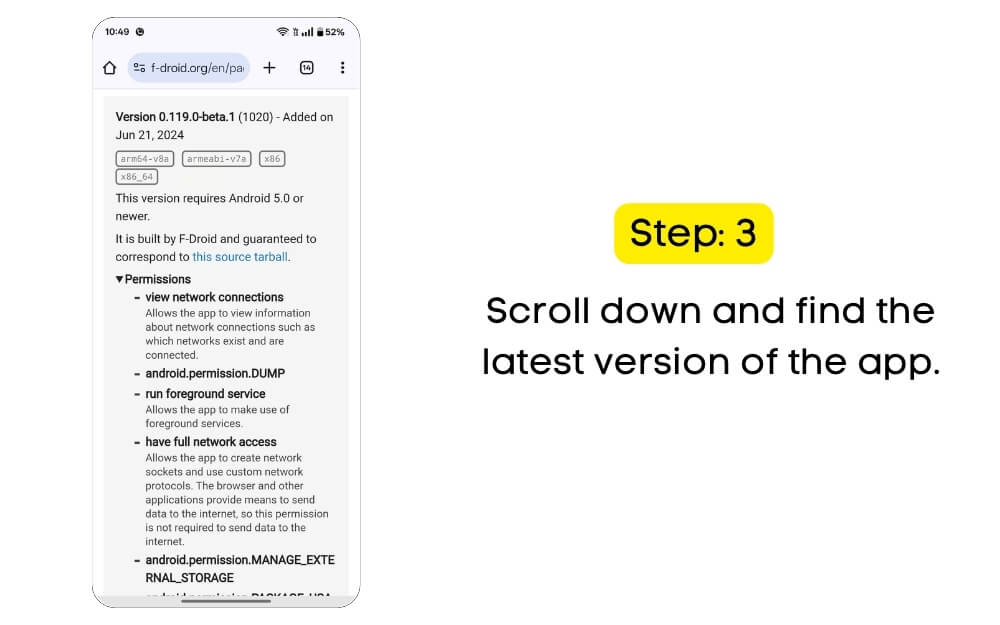

步骤1.4:向下滚动并找到该应用的最新版本(在撰写本文时,最新版本为0.119.0-beta.1(1020);对我来说很好;如果您有问题,则可以下载稳定版本。

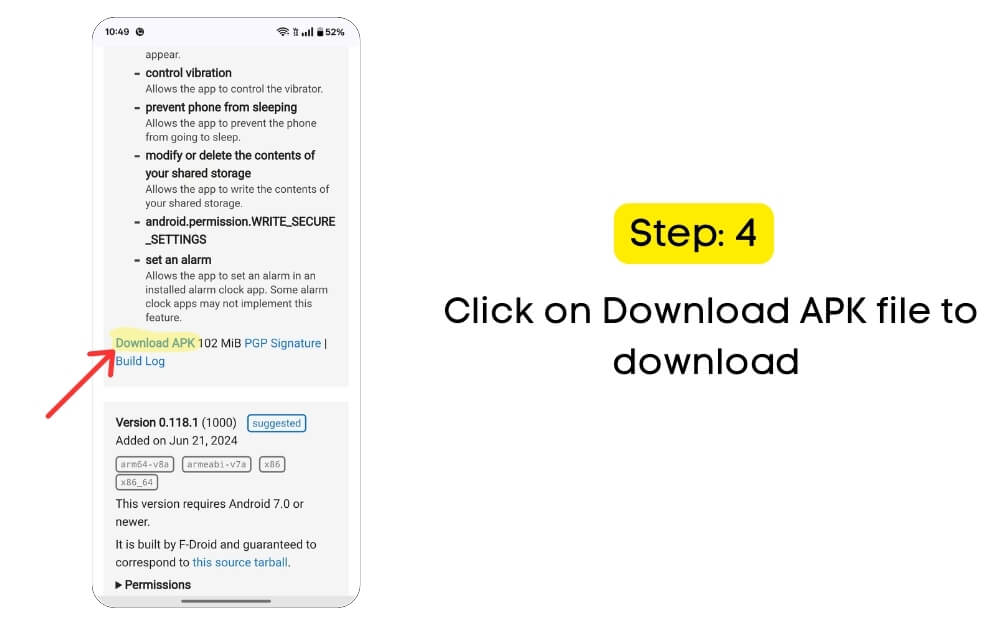

步骤1.5:单击下载APK文件以下载。

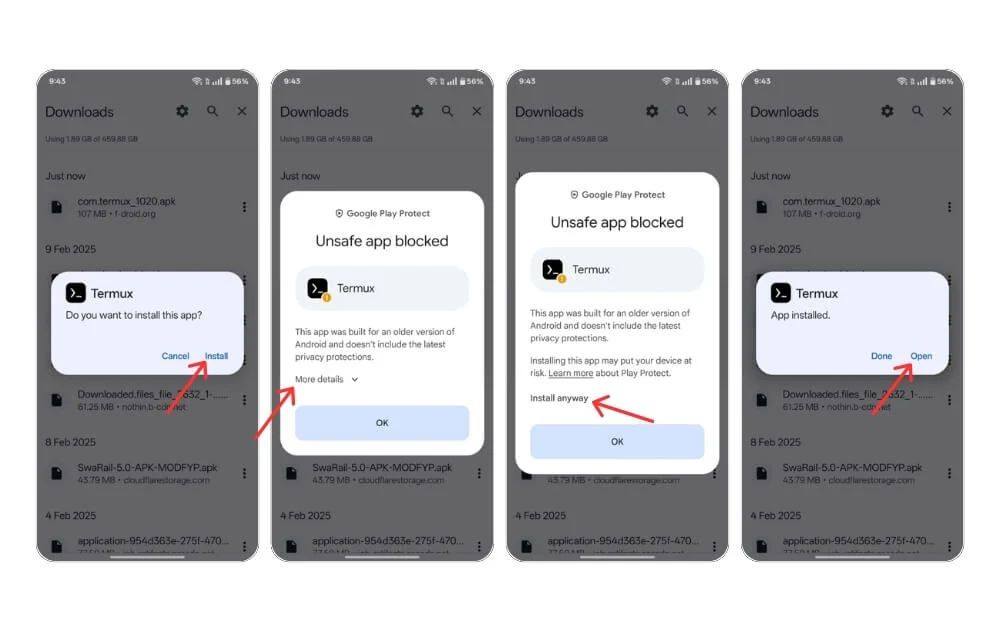

步骤1.6 :转到下载的文件,然后单击安装。如果您需要权限,请在Android设置中启用“从未知来源安装” 。在您的设备上安装和开放期限。

步骤1.7:如果有安全提示,请单击更多选项,然后点击安装选项,并且该应用程序将成功安装在您的设备上。

步骤1.7:如果有安全提示,请单击更多选项,然后点击安装选项,并且该应用程序将成功安装在您的设备上。

步骤2:现在让我们设置Termux

到达那里后,您必须设置Termux才能在设备上运行。

为此,打开应用程序并授予存储许可。默认情况下,Termux在安装应用程序后无权访问手机文件。使用此命令,您可以授予访问Android文件,读取和存储数据并使用文件管理命令的权限。

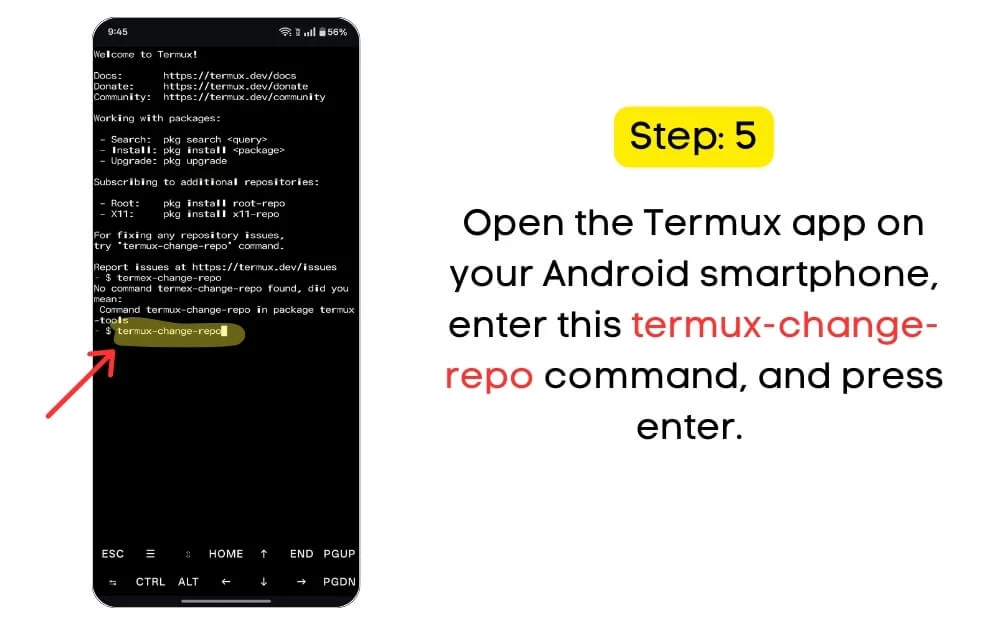

步骤2.1:在Android智能手机上打开Tarmux应用程序,输入此命令,然后按Enter。术语更改repo

但是,在执行此操作时,您可能会遇到常见错误,例如“权限拒绝”错误,这是在Android拒绝授予许可时发生的。转到“设置”>“应用程序权限”来修复此问题并手动启用存储权限。

用户面临的另一个常见错误是“无文件或目录”错误,这意味着存储未初始化。在这种情况下,关闭术语应用程序,重新打开它,强制停止并在运行命令后重新打开它。

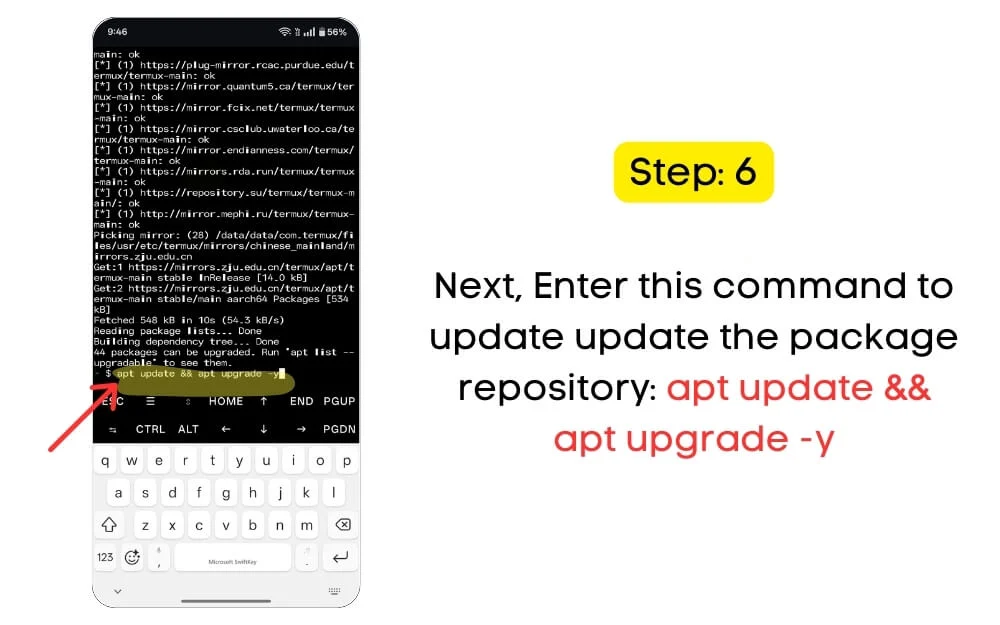

步骤2.2:接下来,您需要更新软件包存储库。您可以使用下面的命令来更新软件包存储库。在术语应用程序中,输入此命令: apt Update && apt升级-y

您必须更新术语存储库以更新所有软件包。这将帮助您获得最新的安全补丁并防止兼容性问题。但是,在执行此操作时,请确保您具有主动的Internet连接,可以从服务器中获取最新软件包,并将其安装在您的Termux应用程序上。

步骤3。接下来,安装Proot发行和Debian 12

接下来,您必须在Termux中安装Proot-Distro和Debian。 ProOt软件包允许您在termux Inside termux内运行Linux发行版。

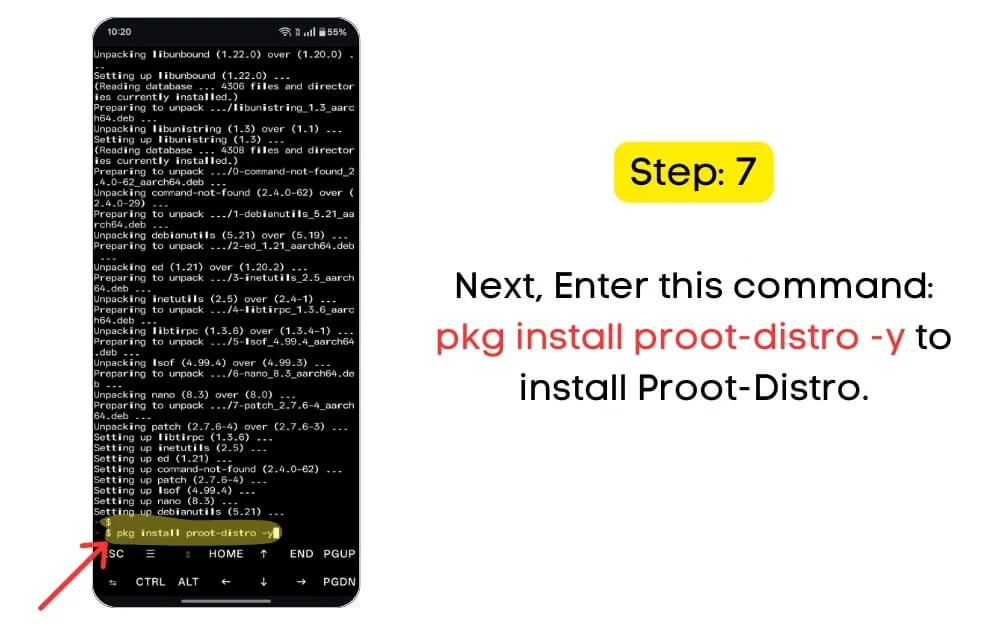

步骤3.1:要安装proot发行版,请输入以下命令: pkg install proot -distro -y在termux应用程序中,然后按Enter。

在执行此操作时,遇到“未找到的软件包”错误意味着Termux尚未更新。同样,运行APT Update && APT升级-Y命令,还确保在使用此命令时具有活动的Internet连接。

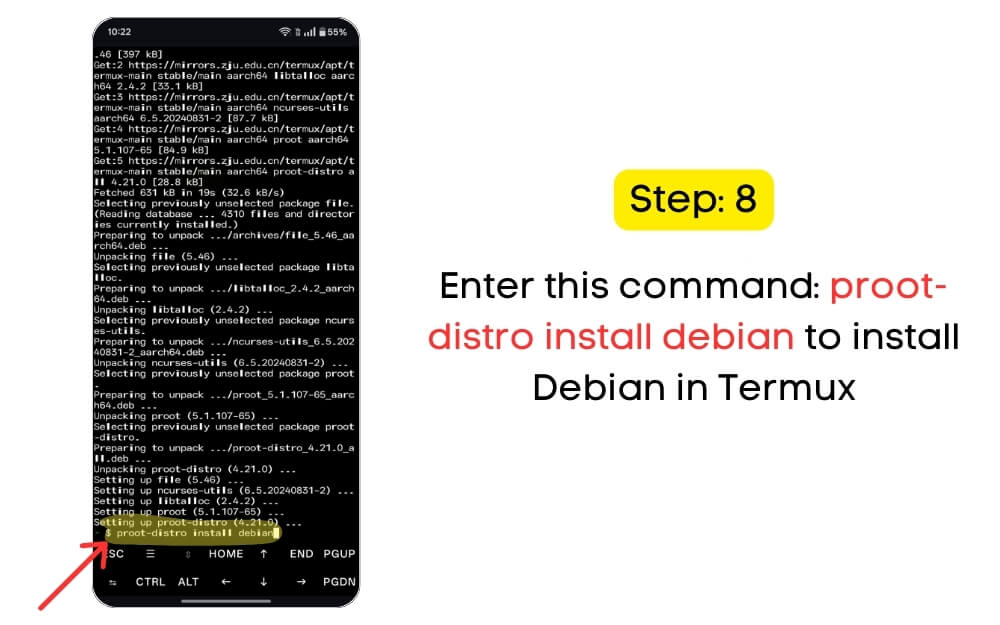

接下来,您需要在Termux中安装Debian 。 Debian是一种免费的开源Linux发行版,轻巧,使用ProOt-Distro在您的Android上运行。您可以使用以下以下命令安装最新版本的Debian。另外,请确保您在设备上有足够的存储空间和稳定的Internet连接。

步骤3.2:在终端中输入此命令: proot-distro安装debian

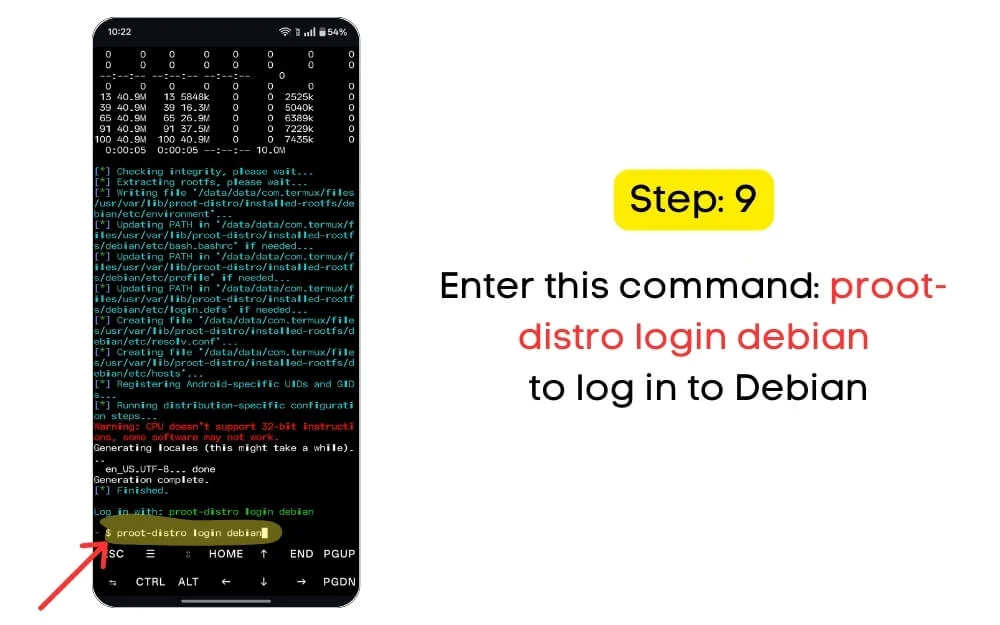

步骤3.3:接下来,您必须使用以下命令登录到Debian: proot-distro登录debian。

步骤4。安装Tmux&Ollama以安装和使用DeepSeek R1

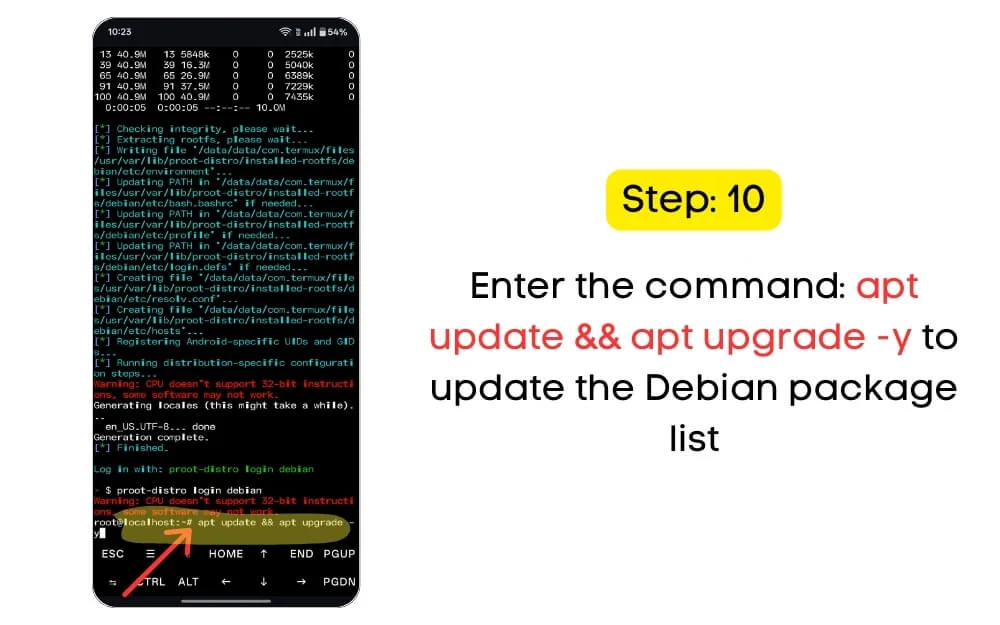

接下来,您必须在设备上安装Tmux和Ollama,以在本地运行DeepSeek R1。为此,您首先需要更新Debian软件包列表。您可以使用以下命令将所有Debian软件包列表更新为最新版本。

步骤4.1:输入以下命令: APT UPDATE && APT升级-Y以更新Debian软件包列表。

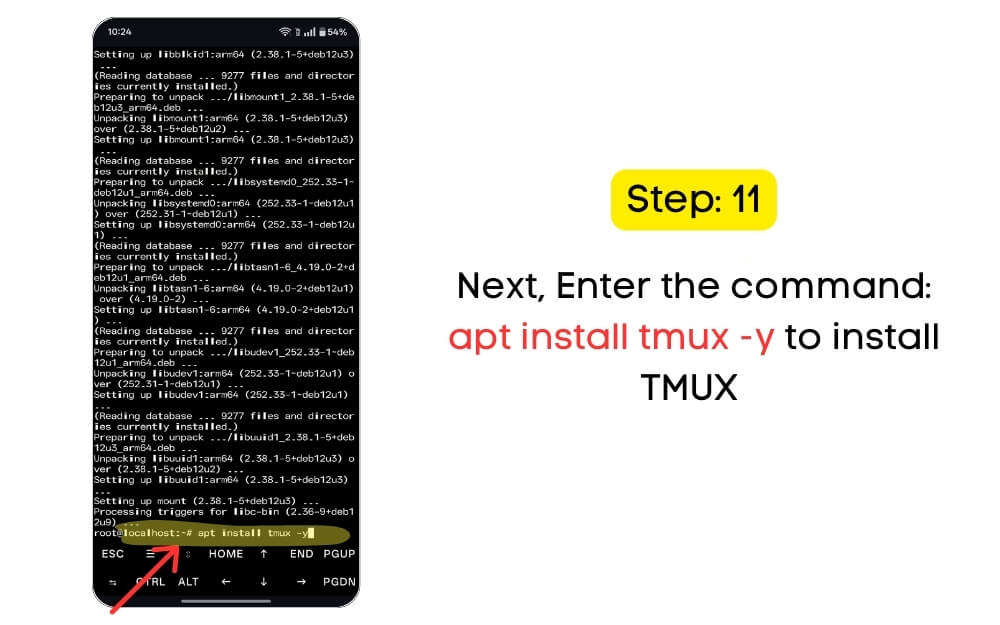

接下来,您需要安装TMUX来管理多个终端会话。 TMUX允许您在单个窗口内运行多个终端会话。安装TMUX的主要原因是,即使您不小心断开连接,它也可以帮助您保持AI模型在后台运行。它还带有其他好处,例如将您的终端分为多个窗格,以更好地多任务处理和同时运行多个任务。

步骤4.2:使用以下命令: apt install tmux -y安装tmux

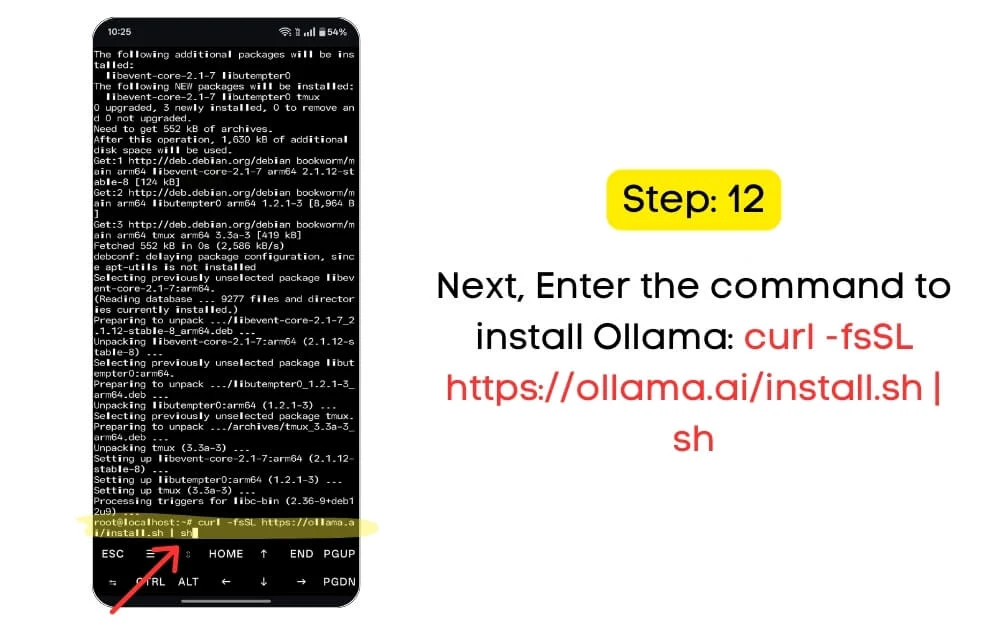

接下来,您需要安装Ollama,这是一种为Android设计的工具,可让您可以在设备上本地运行AI模型。您可以使用此工具在设备上本地运行DeepSeek R1和Meta Llama。它还支持诸如chatgpt之类的离线AI接口。

步骤4.3:完成所有操作后,必须在设备上本地安装并运行DeepSeek R1。使用以下命令安装Ollama: curl -fssl https://ollama.ai/install.sh | sh

步骤5。安装和运行DeepSeek R1

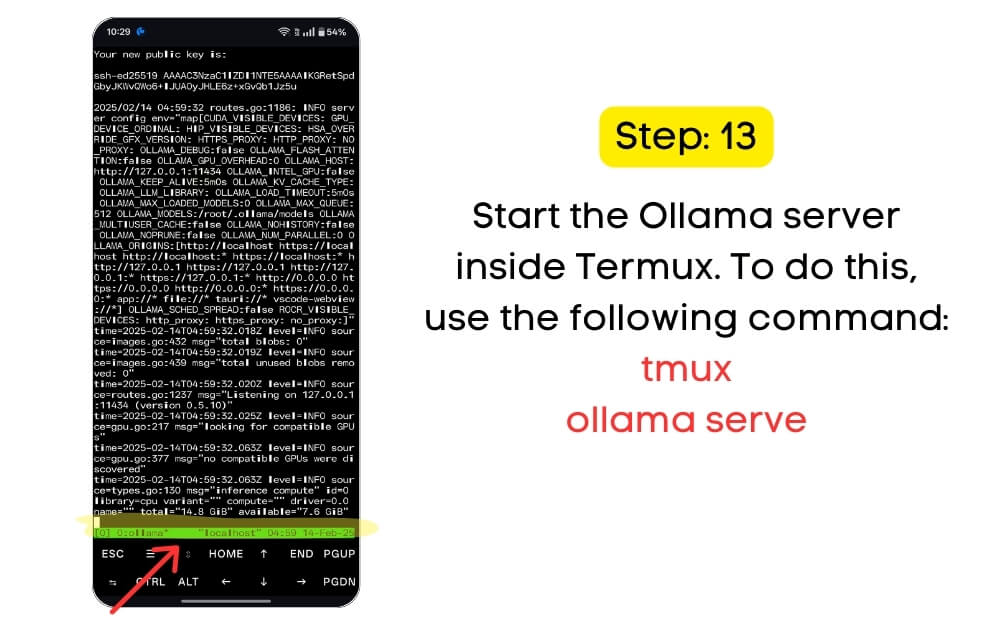

接下来,您需要在Termux内部启动Ollama服务器。为此,请使用以下命令:

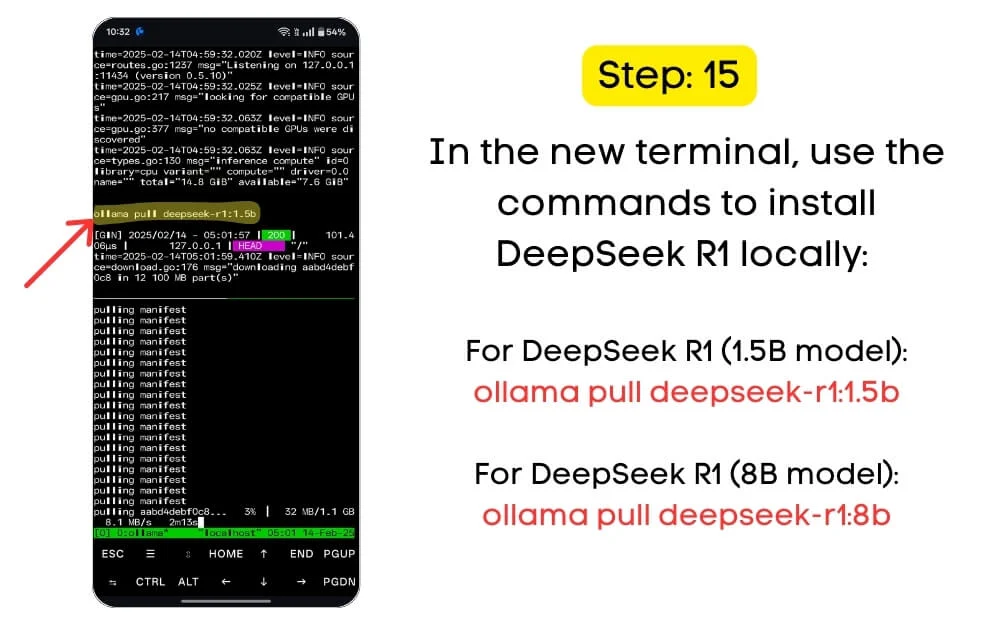

步骤5.1:步骤启动tmux内部的Ollama服务器: tmux ollama服务

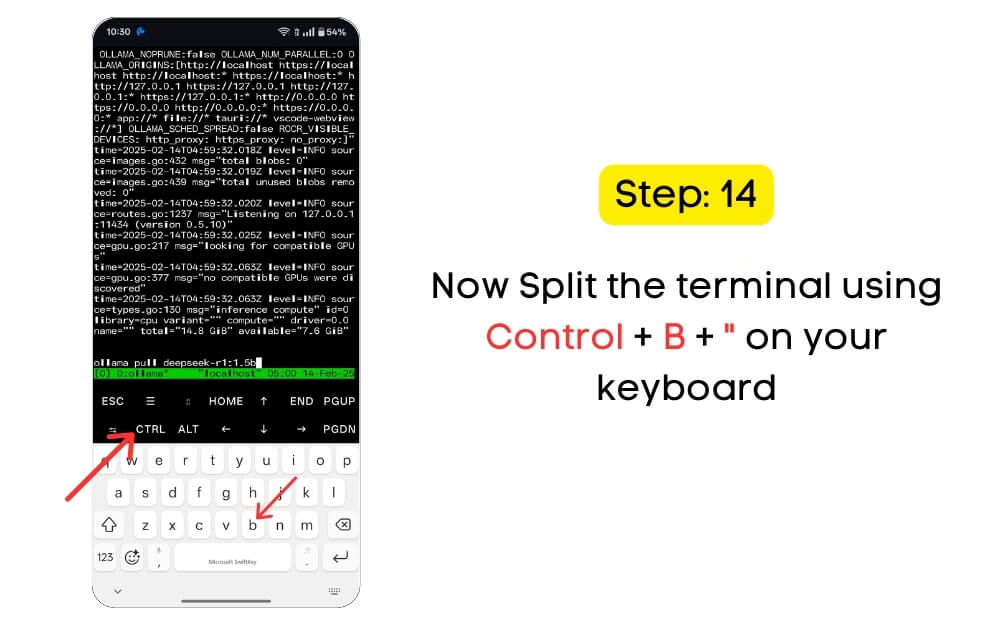

步骤5.2:打开一个新的TMUX窗口,然后将终端分成多个窗格。在一个窗格中运行AI模型,监视日志或输入另一个终端中的命令时,这可能会有所帮助。使用以下快捷方式将终端分开:单击控件+B+”

接下来,您必须在设备上本地安装DeepSeek R1 1.5B型号。 DeepSeek R1型号有几种型号。由于Android的资源有限,并且在本地运行这些模型需要大量资源,因此1.5B模型是大多数Android设备最可靠的模型。这是DeepSeek R1支持的模型列表。

模型变体 | 存储要求 | 最小要求 |

|---|---|---|

DeepSeek-r1:1.5b | 1.1 GB | RAM:8 GB - 处理器:Snapdragon 8 Gen 2或同等 - 存储:12 GB的自由空间 |

DeepSeek-r1:7b | 4.4 GB | - RAM:8 GB - 处理器:Snapdragon 8 Gen 2或同等 - 存储:12 GB的自由空间 |

DeepSeek-r1:8b | 4.9 GB | RAM:8 GB - 处理器:Snapdragon 8 Gen 2或同等 - 存储:12 GB的自由空间 |

DeepSeek-r1:14b | 9.0 GB | - RAM:8 GB - 处理器:Snapdragon 8 Gen 2或同等 - 存储:12 GB的自由空间 |

DeepSeek-r1:32b | 22 GB | - RAM:8 GB - 处理器:Snapdragon 8 Gen 2或同等 - 存储:12 GB的自由空间 |

DeepSeek-r1:70b | 43 GB | - RAM:8 GB - 处理器:Snapdragon 8 Gen 2或同等 - 存储:12 GB的自由空间 |

使用以下命令下载设备的DeepSeek R1 1.5B本地型号。这将下载并将其保存在您的设备上。确保您的设备对每种型号具有最少所需的存储空间。

步骤5.3:在新的Termux Windows中,使用命令安装DeepSeek R1(1.5B型号): Ollama Pull DeepSeek-R1:1.5B

如果您有高端旗舰设备,则可以使用同一命令安装8B型号。同样,如果您有其他高端设备,则可以在设备上本地安装15B参数模型。

对于您的信息,模型参数越多,模型就越有能力。对于大多数用例,1.5B参数模型是简单的选择。但是,8B参数模型是合理的,如果您想要更多的知识和更好的性能,通常会建议使用。

就是这样。现在,您已在设备上成功安装了DeepSeek R1。现在,安装了DeepSeek R1,您可以使用Termux在设备上本地运行。

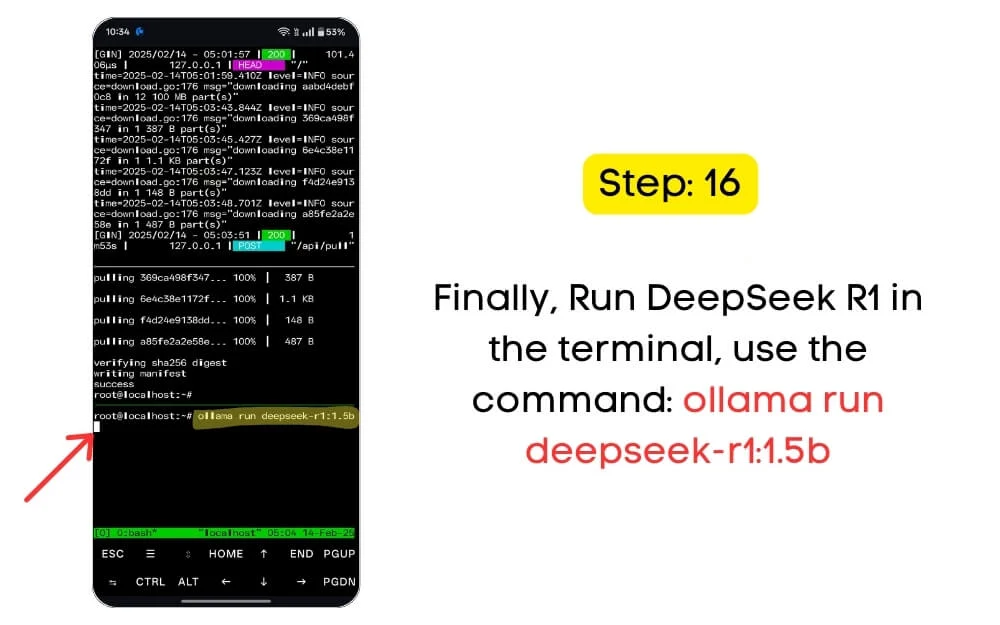

第6步。在您的设备上本地运行DeepSeek

步骤6.1:要在终端中运行DeepSeek R1,请使用命令: Ollama运行DeepSeek-R1:1.5B。

确保您在命令中使用正确的型号。如果安装了1.5B型号,请在命令中使用相同的模型名称。如果安装了8B型号,请使用命令。

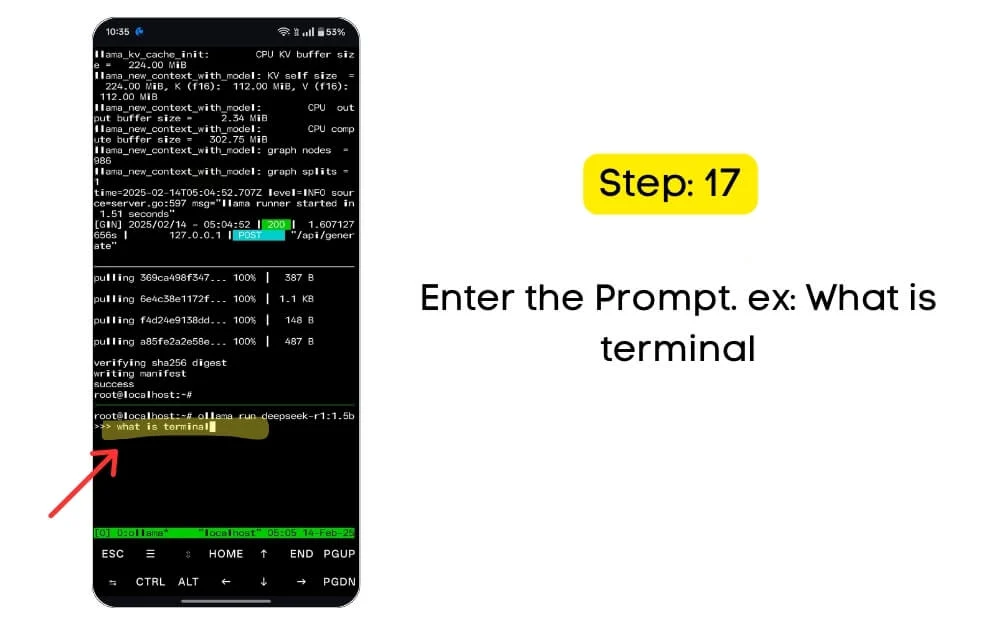

现在,您可以尝试使用文本输入与模型进行交互。由于所有内容都贯穿整个终端,因此将没有GUI(图形用户界面)可以与ChatGpt进行交互。您可以使用文本输入并在同一终端中获取结果。

根据设备的本地存储和处理能力,该模型将根据可用资源生成输出。这是用于在设备上本地管理您的AI会话的最常见的Termux快捷方式。您可以使用CTRL + C停止AI模型,CTRL + D退出,返回模型等等。

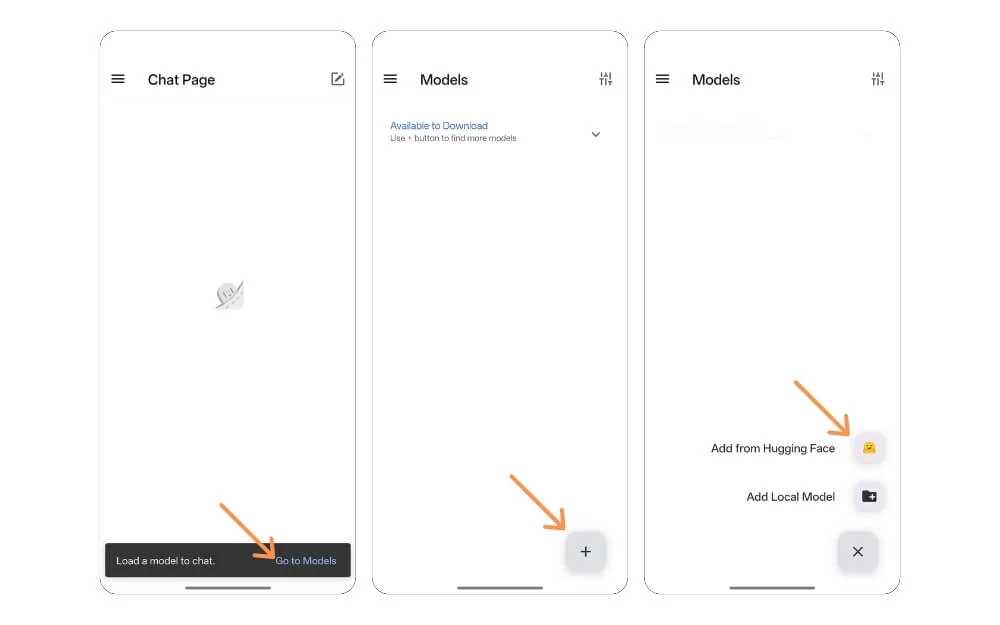

使用PocketPal在设备上本地运行DeepSeek R1

如果找到上述方法压倒性的方法,则可以使用PocketPal AI,该应用程序是一个免费的应用程序,该应用程序在设备上本地安装并运行AI模型。按照以下步骤操作。

步骤1:从Google Play商店安装PocketPal应用程序。

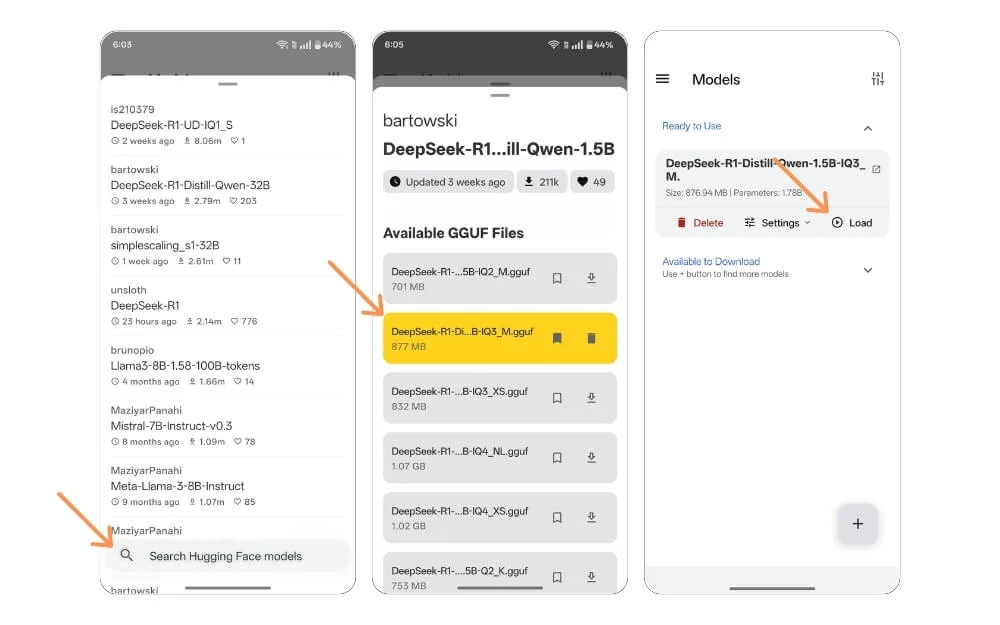

步骤2:打开应用并转到模型

步骤3:单击加上图标,然后从拥抱脸上点击添加。

步骤4:使用按钮中的搜索栏并搜索DeepSeek R1型号。

步骤5:根据您的设备存储限制选择模型,然后单击下载图标。等待模型下载。

步骤6:下载后,返回主屏幕,选择模型,然后单击加载。

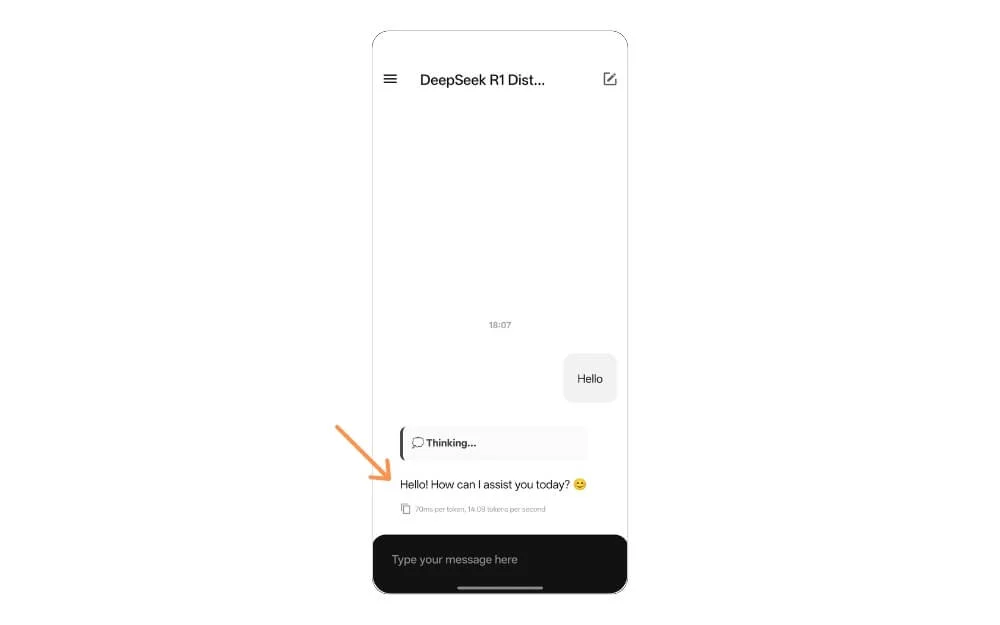

这将在您的设备上本地加载DeepSeek R1。与上述方法不同,它为您提供了与模型交互的聊天图形接口。如果需要,也可以关闭Internet连接。

在您的手机上本地运行AI模型

尽管DeepSeek具有破坏性,对消费者非常有益,但一些报告称DeepSeek可以将数据发送给中国公司。随着该型号在本地设备上运行,数据停留在您的设备上。另外,如果您对旗舰智能手机的规格有良好的规格,那么DeepSeek的速度更快且没有缓慢的加载时间可以响应,云模型通常就是这种情况。所有这些使DeepSeek R1成为安装,运行和使用LLM本地在您的设备上的重要资源。

我分享了您详细的,全面的逐步帮助。如果您在安装时仍然遇到任何问题或错误,则可以在下面发表评论,我将尝试为您提供帮助。希望您发现本指南有帮助。另外,请查看我们在Mac和Windows上本地安装DeepSeek的指南;这对您的专业和学生工作任务非常有帮助。