美國孩子可以從社交機器人學到什麼

已發表: 2024-01-21如果你的孩子接受機器人輔導,你會有什麼感覺? 社交機器人——能夠說話、模仿和回應人類情感的機器人——已經被引入世界各地的教室。

研究人員用它們為新加坡的學前班學生朗讀故事,幫助伊朗 12 歲的孩子學習英語,幫助瑞士的幼兒提高書寫能力,並教導英國患有自閉症的學生在社交互動中保持適當的身體距離。

一些專家認為,這些機器人可能會在學校中「像紙張、白板和平板電腦一樣普遍」。

由於社交機器人有身體,人類對它們的反應與對電腦螢幕的反應不同。 研究表明,小孩子有時會接受社交機器人作為同伴。

例如,在筆跡研究中,一名 5 歲男孩在互動結束幾個月後繼續向機器人發送信件。

身為教育學教授,我研究世界各地教師工作的不同方式。

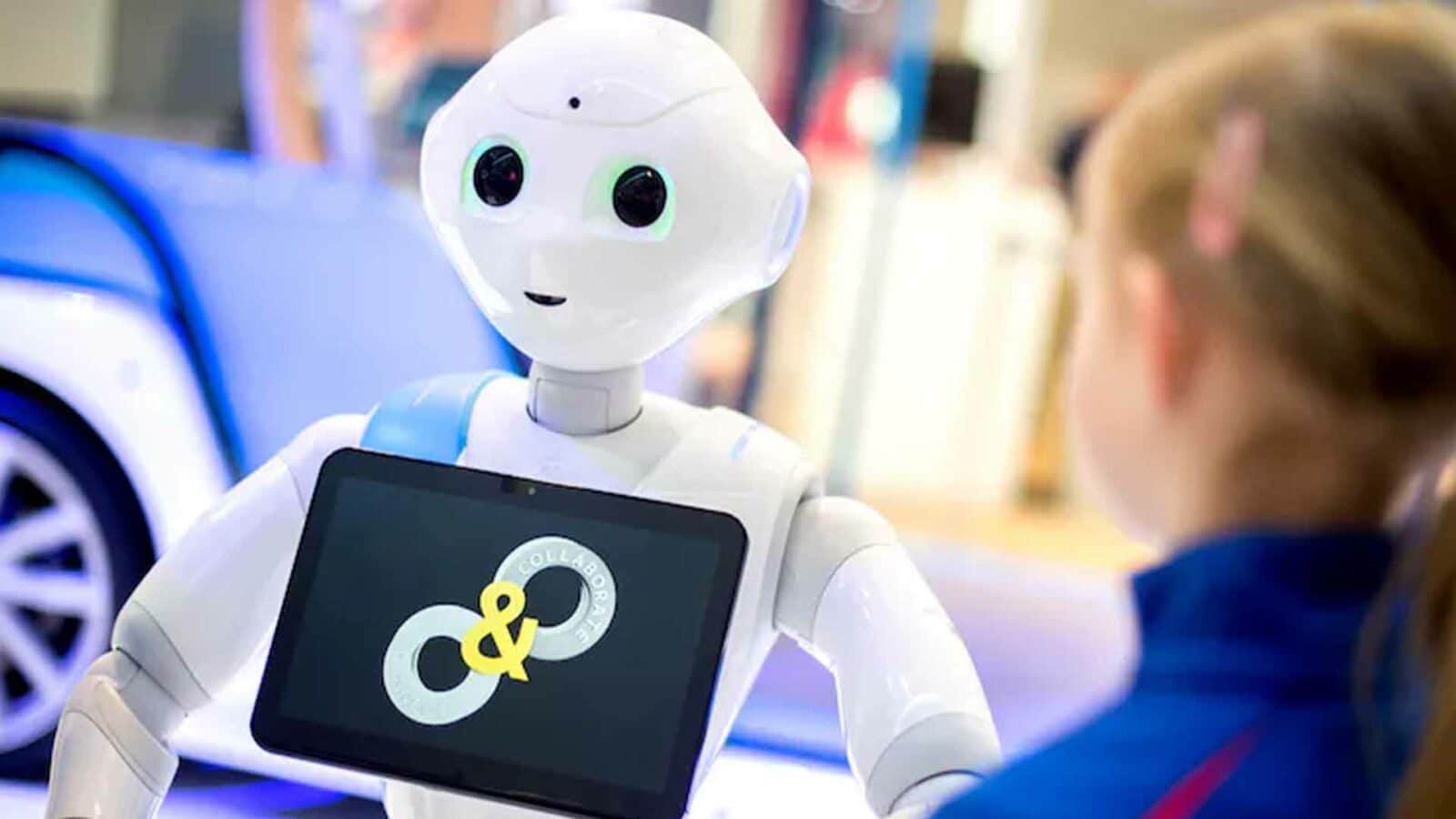

為了了解社交機器人如何影響教學,我和研究生 Raisa Gray 向美國一所公立中小學引入了一個 4 英尺高的人形機器人,名為“Pepper”

我們的研究揭示了當前一代社交機器人的許多問題,使得社交機器人不太可能很快進入課堂。

尚未準備好迎接黃金時段

許多關於學校社交機器人的研究都是以非常有限的方式進行的。

如果沒有研究人員的幫助或乾預,兒童和社交機器人不得自由互動。 只有少數研究在現實課堂環境中使用社交機器人。

此外,機器人研究人員經常在課堂環境中使用「綠野仙蹤」技術。 這意味著一個人正在遠端操作機器人,給人的印像是機器人真的可以與人類交談。

社交能力有限

機器人需要安靜。 任何類型的背景噪音——換班鈴聲、擴音器公告或其他對話——都可能破壞機器人追蹤對話的能力。

這是機器人融入學校面臨的主要問題之一。

對於程式設計師來說,創建能夠實現人類無意識所做的事情的軟體和硬體系統是極其困難的。

例如,當前世代的社交機器人無法與一小群人互動,也無法追蹤多人的臉部表情。

如果一個人正在與另外兩個人談論他們最喜歡的足球隊,而其中一個聽眾皺起眉頭或翻白眼,那麼人類很可能會注意到這一點。

機器人不會。 此外,除非使用條碼或其他識別設備,否則當今的社交機器人無法識別個人。 這使得他們不太可能進行現實的社交互動。

臉部辨識軟體很難在充滿移動的人的房間中使用,也引發了有關保護學生個人資訊安全的嚴重道德問題。

對話是預先編程好的

為了讓機器人執行任務,我們的學生必須掌握機器人附帶的教學。 一些學生很快就發現機器人只能對某些基本例程做出反應。

例如,Pepper 可以回答“你多大了?” 但不是“你多大了?” 其他學生一直試圖像機器人一樣與機器人互動,但對其非人類的反應感到非常沮喪。

當機器人無法回答問題或以錯誤的方式做出反應時,學生就會意識到機器人並沒有真正理解他們,機器人的對話是預先編程的。 機器人無法真正理解社會背景。

在我們的研究中,學生學會了適應機器人。 一群女孩站在機器人周圍,而其中一個女孩不停地撫摸它的頭。

這導致機器人執行「我感覺像一隻貓」或「我今天很癢」的例行公事。 這似乎讓女孩們很高興。 他們似乎滿足於讓一個人與機器人互動,而其他人則在一旁觀看。

無法在教室裡輕鬆走動

看過 YouTube 上有關機器狗奔跑和跳躍的影片的學生可能會失望地發現,大多數社交機器人無法輕鬆地在教室裡移動。

我們研究中的老師對佩珀無法送咖啡給他們感到失望。

這些問題不僅限於學校環境。 一些醫療機構中的服務機器人已被編程為提供藥物,但這需要特殊的感測器和編程。

當商店和餐廳正在試驗送貨和清潔機器人時,當蘇格蘭的一家雜貨店試圖使用 Pepper 進行客戶互動時,該機器人在一周後被解僱。

社交機器人可以教孩子什麼

雖然目前學校使用的社交機器人比較挑剔且功能有限,但它們仍然可以提供有用的學習體驗。

學生可以利用它們來更多地了解機器人技術、人工智慧和真實人類行為的複雜性。

正如一位研究人員所寫,“機器人充當了學生理解人類的橋樑。”

與機器人的限製作鬥爭可以讓學生真正了解人類社交互動的複雜本質。

親身實踐社交機器人的機會向學生展示了對機器人進行程式設計以模仿人類行為是多麼困難。

社交機器人還可以為學生提供有關人工智慧的重要學習機會。 在日本,Pepper 被用來向學生介紹生成式人工智慧。

學生可以將 ChatGPT 與 Pepper 的實際存在聯繫起來,看看 AI 在多大程度上改善了 Pepper 的溝通,以及這是否使其更加逼真。

隨著人工智慧成為我們工作和生活中越來越重要的一部分,教育工作者需要讓學生做好準備,批判性地思考與社交機器一起生活和工作意味著什麼。

在真正的人類老師的指導和監督下,學生可以探索為什麼我們想像機器人一樣與人交談。

編輯推薦:

- 2024 年人工智慧挑戰:三位領先人工智慧研究人員的見解

- 人類和 ChatGPT 反映了共同的語言模式——具體如下

- ChatGPT 人工智慧交易員:太快、太激烈、太冒險?

- ChatGPT 和其他語言的人工智慧和我們一樣不理性

編者註:本文由賓州州立大學教育管理教授 Gerald K. LeTendre 撰寫,並根據知識共享授權從 The Conversation 重新發布。 閱讀原文。